1.jdk安装

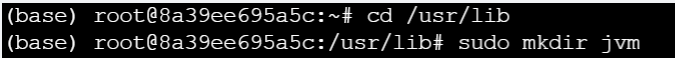

创建/usr/lib/jvm 目录:

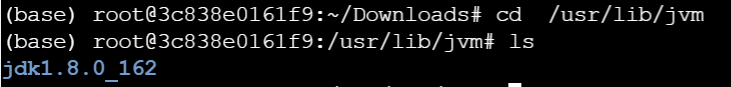

把包放进去:

修改bashrc:

2.pyspark安装

3.spark安装

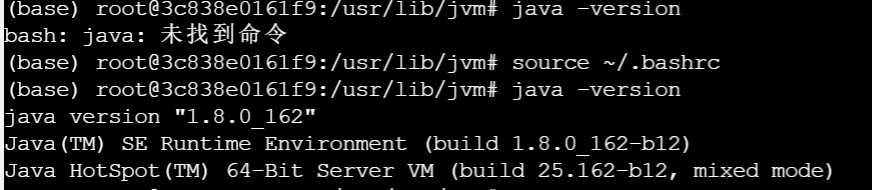

下载:

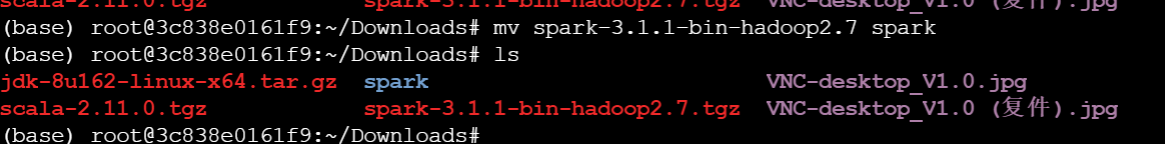

解压改名:

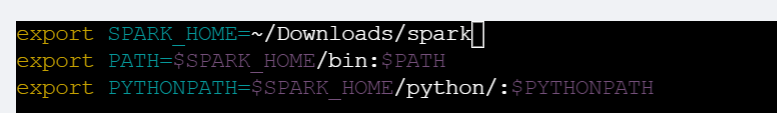

修改bashrc:

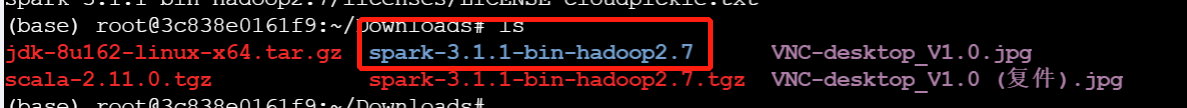

source ~/.bashrc

本来我的配置到这里就结束了,但是在跑程序的过程中,创建完dataframe,调用df.show()的时候就会出错,更不要说其他功能了(这些代码在本地都是可以运行的)。

报错截图:

可能是没有装hadoop的原因,所以又去装hadoop。

4. 补充:hadoop安装配置

Hadoop3.1.3安装教程_单机/伪分布式配置_Hadoop3.1.3/Ubuntu18.04(16.04)

4.1 安装hadoop3.1.3:

4.2 hadoop伪分布式配置:

修改core-site.xml

修改hdfs-site.html

执行namenode格式化。这一步的反应就和教程里不一样了,虽然我没有找到error。

开启namenode和datanode守护进程(报错)

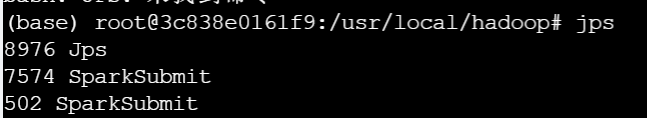

通过命令 jps 来判断是否成功启动。没有列出 “NameNode”、”DataNode” 和 “SecondaryNameNode”,说明没有成功启动。

(ps:这一番失败的尝试之后,代码的报错问题和之前一样。)

878

878

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?