本笔记仅记录《统计学习方法》中各个章节算法|模型的简要概述,比较泛泛而谈,用于应对夏令营面试可能会问的一些问题,不记录证明过程和详细的算法流程。大佬可自行绕路。

更多章节内容请参阅:李航《统计学习方法》学习笔记-CSDN博客

目录

EM算法概述:

概率模型中有时除了含有观测变量外,还含有隐变量或潜在变量。如果只含有观测变量,便可以直接用极大似然估计或者贝叶斯估计法估计参数。但是当模型含有隐变量时,就需要用到EM。EM算法就是含有隐变量的概率模型参数的极大似然估计或称“极大后验概率估计法”。

EM算法的每次迭代由2步组成:求期望和求极大,所以称为期望极大算法。

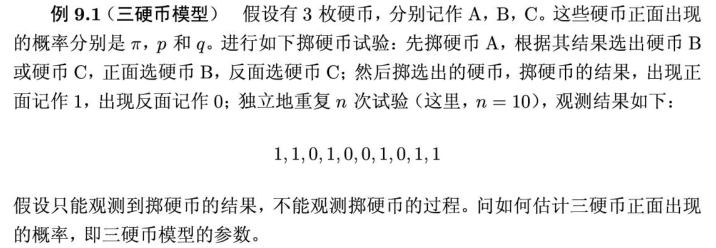

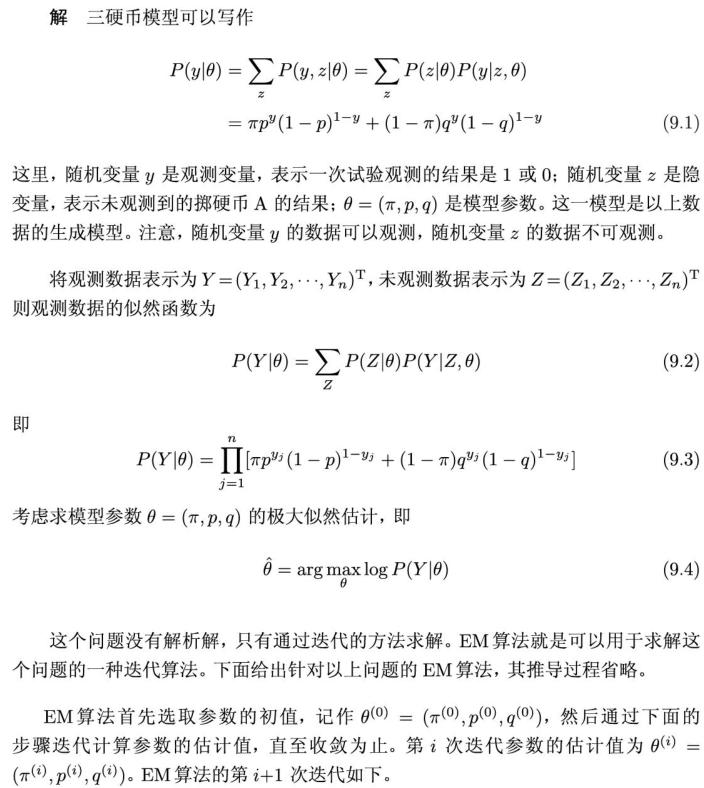

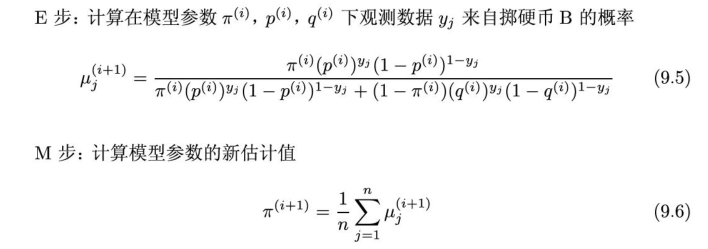

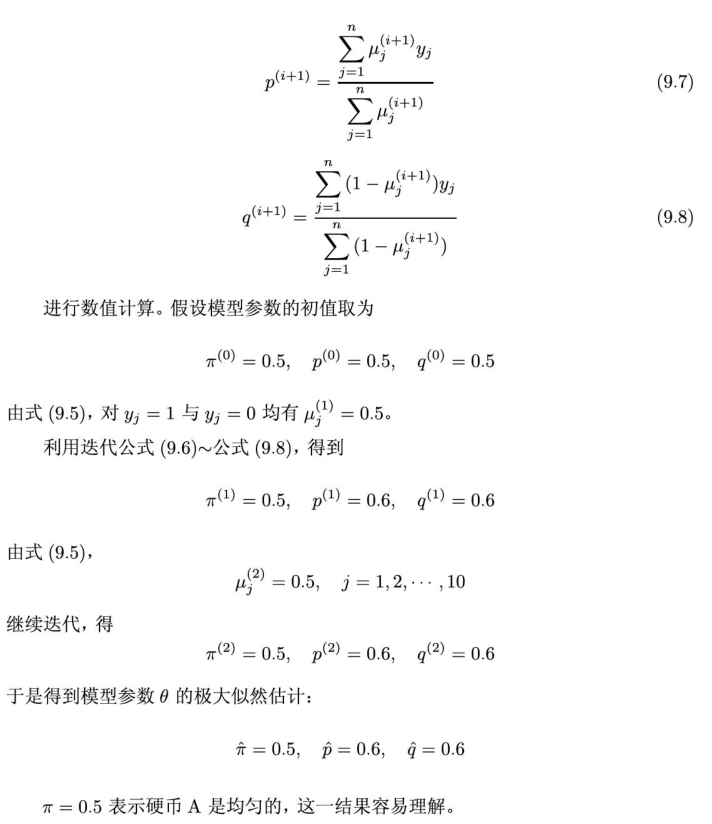

一个使用EM算法的例子:

EM算法与初值的选择有关,使用不同的初值可能得到不同的参数估计值。

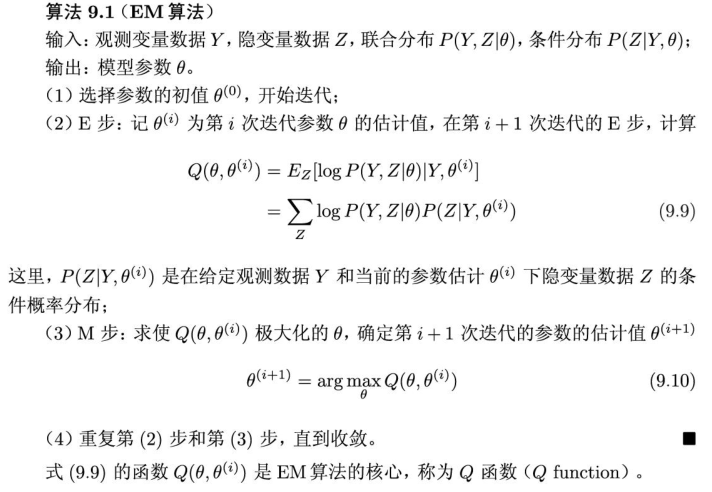

EM算法:

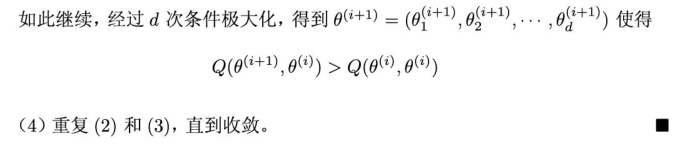

算法流程:

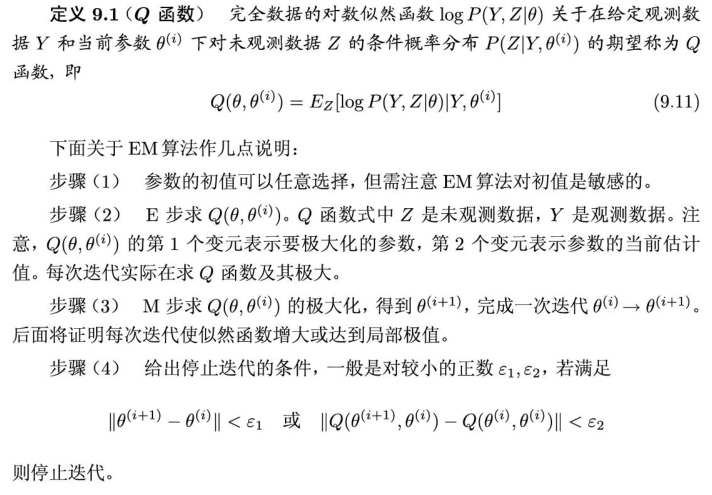

Q函数:

EM算法的收敛性:

EM算法智能保证参数估计序列收敛到对数似然函数序列的稳定点,不能保证收敛到极大值点。所以在应用中,初值的选择变得极为重要,常用的方法是选取几个不同的初值进行迭代,然后对得到的各个估计值加以选择比较,从中选择最好的。

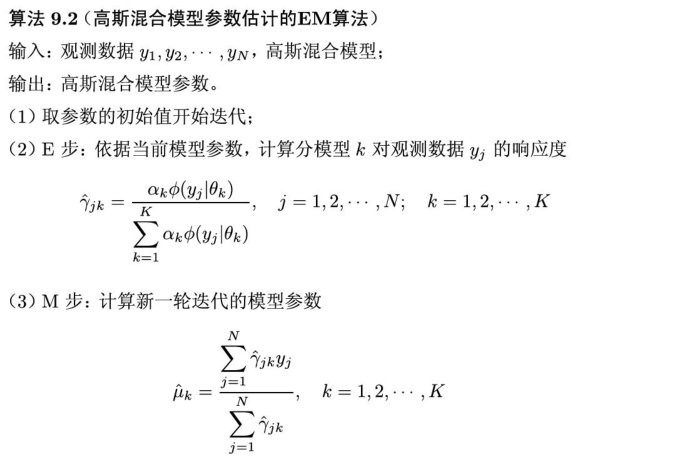

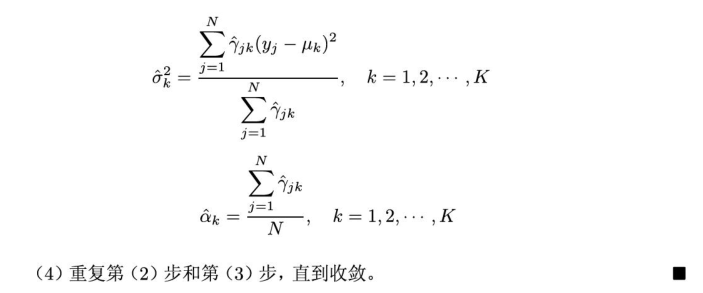

EM算法在高斯混合模型中的应用:

EM算法的推广:

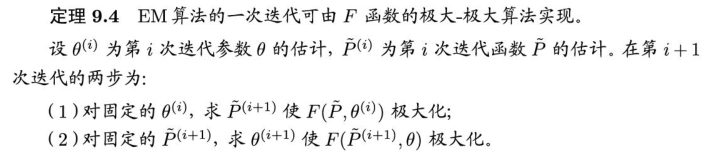

F函数的极大-极大算法:

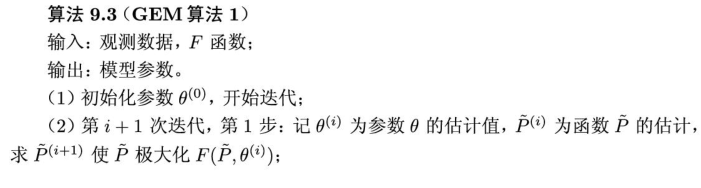

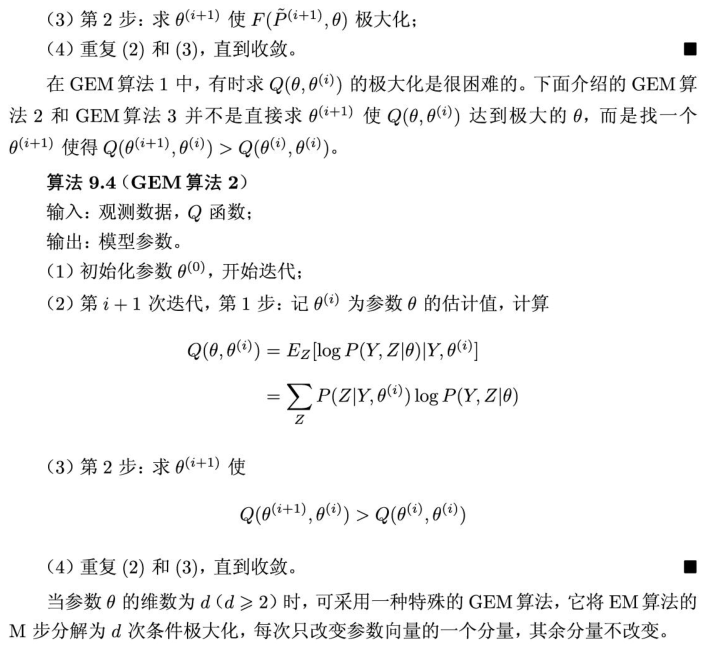

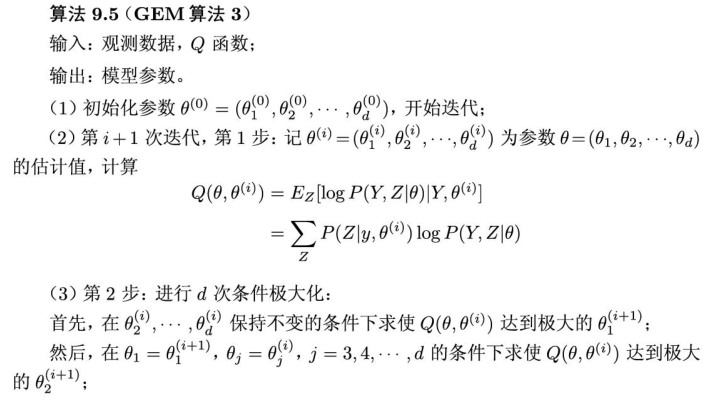

GEM算法:

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?