文章目录

论文略读:Feature Modulation Transformer: Cross-Refinement of Global Representation via High-Frequency Prior for Image Super-Resolution

动机

大多数研究都优先考虑了变压器块的设计以捕获全局信息,而忽略了纳入高频先验的重要性,而本文认为这些高频先验是有益的。此外,从实验中发现变压器结构更擅长捕捉低频信息,但与卷积网络相比,构建高频表征的能力有限。于是本文结合CNN和Transformer的优点,提出了新的网络结构-特征调制变压器(Feature Modulation Transformer)。

频率影响分析

下图为频率分析:

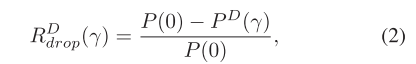

给定HR图像,使用FFT提取频谱,然后扁平化为序列,按幅度升序排列。序列长度为L,我们定义了一个由跌落比γ确定的阈值,0≤γ≤1,位于γ·L位置对应的数量级上。幅度低于该阈值的频率分量被设为零。在此之后,我们执行逆快速傅里

叶变换(IFFT)以生成频率下降的HR图像,称为XdropHR(γ)。这个过程的公式如下。

之后,我们使用双三次内插法对XdropHR(γ)进行下采样,以获得LR版本的XdropLR(γ)(例如×4下采样)。最后,我们采用基于cnn的和基于变压器的SR模型来生成超分辨对应的XdropSR (γ)。

为了分析CNN和变压器对高频信息的依赖性,我们计算了XdropSR(γ)和XdropHR之间的峰值信噪比(PSNR) P D(γ)。然后我们绘制PSNR下降趋势,以可视化两种结构之间的差异。如图1(a)所示,定义了每个降比的PSNR降比。

其中P(0)为XSR与XHR之间计算的不下降的PSNR。从图中可以看出,变压器模型对高频信息的敏感性降低,对低频信息的捕获能力较强,随着丢弃高频信息比例的增加,变压器模型的PSNR变化比CNN模型小。

此外,我们进行了另一项实验,以评估不同结构在重建高频信息方面的有效性。具体来说,我们计算了XSRdrop(γ)和XHR之间的PSNR pe (γ),并绘制了前面描述的性能下降趋势。每个降比的PSNR降比可表示为

从图1(b)中我们可以看到,随着高频信息被丢弃比例的增加,变压器模型的PSNR比CNN模型变化更大,说明变压器模型从低频重构高频信息的能力有限。

基于这些观察,我们认为变压器需要CNN的帮助来增强其恢复复杂细节的能力。为了解决这个问题,我们提出了一种结合CNN和变压器优点的方法。具体来说,我们引入CNN信息作为高频先验,以帮助变压器精炼全局表示。

方法

模型结构

浅层特征提取、残差交叉细化融合组(rcrfg)和重建。

概述:

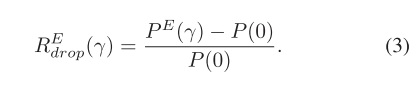

浅层特征提取模块由单个卷积层组成,重建模块后面是SwinIR[21]。RCRFG组件由多个交叉细化融合块(crfb)组成,每个融合块由三种类型的块组成:高频增强残差块(hferb)、移位矩形窗口注意块(SRWABs)和混合融合块(HFBs)。

输入LR图像经过3×3卷积层处理,获得浅层特征。然后将这些特征输入到一系列rcrfg中以学习深度特征。在最后一次RCRFG之后,一个3 ×3卷积层对特征进行聚合,并在其输出与浅层特征之间建立残差连接,便于训练。重建模块采用3 ×3卷积层对特征进行聚合,shuffle层[33]用于获得最终的SR输出图像。

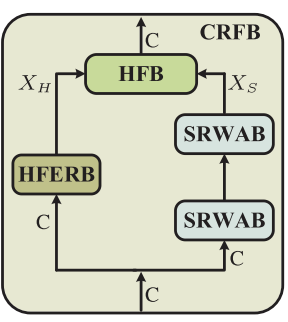

高频增强残差块(High-frequency Enhancement Residual Block)

HFERB旨在增强高频信息,如图2所示。它包括局部特征提取(LFE)分支和高频增强(HFE)分支。

(1)、分割通道

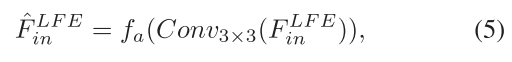

(2)、提取局部高频特征

(3)、增强高频特征

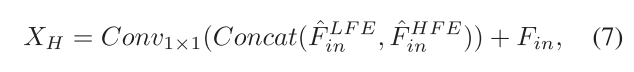

(4)、信息融合

1x1 卷积

(5)、残差连接

为了使网络从多尺度信息中获益并保持训练稳定性,引入了跳跃式连接。整个过程可以表示为

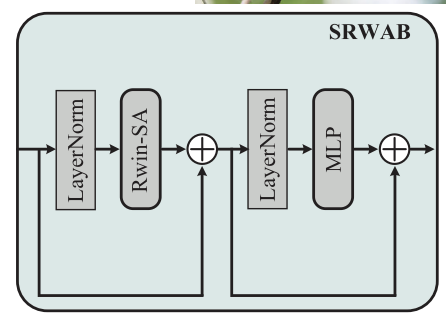

矩形移位窗口注意力块(Shift Rectangle Window Attention Block)

input:

SRWAB:

其中d取d = C/M , M is the number of heads。

B是动态相对位置偏置。

引入卷积,增强局部提取能力。

改进:

1、为了从不同的轴上捕获信息,我们利用了两种类型的直角窗:水平窗和垂直窗。

2、与利用注意力遮罩将计算限制在同一窗口的传统操作不同,在实践中,我们消除了mask attention,实现了跨不同窗口的更广泛的信息交互。

其中W^p是融合特征的线性投影,V -Rwin和H-Rwin表示垂直和水平矩形窗口注意力。

混合融合块(Hybrid Fusion Block)

为了更好地整合CNN和变压器(HFERB和SRWAB)的优点。

将HFERB的输出作为高频先验查询,SRWAB的输出作为关键字,对SRWAB得到的全局特征进行赋值和计算,以细化得到的全局特征。

此外,大多数现有方法都侧重于空间关系,而忽略了信道信息。为了克服这一限制,我们基于渠道维度执行互注意来探索渠道依赖关系。这种设计将显著降低复杂性。利用空间注意力的传统方法往往会导致显著的计算复杂度(例如,O(N ^2C), NC),其中N表示序列的长度,C表示通道维度。相比之下,我们的通道注意力设计可以将二次分量转移到通道维度(例如,O(NC^2)),有效地降低了复杂性。

inter-attention:

其中α表示可学习参数。

添加细化特征Xs,得到融合输出Xfuse

使用MLP聚合特征:(类似SUNet中的双线性映射)

QA

高频先验?先验知识?

Transformer更适合捕获低频,与cnn相比高频表征的能力有限。

快速傅里叶变换获得频谱。

双三次内插法?用于构建LR图像。

信噪比?

融合特征的线性投影?

399

399

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?