LoRA的解释:一种高效微调预训练神经网络的方法

LoRA 解决的问题:

🔸 2021年初,微软与OpenAI合作探索GPT-3的商业可行性。

🔸 发现仅仅通过提示(prompting)不足以完成生产任务,例如将自然语言转换为代码生成任务。

🔸 微调是必要的,但由于模型检查点的规模庞大,成本过高。

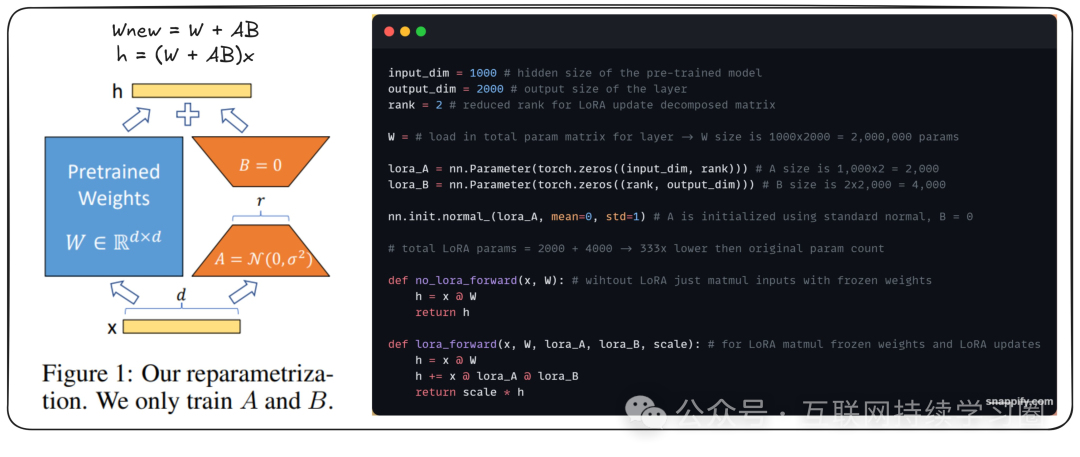

工作原理:

🔸 LoRA通过提出两个问题来推广全量微调(更新每个参数):

- 是否需要微调所有参数?

- 对于我们要微调的权重矩阵,更新在矩阵秩方面应该有多大的表达能力?

🔸 这两个问题定义了一个二维平面,在这个平面上,全量微调位于一个角(满秩且更新所有参数),而原点代表原始模型。

🔸 平面中的任意一点都是一个有效的LoRA配置。

🔸 更新矩阵的选定秩控制了微调过程的表达能力。

🔸 一个d×d的矩阵可以表示d维向量空间中的任何线性变换。

🔸 通过首先将输入转换到一个较低维度的空间,然后再转回原始空间,我们可以限制可以表示的线性变换类型。

🔸 这样可以减少需要存储的参数数量,从(dxd)减少到(dxr + dxr),其中r << d。

🔸 接近原点的点通常表现得与全量微调一样好——因为通常神经网络过度参数化,因此权重矩阵中充满了线性相关的元素。

🔸 这表明我们可以从低秩配置开始,并根据需要逐渐增加秩。

使用LoRA的常见做法:

🔸 如何选择更新矩阵的秩R:从低秩开始,并根据需要增加。

🔸 何时使用全量微调?:当在数据集上进行微调,这些数据集完全不同于基础模型预训练的数据集时(例如,如果你正在用火星语数据对英语模型进行微调,则可能需要全量微调)。

🔸 LoRA是否适用于任何模型架构?:只要模型使用矩阵乘法,就可以应用LoRA。因此,几乎所有的模型架构都可以使用LoRA!

LoRA的好处:

🔸 减少检查点大小:在GPT-3上,检查点大小从1TB减少到了25MB。

🔸 没有额外的推理延迟:LoRA更新可以在推理过程中与原始参数合并。W_new = W_old + AxB

🔸 快速切换任务的能力:LoRA模块可以高效地加载和卸载。(A_frenchxB_french)、(A_germanxB_german)、(A_spanishxB_spanish)

LoRA带来的一些有趣的想法:

🔸 在RAM中缓存LoRA模块以实现更快的模型切换和在不同的微调之间进行路由。

🔸 在训练集的不同批次上并行训练多个LoRA模块。

🔸 创建一个自适应模型树,其中每个节点是一个LoRA模块。

AI大模型学习福利

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

四、AI大模型商业化落地方案

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。

本文转自 https://blog.csdn.net/Javachichi/article/details/140918820?spm=1001.2014.3001.5502,如有侵权,请联系删除。

640

640

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?