卷积网路基础

- 卷积运算,二位卷积

- 填充,步幅

- 通道

- 1x1 卷积

卷积运算

二维卷积,基本算法,对应相乘再加和

-

填充与步幅

一般是在外圈做操作,补0

步幅是kernel 移动的大小 -

多输入通道

-

多输出通道

输出通道的卷积核,我们提供这样一种理解,一个 ci×kh×kw 的核数组可以提取某种局部特征,但是输入可能具有相当丰富的特征,我们需要有多个这样的 ci×kh×kw 的核数组,不同的核数组提取的是不同的特征。 -

1x1 卷积

1x1卷积核的互相关计算。输入和输出具有相同的高和宽。

1×1 卷积核可在不改变高宽的情况下,调整通道数。1×1卷积核不识别高和宽维度上相邻元素构成的模式,其主要计算发生在通道维上。假设我们将通道维当作特征维,将高和宽维度上的元素当成数据样本,那么1×1卷积层的作用与全连接层等价。 -

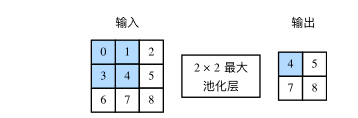

池化

池化层主要用于缓解卷积层对位置的过度敏感性

常见的卷积网络的结构

-

LeNet 模型

基本构成,卷积+ 池化+全连接

卷积层,kernel 5x5, 激活函数 sigmoid,

pool 层,平均池化 -

AlexNet

8层变换,其中有5层卷积和2层全连接隐藏层,以及1个全连接输出层。

将sigmoid激活函数改成了更加简单的ReLU激活函数。

用Dropout来控制全连接层的模型复杂度。

引入数据增强,如翻转、裁剪和颜色变化,从而进一步扩大数据集来缓解过拟合 -

主要的变化,采用小卷积核,relu激活函数 dropout方式。

-

VGG网络结构

VGG:通过重复使⽤简单的基础块来构建深度模型。

Block:数个相同的填充为1、窗口形状为 3×3 的卷积层,接上一个步幅为2、窗口形状为 2×2 的最大池化层。

卷积层保持输入的高和宽不变,而池化层则对其减半。

常见的网络结构: VGG16 VGG19

- GOOGLENET

基本的网络结构,Inception 模块

1X1 的卷积

多尺度

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?