一、IS分数简介

文本生成图像的评估也是一个很有挑战性的工作,IS分数是测量图像质量的一个通用指标。

IS用到了KL散度和熵的数学知识,其主要原理在于计算p(y|x)和p(y)之间的散度,IS分数越大越好。

二、IS分数 CUB定量实验步骤

以DF-GAN为例子:

第一步:B_VALIDATION改为True

根据DF-GAN的官方文档,首先将bird.yml中的B_VALIDATION改为True:

第二步:配置训练好的生成器

配置训练好的model,并将其放到code/bird中,重命名为netG.pth,DF-GAN官方也给出了训练好的模型:官方链接 ,打不开官方链接的可以点击CSDN链接,下载后放入指定文件夹即可。

第三步:采样生成图像

运行:python main.py --cfg cfg/bird.yml

可能出现的问题1:RuntimeError: Attempting to deserialize object on CUDA device

1 but torch.cuda.device_count() is 1

问题原因:模型在训练时使用了多块GPU,但是本机只有1块GPU

解决方案:指定用“cuda:0”,找到两个torch.load()

第一处在main.py的第57行:netG.load_state_dict(torch.load('models/%s/netG.pth' % (cfg.CONFIG_NAME))将其更改为:netG.load_state_dict(torch.load('models/%s/netG.pth' % (cfg.CONFIG_NAME), map_location='cuda:0'))

第二处在第254行将其更改为:state_dict = torch.load(cfg.TEXT.DAMSM_NAME, map_location='cuda:0')

可能出现的问题2:

RuntimeError: Error(s) in loading state_dict for NetG:

size mismatch for fc.weight: copying a param with shape torch.Size([4096, 100]) from checkpoint, the shape in current model is torch.Size([1024, 100]).

size mismatch for fc.bias: copying a param with shape torch.Size([4096]) from checkpoint, the shape in current model is torch.Size([1024]).

size mismatch for block0.c1.weight: copying a param with shape torch.Size([256, 256, 3, 3]) from checkpoint, the shape in current model is torch.Size([64, 64, 3, 3])

问题原因:在加载模型时,参数对应不上,尺寸mismatch

解决方案:查看训练出的模型model.py与此时做定量的model.py是否一样,查看yml文件的尺寸大小是否设置一样,特别是NF参数的设置。如果是使用的DF-GAN官方训练好的模型,要将NF设置为32,其他也要保持一致:

成功运行后,会进行自动采样生成若干图片,即成功

第四步:下载IS代码并配置

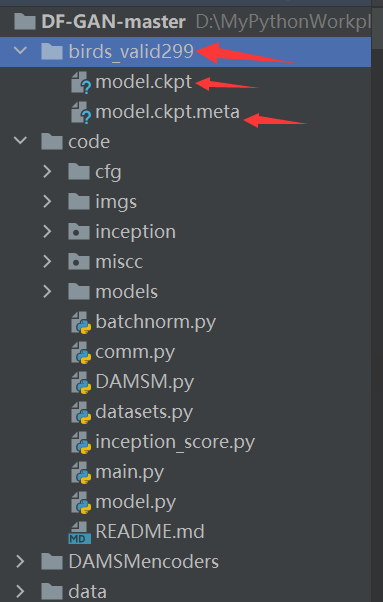

官方提供的IS分数(StackGAN用过的)代码:github链接,将其放入文件夹中位置如下:

第五步:下载预训练好的inception mode并配置

下载预训练好的inception model:官方链接、打不开可以点击:CSDN链接,将其放入文件夹指定位置,位置如下:

第六步:配置inception_score.py,更改读取的路径

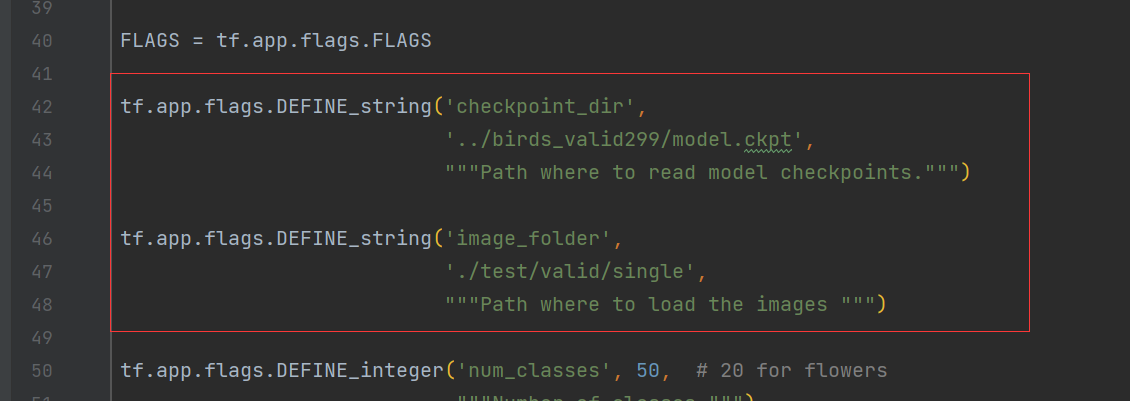

打开inception_score.py的代码,定位到41行到49行:

可以看到这里有两个文件地址,第一个地址是指明在哪里读取预训练好的inception model checkpoints,将其改为自己放的路径:

tf.app.flags.DEFINE_string('checkpoint_dir',

'../birds_valid299/model.ckpt',

"""Path where to read model checkpoints.""")

第二个路径是指从哪里读取采样的图片,同样将其改为自己放的路径:

tf.app.flags.DEFINE_string('image_folder',

'../test/valid/single',

"""Path where to load the images """)

第七步:开始定量评测

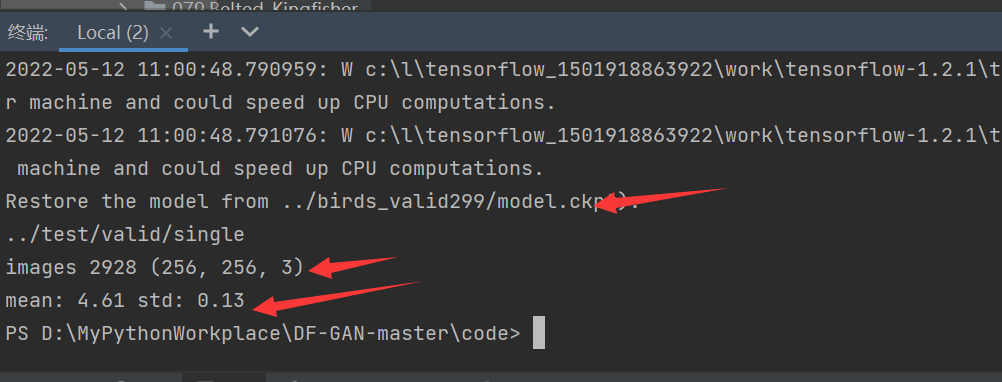

在终端输入:python inception_score.py --image_folder ../test/valid/single

显示如下:

就是大功告成啦,可以看到本次结果为 4.61,误差为±0.13!

最后

💖 个人简介:人工智能领域研究生,目前主攻文本生成图像(text to image)方向

📝 个人主页:中杯可乐多加冰

🔥 限时免费订阅:文本生成图像T2I专栏

🎉 支持我:点赞👍+收藏⭐️+留言📝

如果这篇文章帮助到你很多,希望能不吝打赏我一杯可乐!多加冰哦

2722

2722

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?