由于学术需要,这段时间再训练一个分类器,但其效果不太好,loss下降不明显。便考虑是不是学习率的问题,由于使用的是SGD,其中一个参数为decay,借鉴别人的参设默认值,decay 一般设为1x10-4 .我怀疑是训练过程种学习率太大,于是想找到SGD优化器种学习率衰减的公式,但能力有限,读代码没读懂,就在网上找,也没找到。

最后再Google上找到了,帖子的连接如下:

https://machinelearningmastery.com/understand-the-dynamics-of-learning-rate-on-deep-learning-neural-networks/

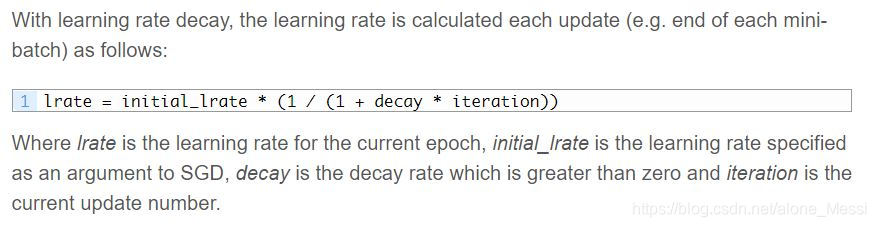

计算的公式如下:

initial_rate为初始优化器时的学习率,decay为衰减参数,iteration为迭代次数

但这个衰减的公式过于简单,再前期衰减的很快,后期几乎不衰减。

例如当decay = 0.1时

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4018

4018

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?