点击下方卡片,关注“CVer”公众号

AI/CV重磅干货,第一时间送达

添加微信号:CVer111,小助手会拉你进群!

扫描下方二维码,加入CVer学术星球!可以获得最新顶会/顶刊上的论文idea和CV从入门到精通资料,及最前沿应用!发论文/搞科研/涨薪,强烈推荐!

西风 发自 凹非寺

转载自:量子位(QbitAI)

ICML 2024时间检验奖出炉,贾扬清共同一作论文获奖!

论文题为“DeCAF: A Deep Convolutional Activation Feature for Generic Visual Recognition”,是贾扬清及其团队10年前在UC伯克利期间完成的工作。

ICML官方第一时间发推文表示祝贺,贾扬清回应道“深感荣幸DeCAF获ICML2024时间检验奖,这是人工智能发展惊人的十年”,并把其他作者艾特了个遍。

作者之一、现谷歌DeepMind副总裁、Gemini项目联合负责人Oriol Vinyals也开麦表示“非常感谢这个奖(让我感觉自己老了)”:

DeCAF是AlexNet的首个开源版本,我们通过它测试了这个卓越的ImageNet分类器学习到的特征是否能广泛应用于其他视觉任务。事实证明,这个想法在今天仍然与最好的多模态模型非常相关!

两位老搭档也在评论区叙上了旧:

ICML今年是其举办的第41届,投稿量9000+,接受率27.5%。除了时间检验奖,最佳论文奖也已出炉,Stable Diffusion 3论文等上榜。

获得时间检验奖的这篇论文,目前谷歌学术被引6012次:

先来看这篇论文都讲了什么。

著名框架Caffe的前身

这篇论文提出了一种名为DeCAF(Deep Convolutional Activation Feature)的深度卷积激活特征,用于解决通用视觉识别问题。

主要是探索了在ImageNet等大规模标记数据集上预训练的深度卷积神经网络,其中间层特征是否能够有效迁移到其他视觉任务中,即transfer learning的可行性。

作者采用了Geoffrey Hinton、Alex Krizhevsky、Ilya Sutskever 2012年提出的AlexNet卷积神经网络架构,包含5个卷积层和3个全连接层。在ImageNet数据集上进行预训练后,冻结网络权重。

提取了不同层的激活作为特征,具体包括DeCAF5、DeCAF6和DeCAF7(最后一个隐藏层的激活)。并在新任务上仅训练简单的线性分类器,同时保持DeCAF特征不变。

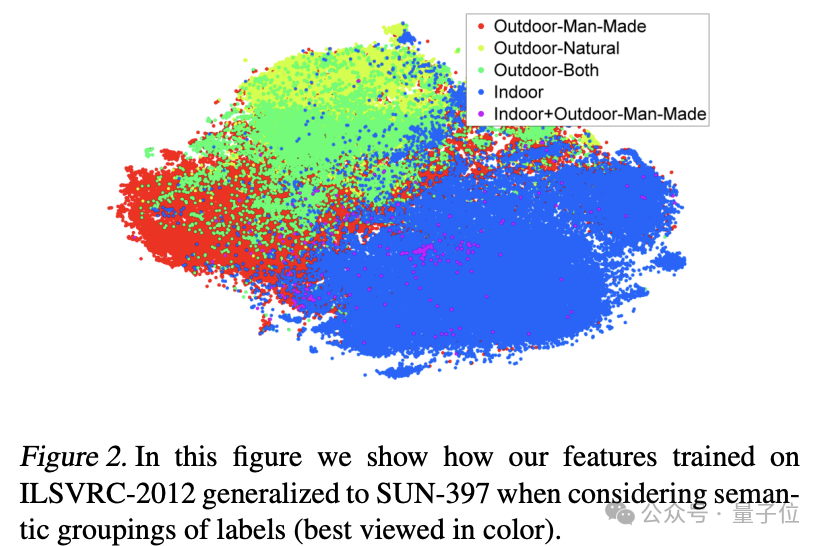

为了验证这种方法的有效性,作者在多个标准计算机视觉基准测试上进行了实验,包括对象识别(Caltech-101)、域适应(Office数据集)、细粒度识别(Caltech-UCSD鸟类数据集)和场景识别(SUN-397)。

实验结果显示,DeCAF在所有这些任务上都取得了优秀的表现,常常超越当时的最佳方法。

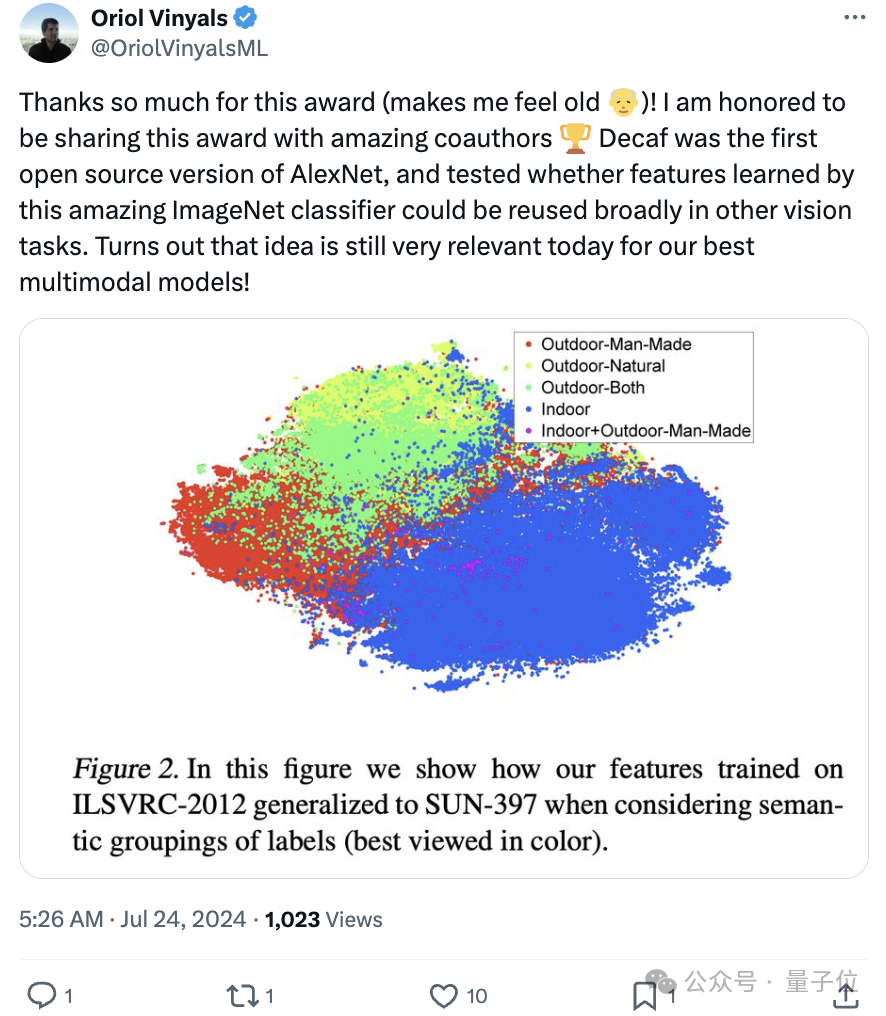

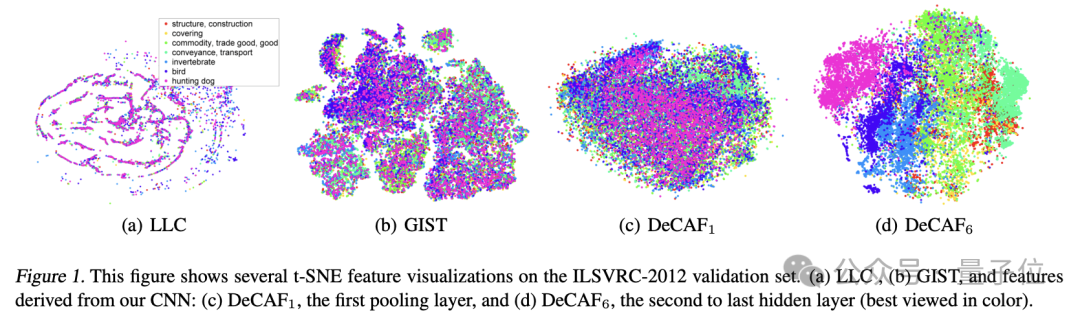

使用t-SNE算法将高维特征映射到2D空间,展示了DeCAF特征在语义聚类方面优于GIST和LLC等传统特征。

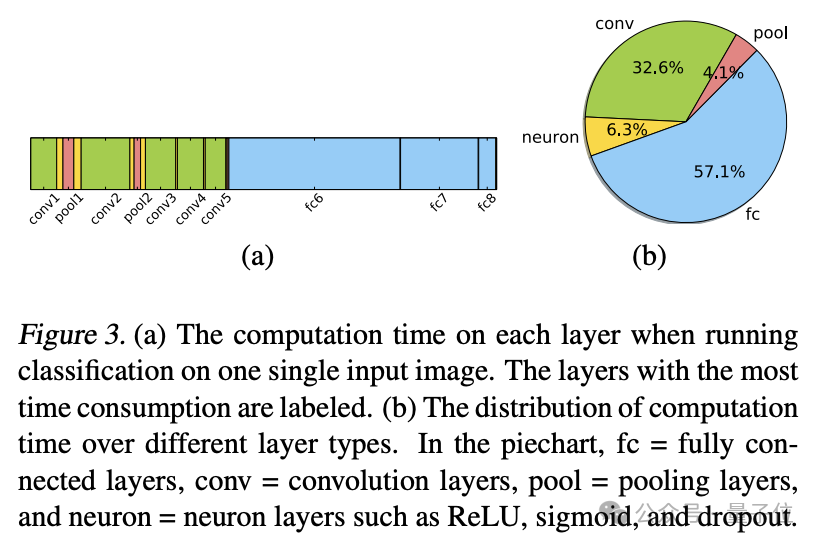

即使在训练样本稀缺的情况下,如单样本学习,DeCAF仍然表现出色。论文还详细分析了网络各层的计算时间分布,发现全连接层占用了大部分计算时间。

此外,论文还探讨了dropout等正则化技术的影响,特别是在DeCAF6和DeCAF7层上的应用。

最终作者开源了DeCAF特征提取工具和预训练模型。

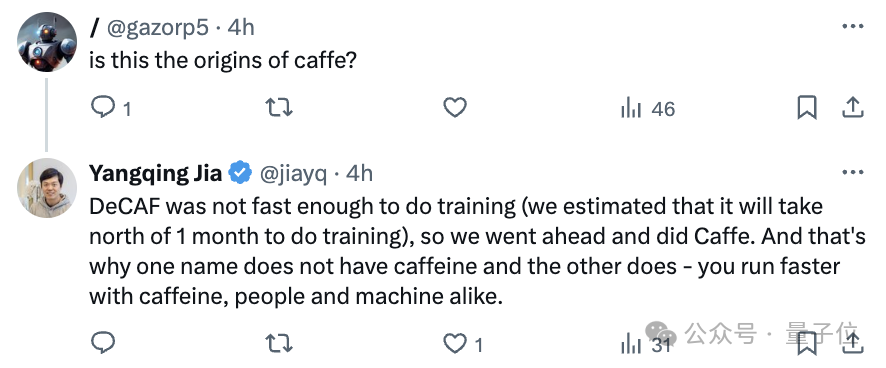

有网友看到这篇论文在十年后的今天获奖后,突然反应过来“这是不是Caffe的起源?”

贾扬清也做出了回复:

DeCAF的训练速度不够快(我们估计训练时间需要超过一个月),因此我们转而使用了Caffe。这就是为什么一个名字中含caffeine(咖啡因)成分为零而另一个有的原因——无论是人还是机器,含caffeine都运行得更快。

最佳论文奖

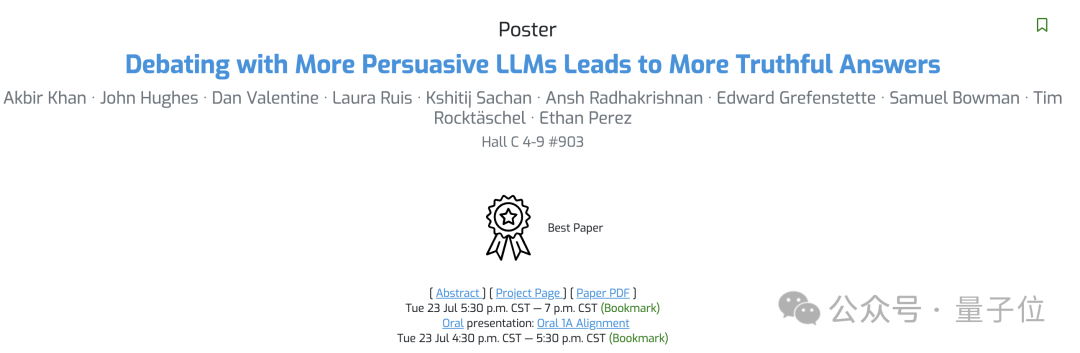

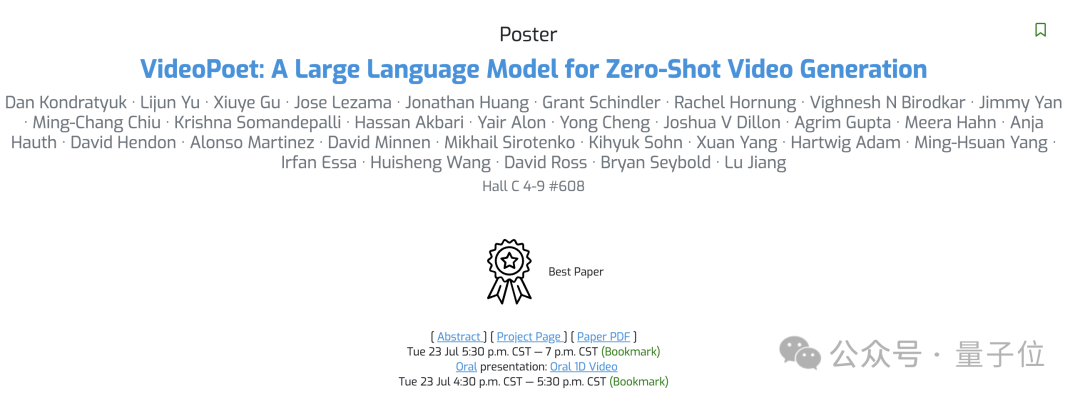

除时间检验奖,ICML 2024最佳论文奖也出炉了,今年获奖论文共有10篇。

其中包括Stable Diffusion 3论文“Scaling Rectified Flow Transformers for High-Resolution Image Synthesis”。

Pika联合创始人兼CTO Chenlin Meng参与的“Discrete Diffusion Modeling by Estimating the Ratios of the Data Distribution”这项工作也获奖了。

参考链接:

[1]https://icml.cc/virtual/2024/awards_detail

[2]https://arxiv.org/abs/1310.1531

[3]https://x.com/jiayq/status/1815653822028738667

[4]https://x.com/jiayq/status/1815862939569774796

何恺明在MIT授课的课件PPT下载

在CVer公众号后台回复:何恺明,即可下载本课程的所有566页课件PPT!赶紧学起来!

ECCV 2024 论文和代码下载

在CVer公众号后台回复:ECCV2024,即可下载ECCV 2024论文和代码开源的论文合集CVPR 2024 论文和代码下载

在CVer公众号后台回复:CVPR2024,即可下载CVPR 2024论文和代码开源的论文合集Mamba、多模态和扩散模型交流群成立

扫描下方二维码,或者添加微信号:CVer111,即可添加CVer小助手微信,便可申请加入CVer-Mamba、多模态学习或者扩散模型微信交流群。另外其他垂直方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch、TensorFlow和Transformer、NeRF、3DGS、Mamba等。

一定要备注:研究方向+地点+学校/公司+昵称(如Mamba、多模态学习或者扩散模型+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群▲扫码或加微信号: CVer111,进交流群

CVer计算机视觉(知识星球)来了!想要了解最新最快最好的CV/DL/AI论文速递、优质实战项目、AI行业前沿、从入门到精通学习教程等资料,欢迎扫描下方二维码,加入CVer计算机视觉(知识星球),已汇集上万人!

▲扫码加入星球学习▲点击上方卡片,关注CVer公众号

整理不易,请赞和在看

8

8

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?