点击下方卡片,关注“CVer”公众号

AI/CV重磅干货,第一时间送达

添加微信号:CVer2233,小助手会拉你进群!

扫描下方二维码,加入CVer学术星球!可以获得最新顶会/顶刊上的论文idea和CV从入门到精通资料,及最前沿应用!发论文/搞科研/涨薪,强烈推荐!

论文标题:SFPNet: Sparse Focal Point Network for Semantic Segmentation on General LiDAR Point Clouds

论文:https://arxiv.org/abs/2407.11569

数据集:https://www.semanticindustry.top

代码:github.com/Cavendish518/SFPNet

背景

激光雷达因其在包括低光照条件在内的多种环境下的精确距离检测能力而成为自动驾驶汽车和机器人的热门选择。激光雷达点云能够精准表征真实场景,通过语义分割实现对三维场景的直接理解,相比基于二维图像的分割,这些优势能够更有效地支持后续的定位、规划等任务。

摘要

现有激光雷达语义分割的SOTA方法通常包含专门为机械旋转激光雷达设计的归纳偏置。这限制了模型在其他类型激光雷达技术中的通用性,并使超参数调整变得更加复杂。为了解决这些问题,上海交通大学团队提出了一种通用的框架SFPNet,用稀疏焦点机制代替窗口注意力机制,以适应市场上流行的各种类型的激光雷达。SFPNet能够提取多层上下文信息,并使用门控机制动态聚合不同层次的信息。作者还提出了一种针对工业机器人应用场景的新型混合固态激光雷达语义分割数据集S.MID。SFPNet在nuScenes 和SemanticKITTI等机械旋转激光雷达数据集中展示了具有竞争力的性能,在固态激光雷达数据集PandaSet和混合固态激光雷达数据集S.MID上表现优于现有方法。

动机

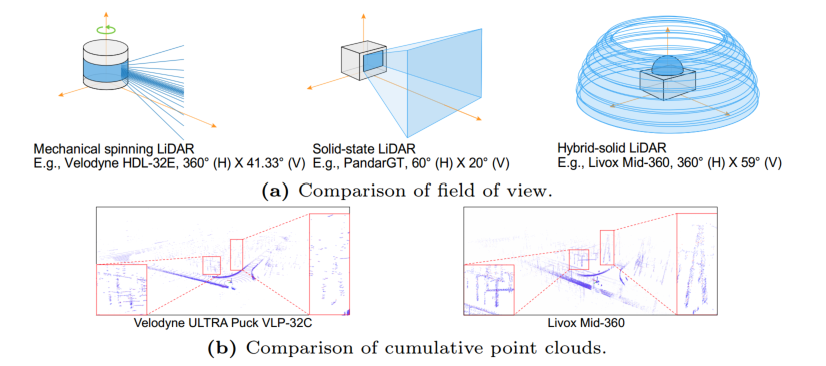

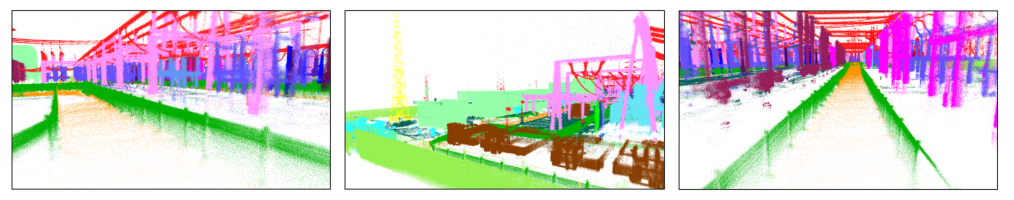

图1不同类型的激光雷达点云分布和FOV对比。

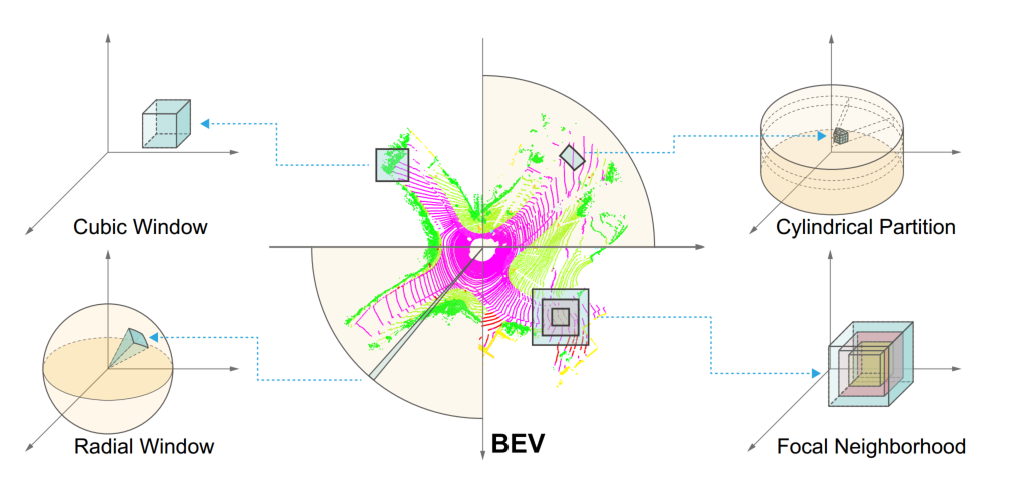

对于激光雷达分割任务的backbone网络,它需要解决的三个主要挑战是稀疏性、大规模性和点云密度的非均匀变化。先前的研究将归纳偏置(特殊分区或特殊窗口和位置编码)引入到单一类型的激光雷达(通常是机械旋转激光雷达)来解决上述三个挑战(图2)。这会限制模型对其他类型激光雷达的通用性,并使超参数调整更加复杂。在这种背景下作者提出了稀疏焦点机制来替换窗口注意机制。

图2窗口注意力机制(左上,左下),圆柱分区(右上)和稀疏焦点机制(右下)的直观对比。

方法

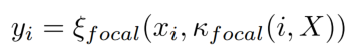

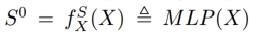

稀疏焦点模块可以替换窗口注意力机制,直接插入现有的网络中。稀疏焦点模块具有如下形式:

稀疏焦点模块具有两条性质1)包含上下文信息的显式局部性 2)平移不变性。

图3 稀疏焦点模块。

方法具体实现如下,给定一个激光雷达特征序列X。

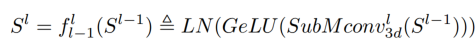

先进行多级上下文提取:

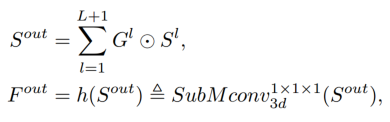

然后进行自适应特征聚合:

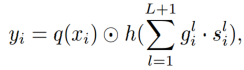

最后实现通道信息查询:

数据集

作者使用装备了Livox Mid-360的工业机器人在电站场景采集并标注了38904 帧数据。数据集场景如下:

图4 S.MID数据集中的累计点云图。

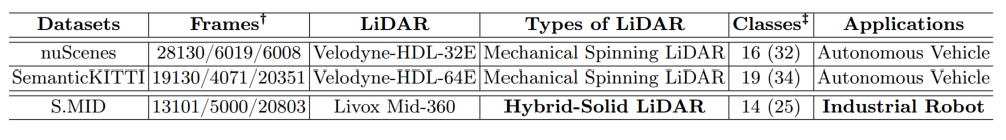

和传统benchmark,nuScenes 和SemanticKITTI的对比:

表1 数据集对比。

实验结果

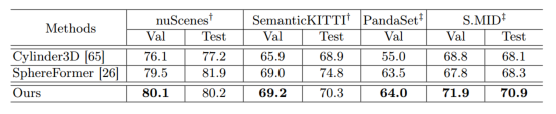

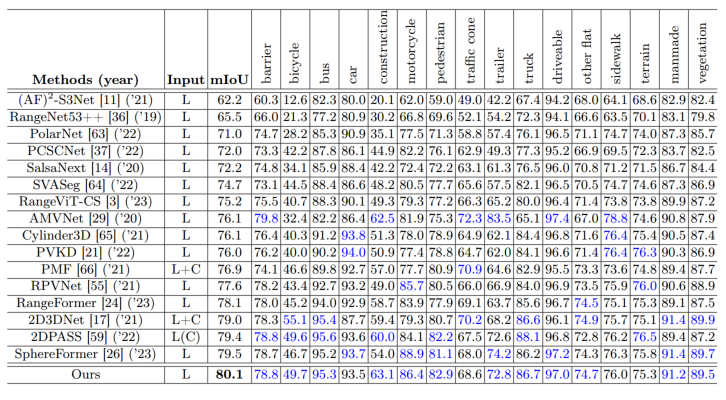

作者在不同类型的激光雷达数据集nuScenes ,SemanticKITTI, PandaSet和S.MID上进行了实验,SFPNet均取得了非常好的分割效果,表现出了很好的通用性和鲁棒性。

表2 和现有backbone类型的网络在不同类型激光雷达数据集上的效果对比。

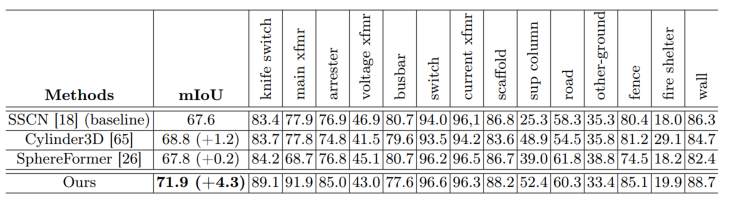

表3 nuScenes验证集。

特别地,针对混合固态激光雷达点云分布的随机性,SFPNet有较好的结果,而前人的方法和标准稀疏卷积网络相比效果没有明显提升,即前人设计的模块失效。印证了方法的通用性。

表4 S.MID验证集。

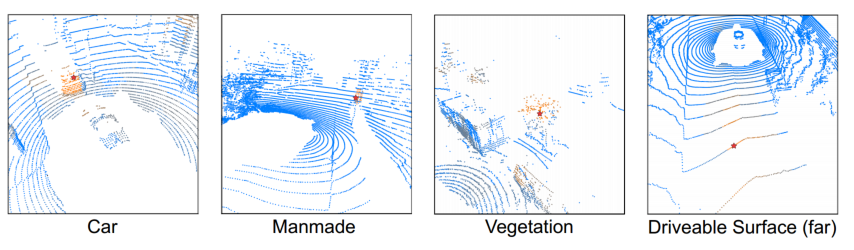

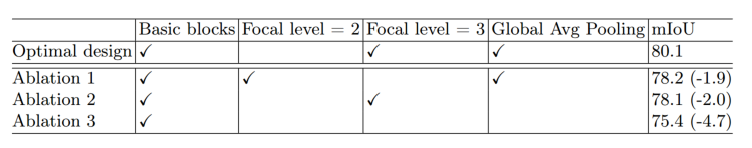

作者还给出了可解释性的可视化验证。消融实验验证了各个模块的必要性。

图5 可解释性分析。某一个点(红星)和周围特征( )的相关性。

)的相关性。

表5 消融实验。

总结

作者提出了一种新的通用的激光语义分割网络SFPNet。该方法可以替换现有主流网络中的窗口注意机制。SFPNet在各种类型激光雷达的数据集上表现出出色的性能,并具有良好的可解释性。作者还构建了一个全新的基于混合固态激光雷达的数据集S.MID。

何恺明在MIT授课的课件PPT下载

在CVer公众号后台回复:何恺明,即可下载本课程的所有566页课件PPT!赶紧学起来!

ECCV 2024 论文和代码下载

在CVer公众号后台回复:ECCV2024,即可下载ECCV 2024论文和代码开源的论文合集CVPR 2024 论文和代码下载

在CVer公众号后台回复:CVPR2024,即可下载CVPR 2024论文和代码开源的论文合集Mamba、多模态和扩散模型交流群成立

扫描下方二维码,或者添加微信号:CVer2233,即可添加CVer小助手微信,便可申请加入CVer-Mamba、多模态学习或者扩散模型微信交流群。另外其他垂直方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch、TensorFlow和Transformer、NeRF、3DGS、Mamba等。

一定要备注:研究方向+地点+学校/公司+昵称(如Mamba、多模态学习或者扩散模型+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群▲扫码或加微信号: CVer2233,进交流群

CVer计算机视觉(知识星球)来了!想要了解最新最快最好的CV/DL/AI论文速递、优质实战项目、AI行业前沿、从入门到精通学习教程等资料,欢迎扫描下方二维码,加入CVer计算机视觉(知识星球),已汇集上万人!

▲扫码加入星球学习▲点击上方卡片,关注CVer公众号

整理不易,请赞和在看

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?