1.1 CNN基本原理

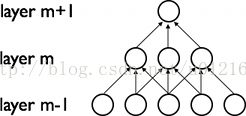

CNN的基本结构包括两层,其一为特征提取层,每个神经元的输入与前一层的局部接受域相连,并提取该局部的特征。一旦该局部特征被提取后,它与其它特征间的位置关系也随之确定下来;其二是特征映射层,网络的每个计算层由多个特征映射组成,每个特征映射是一个平面,平面上所有神经元的权值相等。特征映射结构采用影响函数核小的sigmoid函数作为卷积网络的激活函数,使得特征映射具有位移不变性。此外,由于一个映射面上的神经元共享权值,因而减少了网络自由参数的个数。卷积神经网络中的每一个卷积层都紧跟着一个用来求局部平均与二次提取的计算层,这种特有的两次特征提取结构减小了特征分辨率。

CNN主要用来识别位移、缩放及其他形式扭曲不变性的二维图形。由于CNN的特征检测层通过训练数据进行学习,所以在使用CNN时,避免了显示的特征抽取,而隐式地从训练数据中进行学习;再者由于同一特征映射面上的神经元权值相同,所以网络可以并行学习,这也是卷积网络相对于神经元彼此相连网络的一大优势。卷积神经网络以其局部权值共享的特殊结构在语音识别和图像处理方面有着独特的优越性,其布局更接近于实际的生物神经网络,权值共享降低了网络的复杂性,特别是多维输入向量的图像可以直接输入网络这一特点避免了特征提取和分类过程中数据重建的复杂度。

卷积神经网络是我认为非常好用的一类神经网络结构,当数据具有局部相关性时是一种比较好选择,在图像、自然语言处理、棋类竞技、新药配方研制等方面有广泛应用。

CNN的最大特点就是稀疏连接(局部感受)和权值共享.左为稀疏连接,右为权值共享。稀疏连接和权值共享可以减少所要训练的参数,减少计算复杂度。

比如,经典的LeNet-5网络结构:

1.1.1 Sigmoid激活函数(下图左)

:

优点:能够把输入的连续实值压缩到0到1之间;

缺点:

(1)梯度消失问题(Vanishing Gradient Problem),当输入非常大或非常小的时候,神经元的梯度就接近0了,这使得在反向传播算法中反向传播接近于0的梯度,导致最终权重基本没什么更新;

(2)激活输出非0均值问题 :Sigmoid的输出不是0均值的,这会导致后层的神经元的输入是非0均值的信号,这会对梯度产生影响,假设后层神经元的输入都为正(e.g. x>0elementwise in f=wTx+b),那么对w求局部梯度则都为正,这样在反向传播的过程中w要么都往正方向更新,要么都往负方向更新,导致有一种捆绑的效果,使得收敛缓慢。

解决方法:注意参数的初始值设置来避免饱和情况。

Tanh函数是另外一种Sigmoid函数,它的输出是0均值的(下图右):

优点:0均值,能够压缩数据到-1到1之间;

缺点:同Sigmoid缺点第二个,梯度饱和;

但这个函数依然解决不了梯度消失问题,后续介绍其他网络结构时会看到在激活函数层面上的演化。

CNN的典型特点是:局部相关性(稀疏连接)、权重与偏置共享及采样,一套典型的结构由输入层、卷积层、采样层、全连接层、输出层组成。

本文详细介绍了卷积神经网络(CNN)的基本原理,包括Sigmoid激活函数、输入层、卷积层、Zero-Padding、采样层(Pooling)和全连接层。此外,还深入探讨了LeNet-5的经典结构,解析了其各层的功能与参数计算,揭示了CNN在图像识别中的应用和优势。

本文详细介绍了卷积神经网络(CNN)的基本原理,包括Sigmoid激活函数、输入层、卷积层、Zero-Padding、采样层(Pooling)和全连接层。此外,还深入探讨了LeNet-5的经典结构,解析了其各层的功能与参数计算,揭示了CNN在图像识别中的应用和优势。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1908

1908

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?