摘要

文档级关系提取旨在识别整个文档中实体之间的关系。先前捕获远程依赖关系的努力严重依赖于通过(图)神经网络学习的隐式强大表示,这使得模型不太透明。为了解决这一挑战,本文提出了LogiRE,这是一种通过学习逻辑规则来提取文档级关系的新型概率模型。LogiRE将逻辑规则视为潜在变量,由两个模块组成:规则生成器和关系提取器。规则生成器生成可能有助于最终预测的逻辑规则,关系提取器根据生成的逻辑规则输出最终预测。利用期望最大化(EM)算法可以对这两个模块进行有效的优化。通过将逻辑规则引入神经网络,LogiRE可以显式地捕获远程依赖关系,并获得更好的解释。实证结果表明,LogiRE在关系性能(~ 1.8 F1分数)和逻辑一致性(超过3.3逻辑分数)方面显著优于几个强基线。我们的代码可在https://github上获得。com/rudongyu/LogiRE。

介绍

图1:利用规则进行关系标识的示例。这三个带标签的句子分别描述了royalty_of(Harry,UK)、sibling_of(William,Harry)和spouse (Kate,William)的关系。关系royalty_of(Kate,UK)的识别需要在三句话中综合信息。它可以很容易地从证明的规则和其他三个关系中推导出来。

从文档中提取关系是信息抽取(information extraction, IE)中的一个重要研究方向。最近,人们不再关注句子层面(Socher et al., 2012;dos Santos等人,2015;Han et al., 2018;Zhang et al., 2018;Wang et al., 2021a,b),研究人员已经转向直接在文档层面建模(Wang et al., 2019;Ye et al., 2020;Zhou et al., 2021),它提供了更长的上下文,需要更复杂的推理。早期的工作主要集中在学习一个强大的关系(即实体对)表示,它隐式地捕获远程依赖关系。根据输入结构,我们可以把现有文档级关系提取工作分为两类:基于序列的模型和基于图的模型。

基于序列的模型首先利用不同的序列编码器(例如BERT (Devlin等人,2019),RoBERTa (Liu等人,2019))获得token表示,然后通过各种池化操作计算关系表示,例如平均池化(Yao等人,2019);Xu et al., 2021),细心池化(Zhou et al., 2021)。为了进一步捕获远程依赖关系,提出了基于图的模型。通过构造图,距离较远的词或实体可以成为相邻节点。在序列编码器之上,图形编码器(例如,GNN)可以聚合来自所有邻居的信息,从而捕获更长的依赖关系。提出了各种形式的图,包括依赖树(Peng et al., 2017;Zhang 1240等人,2018),共同参考图(Sahu等人,2019),提及实体图(Christopoulou等人,2019;Zeng et al., 2020),实体-关系二部图(Sun et al., 2019)等。尽管它们取得了巨大的成功,但人们对内部表征仍然没有全面的了解,它们经常被批评为神秘的“黑盒子”。

学习逻辑规则可以发现和表示知识在明确的符号结构,可以被人理解和检查。同时,逻辑规则提供了另一种显式捕获文档中实体和输出关系之间交互的方法。例如,在图1中,royalty_of(Kate,UK)的识别需要所有三个句子中的信息。所证明的逻辑规则可以直接从每个句子中局部提取的三个关系中获得这个关系。对规则的推理绕过了捕获长期依赖关系的困难,并用内在相关性解释结果。如果模型能够自动学习规则并利用它们进行预测,那么我们将获得更好的关系提取性能和更多的解释。

在本文中,我们提出了一种新的概率模型LogiRE,它通过逻辑规则来描述关系之间的内在相互作用。受RNNLogic (Qu et al., 2021)的启发,我们将逻辑规则视为潜在变量。具体地说,LogiRE由一个规则生成器和一个关系提取器组成,它们同时经过训练以相互增强。规则生成器提供逻辑规则供关系提取器用于预测,关系提取器提供一些监督信号来指导规则生成器的优化,从而大大减少了搜索空间。此外,所提出的关系提取器是模型不可知的,因此它可以用作任何现有关系提取器的即插即用技术。EM算法可以有效地优化这两个模块。通过在神经网络中引入逻辑规则,LogiRE可以显式地捕获文档中实体之间的远程依赖关系和输出关系,从而实现更好的交互。我们的主要贡献如下:

- 提出了一种基于逻辑规则学习的关系抽取概率模型。该模型可以显式地捕获实体和输出关系之间的依赖关系,同时获得更好的解释。

- 在EM算法的基础上,提出了一种基于迭代的LogiRE优化方法。

- 实证结果表明,LogiRE在关系性能(~ 1.8 F1分数)和逻辑一致性(超过3.3逻辑分数)方面显著优于几个强基线。

相关工作

图2:LogiRE的概述。LogiRE由两个模块组成:规则生成器𝑝和关系提取器𝑝𝑤。对于给定的文档D和查询三元组𝑞,我们将所需的逻辑规则视为潜在变量𝒛,旨在识别相应的真值。在推理过程中,我们从规则生成器中抽取潜在规则集的样本,并使用关系提取器对给定规则进行预测。总体目标(最大似然)通过EM算法进行优化。在e步中,我们估计近似后验𝑞(𝒛);在m步中,我们最大化可能性的下界。

对于文档级关系提取,先前捕获远程依赖关系的努力主要集中在两个方向:追求更强的序列表示(Nguyen and Verspoor, 2018;Verga et al., 2018;Zheng等人,2018)或将实体之间交互的先验作为图(Christopoulou等人,2019)。为了获得更强大的表示,他们引入了预训练的语言模型(Wang et al., 2019;Ye et al., 2020),利用注意力进行上下文池化(Zhou et al., 2021),或者将分散的信息按层次进行整合(Tang et al., 2020)。为了模拟实体和关系之间的内在相互作用,他们通过精心设计图来使用隐式推理结构,将提及到实体、同一句子中的提及连接起来(Christopoulou et al., 2019;Sun等人,2019),提到了相同的实体(Wang等人,2020;Zeng et al., 2020)等。Nan et al. (2020);Xu等人(2021)直接将类似的结构依赖关系集成到编码器中的注意机制中。这些方法有助于获得区分各种关系的强大表征,但在隐含推理上缺乏可解释性。另一种可以捕获关系之间依赖关系的方法是全局规范化模型(Andor等人,2016;Sun等人,2018)。在这项工作中,我们关注如何学习和使用逻辑规则来捕获关系之间的长期依赖关系。

另一类相关工作是逻辑推理。许多关于学习或应用逻辑规则进行推理的研究。其中大部分(瞿和唐,2019;Zhang et al., 2020)专注于知识图的推理,旨在从现有三元组中推断出新的知识。神经符号系统(Hu et al., 2016;Wang和Poon, 2018)结合逻辑规则和神经网络,从深度学习方法的正则化中受益。这些努力证明了将神经网络与逻辑推理相结合的有效性。尽管doc-RE为逻辑推理提供了一个合适的场景(关系作为谓词,实体作为变量),但没有现有的工作试图学习和利用这一领域的规则。使用手工规则,Wang and Pan (2020);Wu等人(2020)在发送级信息提取任务上取得了巨大成功。然而,这些规则是预定义的,并且仅限于低级操作,从而限制了它们的应用。

方法

在本节中,我们将描述所提出的方法学习用于文档级关系提取的逻辑规则的LogiRE。我们首先定义了文档级关系抽取和逻辑规则的任务。

文档级关系提取给定一组实体E,它们的提及分散在文档D中,我们的目标是提取一组关系R。一个关系是一个三元组(h,𝑟,𝑡)∈R(也用𝑟(h,𝑡)表示),其中,h∈E是头部实体,𝑡∈E是尾部实体,𝑟是描述两个实体之间语义关系的关系类型。设T𝑟为可能的关系类型(包括反向关系类型)的集合。为简单起见,我们定义了一个查询𝑞=(ℎ,𝑟,𝑡)和目标模型的概率分布𝑝(𝒚|𝑞,D),在𝒚∈{−1,1}是一个二进制变量指示(ℎ,𝑟,𝑡)是否有效与否,和ℎ,𝑡∈E,𝑟∈T𝑟。在本文中,粗体字母表示变量。

我们通过学习逻辑规则从文档中提取关系,其中本工作中的逻辑规则具有连接形式:

其中𝑒i∈E,𝑟i∈T𝑟,𝑙为规则长度。这种形式可以表达广泛的常见逻辑关系,如对称性和可转移性。例如,可转移性可以表示为

受RNNLogic (Qu et al., 2021)的启发,为了在大的搜索空间中推断出高质量的逻辑规则,我们将规则学习和权重学习分开,将逻辑规则作为潜变量。LogiRE由两个主要模块组成:规则生成器和关系提取器,这两个模块同时进行训练以相互增强。对于文档D中的查询𝑞= (h,𝑟,𝑡),一方面,规则生成器采用自回归模型生成一组基于𝑞的逻辑规则,用于帮助关系提取器做出最终决策;另一方面,关系提取器可以提供一些监督信号,通过后验推理来更新规则生成器,从而大大减少了高质量规则的搜索空间。

与现有的通过学习强大的表示来捕获文档中关系之间交互的方法不同,我们引入了一种新的概率模型LogiRE(第3.1节,图2),它通过学习逻辑规则显式地增强了交互。LogiRE使用神经网络来参数化规则生成器和关系提取器(第3.2节),并通过EM算法以迭代的方式进行优化(第3.3节)。

概述

E以概率方式制定文档级关系提取,其中一组逻辑规则被指定为潜在变量𝒛。给定文档D中的查询变量𝒒=(h,t,r),我们将目标分布𝑝(𝒚|𝒒,D)定义如下1:

其中𝑝是规则生成器的分布,它定义了以查询𝒒为条件的潜在变量𝒛之上的先验(我们假设𝒛的分布独立于文档D),𝑝𝑤是关系提取器,它给出了以查询𝒒、潜在𝒛和文档D为条件的𝒚的概率。给定查询的金标调换在D文件𝑞中,目标函数是使似然最大化如下:

由于目标函数L中存在潜在变量,我们使用EM算法进行优化(第3.3节)。

参数化

规则生成器

规则生成器定义分布𝑝(𝒛|𝒒)。对于查询𝑞,规则生成器生成一组用𝒛表示的逻辑规则,用于预测查询𝑞的真值𝒚。

通常,给定查询𝑞= (h,𝑟,𝑡),我们生成的逻辑规则采用𝑟←𝑟1∧···∧𝑟𝑙的形式。这样的关系序列[𝑟1,…][𝑟𝑙]可以通过自回归模型有效地建模。在这项工作中,我们使用基于transformer的自回归模型AutoReg来参数化规则生成器,该规则生成器依次生成每个关系𝑟i。在此过程中,同时计算生成规则的概率。接下来,我们假设规则集𝒛服从一个多项分布,并且从分布AutoReg (rule|𝑞)中独立采样的二进制规则:

Multi表示多项分布,N表示集合𝒛的大小的超形参,AutoReg系统定义了基于查询𝑞的逻辑规则的分布。

关系提取器

关系提取器定义𝑝𝑤(𝒚|𝒒,𝒛)。它利用一组逻辑规则来获取查询𝒒对应的𝒚的真值。对于每个查询𝑞,规则∈𝒛能够在文档D中找到不同的接地路径。例如

是规则母亲(𝑒0,𝑒2)←父亲(𝑒0,𝑒1)∧配偶(𝑒1,𝑒2)的接地路径。根据积t范数模糊逻辑(Cignoli et al., 2000),我们对每条规则进行如下评分:

式中,P(规则)是一组接地路径,这些接地路径遵循一条规则,起点为h,终点为𝑡。

其中,𝑤(𝑒i-1,𝑟i,𝑒i)为现有关系模型得到的置信分数。

为了得到𝒚的概率(模糊真值),我们综合了潜规则集𝒛中各规则的评价结果。任何规则主体的满足都意味着𝒚的真实性。因此,我们将𝒛中所有规则的析取作为目标真值。遵循基于s型的模糊逻辑函数的析取(Sourek et al., 2018;Wang and Pan, 2020)的原则,我们将模糊真值定义为:

其中,和

是可学习的标量权重,

是一个用来平衡正负事件分数的偏置项;

评估这个分数,即特定规则的质量。

通过规则主体定义的元路径计算从头部实体h到尾部实体𝑡的可访问性。对规则应用逻辑规则和推理使关系提取器能够显式地将远程依赖关系建模为实体和关系之间的交互。

优化

为了优化似然估计L(𝑤,)(Eq. 1),我们以迭代的方式交替更新规则生成器和关系提取器,即EM算法。经典的EM算法估计e步中当前参数估计隐变量的后验Z。在m步中更新参数,𝒛服从估计的后验。然而,在我们的设置中,由于Z的空间空间很大,很难计算精确的后验𝑝(𝒛|𝒚,𝒒)。为了解决这一挑战,我们寻求二阶泰勒展开式作为近似后验𝑞(𝒛)。这个修改后验的版本在log𝑝𝑤,

(𝒚|𝒒)上形成了一个下界,因为它们之间的差是KL散度,因此是正的:

一旦我们得到𝑞(𝒛),我们就可以最大化log𝑝𝑤(𝒚|𝒒)的下界。

E-step

给定当前参数为,𝑤,E-step的目的是根据当前参数,计算𝒛的后验。然而,精确后验𝑝𝑤,

(𝒛|𝒒,𝒚)由于其难以处理的配分函数(𝒛的空间较大)而是非平凡的。在这项工作中,我们的目标是寻求近似后验𝑞(𝒛)。

通过二阶泰勒展开式近似似然,我们可以得到多项式分布的后验的共轭形式。详细的推导列在附录中。形式上,我们首先定义𝐻(rule)为估计每条规则质量的分数函数:

直观地,𝐻(rule)从两个方面评估规则质量。一个是基于规则生成器𝑝,它作为每条规则的先验概率。另一种是基于关系提取器,它考虑了当前规则对最终正确答案

的贡献。接下来,我们使用

(rule|𝑞)表示给定查询的规则的后验分布𝑞:

因此近似后验也服从多项分布.

M-step

| Algorithm 1 EM Optimization for L (𝑤, 𝜃) |

| 1: while 不收敛 do 2:对于每个实例,使用规则生成器 3: 计算每条规则的规则得分𝐻(rule)来近似规则的后验值: ⊲ E-step 4: 对于每个实例,更新规则生成器AutoReg基于采样规则的 5:对于每个实例,基于从更新的规则生成器生成的逻辑规则 ⊲ M-step 6: end while |

在得到𝑞(𝒛)后,m步是对𝑤和的下界log𝑝𝑤、p

(𝒚|𝒒)求最大值。正式地说,给定每个数据实例(

,𝑞,D)和𝑞(𝒛),目标是最大化

其中LG和LR分别是规则生成器和关系提取器的目标。对于目标L𝐺,可以进一步等价地转换为

为了计算LG的期望项,我们从当前的先验(𝒛|𝑞)中对样本进行采样,并将各规则的得分评价为𝐻(rule),将超过𝐻(规则)的归一化得分视为近似的

(rule|𝑞)。然后我们使用采样规则来更AutoReg的规则(rule|𝑞)。直观地说,我们更新了规则生成器

(𝒛|𝑞),使其与近似后验识别的高质量规则保持一致。

对于目标L𝑅,我们根据从更新的规则生成器中采样的逻辑规则更新关系提取器。可以将显式捕获关系之间更多交互的逻辑规则融合为关系提取器的输入,从而产生更好的经验结果并具有更好的解释。最后,总结了算法1中的优化过程。

实验

我们在多关系文档级关系提取数据集上进行了实验:DocRED (Yao等人,2019)和DWIE (Zaporojets等人,2020)。两个数据集的统计结果如表1所示。DWIE的预处理细节见附录B。

评价

除了用于关系提取的常用F1指标外,我们还包括用于模型综合评估的其他两个指标:ign F1,logic。(Yao et al., 2019)中提出了ign F1,用于排除训练集中出现的三元组进行评估。避免了训练集的信息泄露。我们提出了评估预测结果之间逻辑一致性的逻辑。具体来说,我们使用DWIE数据集上的41个预定义规则来评估预测是否满足这些黄金规则。这些规则的形式与第3节中定义的逻辑规则类似。我们将这些预测规则的精确度称为逻辑分数。请注意,这些规则独立于第3节中的规则学习和使用,但仅用于逻辑评估。

实验设置

在我们的实验设置中,规则生成器被实现为具有两层编码器和两层解码器的解码器,隐藏大小设置为256。根据经验,我们发现微小的结构足以建模所需的规则集。我们将潜在规则集的大小设置为50。在我们的设置中,我们将逻辑规则的最大长度限制为3。

Baselines

我们将LogiRE与以下文档级RE的基线进行比较。基线也用作框架中相应的骨干模型。Yao等人(2019)提出将四种最先进的句子级RE模型应用于文档级关系提取:CNN、LSTM、BiLSTM和上下文感知。(Zeng et al., 2020)提出GAIN,利用图神经网络,利用提及级图和聚合实体级图来模拟文档级RE中的推理过程。Zhou等人(2021)提出了ATLOP,使用自适应阈值学习更好的可调阈值,并通过局部上下文池增强实体对的表示。基线的实施细节见附录B。

主要结果

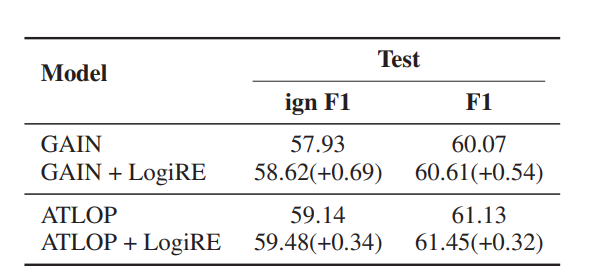

我们的LogiRE在所有三个指标上都优于基线。(我们主要对结果进行分析具有这三个指标的DWIE可以被评估。表3展示了DocRED的结果,并在第4.3节中进行了讨论。)

我们的LogiRE始终优于各种骨干模型。它优于DWIE数据集上的各种基线,如表2所示。我们在当前SOTA, ATLOP的基础上实现了2.02测试F1和1.84测试F1的改进。LogiRE与各种骨干模型之间的兼容性显示了我们的LogiRE的泛化能力。基于序列和基于图的模型的一致改进经验验证了显式地向文档级关系提取注入逻辑规则的好处。

基于图的模型的改进表明了对多个关系和实体之间的交互建模的有效性。尽管基于图形的模型提供了图形(Christopoulou等人,2019;Wang et al., 2020),由提及、实体和句子之间的连接组成,他们寻求更强大的表征,隐含地对内在连接进行建模。相反,我们的LogiRE通过由规则确定的元路径在实体和关系之间构建显式交互。通过对现有基于图的SOTA模型的改进,经验证明了其优越性。

DWIE的主要结果。(下划线统计量通过t检验,𝑝值< 0.01。)

表3:DocRED对比。改进不太显著,原因在第4.3节中分析。

DocRED中实体对间距离的分布

与基线相比,我们的模型实现了更好的逻辑一致性。结果表明,LogiRE在逻辑度量上实现了高达18.78的增强。即使在基于图的模型GAIN上,我们在逻辑一致性上也获得了5.03的显著改进。改进后的逻辑评分表明,LogiRE的预测与数据中的规则逻辑模式更加一致。这些数字证明了我们通过将逻辑规则作为潜在变量引入的基于迭代的优化方法的强度。

分析讨论

我们分析了DocRED数据的结果,并讨论了我们的LogiRE在捕获远程依赖关系和可解释性方面的优势。通过考察不同距离实体对的推理性能,研究了远程依赖关系的捕获能力。通过检查我们的规则生成器学习的逻辑规则和对预测的案例研究来验证可解释性。

DocRED结果分析

与DWIE的显著改进相比,LogiRE在DocRED上的增强不那么显著。我们的分析表明,原因是DocRED中相对较短的依赖关系和不完整的注释导致的逻辑不一致

a docreds中更短的依赖项

DocRED中较短的依赖关系降低了捕获实体和关系之间的长期相关性的需求。我们在图3中显示了实体对之间的距离分布。DocRED中79.26%的实体对的距离小于100个令牌。DocRED中的示例在捕获远程依赖关系方面不那么困难。更多的分析和比较可以在Zaporojets等人(2020)中找到。在这种情况下,基于表示的方法已经可以很好地执行。通过逻辑推理对远程依赖关系建模的好处将会更小。

b DocRED中的逻辑不一致

由于缺少注释,推理后的预测证明可能不准确。我们计算了一些易于验证的逻辑规则的错误率,如表4所示。通过案例分析选择的7条规则中,有相当一部分(12.96%)的标注关系可能作为原子参与。然而,表中的统计数据表明,这7条规则的错误率都大于10%。这些数字表明,真正关系的一个显著划分是缺失的。通过逻辑规则推理得到的结果可能被错误地证明,因为数据没有详尽地注释。

根据上面的分析,我们的LogiRE具有比DocRED上的整体性能更大的潜力。

表4:DocRED中的逻辑不一致(为简洁起见,P150表示关系“包含行政区域实体”,P131表示关系“位于行政区域实体”)。所示的易于验证的金规则在DocRED中具有较高的错误率,而所示规则中相当一部分关系(12.96%)以原子形式参与。这些缺失的注释使得逻辑规则的学习变得困难。训练和测试之间不一致的模式或统计可能导致对关系提取性能的不公平评价。

图4:对于不同距离的实体对,ATLOP和logic -ATLOP之间的性能差距。

表5:从DWIE数据集上训练的LogiRE中提取的示例规则。

逻辑规则是理解的捷径

当实体对之间的距离变长时,我们的LogiRE的性能增强变得更加突出。我们用四组实体对距离在dwidata dataset上绘制了atlop和基于atlop的LogiRE的性能图。4. 距离是根据最近提到实体之间的标记数来计算的。结果表明,我们的LogiRE在捕获长依赖项方面表现得更好。

对于距离较长的实体对,关系提取的性能通常较差。如图所示,当距离超过100个令牌时,性能开始下降,这表明建模远程依赖关系很困难。长上下文中的冗余信息阻碍了通过强大的表示进行准确的语义映射。这个问题增加了建模的复杂性,限制了基于表示的方法的潜力。

我们的框架注入了潜在的逻辑规则,可以有效地缓解这一问题。当实体之间的距离变大时,我们的LogiRE的性能下降较小。对于距离大于400的实体对,我们的LogiRE在测试标志F1上实现了4.47的增强。通过对局部逻辑单元(规则中的原子)进行推理,我们忽略了文本中嘈杂的背景信息,而是直接整合概念之间的高层联系来获得答案

我们的LogiRE的推理过程符合我们人类在阅读长文本时的理解方式。我们为文本的每个局部部分构建基本概念和(局部逻辑原子)之间的联系。当收集到的信息足够适合某些先验知识(逻辑规则)时,我们从现有知识中推断出新的认知。我们的LogiRE通过向朴素语义映射添加逻辑推理,为长文本语义建模提供了快捷方式。

生成规则的可解释性

使用生成的潜在规则集,我们的LogiRE具有更好的可解释性。EM优化之后,我们可以从规则生成器中抽取可能有助于最终预测的高质量规则。除了前面显示的用于评估逻辑的黄金规则外,LogiRE还从数据中挖掘出更多的逻辑规则,如表5所示。这些逻辑规则显式地揭示了作为常规模式的同一文档中实体和关系之间的交互。LogiRE更加透明,通过规则生成器显示潜在的规则。

图5:使用ATLOP作为主干模型的LogiRE在DWIE上的推理案例。灰色箭头是骨干模型提取的关系,实线表示真关系,虚线表示假关系。绿色箭头是通过逻辑推理正确提取的新关系。蓝色箭头表示潜在的推理路径。我们还展示了一个否定的例子。在第三个示例中,红色箭头表示通过对错误估计的原子进行推理而提取的错误关系。

案例研究

图5显示了我们的LogiRE的一些推理案例,包括两个正例和一个负例。如前两个示例所示,LogiRE可以利用逻辑规则来完成主干模型输出中缺失的关系。软逻辑推理可以在特定情况下弥补基于表示的方法的缺陷。然而,额外的推理也可能通过对错误估计的逻辑单元进行推理而加剧错误。第三个例子展示了这种情况。错误估计的原子in0(Vega,德国)导致通过推理提取的另一个错误关系。幸运的是,由于逻辑推理部分的透明性,我们的LogiRE中的这种错误将更加可控。

结论

在本文中,我们提出了一个概率模型LogiRE,该模型利用规则并对规则进行推理,用于文档级关系提取。逻辑规则被视为潜在变量。我们利用EM算法来有效地最大化整体可能性。通过向关系提取框架注入规则,我们的LogiRE将docRE中的远程依赖显式地建模为关系和实体之间的交互,从而具有更好的可解释性。经验结果和分析表明,LogiRE在总体性能、逻辑一致性和捕获远程依赖关系的能力方面优于强大的基线。

感谢

上海交通大学团队获得上海市科技重大专项(2021SHZDZX0102)和国家自然科学基金(61772333)资助。我们感谢张鑫波、徐晶晶、宋宇轩、史文娴和其他匿名评论者的深刻而详细的评论。

6133

6133

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?