前言

快速实现一个简单的深度学习模型。

一、安装昇思MindSpore库

本文都是基于Jupyter Notebook来执行。

# 捕获该单元格的输出,并将它存储在变量captured_output中,输出就不会直接显示在Jupyter Notebook的界面中。

%%capture captured_output

# 卸载mindspore

!pip uninstall mindspore -y

# 安装清华大学镜像源的mindspore,版本为2.2.14

!pip install -i https://pypi.mirrors.ustc.edu.cn/simple mindspore==2.2.14

二、处理数据集

MindSpore提供基于ipeline的数据引擎,通过数据集(Dataset)和数据变换(Transforms)实现高效的数据预处理。

在本教程中,我们使用Mnist数据集,自动下载完成后,使用mindspore.dataset提供的数据变换进行预处理。

本章节中的示例代码依赖download,可使用命令pip install download安装。

如本文档以Notebook运行时,完成安装后需要重启kernel才能执行后续代码。

import mindspore

from mindspore import nn

from mindspore.dataset import vision, transforms

from mindspore.dataset import MnistDataset

# 从开放的数据集下载数据

from download import download

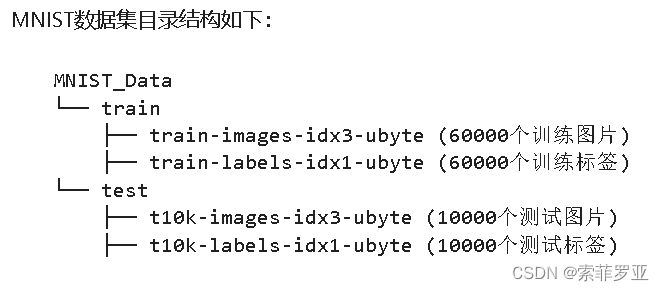

# (图1)

url = "https://mindspore-website.obs.cn-north-4.myhuaweicloud.com/" \

"notebook/datasets/MNIST_Data.zip"

path = download(url, "./", kind="zip", replace=True)

# 数据下载完成后,获得数据集对象。

train_dataset = MnistDataset('MNIST_Data/train')

test_dataset = MnistDataset('MNIST_Data/test')

# 打印数据集中包含的数据列名,用于dataset的预处理。

print(train_dataset.get_col_names())

# 接收参数为:数据集 dataset 和一个批量大小batch_size

def datapipe(dataset, batch_size):

# 转换将应用于数据集中的图像,包含三个转换的列表

image_transforms = [

# 将图像的像素值从[0, 255]缩放到 [0, 1]。它将每个像素值除以255来实现这一点

vision.Rescale(1.0 / 255.0, 0),

# 转换对图像进行标准化,使用给定的均值和标准差来转换像素值。

vision.Normalize(mean=(0.1307,), std=(0.3081,)),

# 改变了图像的维度顺序

# HWC 表示 "高度-宽度-通道",而 CHW 表示 "通道-高度-宽度"

vision.HWC2CHW()

]

# 将标签(可能是整数但数据类型不是 mindspore.int32)转换为 mindspore.int32 类型

label_transform = transforms.TypeCast(mindspore.int32)

# 使用 map 方法将 image_transforms 列表中的转换应用于数据集中的 'image' 字段

dataset = dataset.map(image_transforms, 'image')

# 使用 map 方法将 label_transform 应用于数据集中的 'label' 字段

dataset = dataset.map(label_transform, 'label')

# 将数据集中的数据分成大小为 batch_size 的批次。这对于深度学习训练通常很有用,因为它允许模型一次处理多个样本,从而加速训练过程

dataset = dataset.batch(batch_size)

# 返回处理后的数据集

return dataset

# 调用上述方法,将地图视觉变换和批处理数据集,这个就是训练与测试数据

train_dataset = datapipe(train_dataset, 64)

test_dataset = datapipe(test_dataset, 64)

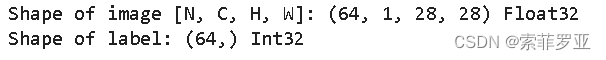

# 迭代测试数据集 test_dataset 并打印出其中一个样本的图像形状和数据类型,以及标签的形状和数据类型。输出结果如图2

# create_tuple_iterator() 用来来创建一个迭代器

for image, label in test_dataset.create_tuple_iterator():

# 打印出当前样本的图像形状和数据类型

# N 是批量大小, C 是通道数, H 是图像的高度, W 是图像的宽度,shape元组,dtype-数据类型

print(f"Shape of image [N, C, H, W]: {image.shape} {image.dtype}")

print(f"Shape of label: {label.shape} {label.dtype}")

break

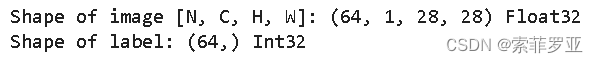

# 同上面迭代类似,采用create_dict_iterator()创建迭代器,用于产生字典.输出结果如图3

for data in test_dataset.create_dict_iterator():

print(f"Shape of image [N, C, H, W]: {data['image'].shape} {data['image'].dtype}")

print(f"Shape of label: {data['label'].shape} {data['label'].dtype}")

break

下载后的数据结果图(图1):

for循环输出结果(图2):

for循环输出结果(图3):

二、网络构建

mindspore.nn类是构建所有网络的基类,也是网络的基本单元。当用户需要自定义网络时,可以继承nn.Cell类,并重写__init__方法和construct方法。__init__包含所有网络层的定义,construct中包含数据(Tensor)的变换过程。

# 定义一个神经网络类,继承nn.Cell

# 在 MindSpore 框架中,nn.Cell 是所有神经网络层的基类。

class Network(nn.Cell):

# 初始化

def __init__(self):

super().__init__()

# 定义了一个展平层,用于将输入的 28x28 图像展平为一个一维向量,其长度为 28*28。

self.flatten = nn.Flatten()

# 顺序容器,三个全连接层(或称为密集层)和两个 ReLU 激活函数。每个全连接层都接受一个输入大小和一个输出大小

# 输入大小(28*28)和输出大小(10)设计的

self.dense_relu_sequential = nn.SequentialCell(

nn.Dense(28*28, 512),

nn.ReLU(),

nn.Dense(512, 512),

nn.ReLU(),

nn.Dense(512, 10)

)

# 定义网络的前向传播过程 神经网络(计算图)构建

def construct(self, x):

x = self.flatten(x)

logits = self.dense_relu_sequential(x)

return logits

# 实例化了 Network 类,创建了一个 model 对象。

model = Network()

# 打印出模型的详细结构。在 MindSpore 中,打印模型通常会显示其各层的详细信息,包括层的类型、输入和输出形状等

print(model)

三、模型训练

在模型训练中,一个完整的训练过程(step)需要实现以下三步:

1、正向计算:模型预测结果(logits),并与正确标签(label)求预测损失(loss)。

2、反向传播:利用自动微分机制,自动求模型参数(parameters)对于loss的梯度(gradients)。

3、参数优化:将梯度更新到参数上。

MindSpore使用函数式自动微分机制,因此针对上述步骤需要实现:

定义正向计算函数。

使用value_and_grad通过函数变换获得梯度计算函数。

定义训练函数,使用set_train设置为训练模式,执行正向计算、反向传播和参数优化。

# 定义了交叉熵损失函数

loss_fn = nn.CrossEntropyLoss()

# 定义了SGD优化器,学习率为0.01

optimizer = nn.SGD(model.trainable_params(), 1e-2)

# 1. 定义了前向传播函数forward_fn,它接收数据和标签,通过模型得到logits(预测值),并计算损失:

def forward_fn(data, label):

logits = model(data)

loss = loss_fn(logits, label)

return loss, logits

# 2. grad_fn 获取损失和梯度的logits

grad_fn = mindspore.value_and_grad(forward_fn, None, optimizer.parameters, has_aux=True)

# 3. Define function of one-step training

def train_step(data, label):

(loss, _), grads = grad_fn(data, label)

optimizer(grads)

return loss

def train(model, dataset):

size = dataset.get_dataset_size()

model.set_train()

for batch, (data, label) in enumerate(dataset.create_tuple_iterator()):

loss = train_step(data, label)

if batch % 100 == 0:

loss, current = loss.asnumpy(), batch

print(f"loss: {loss:>7f} [{current:>3d}/{size:>3d}]")

除训练外,我们定义测试函数,用来评估模型的性能。

def test(model, dataset, loss_fn):

num_batches = dataset.get_dataset_size()

model.set_train(False)

total, test_loss, correct = 0, 0, 0

for data, label in dataset.create_tuple_iterator():

pred = model(data)

total += len(data)

test_loss += loss_fn(pred, label).asnumpy()

correct += (pred.argmax(1) == label).asnumpy().sum()

test_loss /= num_batches

correct /= total

print(f"Test: \n Accuracy: {(100*correct):>0.1f}%, Avg loss: {test_loss:>8f} \n")

训练过程需多次迭代数据集,一次完整的迭代称为一轮(epoch)。在每一轮,遍历训练集进行训练,结束后使用测试集进行预测。打印每一轮的loss值和预测准确率(Accuracy),可以看到loss在不断下降,Accuracy在不断提高。

epochs = 3

for t in range(epochs):

print(f"Epoch {t+1}\n-------------------------------")

train(model, train_dataset)

test(model, test_dataset, loss_fn)

print("Done!")

Epoch 1

loss: 2.302088 [ 0/938]

loss: 2.290692 [100/938]

loss: 2.266338 [200/938]

loss: 2.205240 [300/938]

loss: 1.907198 [400/938]

loss: 1.455603 [500/938]

loss: 0.861103 [600/938]

loss: 0.767219 [700/938]

loss: 0.422253 [800/938]

loss: 0.513922 [900/938]

Test:

Accuracy: 83.8%, Avg loss: 0.529534

Epoch 2

loss: 0.580867 [ 0/938]

loss: 0.479347 [100/938]

loss: 0.677991 [200/938]

loss: 0.550141 [300/938]

loss: 0.226565 [400/938]

loss: 0.314738 [500/938]

loss: 0.298739 [600/938]

loss: 0.459540 [700/938]

loss: 0.332978 [800/938]

loss: 0.406709 [900/938]

Test:

Accuracy: 90.2%, Avg loss: 0.334828

Epoch 3

loss: 0.461890 [ 0/938]

loss: 0.242303 [100/938]

loss: 0.281414 [200/938]

loss: 0.207835 [300/938]

loss: 0.206000 [400/938]

loss: 0.409646 [500/938]

loss: 0.193608 [600/938]

loss: 0.217575 [700/938]

loss: 0.212817 [800/938]

loss: 0.202862 [900/938]

Test:

Accuracy: 91.9%, Avg loss: 0.280962

Done!

四、保存模型

模型训练完成后,需要将其参数进行保存。

Save checkpoint

mindspore.save_checkpoint(model, "model.ckpt")

print("Saved Model to model.ckpt")

Saved Model to model.ckpt

五、加载模型

加载保存的权重分为两步:

重新实例化模型对象,构造模型。

加载模型参数,并将其加载至模型上。

Instantiate a random initialized model

model = Network()

Load checkpoint and load parameter to model

param_dict = mindspore.load_checkpoint("model.ckpt")

param_not_load, _ = mindspore.load_param_into_net(model, param_dict)

print(param_not_load)

[]

param_not_load是未被加载的参数列表,为空时代表所有参数均加载成功。

加载后的模型可以直接用于预测推理。

model.set_train(False)

for data, label in test_dataset:

pred = model(data)

predicted = pred.argmax(1)

print(f'Predicted: "{predicted[:10]}", Actual: "{label[:10]}"')

break

998

998

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?