softmax与sigmoid

引用文章

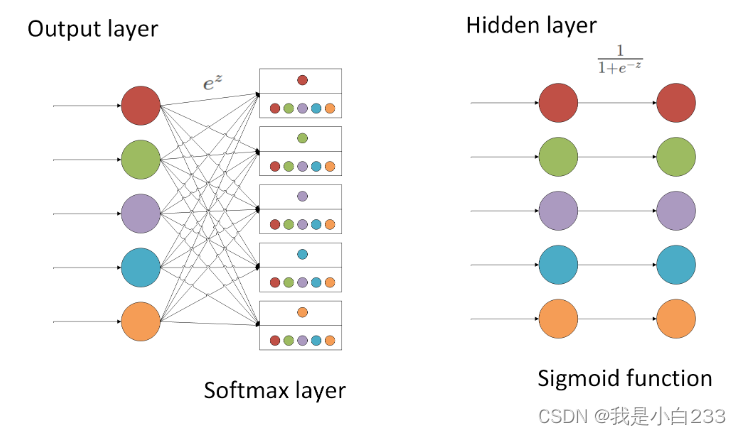

如上图所示,不同之处: softmax的输出是一个比重,每个输出相加和为1。而sigmoid是将每一个输出做一个非线性映射而已。相同之处: softmax与sigmoid的输出值的大小范围都是[0,1]。

区别就在于softmax是一个针对输出结果归一化的过程,所以很多文献里也称作softmax层;而sigmoid只是一个非线性激活过程,所以一般称为激活函数,多用于二分类。

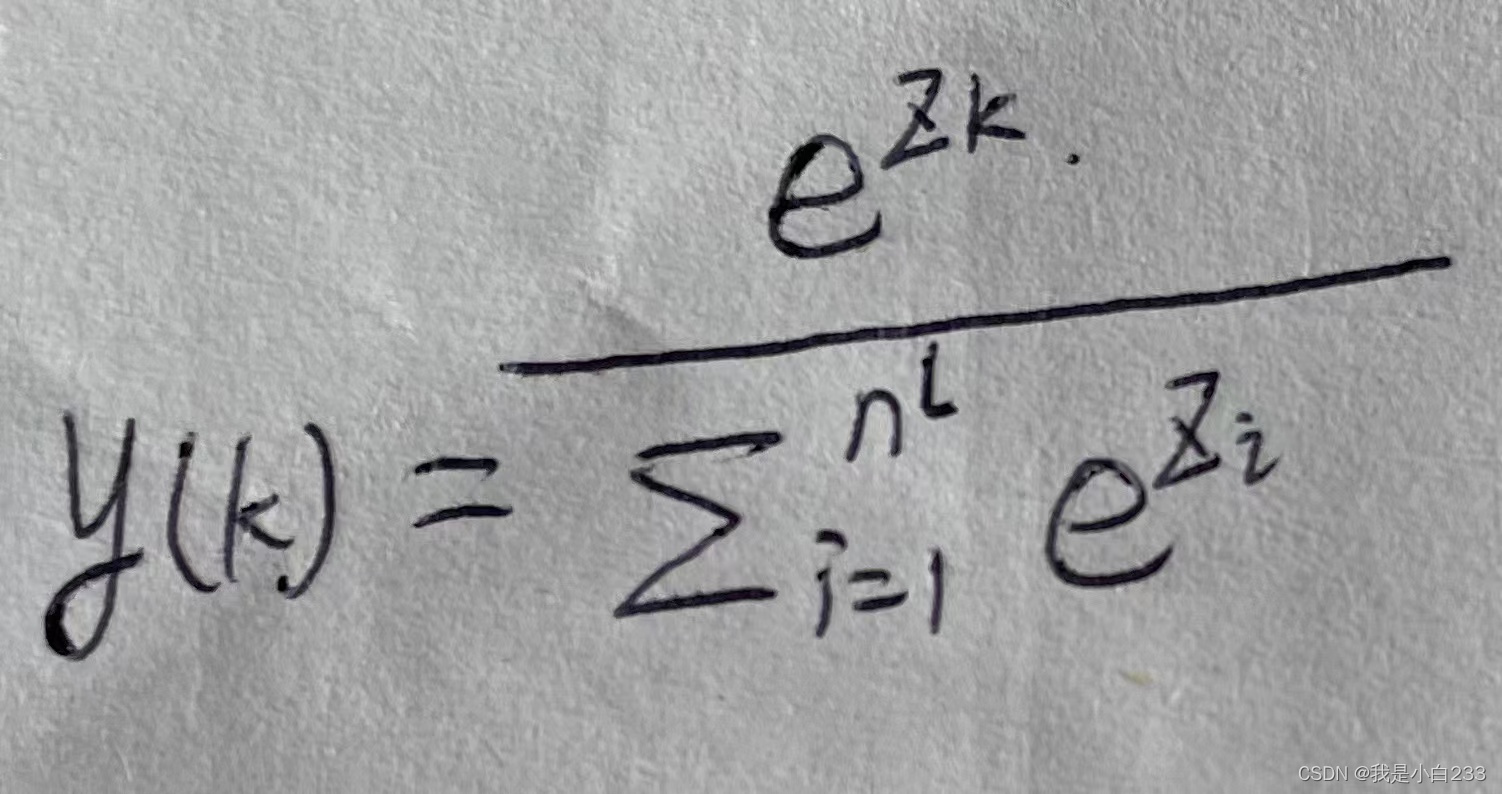

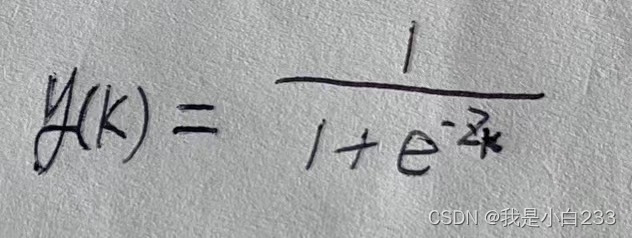

二者公式上也并不是直接归一化的关系:

softmax的计算公式为:

sigmoid的计算公式为:

交叉熵损失函数(CrossEntropy Loss)

二分类的交叉熵损失函数 --y为标签,y^为对应标签的预测概率

多分类的交叉熵损失函数

多分类的交叉熵损失函数

2792

2792

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?