目录

一、什么是RDD

(一)RDD概念

- Spark提供了一种对数据的核心抽象,称为弹性分布式数据集(Resilient Distributed Dataset,RDD)。这个数据集的全部或部分可以缓存在内存中,并且可以在多次计算时重用。RDD其实就是一个分布在多个节点上的数据集合。

RDD的弹性主要是指当内存不够时,数据可以持久化到磁盘,并且RDD具有高效的容错能力

(二)RDD示例

- 将数据集(hello,world,scala,spark,love,spark, happy)存储在三个节点上,节点一存储(hello,world),节点二存储(scala,spark,love),节点三存储(spark,happy),这样对三个节点的数据可以并行计算,并且三个节点的数据共同组成了一个RDD。

- 分布式数据集类似于HDFS中的文件分块,不同的块存储在不同的节点上;而并行计算类似于使用MapReduce读取HDFS中的数据并进行Map和Reduce操作。Spark则包含这两种功能,并且计算更加灵活。

- 在编程时,可以把RDD看作是一个数据操作的基本单位,而不必关心数据的分布式特性,Spark会自动将RDD的数据分发到集群的各个节点。Spark中对数据的操作主要是对RDD的操作(创建、转化、求值)。

(三)RDD主要特征

- RDD是不可变的,但可以将RDD转换成新的RDD进行操作。

- RDD是可分区的。RDD由很多分区组成,每个分区对应一个Task任务来执行。

- 对RDD进行操作,相当于对RDD的每个分区进行操作。

- RDD拥有一系列对分区进行计算的函数,称为算子。

- RDD之间存在依赖关系,可以实现管道化,避免了中间数据的存储。

二、做好准备工作

(一)准备文件

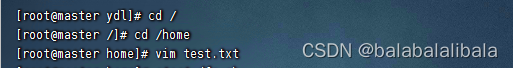

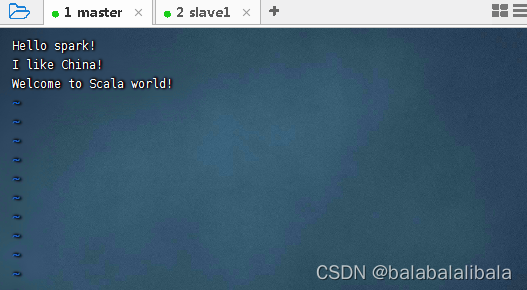

1、准备本地系统文件

在/home目录里创建test.txt

2、启动HDFS服务

执行命令:start-dfs.sh

<

目录一、什么是RDD(一)RDD概念(二)RDD示例(三)RDD主要特征二、做好准备工作(一)准备文件1、准备本地系统文件2、启动HDFS服务3、准备HDFS系统文件(二)启动SparkShell1、启动Spark服务2、启动Spark Shell三、创建RDD(一)从对象集合创建RDD1、利用parallelize()方法创建RDD2、利用makeRDD()方法创建RDD 3、总结说明(二)从外部存储创建RDD1、读取......

目录一、什么是RDD(一)RDD概念(二)RDD示例(三)RDD主要特征二、做好准备工作(一)准备文件1、准备本地系统文件2、启动HDFS服务3、准备HDFS系统文件(二)启动SparkShell1、启动Spark服务2、启动Spark Shell三、创建RDD(一)从对象集合创建RDD1、利用parallelize()方法创建RDD2、利用makeRDD()方法创建RDD 3、总结说明(二)从外部存储创建RDD1、读取......

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2359

2359

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?