我们在使用fork()产生了一个子进程,子进程和父进程都是执行的相同的代码,此时我们又是如何进程执行的呢。

-

虚拟地址空间和物理内存

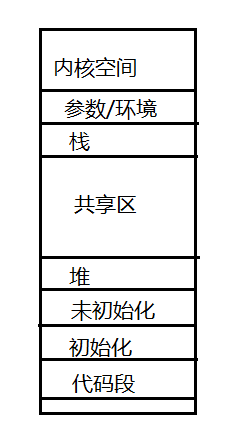

这就是我们的虚拟地址空间,他实际上是使用一个结构体mm_struct结构体去描述的一段内存,并不是存储我们变量和代码的地方,

此时的task_struct就是一个进程描述块,其实就是我们的PCB,mm_struct就是PCB中的一个成员,就是内存指针。

此时的task_struct就是一个进程描述块,其实就是我们的PCB,mm_struct就是PCB中的一个成员,就是内存指针。

如图,在mm_struct后面是就是我们的数据段,堆区,栈区,代码段,内存映射区等等。

物理内存就是我们实际存储代码的,当我们一个进程运行的时候我们就需要将自己的代码赋值到内存中去,这时候内存就是物理内存,这里我们要清楚物理内存和我们上面所讲的虚拟地址空间是有所不同的。 -

mm_struct的数据结构

在地址空间中,mmap为地址空间的内存区域(用vm_area_struct结构来表示)链表,mm_rb用红黑树来存储,链表表示起来更加方便,红黑树表示起来更加方便查找。

区别是,当虚拟区较少的时候,这个时候采用单链表,由mmap指向这个链表,当虚拟区多时此时采用红黑树的结构,由mm_rb指向这棵红黑树。这样就可以在大量数据的时候效率更高。

所有的mm_struct结构体通过自身的mmlist域链接在一个双向链表上,该链表的首元素是init_mm内存描述符,代表init进程的地址空间。

atomic_t mm_users;

atomic_t mm_count;

每一个进程都可以被别的进程来共享,也就是和别的进程来共享mm_struct

kernel线程是没有地址空间的,也就没有对应的mm_struct,kernel线程使用之前运行的进程的内存描述符。

程序中通常用到的地址常常具有局部性,当前最近一次用的虚拟地址区间很可能下一次还是需要用到,所以我们采用局部性原理,通常时候我们去吧当前地址周围一个区间的内存放入高速缓存当中,这个区间在mm_struct当中就是由mmap_cache来维护。

struct mm_struct {

struct vm_area_struct * mmap; /* list of VMAs,指向线性区对象的链表头部 */

struct rb_root mm_rb; /* 指向线性区对象的红黑树*/

struct vm_area_struct * mmap_cache; /* last find_vma result 指向最近找到的虚拟区间 */

#ifdef CONFIG_MMU

/*用来在进程地址空间中搜索有效的进程地址空间的函数*/

unsigned long (*get_unmapped_area) (struct file *filp,

unsigned long addr, unsigned long len,

unsigned long pgoff, unsigned long flags);

/*释放线性区的调用方法*/

void (*unmap_area) (struct mm_struct *mm, unsigned long addr);

#endif

unsigned long mmap_base; /* base of mmap area ,内存映射区的基地址*/

unsigned long task_size; /* size of task vm space */

unsigned long cached_hole_size; /* if non-zero, the largest hole below free_area_cache */

unsigned long free_area_cache; /* first hole of size cached_hole_size or larger */

pgd_t * pgd; /* 页表目录指针*/

atomic_t mm_users; /* How many users with user space?,共享进程的个数 */

atomic_t mm_count; /* How many references to "struct mm_struct" (users count as 1),主使用计数器,采用引用计数,描述有多少指针指向当前的mm_struct */

int map_count; /* number of VMAs ,线性区个数*/

struct rw_semaphore mmap_sem;

spinlock_t page_table_lock; /* Protects page tables and some counters,保护页表和引用计数的锁 (使用的自旋锁)*/

struct list_head mmlist; /* List of maybe swapped mm's. These are globally strung

* together off init_mm.mmlist, and are protected

* by mmlist_lock

*/

unsigned long hiwater_rss; /* High-watermark of RSS usage,进程拥有的最大页表数目 */

unsigned long hiwater_vm; /* High-water virtual memory usage ,进程线性区的最大页表数目*/

unsigned long total_vm, locked_vm, shared_vm, exec_vm;

unsigned long stack_vm, reserved_vm, def_flags, nr_ptes;

unsigned long start_code, end_code, start_data, end_data; /*维护代码区和数据区的字段*/

unsigned long start_brk, brk, start_stack; /*维护堆区和栈区的字段*/

unsigned long arg_start, arg_end, env_start, env_end; /*命令行参数的起始地址和尾地址,环境变量的起始地址和尾地址*/

unsigned long saved_auxv[AT_VECTOR_SIZE]; /* for /proc/PID/auxv */

/*

* Special counters, in some configurations protected by the

* page_table_lock, in other configurations by being atomic.

*/

struct mm_rss_stat rss_stat;

struct linux_binfmt *binfmt;

cpumask_t cpu_vm_mask;

/* Architecture-specific MM context */

mm_context_t context;

/* Swap token stuff */

/*

* Last value of global fault stamp as seen by this process.

* In other words, this value gives an indication of how long

* it has been since this task got the token.

* Look at mm/thrash.c

*/

unsigned int faultstamp;

unsigned int token_priority;

unsigned int last_interval;

unsigned long flags; /* Must use atomic bitops to access the bits */

struct core_state *core_state; /* coredumping support */

#ifdef CONFIG_AIO

spinlock_t ioctx_lock;

struct hlist_head ioctx_list;

#endif

#ifdef CONFIG_MM_OWNER

/*

* "owner" points to a task that is regarded as the canonical

* user/owner of this mm. All of the following must be true in

* order for it to be changed:

*

* current == mm->owner

* current->mm != mm

* new_owner->mm == mm

* new_owner->alloc_lock is held

*/

struct task_struct *owner;

#endif

#ifdef CONFIG_PROC_FS

/* store ref to file /proc/<pid>/exe symlink points to */

struct file *exe_file;

unsigned long num_exe_file_vmas;

#endif

#ifdef CONFIG_MMU_NOTIFIER

struct mmu_notifier_mm *mmu_notifier_mm;

#endif

};

实际上我们mm_struct就是一个结构体,就是用来描述我们的虚拟地址空间。方便我们的虚拟地址找到我们的物理内存中的时候能够快速找到我们所要执行的代码。

2143

2143

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?