集团的内部通讯工具搜同事时,需要根据姓名后缀进行搜索。譬如“徐欢春”,我们要能根据“欢春”搜出这个人;“黄继刚”,要根据“继刚”为关键字搜出“黄继刚”。这是个很人性化的用户体验,当我们有同事的名字是三个字的时候,我们通常会叫他们名字的最后两个字。Lucene本身并没有提供这种分词器,只能自己照着Lucene已有的分词器进行模仿开发。

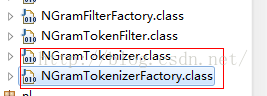

参照ngram分词器进行开发。

要定制这个后缀分词器,实现一个Tokenizer和一个工厂类就可以了。Tokenizer类是实际分词是要用到的类。为了方便单元测试,额外增加一个Analyzer类。

分词器类

package org.apache.lucene.analysis.suffix;

import java.io.IOException;

import java.io.Reader;

import org.apache.commons.logging.Log;

import org.apache.commons.logging.LogFactory;

import org.apache.lucene.analysis.Tokenizer;

import org.apache.lucene.analysis.tokenattributes.CharTermAttribute;

import org.apache.lucene.analysis.tokenattributes.OffsetAttribute;

/**

* 用于姓名取后缀的分词器

*

* @author cdlvsheng

* date : 2014年9月23日

* time : 下午1:49:36

* project : im-solr-web

* user : cdlvsheng

*/

public class SuffixTokenizer extends Tokenizer {

private Log LOG = LogFactory.getLog(SuffixTokenizer.class);

private char[] buffer = new char[1024];

private int suffixOffset;

private static int MAX_SIZE;

private int termSize;

private final CharTermAttribute termAtt = addAttribute(CharTermAttribute.class);

private final OffsetAttribute offsetAtt = addAttribute(OffsetAttribute.class);

protected SuffixTokenizer(Reader input) {

super(input);

}

protected SuffixTokenizer(AttributeFactory factory, Reader input) {

super(factory, input);

}

@Override

public boolean incrementToken() throws IOException {

try {

clearAttributes();

if (termSize != -1) {

termSize = input.read(buffer);

if (termSize >= 0) {

MAX_SIZE = termSize;

}

}

if (suffixOffset + 1 >= MAX_SIZE) {

return false;

}

termAtt.copyBuffer(buffer, suffixOffset, MAX_SIZE);

termAtt.setLength(MAX_SIZE - suffixOffset);

offsetAtt.setOffset(correctOffset(suffixOffset), correctOffset(MAX_SIZE));

LOG.debug(termAtt.buffer());

suffixOffset++;

} catch (Exception e) {

LOG.error(e.getMessage(), e);

}

return true;

}

@Override

public final void end() {

final int finalOffset = correctOffset(suffixOffset);

this.offsetAtt.setOffset(finalOffset, finalOffset);

}

@Override

public void reset() throws IOException {

super.reset();

termSize = 1;

suffixOffset = 1;

MAX_SIZE = 0;

}

}

incrementToken方法是实际分词时用到的方法。一会单元测试时可以看出它的作用。

工厂类

package org.apache.lucene.analysis.suffix;

import java.io.Reader;

import java.util.Map;

import org.apache.lucene.analysis.Tokenizer;

import org.apache.lucene.analysis.util.TokenizerFactory;

import org.apache.lucene.util.AttributeSource.AttributeFactory;

public class SuffixTokenizerFactory extends TokenizerFactory {

public SuffixTokenizerFactory(Map<String, String> args) {

super(args);

}

@Override

public Tokenizer create(AttributeFactory factory, Reader input) {

return new SuffixTokenizer(factory, input);

}

}

工厂类的作用就是产生分词器类的实例。

analyzer类

package org.apache.lucene.analysis.suffix;

import java.io.Reader;

import org.apache.lucene.analysis.Analyzer;

import org.apache.lucene.analysis.Tokenizer;

public final class SuffixAnalyzer extends Analyzer {

@Override

protected TokenStreamComponents createComponents(String fieldName, Reader reader) {

final Tokenizer source = new SuffixTokenizer(reader);

return new TokenStreamComponents(source, source);

}

}以上3个类合作就构成了一个完整的自定义分词器组件。

单元测试

package test.prefix.tokenizer;

import java.io.IOException;

import org.apache.lucene.analysis.TokenStream;

import org.apache.lucene.analysis.suffix.SuffixAnalyzer;

import org.apache.lucene.analysis.tokenattributes.CharTermAttribute;

import org.junit.Test;

/**

* @author cdlvsheng

* date : 2014年9月22日

* time : 下午7:23:01

* project : im-solr-web

* user : cdlvsheng

*/

public class SuffixTest {

@SuppressWarnings("resource")

@Test

public void suffixTest() {

try {

SuffixAnalyzer analyzer = new SuffixAnalyzer();

TokenStream ts = analyzer.tokenStream("text", "黄继刚");

CharTermAttribute term = ts.addAttribute(CharTermAttribute.class);

ts.reset();

while (ts.incrementToken()) {

System.out.println(term.toString());

}

ts.end();

ts.close();

} catch (IOException e) {

e.printStackTrace();

}

}

}

程序输出结果:

继刚学习一个新的框架,照葫芦画瓢可能是最快捷的方式,但是有点赶鸭子上架的感觉。

534

534

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?