入门级算法:梯度下降法(GD)

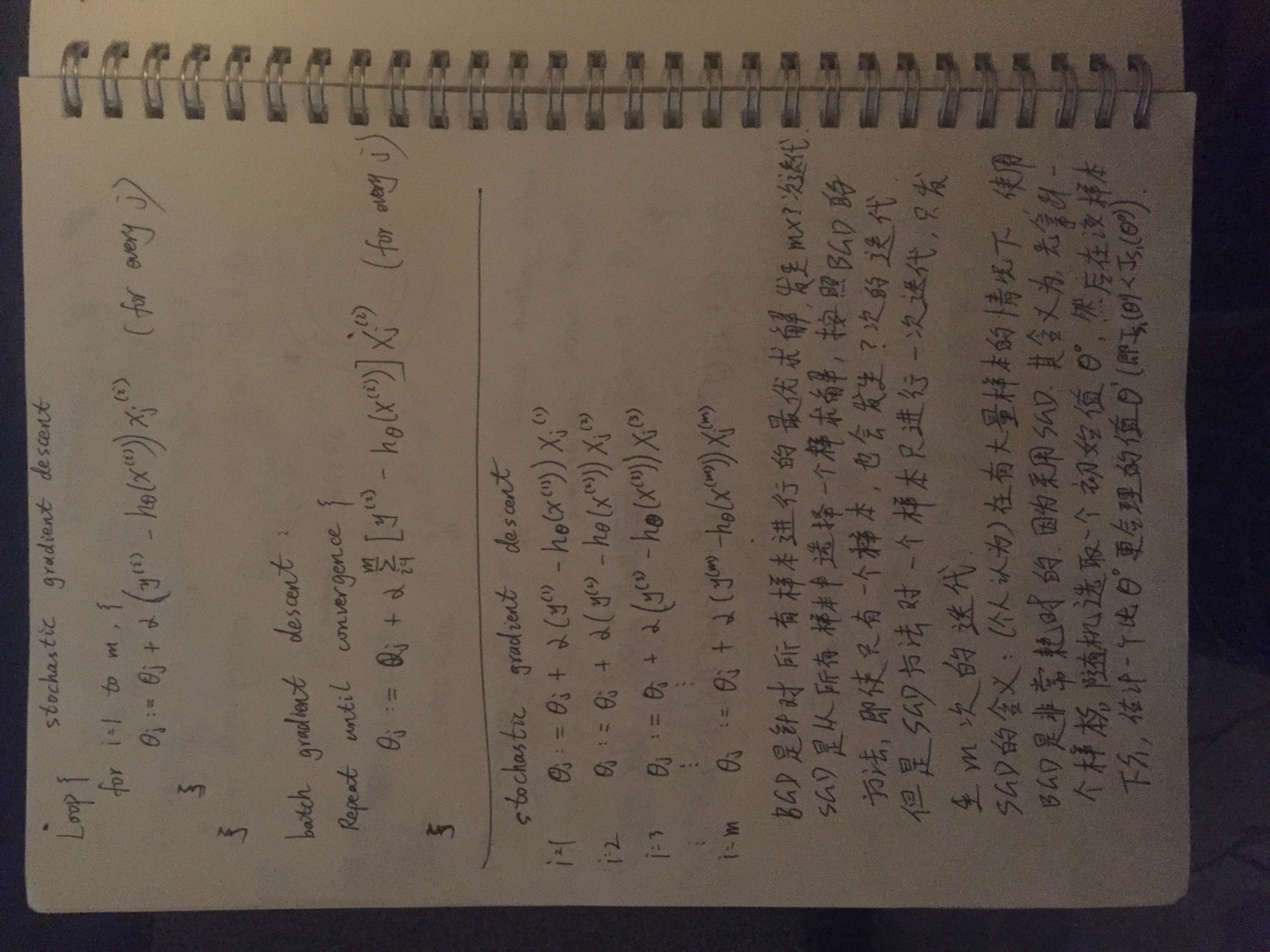

batch gradient descent(BGD) and stochastic gradient descent(SGD)

当使用大量样本时,SGD不用循环所有样本吧?

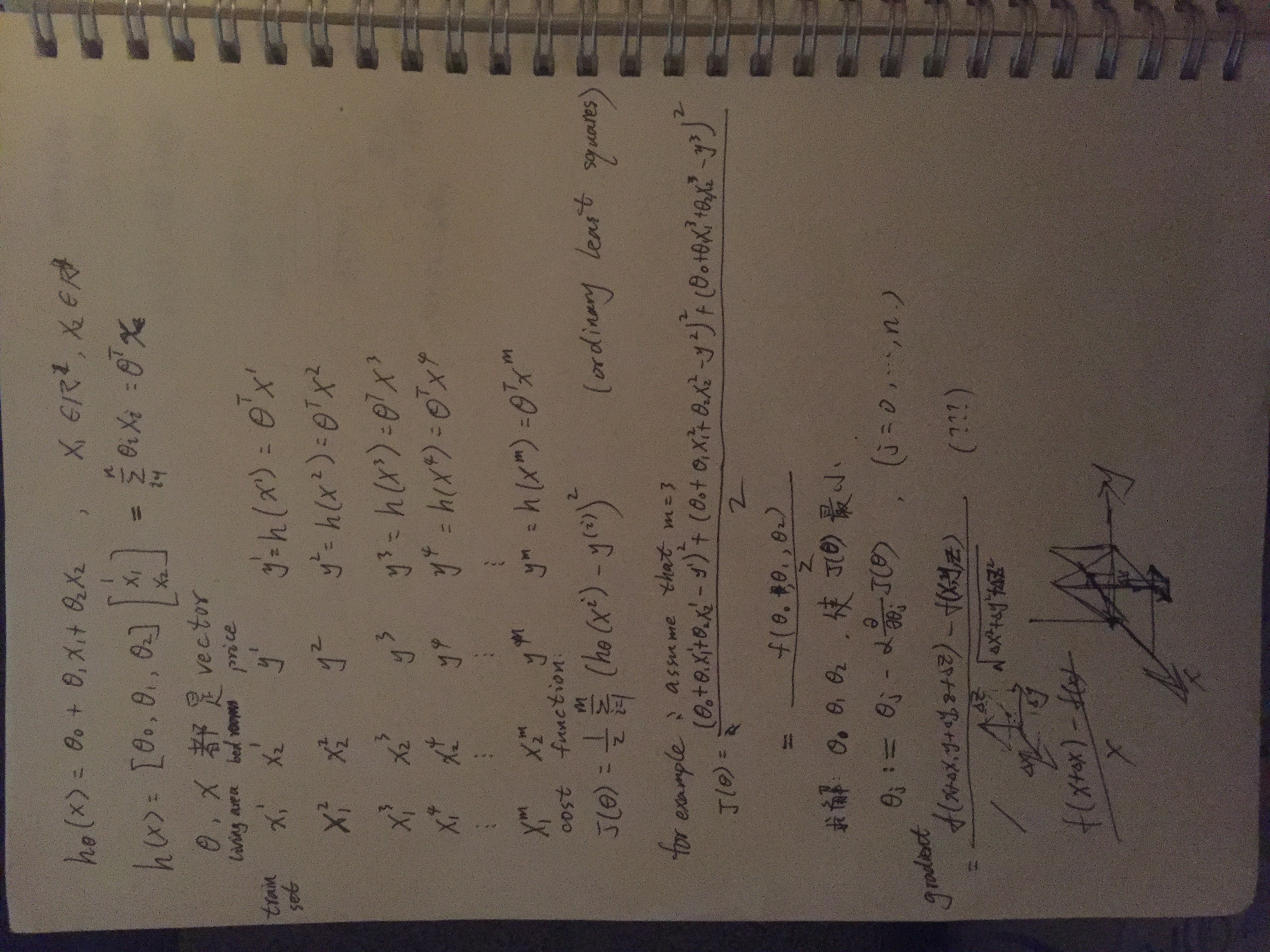

page1:

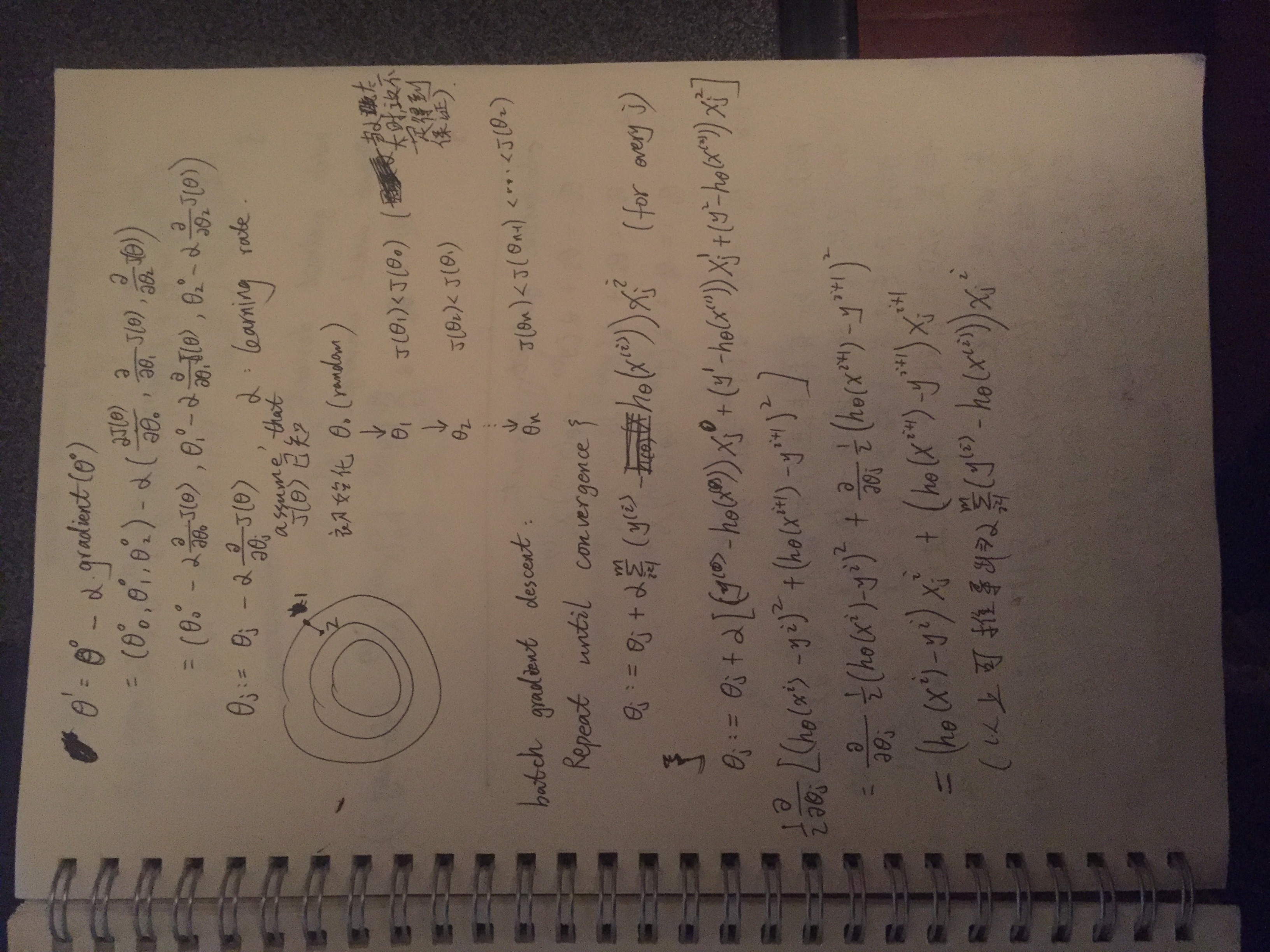

page2:

page3:

page4

2016.04.13

在page4中,对于stochastic gradient descent的“stochastic”,理解的不正确。

那么,该怎样理解“stochastic”呢?

难道,从统计的角度看,【在大量样本情况下,对单个样本求梯度,然后循环每个样本,估计出的参数值就是近似满足要求的。】,会有这样的结论吗?怎样证明。

12万+

12万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?