来源:CreateAMind

退休教授熊墨淼

美国德州大学公共卫生学院,生物统计和数据科学系,人类遗传中心

德州大学休斯顿健康卫生中心,德州大学安徳森癌症中心生物医学科学研究生院

中国十分重要的一年一度的人工智能学术讨论会,2023年智源人工智能大会已经结束。深度学习三巨头之一YannLeCun, OpenAICEOSamAltman,Midjourney的創始人DavidHolz的演讲或访谈录集中谈到了不同的通向一般人工智能的道路。综合他们报 告的内容和其他文献,我认为超维计算是未来人工智能研究的重要方向,是我们通向一般人工智能的桥梁。

不同的通向一般人工智能的道路

大会最重要的主题是未来十年的人工智能研究的方向。这些学术界的巨人由于他们思维的独立性,各自的看法和主张是不一样的。Sam Altman今年才38岁,是新一代的人工智能科学家。尽管隶属Google的DeepMind在人工智能方面发表了一系列开創性的论文, 但OpenAI 研制了震动全世界的ChatGPT,使人工智能朝着实用的方向高歌猛进,正在革命性地改变整个社会。这一成果充分表明,Altman不仅是一位杰出的科学家,还是一位出色的组织者。人工智能是一门实践性很强的学科,倘若设有人出色地领导一个研究团队 ,协同工作,很难創造一个出色的产品岀来。

OpenAI会继续他们的工作,开发GPT5,注意对齐,包括扩展性和可解释性和可泛化性。预测十年内可能会出现超强AI。因此需要加强国际间的合作,推进AGI的安全。

三巨头之一,图灵奖得主YannLeCun发表了《走向能够学习,推理和规划的大模型》,提出了与OpenAI不同的发展通用人工智能的路线。他认为GPT模式五年就不会有人用。不象有些学者认为现在AI具有与人较量的智力,楊立昆教授认为AI的能力与人的 能力,甚至与动物的能力是有差距的。与人能力的差距主要在推理和规划。由于推理能力 有限,其自身不能辩别真假,陈述可能存在不一致性,有偏见。他提出了兼具学习,推理 ,规划和决策的人工智能。他认为推理和规范的核心是观察和体验世界。因而提出了世界 模型,也就是感知,输入,存储和理解整个外部世界的模型,(在一定程度上理解我们内部世界的模型。这是我加的)。世界模型包括世界的感知和表征,包括语言,外部世界的图象,声音,视频等。推理包括系统1,即与潜意识相对应的人类行为和行动,系统2,即是有意识,有目的去做的事情。一般人工智能应该象人那样具有将复杂任务|分解为一系列简单任务的能力。最为激动人心的是大家称为"教父"的图灵奖得主GeoffreyHinton的闭幕会上的演讲。他提出了人工智能研究所面临的两个基本问题和两条通向智能的道路。

他的第一个问题是人造的神经网络能否很快比我们大恼的神经网络更智能?第二个问题是人能否控制这种超级人工智能? 辛顿(Hinton)教授认为超级人工智能很快会到来,而人难于控制超级人工智能。

现在的计算机是软、硬件分离的。我们编写的程序可在不同的计算机,不同的硬件上重复 执行。在这个意义上来说,传统的计算是一种永生的计算。要达到永生这种计算,使软硬件分离,必须在高能耗的晶体管上运行,而不能使用模拟,具有高度可变性的硬件。要降低能耗就必须抛弃传统计算机软硬件分离的基本规则。

传统的计算机运行是根据我们编写的程序去严格执行的。但新型的计算机学习是通过例子来进行的。我们给计算机以例子,计算机从例子中学习我们希望计算机做什么,从例子中学习数据所隐含的规律,模式。这样计算机就会越来越聪明,就会学到我们人所不知道的东西。

新一代的计算机,辛顿称为《普通人的计算》是使用模拟计算机把人工智能和硬件联姻, 放弃软件和硬件的分离而接受知识是与硬件的具体物理性质密不可分的。辛顿教授于十二 月一日在新奥尔良NeurlPS闭幕演说时首次提出来。在他于去年12月27日所发表的予印本"The forward-forward algorithm: somepreliminaryinvestigation "上又提在模拟 计算机上用向前算法代理反向算法。这次在北京2023年智源大会上再次提出。这样做有两大优点:(1)节省大量能耗,(2)使用便宜得多的硬件。可期待许多纳米新技术,或采用遗传工程制作生物神经元。

因为模拟计算机没有精确的向前模型,辛顿以前提出的,现在神经网络学习算法中广泛采用的反向梯度传播方法就不可使用。因此辛顿教授提出了前向-前向算法。毕业于加拿大 多倫多大学,现在纽约大学計算机系和柯朗数学研究所任助理教授的MengyeRen曾在 多倫多谷歌大恼作访问研究员跟随辛顿教授为使前向-前向算法发挥作用作出了大量工作。

普通人计算的第二个问题是它的生命有限性。即当一个特定的硬件死掉时,它所学到的所 有知识也随之死去。辛顿教授提出了教师-学生知识蒸馏法。学生向教师学习的是模仿教师对外部输入的各种正确反应,不依赖于具体所学到的知识。

辛顿提出的第二条走向一般人工智能的道路是超级智能的构想。超级人工智能的核心是巨大的神经网络在多台数字计算机上直接地向世界而不是只靠向语言获取知识。辛顿教授认为人类很难控制超级人工智能。他看不出如何防止这种情况发生。他说"但我老了。我希望像你们这样的许多年轻而才华横溢的研究人员会弄清楚我们如何拥有这些超级智能"

模拟计算机因应人工智能的发展,再登历史舞台

电子模拟计算机在上世纪四十年代得到了广泛的发展。我在大学二年级上计算方法课的时候,所用的计算机是一种机械式摸拟计算机一手摇计算机。模拟计算机因太难设计,建造,操作和维护。数字计算机因能直接编程,易于存储,精度高,易于操作,于上世纪六十 年代,正当中国在如火如荼进行文化大革命的时候取代了模拟计算机,那时典型的数字计算机代表是IBM360.

随着人工智能的发展,大语言模型具有几千亿参数,需要海量数据进行大规模预训练,对计算机的速度和功效提岀了极大的挑战。为了降低功耗,节省成本,增加计算速度,"风水轮流转,十年一轮迴",人们又把目光重新转向了模拟计算具有下列几个原因。

(1)经过几十年的技术改进,模拟计算机的制造工艺逐渐稳定可靠。(2)模拟计算功

效低,能满足基础模型预训练对功效的要求。(3)模拟计算提高了计算精确。

(4)超维向量计算被认为与人的大脑智能活动相似,是通向一般人工智能的道路之一。模拟计算用于超维向量计算速度比数字计算机快。超维向量的一个主要运算是乘法。乘法很容易用模拟运算实现:

电压*电导=电荷(电流) 。所以计算机系统的模拟表示通常更自然。

(5)现在的许多应用可能只需要一点点计算能力,使用数字计算会耗费大量的计算资源。

总之,模拟计算具有两大优势:一是速度快,二是功效低,成本便宜。如采用180nm的 模拟工艺设计相当于65nm的数字设计。这正是目前人工智能基础模型需要急迫解决的两大难题。模拟计算有可能取代GPU。

模拟计算的研究正在IBM和Mythic, Arm,Innatera,RainNeuromorphics和中国的"每

刻深思"等初創公司进行。

模拟计算存在几大挑战:

(1)将复杂的大而昂贵的计算问题分解为更小的子问题。

(2)实现远距离的随意互联仍然是个难题。

(3)提高运算精度。

模拟计算不是通用计算,而是面向特定领域的计算。它是面向特定领域的计算,其与算法 和应用结合的非常紧密。在底层架构变成模拟计算单元后,要设计和优化相应的算法,设计针对应用的最合适的模拟计算电路。这是统计学家可以大展身手的地方。

模拟计算机的大规模商业化据估计大约需3至5年的时间。新一代的人工智能会催生模拟计算机,或更准确地说,新的模拟数字混合计算机的诞生。

类脑鼓舞下的超维计算是通向一般人工智能(AGI)的桥樑

Herscheetal. 2023 , ANeuro-vector-symbolicArchitecturefor

SolvingRaven’sProgressiveMatrices.

现在的人工智能分析计算往往需要大规模的计算,耗时,耗能,耗费。人工智能分析不 透明,难于解释,缺乏推理,规划和决策。现在的人工智能系统过于复杂,源于人工智能最先提出的神经网络模型,具体来说,现在的人工智能主要有如下缺点:

(1)过分依赖大量标记的数据去学习、发现模式和预报未来。而大量数据的产生和收集

往往是困难的。

(2)缺乏常识推理和理解上下文,难于掌握语言,声音和视觉信号所隐含的意义。

(3) 许多人工智能模型,如深度神经网络是黑箱。他们的分析过程不透明,结论缺乏可解释性。因而阻碍了利用人工智能进行决策。

(4)现在人工智能需要很强的算力,耗时,耗能,耗费。

(5)现代人工智能需要搜索巨大的解空间。他们追求许多近似正确的解,但不是稀少的唯一正确的解。

(6)正在出现的计算设备运行电压低以減少能耗,必能产生充满噪声的结果。低压条件 下运行的计算机因而'由不可靠的,随机的计算元件组成。这些计算设备是並行的,分布式的。

(7)缺乏处理符号运算。分析多依赖于关联,而缺乏因果性。

为了克服这些困难,类恼的超维计算提出了。它能同时处理符号和数值运算。超维概念起源于上世纪九十年代。Kanerva and TonyPlate(那时是多倫多大学辛顿的博士生)提出

了超维的概念,各自独立地发展了一套处理超维向量的代数运算。

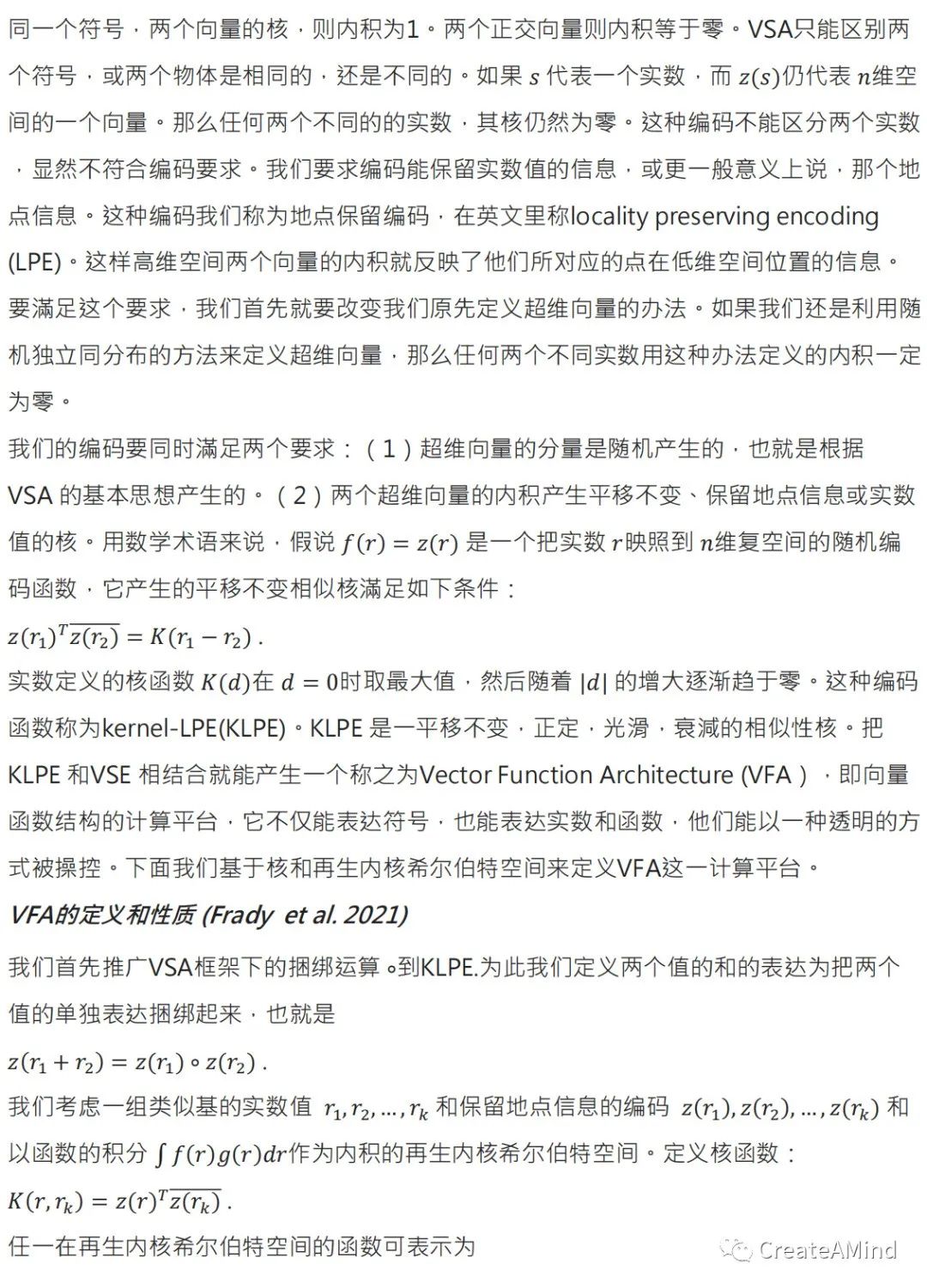

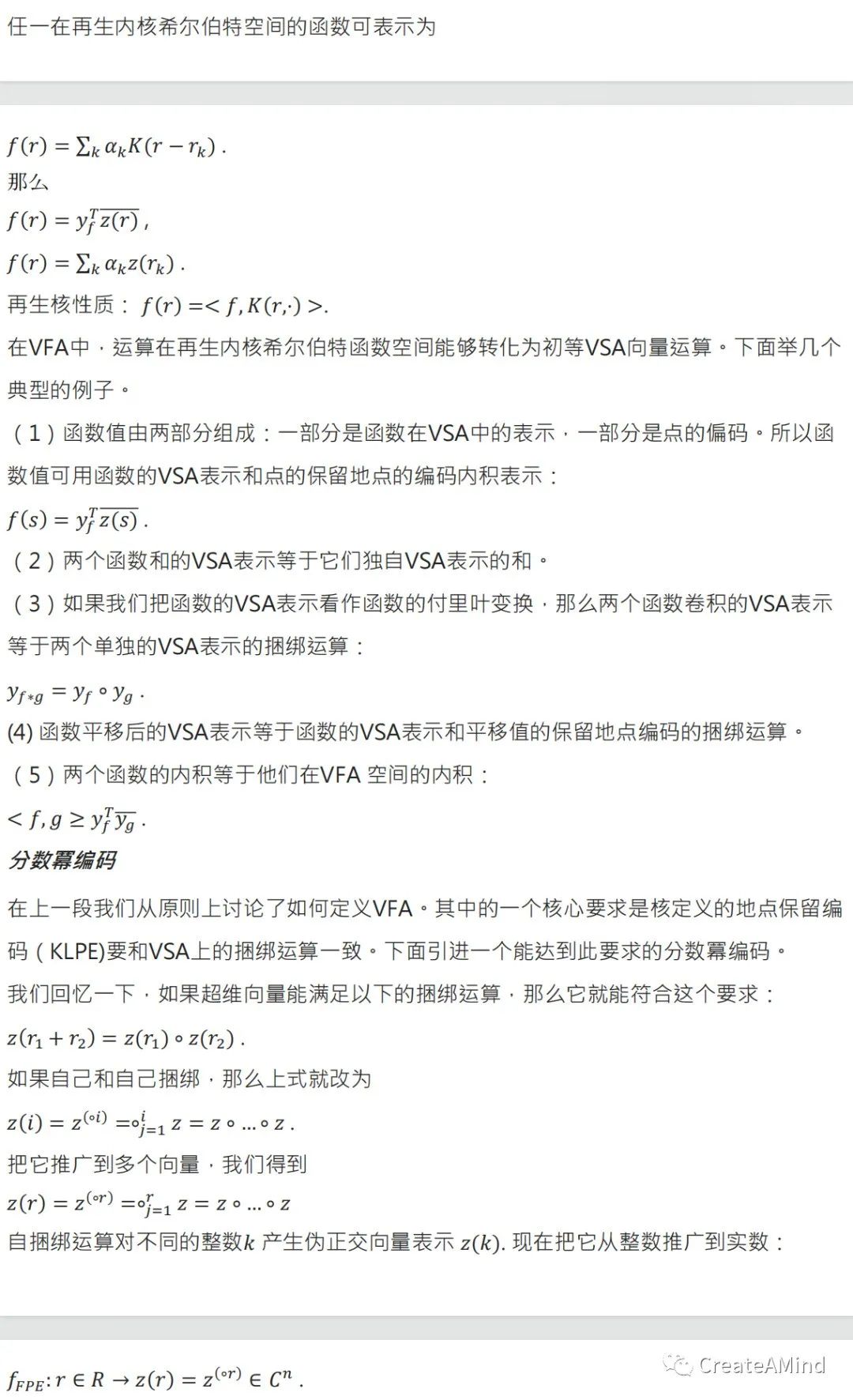

超维向量是embedding的推广

构建世界模型就是要直接输入外部世界的语言,图象,声音和视频信息。任何信息的处理都需要座标系。在欧氏空间,曾身受苦难的数学家笛卡尔建立了座标系。但语言、图象等感觉信号是在非欧氏空间观察和测量的。没有座标系。早期这些数据的处理是采用符号逻辑。符号逻辑是离散的,不能应用微积分,其运算结果也难于与欧氏空间的数值综合。

经典人工智能利用变换器等神经网络从非欧氏空间映到欧氏空间,产生embeddings。然后利用传统的在欧氏空间里工作的数学如微积分和概率统计分析embedding。得出结果后再从欧氏空间映到非欧氏空间。这样消耗了许多计算资源。

超维计算是脑科学所鼓午的数据表示和信息处理技术。从俯视的观点来看,它直接从非欧氏空间输入数据到超维空间,这个过程我们常称为编码(encoding)。然后所有的信息处理都在超维空间里进行。

超维空间的座标系和欧氏空间的座标系是不同的,有许多不同的构成方法,如二进制,二极制,整数,实数和复数等。尽管座标系种类繁多,但都要满足正交条件。这儿的正交是根据统计定义的。设x和 Y是两个超向量而形成座标。假设他们的均值为零。那么如果他们乘积的数学期望为零,那么这两个座标就是正交的。

假设维数是一万。那么可以证明,数十亿随机向量的集合中没有相似的随机向量,即他们乘积的数学期望为量。这就是常称之的测度浓缩性质。

非欧空间任何测量或观察到的量在超维空间的座标,类似于笛卡尔座标的计算,都可以通过和超维空间座标向量的内积而获取。

超维向量的运算

超维空间向量的所有运算仅加法,乘法和置换三种运算(Kanerva 2022)。超维向量相加 等于其对应向量元素的相加。结果产生了其元素为整数的超维向量。超维向量所有非零元素取它的符号函数作为值,零元素以相等概率取为正1或负1 作为其值,称为超维向量的 正则化。两个超维向量近似相等称为相似。两个超维向量的内积除以它的维数定义为它们 的余弦函数,也称之为相似度。当相似度为零,这两个向量称为正交的,或无关的。向量和相似于它的每个输入向量。

超维向量相乘等于其对应向量的元素相乘。它滿足乖法对加法的分配率。乘法可以交换顺 序。超维向量是自己的逆向量。两个超维向量各与同一向量相乘,相乘后的向量保持他们原来的相似度。乘积不与任何一个被乘元素相似。

超维向量置换运算是向量元素的循环运算,即最后的元素移到最前,依次循环移动。置换 运算是对超维向量的座标重新排序。置换是可逆的。置换满足对加法和乘法的分配率。两个向量置换后的内积保持不变。向量随机置换后的输出和它的输入不相似。

数据结构和超维向量空间的编码

我们首先讨论种子向量(或原子向量,初等向量)的表示,它是超维空间中一切变量和数值的基础。种子向量的每一个分量都是随机,独立和同分布的,依相等概率取值为1或-1 。譬如英语文字编码,每个字母由一个种子向量代表。一组种子向量形成个词汇表。差不多所有种子向量都是近似正交的。

cj =cj + Hj,ck =ck −Hj .

cj =cj + Hj,ck =ck −Hj .

3 检测:

检测集样本特征向量的编码或者说样本的超维向量与模型中分类超维向量比较,超维向量 最接近的类就是模型所预测的类。

超维向量的乘法计算和加法计算都可以通过模拟计算机来实现。该文借助于欧姆定律设计 了两个数的乘法运算,克希荷夫定律设计了两个向量的求和。从欧姆定律中我们知道,以 电压模拟一个向量,电导模拟另一个向量。电压作用在一个电阻器上产生的电流就代表了 两个数相乘或内积的计算。在以前传统的计算中,存储器和运算器是分开的。中央处理器 进行运算需要不断从存储器中读取和写入数据。数据在存储器和运算器之间的运动产生了 大量的热量,耗费了大量的时间。该文设计了运算在存儲器中。这样就进一步节省了能耗 和运算时间。改造后的计算在分类精度损失小于1%的情况下,可节省能耗255倍,时间加速28倍,而用于聚类计算,能耗节省289倍,速度增加32倍。

神经符号人工智能

人类与他所处的周围世界相互作用是结合了感知和认知两部分。感知指变换从外部环境中 获得的传感器的信号为符号,而认知是指把符号变换为知识。感知和认知两部分结合构成了人的智能使人能理解世界和干预世界。Kahneman把人的智能分为两部分:系统1 和 系统2。系统1把从外部世界所获得的知识变换为有意义的符号如词,数字和颜色。系统2 根据大恼里巳形成的概念,思维链和思维的规律,处理从系统1所获取的符号,进行推理、决策和计划。

符号是外部世界在我们头恼中所形成的潜在的概念,将借助于语言模型,视觉模型和多模 态模型把符号和外部世界联系起来,这也许就是我们常说的世界模型。推理,决策和计划是对符号的运算,这些运算可借助神经符号学习器来进行逻辑运算和推理。

下面用瑞典AbbasRahimi等五位科学家发表在《NatureMachineIntelligence》的文章 为例来介绍如何用超维向量运算和神经符号运算来结合感知和认知进行推理的。他们工作的数据是RAVEN数据集。

符号运算的困难在于这些符号和概念是具有分层结构的。无论是统计,还是现在的人工智 能都无法实现这些符号运算。如我们学生有美国学生,中国学生。美国学生又有美囯男学 生,美国女学生。中国学生又有中国男学生,中国女学生。在统计中我们常用二个二进制

变量来表达学生的囯籍和学生的性别。如x=1表示美国籍学生,x=0表示中国籍学生,y=1表示男生,y=0表示女生。我们很难用 x和 y这两个变量的复合函数(简单运 算)来表示复合概念美国男生。在人工智能中,我们常用onehot向量来表示概念。如美国男生,美国女生,中国男生,中国女生分别用(1,0,0,0),(0,1,0,0),( 0,0,1,0),(0,0,0,1)来表示,但你无法用onehot向量的复合函数来表示他

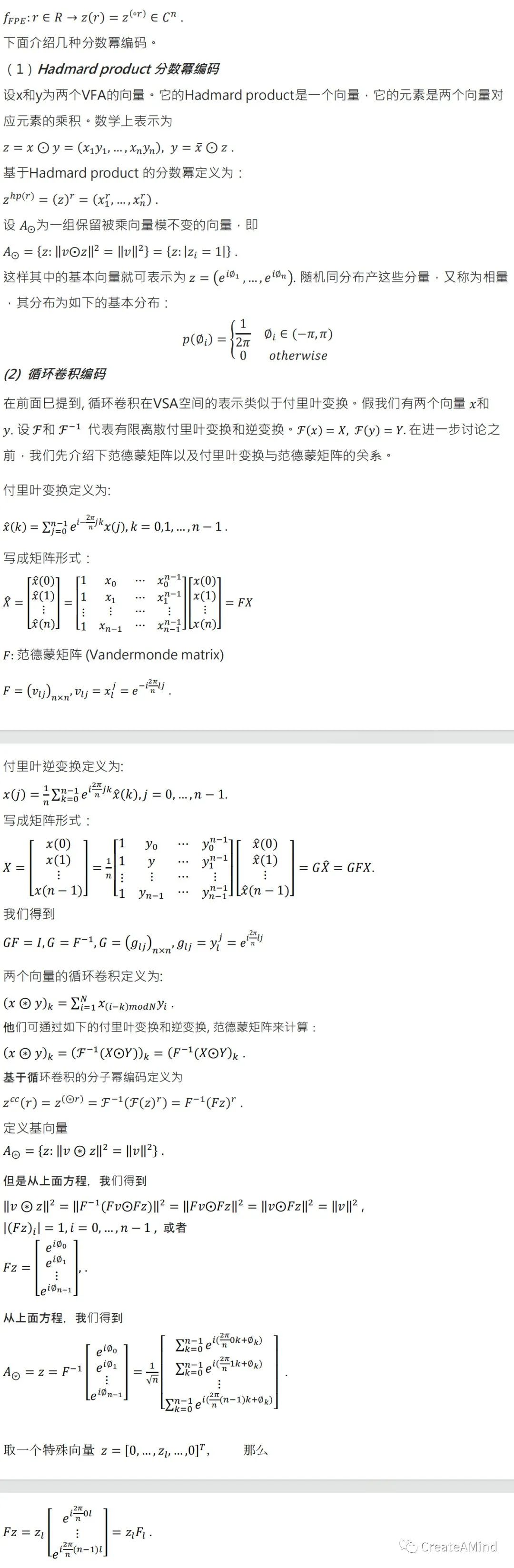

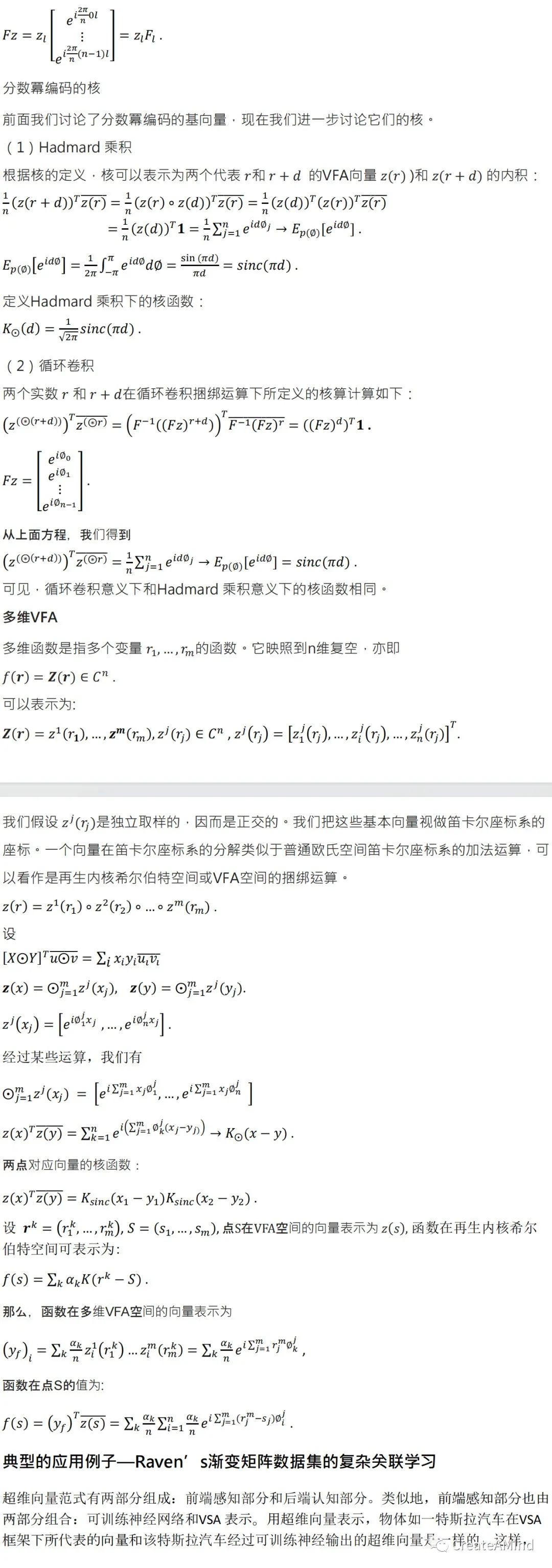

典型的应用例子—Raven’s渐变矩阵数据集的复杂关联学习

超维向量范式有两部分组成:前端感知部分和后端认知部分。类似地,前端感知部分也由

两部分组合:可训练神经网络和VSA 表示。用超维向量表示,物体如一特斯拉汽车在VSA框架下所代表的向量和该特斯拉汽车经过可训练神经输出的超维向量是一样的。这样,VSA或更一般VFA可作为表达概念,符号和外部世界的共同语言。它能把外部世界的物理 量和人大脑里的概念和符合联系为一个同样的事物。把外部世界的听觉,视觉,嗅觉等原 始的传感信号转导成具有固定长度的,嵌套的,可组合的超维VSA 表示。后端处理推理和 行动部分。它提供了有效计算,可微的,透明的,概率演译推理。后端推理有两个主要步 骤。第一一步是把前端所计算出的有关物体的位置,数值,类型,大小.和颜色等的概率 密度函数变换成适当空间的分布式VSA 表示。第二步运用VSA运算执行一阶逻辑规则,计 算每种可能规则的概率,选取和执行概率最大的规则。超维向量运算把前端和后端有机地结合起来。从感觉信号输入开始,根据建造的模型推理,进行决策,然后采取行动。

Herscheetal(2023)应用上述算法至Raven’ s 渐变矩阵数据集的复杂关联学习任务,达到平 均精度87.7%inRAVEN 和88.1%inI-RAVEN。

越是艰险越向前

最近麻省理工学院奈特科学新闻研究员 Anil Ananthaswamy 发表了一篇"一种新的计算 方法重新构想人工智能",提出超维计算, 一条超越ChatGPT ,通向一般人工智能的新道

路。一石激起千层浪, 这篇文章的发表在科学界激起了巨大的反响。

上世纪七十年代初,当我还在攀枝花钢铁公司建设工地上劳动的时候,人们就提出用模拟 电路来摸拟人类大脑的思维活动。那时称为神经形态技术。神经形态计算 Neuromorphic computing或类脑计算 Brain-inspired computing 是指使用模拟神经系统中生理结构的 原理来进行计算。近年来,脑科学成为世界各国重要研究领域之一。,受脑信息处理机制 启发的类脑计算因此成为全球前沿科研领域。所谓类脑计算,也称为神经形态计算,也没 有精确的定义。各人心目中的类恼计算也不大尽相同。但总的原则是指借鉴大脑的神经系统结构及其处理信息的基本规律及机制,在硬件实现与软件 算法等多个层面, 对现有的 计算体系与系统做出本质的变革,从而实现低能耗、速度快,所需数据少,具有高性能的计算系统。为減少数据在中央处理器和存储器之间的传输,和我们恼思维一样,类恼计算 的数字运算在存储器中进行。通过类脑神经网络模型和计算方法的建立,以及对类脑计算 、处理和存储设备技术的研究,可以开发新一代人工智 能机器以及类脑机器人等。与传 统冯诺依曼体系架构相比,类脑计算具有颠覆性创新。如果我们把云计算视为计算网络的 中心节点,神经形态计算或超维向量计算等模拟计算或数字/模拟混合计算设备,那些安

装在更靠近目标任务的计算,尤如计算机大网络的边,所以又称为边计算(edgecomputing)。计算具有低延迟、低能耗,透明性,高安全性、高可靠性、保护用户隐私等优势。它是云计算和超算的补充,也可能在将来会成为主流的计算设备。

经过五十年来的艰苦发展,神经形态技术,或更一般地超维向量计算,已经走向啇业化。

据"Neuromorphic Computing Global Market Report 2023"报导,到2030 年,神经形态计算市场即达到二百多亿美元,市场年增长率可达到21.2%。它们巳广泛使用在家用电器,健康领域的穿戴设备,机器人,无人驾驶汽车,工厂的自动化等方面。

神经形态计算和高维向量计算的研究犹如滚滚奔腾向前的长江一浪高过一浪向前发展。

IEEE 把超维向量列为今后计算机和人工智能的研究方向(https://cmte.ieee.org/futuredirections/2023/07/01/hyperdimensional-computing/)。目前超维向量计算和神经形态计算会议和短期讨论有HD/VSA

Webinars(https://www.hd-computing.com/events), Neuro-Inspired ComputingElements(NICE) Conference ,W05 Hyperdimensional Computing and Vector

Symbolic Architectures for Automation and Design in TechnologyandSystems

(https://date23.date-conference.com/workshop/w05), International conference onneuromorphic, natural and physical computing(https://nnpc-conference.com/),

Top Computer Science Conferencesin2023

(https://www.computer.org/conferences/top-computer-science-

events?gclid=EAIaIQobChMIq7apuPX1_wIVi-HjBx0i7g9EEAMYASAAEgICtvD_BwE$

the Human Brain Project Summit2023

(https://summit2023.humanbrainproject.eu/), ACM ICONS

2023(https://icons.ornl.gov/), Neuromorphic Computing(https://www.date-conference.com/node/1461)

在超维向量计算,人工智能,芯片和计算机研究方面首推的研究单位是英特尔实验室(https://www.intel.com/content/www/us/en/research/overview.html)。英特尔实验室室创建于2002年, 现有工作人员700多人,研究范围包括超维和神经形态计算,量子计算,人工智能,新型计算机结构包括从云计算作为计算网络的中心结点和速度快,能耗少,成本低,所需数据少的模拟或数/模混合的作为连结云计算中心结点的边计算(edgecomputing),芯片和网络设计,安全性和隐私保护等。英特尔试验室主任是Rich Uhlig. 他于1995年毕业于密西根大学计算机科学和工程,他曾在欧洲德国,希腊和法国的国家研 究实验室做了一年的博士后,于1996加入英特尔实验室。他曾发表20多篇技术论文,申请 了50多项专利。英特尔的神经形态计算实验室主任是Mike Davies. 他分别于1998年和2000年从加洲理工学院获得学士和硕士学位。英特尔把神经形态计算视为下一代的人工智能。英特尔为促进人工智能和神经形态计算实行开放式的研究政策,宣布了"Joint Intel and Red Hat AI Developer Program",並建立"The Intel NeuromorphicResearch Community ",己经拥有75个研究小组致力于发展神经形态计算和超维向量计算技术。网站https://intelncl.atlassian.net/wiki/spaces/INRC/pages/1784807425/Join+the+INRC提供了加入INRC的接口。英特尔还提供了许多帮助使用他的最新产品的讲座。网址是

https://intel- ncl.atlassian.net/wiki/spaces/INRC/pages/1784807425/Join+the+INRC。

现在美国大学在这领域积极研究的有 加州大学伯克利分校的Redwood 理论神经科学中心 对超维向量计算理论的研究. Redwood 神经科学研究所创立于2002年4月,是一个非营利组织(https://redwood.berkeley.edu/rni-history/),于2005年7月作为礼物赠送给加洲大学伯克利分校(https://redwood.berkeley.edu/)。该中心的宗旨是把一般数学和物理原理和神经科学数据相结合,奠定神经形态计算和超维计算的算法基础。加洲大学圣地亚哥分校,佐治亚工学院,伊利诺伊大学香槟分校, 宾洲洲立大学,哥倫比亚大学,康乃尔大学等校组成JUMP 2.0 consortium 共同推进微电子系统革命(https://www.src.org/program/jump2/)。馬里兰大学计算机系Perception & Robotics Group University of Maryland (https://prg.cs.umd.edu/)发展超维向量计算技术及在机器人的应用。

在欧洲瑞典,IBM Research Europe 有一个非常出色的超维向量计算中心,他们通过超维向量计算把感知和认知有机地结合起来,正在开辟一条通向一般人工智能的研究的道路。澳大利亚昆士倫技术大学(https://www.qut.edu.au/research/michael-milford)机器 人研究中心也开展了神经形态计算及其在汽车自动驾驶和机器人中的应用。德州大学包括 奥斯汀总校,达拉斯分校,圣东安尼分校都有神经形态计算和超维向量计算的研究中心或项目,理论研究和应用正在蓬勃地发展起来。

最近,《Nature Communication》开辟了Special Issue on “Neuromorphic Hardwarw and computing”专栏。在征求论文的告示中指出,拟神经形态计算作为克服传统的数字 计算能源和不透明的不足的另一种选择方面取得了突破性的进展。Special issue 的发表将进一步推动发展类恼鼓午下的末来计算机的理论和算法。

应该说,超维向量计算还刚刚起步,与传统的人工智能和计算机系统相比, 仅占很少的一 部分。超维向量计算形成第三代人工智能还没形成共识。它的蓬勃发展尚需时日。但是超维向量计算是人工智能发展的一个新春。它正在数据分析,计算机计算和自动化方面尝偿一条新的道路。新春开始时力量是弱小的,但它有巨大的力量,它是不可战胜的。

References

Morris, J. (2022). HYDREA:UtilizingHyperdimensionalComputingforaMore

Robust andEfficientMachineLearningSystem. ACM Transactions onEmbedded

ComputingSystems. 21:1-25.

Kanerva,P.(inpress). \Hyperdimensional Computing: An algebra for computing

with vectors";in A. Chen(ed.), AdvancesinSemiconductor Technologies;

ISBN: 9781119869580; Wiley, 2022.

HerscheM, ZeqiriM, BeniniL, Sebastian A, RahimiA. (2023).ANeuro-vector- symbolic Architecture forSolvingRaven'sProgressiveMatrices.NatureMachine

Intelligence volume5, pages363–375.

FradyEP,et al.(2021). Computing onFunctionsUsingRandomized Vector

Representations. arXiv:2109.03429.

未来智能实验室的主要工作包括:建立AI智能系统智商评测体系,开展世界人工智能智商评测;开展互联网(城市)大脑研究计划,构建互联网(城市)大脑技术和企业图谱,为提升企业,行业与城市的智能水平服务。每日推荐范围未来科技发展趋势的学习型文章。目前线上平台已收藏上千篇精华前沿科技文章和报告。

如果您对实验室的研究感兴趣,欢迎加入未来智能实验室线上平台。扫描以下二维码或点击本文左下角“阅读原文”

2445

2445

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?