1、逻辑回归

本着学习的原则,搜集了各方面的资料来进行一下逻辑回归的总结。首先说下什么是逻辑回归,逻辑回归和线性回归一样,都是回归中常见的算法。那么什么是回归呢,它和分类有什么区别呢?逻辑回归是分类还是回归呢?首先说下什么是回归,比如有在二维平面上一系列的点,例如(x1,y1),(x2,y2)..等等,然后让你从这些点中拟合一条曲线,然后通过拟合的曲线来计算未知的数据,比如再给你一个x,你就能很好的预测y的值。而分类和回归的区别在于输出变量的类型,定性的输出变量,即连续性变量预测称为回归,定量的输出变量,即离散变量预测称为分类。举个例子,比如,预测明天的天气是多少度这就是回归,预测明天是晴天还是阴天就是分类。那么,逻辑回归是分类还是回归问题呢,通过下面的理解其实逻辑回归是一个分类问题。

2、逻辑回归的定义以及形式

定义:

其中,![]() 为位置参数,

为位置参数,![]() > 0 为形状参数。

> 0 为形状参数。

可以通过其图像观察:

右边的逻辑斯蒂分布函数以点![]() 中心对称,即满足:

中心对称,即满足:

形状参数![]() 越小,曲线在中心的增长速度越快。

越小,曲线在中心的增长速度越快。

2.1 二项逻辑回归模型

二项逻辑回归模型是一种分类模型。它由条件分布概率P(Y|X)表示,随机变量X取值为实数,随机变量Y取值为1或者0.

二项逻辑回归模型的分布:

其中,exp为以e为底的指数函数,x∈Rn是输入,y∈{0,1}输出,w,b是模型参数——w是权值向量,b称作偏置,w·x是向量内积。

通过比较x=0和x=1下的概率就可以将实例x进行分类。为了更方便的表示,我们可以把权值向量和输入向量加以扩充,仍记作w和x,即

w=(w(1),w(2),…w(n),b)T,x=(x(1),…x(n),1)T

这时,逻辑回归模型如下:

我们知道一个事件的几率(odds)是发生概率和不发生概率的比值,若发生的概率为p,那么发生的几率就为p/1-p,则该事件的对数几率为

结合上述两个公式可得:

那么,为什么要引入这种形式呢?因为我们只需要知道w和输入值x,就可以知道Y=1发生的概率。所以,当线性函数的值越接近正无穷,那么

概率值就越接近1,线性函数的值越接近负无穷,概率值就越接近0,如上面的图所示。

讲到这个地方,可能大家对于逻辑回归并没有比较形象化的理解。比如你要去买一个房子,然后你心中有心仪的房子的类型,窗户大,价格,

地理位置等等这些因素,这些因素当作x1,x2,x3,然后你为它们设置了三个权值w1,w2,w3,那么,w1x1+w2x2+w3x3加权和就是总共的得分

,你可以根据这个得分情况的大小来决定购买哪栋房子。

上面说了那么多,逻辑回归和线性回归的区别在于,逻辑回归把输出空间压缩到0到1的范围,我们可以简单的理解为,大于0.5的我们就认为

正确分类,小于0.5的属于错误分类。

3、模型参数估计

上面我们讲到了我们只需要知道w的值便可以估算某个x的概率。那么w怎么估计呢,什么情况下w的取值才能拟合出比较好的直线呢,那么

我么可以使用极大似然估计法来估计参数模型,然后再得到逻辑回归模型。我们设:

似然函数为:

似然函数为什么是这个样子呢,因为当y=1时,后面一项为1,而当Y=0时前面一项为1,所以以此来表示(x,y)出现的概率。

对数似然函数为

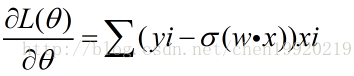

对L(w)求极大值,得到w的估计值,此时我们对上式θ求偏导,可得到

你令上式等于0发现无法解析此式子,那么我们可以优化目标,常采用的方法有梯度下降法和拟牛顿法。

4、梯度下降法

此节单独讲解

7882

7882

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?