机器学习中常见的一些优化算法的总结,以最直接的方式理解。

注:梯度下降法图片来自Rachel-Zhang的博客

机器学习常见的优化算法

不是所有的方程都具有解析解,因此可采用优化的方法寻找其最有解,在机器学习中常见的算法有梯度下降法、牛顿法和拉格朗日对偶性。

1、梯度下降法

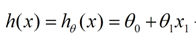

具有一阶连续的偏导数的目标函数,以Andrew Ng老师的课件简要说明。采用线性回归算法来说明,回归函数为:

目标函数和优化条件

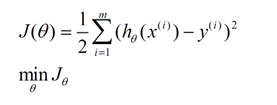

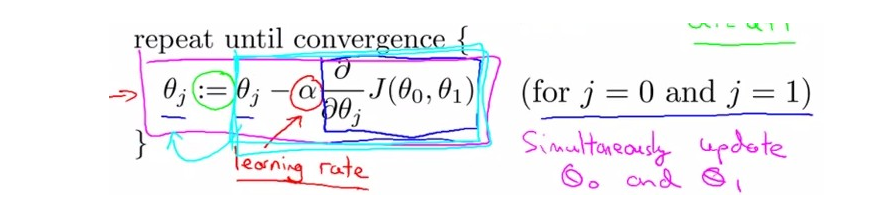

让参数沿着梯度下降的方向走,并迭代地不断减小J(theta0,theta1),达到稳定状态。

初始化theta0,theta1,然后根据梯度下降的方向优化目标值theta0和theta1,使代价函数逐渐收敛到一定的值,一般是指代价函数的偏导数小于某一个值。

本文介绍了机器学习中常用的优化算法,包括梯度下降法及其在线性回归中的应用,强调了学习率的重要性。此外,还提及了牛顿法作为另一种优化策略。内容参考了Andrew Ng的课件及多个技术博客。

本文介绍了机器学习中常用的优化算法,包括梯度下降法及其在线性回归中的应用,强调了学习率的重要性。此外,还提及了牛顿法作为另一种优化策略。内容参考了Andrew Ng的课件及多个技术博客。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4352

4352

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?