21个项目玩转深度学习之MNIST数字识别

通过两层的卷积网络进行训练卷积神经网络

# coding: utf-8

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

def weight_variable(shape):

initial = tf.truncated_normal(shape, stddev=0.1)

return tf.Variable(initial)

def bias_variable(shape):

initial = tf.constant(0.1, shape = shape)

return tf.Variable(initial)

def conv2d(x, w):

return tf.nn.conv2d(x, w, strides=[1, 1, 1, 1], padding='SAME')

def max_pool_2x2(x):

return tf.nn.max_pool(x, ksize=[1, 2, 2, 1], strides=[1, 2, 2, 1], padding='SAME')

if __name__ == '__main__':

mnist = input_data.read_data_sets("F:/path/to/MNIST_data/", one_hot=True)

x = tf.placeholder(tf.float32, [None, 784])

y_ = tf.placeholder(tf.float32, [None, 10])

x_image = tf.reshape(x, [-1, 28, 28, 1])

w_conv1 = weight_variable([5, 5, 1, 32])

b_conv1 = weight_variable([32])

h_conv1 = tf.nn.relu(conv2d(x_image, w_conv1) + b_conv1)

h_pool1 = max_pool_2x2(h_conv1)

w_conv2 = weight_variable([5, 5, 32, 64])

b_conv2 = weight_variable([64])

h_conv2 = tf.nn.relu(conv2d(h_pool1, w_conv2) + b_conv2)

h_pool2 = max_pool_2x2(h_conv2)

w_fc1 = weight_variable([7 * 7 * 64, 1024])

b_fc1 = weight_variable([1024])

h_pool2_flat = tf.reshape(h_pool2, [-1, 7 * 7 * 64])

h_fc1 = tf.nn.relu(tf.matmul(h_pool2_flat, w_fc1) + b_fc1)

keep_prob = tf.placeholder(tf.float32)

h_fc1_drop = tf.nn.dropout(h_fc1, keep_prob)

w_fc2 = weight_variable([1024, 10])

b_fc2 = bias_variable([10])

y_conv = tf.matmul(h_fc1_drop, w_fc2) + b_fc2

cross_entropy = tf.reduce_mean(tf.nn.softmax_cross_entropy_with_logits(labels=y_ , logits=y_conv))

train_step = tf.train.AdamOptimizer(1e-4).minimize(cross_entropy)

correct_prediction = tf.equal(tf.argmax(y_conv, 1), tf.argmax(y_, 1))

accuary = tf.reduce_mean(tf.cast(correct_prediction, tf.float32))

sess = tf.InteractiveSession()

sess.run(tf.global_variables_initializer())

for i in range(20000):

batch = mnist.train.next_batch(50)

if i % 100 == 0:

train_accuary = accuary.eval(feed_dict = {x:batch[0], y_:batch[1], keep_prob:0.5})

print("step %s : accuary %g"%(i, train_accuary))

train_step.run(feed_dict = {x:batch[0], y_:batch[1], keep_prob:0.5})

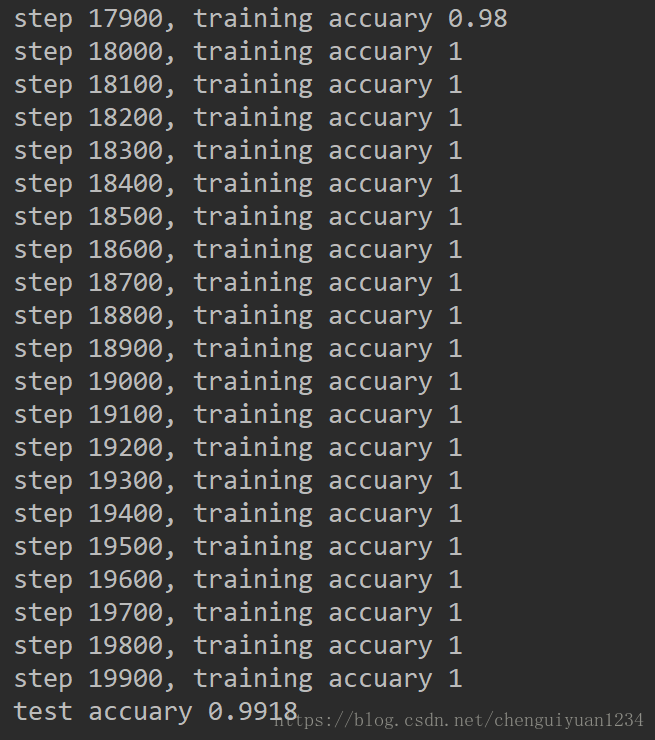

print("test accuary %g" % accuary.eval(feed_dict = {x:mnist.test.images, y_:mnist.test.labels, keep_prob:1.0}))运行结果:得到0.9918的准确率

出现的问题

1、无法成功下载mnist数据集

解决方案:from tensorflow.examples.tutorials.mnist import input_data

mnist = input_data.read_data_sets(“F:/path/to/MNIST_data/”, one_hot=True)

思考的问题

1、第63行代码实时用于计算训练准确率的为什么要设置drop的参数keep_prob为1.0

答:drop主要用于防止过拟合,效果是使输入tensor中某些元素变为0,其它没变0的元素变为原来的1/keep_prob大小。第63行代码设置的keep_prob为1.0,最后的效果是没有改变任何数据,所以这个操作是多余的。

函数介绍

tf.truncated_normal(shape, mean=0.0, stddev=1.0, dtype=tf.float32, seed=None, name=None)

功能:生成的值具有指定平均值和标准差的正态分布

tf.nn.conv2d(input, filter, strides, padding, use_cudnn_on_gpu=None, name=None)

input:输入图片,格式为[batch,长,宽,通道数],长和宽比较好理解,batch就是一批训练数据有多少张照片,通道数实际上是输入图片的三维矩阵的深度,如果是普通灰度照片,通道数就是1,如果是RGB彩色照片,通道数就是3,当然这个通道数完全可以自己设计。

filter:就是卷积核,其格式为[长,宽,输入通道数,输出通道数],其中长和宽指的是本次卷积计算的卷积核的规格,输入通道数应当和input的通道数一致,输出通道数可以随意指定。

strides:是步长,一般情况下的格式为[1,长上步长,宽上步长,1],所谓步长就是指卷积核每次在长和宽上滑动多少会停下来计算一次卷积。这个步长不一定要能够被输入图片的长和宽整除。

padding:是卷积核在边缘处的处理方法。

tf.nn.max_pool(value, ksize, strides, padding, name=None)

最大值池化操作

参数是四个,和卷积很类似:

第一个参数value:需要池化的输入,一般池化层接在卷积层后面,所以输入通常是feature map,依然是[batch, height, width, channels]这样的shape

第二个参数ksize:池化窗口的大小,取一个四维向量,一般是[1, height, width, 1],因为我们不想在batch和channels上做池化,所以这两个维度设为了1

第三个参数strides:和卷积类似,窗口在每一个维度上滑动的步长,一般也是[1, stride,stride, 1]

第四个参数padding:和卷积类似,可以取’VALID’ 或者’SAME’

返回一个Tensor,类型不变,shape仍然是[batch, height, width, channels]这种形式

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?