Devika 是一位高级 AI 软件工程师,可以理解高级人类指令,将它们分解为步骤,研究相关信息,并编写代码以实现给定的目标。Devika 利用大型语言模型、规划和推理算法以及 Web 浏览能力来智能开发软件。

Devika 旨在通过提供 AI 对程序员来彻底改变我们构建软件的方式,该程序员可以在最少的人工指导下承担复杂的编码任务。无论您是需要创建新功能、修复错误还是从头开始开发整个项目,Devika 都能为您提供帮助。

本地化部署Devika请参考如下步骤:

1、安装python包管理器

curl -LsSf https://astral.sh/uv/install.sh | sh

#To add ~/.cargo/bin to your PATH: 安装时已添加,所以直接执行下面语句

source ~/.cargo/env2、安装JavaScript运行时:

curl -fsSL https://bun.sh/install | bash

#"在 ~/.bashrc添加 ~/.bun/bin:$PATH "安装时已添加,所以直接执行下面语句

source ~/.bashrc3、安装ollama

curl -fsSL https://ollama.com/install.sh | sh如果提示缺少unzip,请安装它:

apt install unzip4、创建虚拟环境并激活

uv venv # 创建虚拟环境

source .venv/bin/activate #激活虚拟环境5、安装devika

#克隆代码库

git clone https://github.com/stitionai/devika.git

cd devika/

#安装必要的依赖

uv pip install -r requirements.txt6、启动 Devika 后台服务器

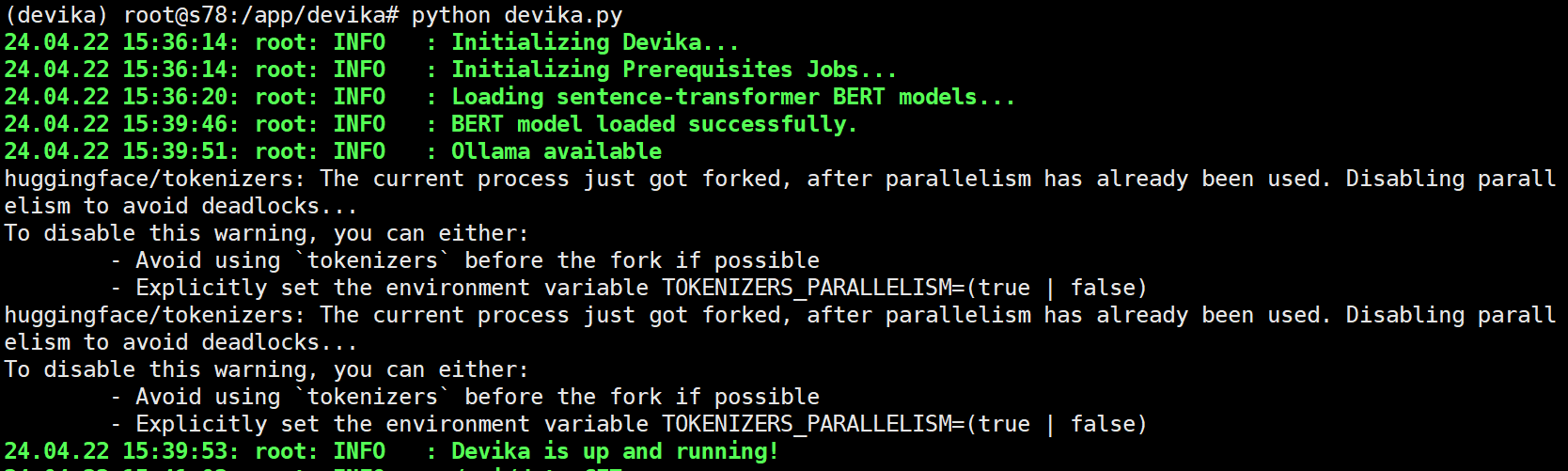

python devika.py #运行后台

启动时会从huggingface下载相关模型文件,如果网络不能访问,请使用科学上网方法下载相关模型至/root/.cache/huggingface!

也可以直接到我的百度网盘下载:DevikarootcacheMiniLM-L6-v2模型下载资源-CSDN文库

使用方法:是解开tar包,然后拷贝覆盖原路径即可。

7、运行前台UI

cd ui/

bun install

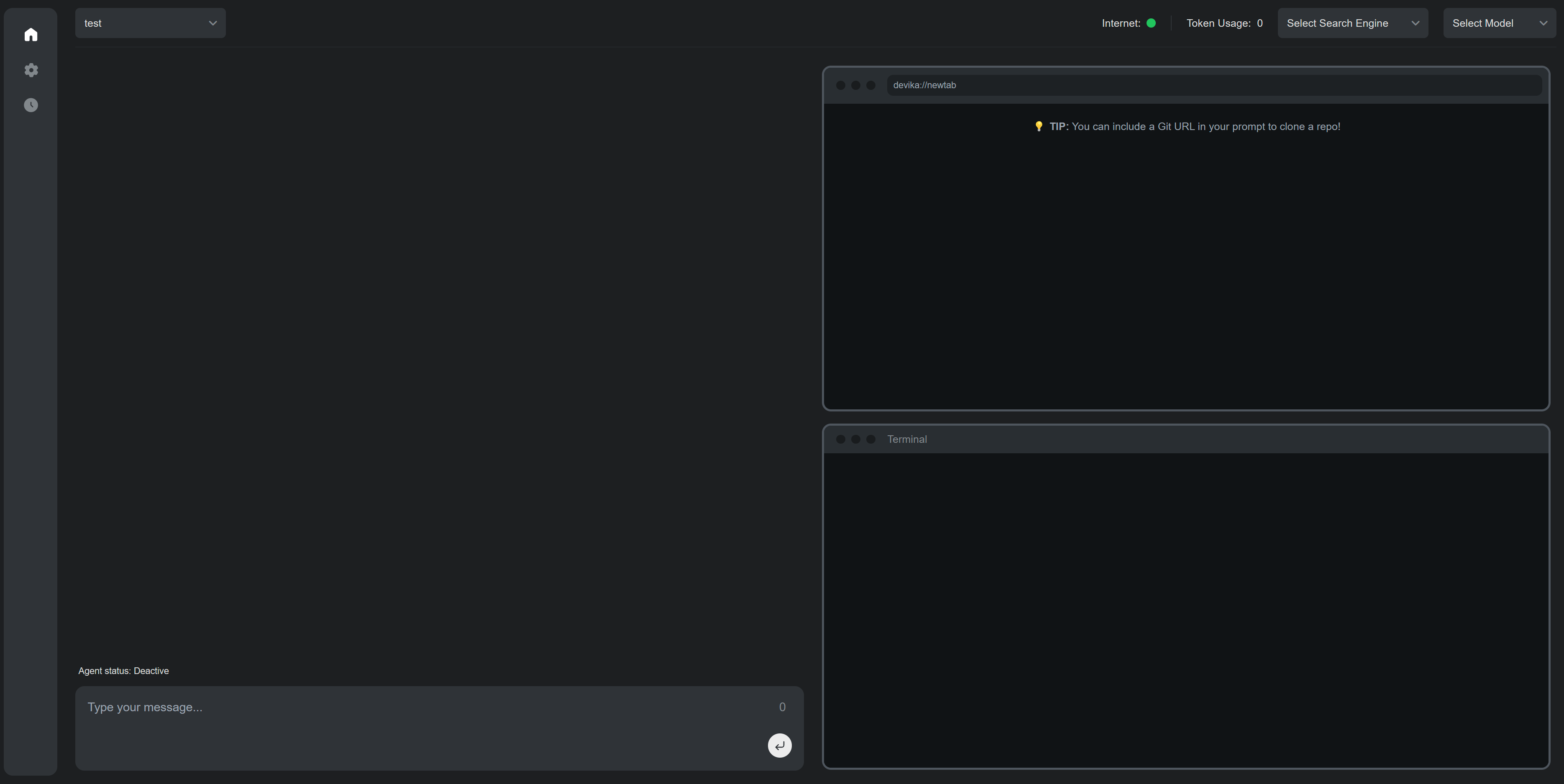

bun run start #运行前台8、运行

打开浏览器运行下面指令,即可使用 。

#本机运行

http://127.0.0.1:3000

#指定输出IP

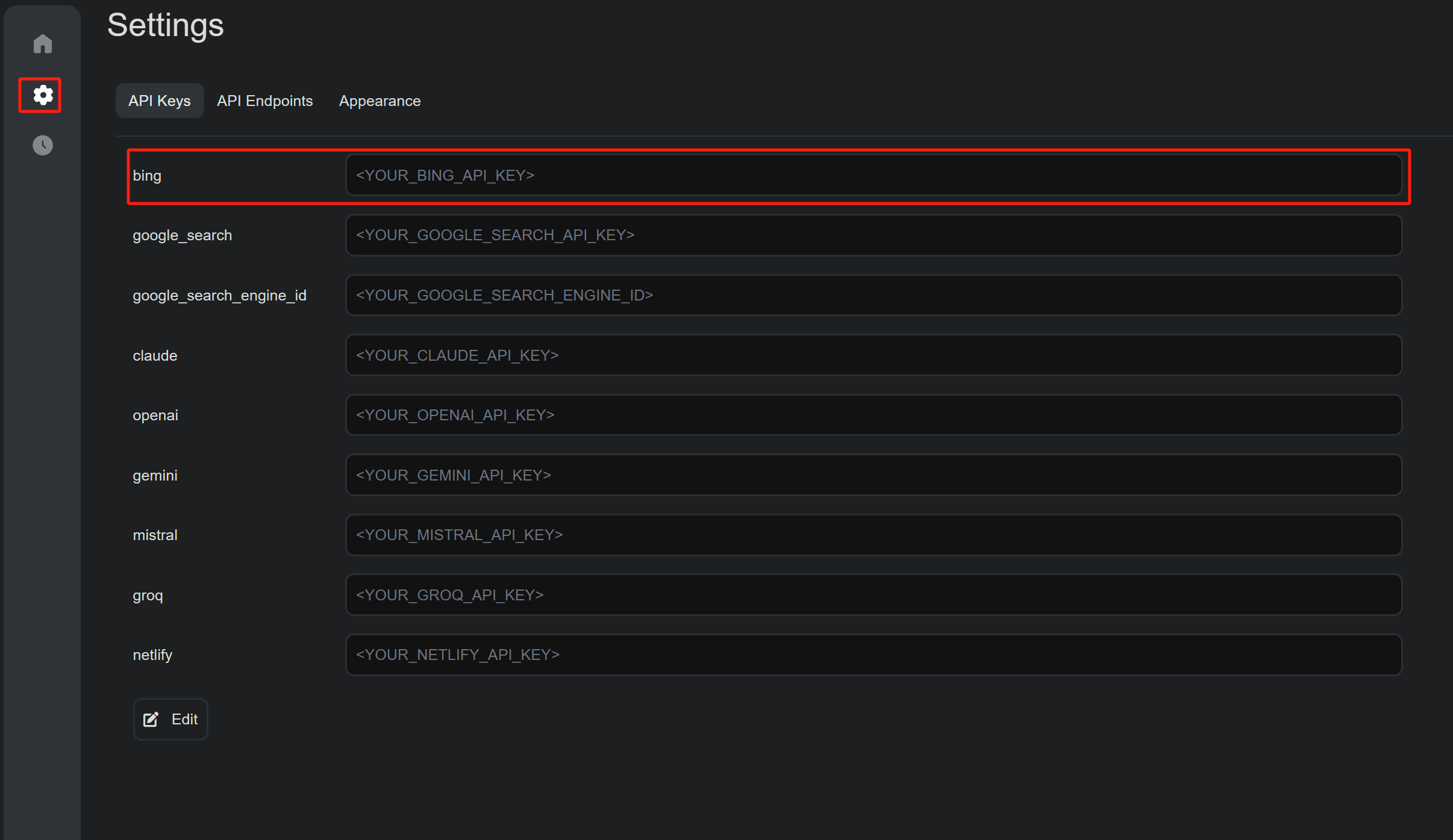

bun run start --host 192.168.29.789、配置BING和LLM

在API Keys里面需要申请BING的API Key,你可以去微软申请必应的Key。

配置信息会记录在项目根目录的:config.toml文件中,当然也可以直接在此文件中修改。

OPENAI_API_KEY:用于访问 GPT 模型的 OpenAI API 密钥。

CLAUDE_API_KEY:用于访问 Claude 模型的 Anthropic API 密钥。

BING_API_KEY:用于 Web 搜索功能的必应搜索 API 密钥。

DATABASE_URL:数据库连接的 URL。

LOG_DIRECTORY:存储 Devika 日志的目录。

PROJECT_DIRECTORY:存储 Devika 项目的目录。

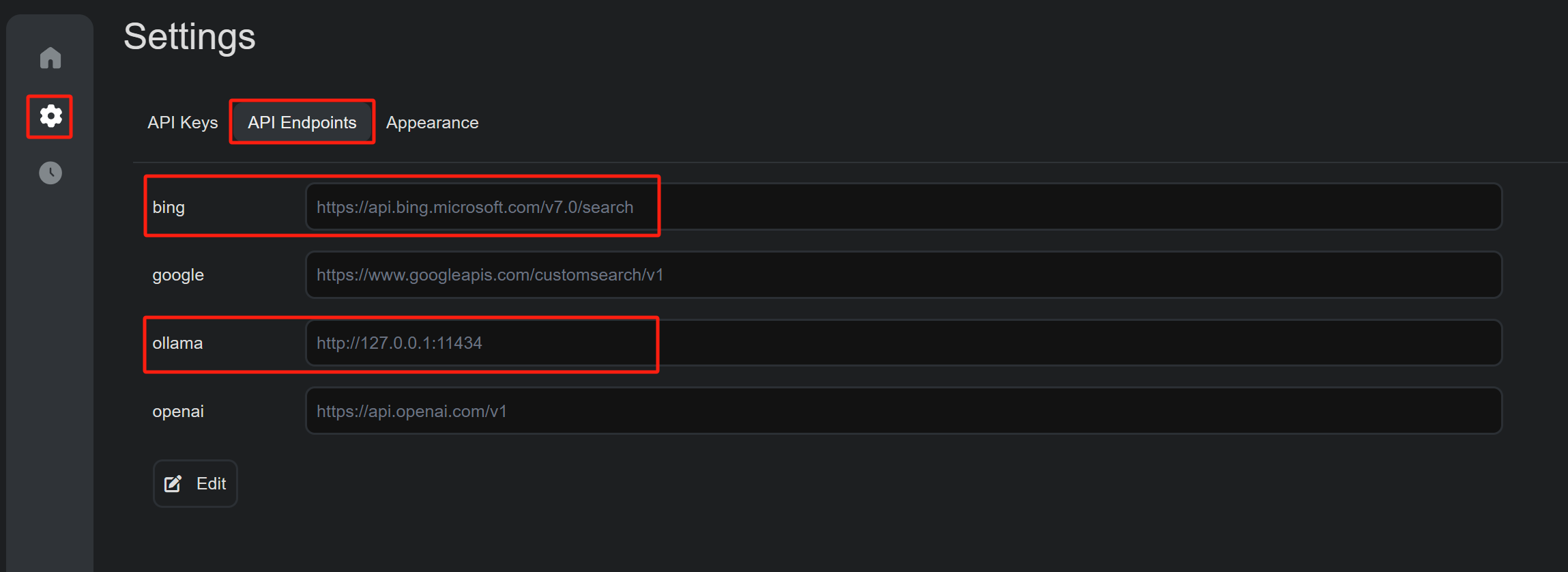

在API Endpoints里面,填写ollama的访问地址。

高级AI工程师Devika通过智能开发软件,提供AI支持,帮助程序员高效处理复杂编码任务。本文详述了Devika的本地化部署步骤,包括安装Python、JavaScript、ollama,创建虚拟环境,以及配置API和BING搜索。

高级AI工程师Devika通过智能开发软件,提供AI支持,帮助程序员高效处理复杂编码任务。本文详述了Devika的本地化部署步骤,包括安装Python、JavaScript、ollama,创建虚拟环境,以及配置API和BING搜索。

1609

1609

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?