概述

本文复现论文 “Zero-Shot” Super-Resolution using Deep Internal Learning[1] 提出的图像超分辨率方法。

图像超分辨率是指从低分辨率图像恢复高分辨率图像的过程,是计算机视觉和图像处理中的一类重要技术。它在实际应用中有广泛的用途。随着深度学习的发展,超分辨率方法的性能取得了巨大飞跃。然而,由于这些超分辨率方法大多是有监督的,因此它们受限于特定的训练数据,其中低分辨率图像是从其高分辨率对应图像中预先获得的。然而,真实的低分辨率图像很少遵循这些限制,导致最先进方法在真实应用场景中性能不佳。

图1:超分辨率示意图

该论文介绍了一种“零样本”图像超分辨率方法,利用单张图像内部信息的重复性训练小型卷积神经网络。该方法可以针对不同的图像进行自适应调整,这使得其能够对真实图像或获取方式未知的图像进行高清化处理。

代码以及视频讲解

本文所涉及所有资源均在传知代码平台可获取

算法原理

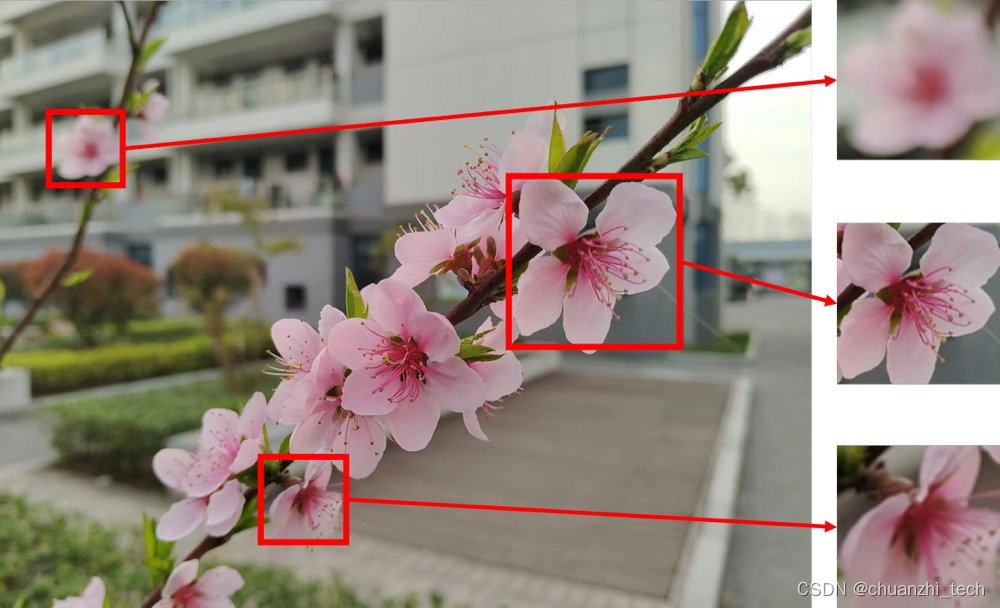

论文提出的方法基于自然图像中强大的内部数据重复性。如图2所示,小图像块会在单张图像内部反复出现,不仅在同一尺度内出现,也在不同尺度之间重复出现。

图2:相似图像块的重复

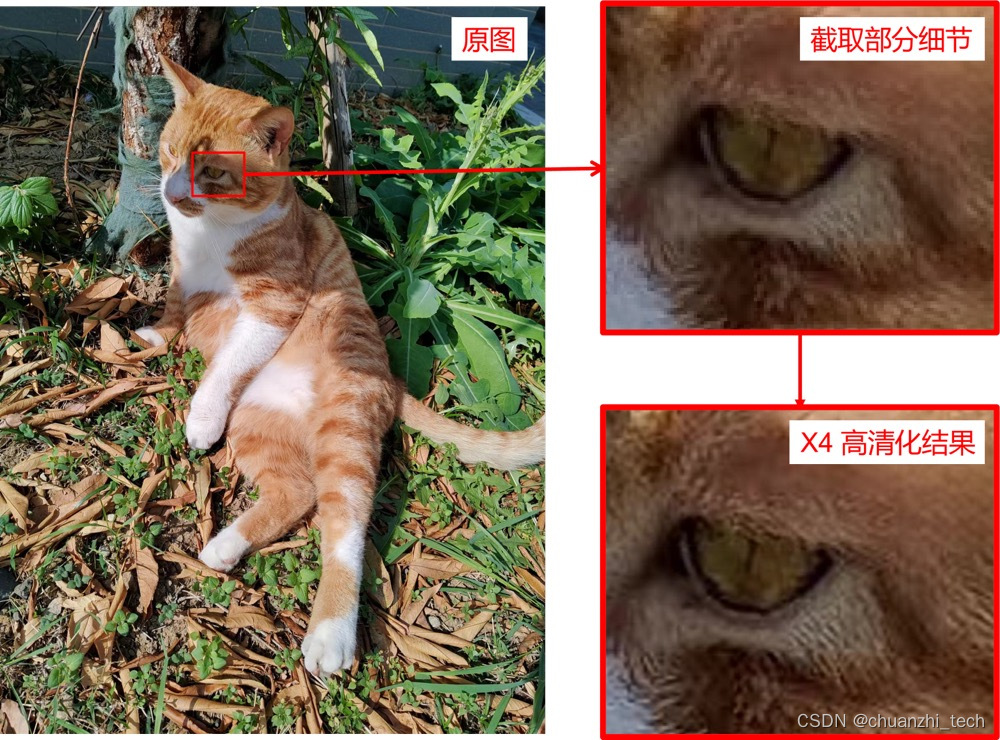

论文提出的方法将图像的内部数据重复性与深度学习的泛化能力结合起来。给定一个测试图像,在没有外部样本可供训练时,可以训练一个小型神经网络,专门用于解决该图像的超分辨率任务。具体地,该方法从测试图像本身提取样本来训练小型卷积神经网络。这些样本是通过对低分辨率图像进行降采样来生成自身的更低分辨率版本获得的。然后,该方法将这些下采样图像作为输入,将原图作为目标,训练网络重建高分辨率图像的能力。图3展示了一张小猫躺在落叶堆上的图像,利用论文所提出的方法对该图像进行超分辨率操作后,图像的细节部分变得更清晰了,即原本模糊的毛发变得更加细腻。

图3:超分辨率方法结果

由于训练集仅包含一个实例,该方法对该图像进行数据增强。具体地,该方法通过将原图旋转不同角度以提取更多的样本来进行训练。为了加速训练,该方法在每次迭代时,从随机选择的样本对中随机裁剪固定大小的随机区域。为了增加方法的稳健性,以及在非常小的低分辨率图像上也能实现较大的放大效果。该方法将希望的放大倍率

s

s

s 分解成多个更小且等大的放大倍率:

s

=

∏

i

=

1

k

s

i

,

s

1

=

s

2

=

.

.

.

=

s

k

s=\prod_{i=1}^k s_i,~s_1=s_2=...=s_k

s=i=1∏ksi, s1=s2=...=sk

该方法使用的卷积神经网络包含 8 个隐藏层,每层有 64 个通道,并使用 ReLU 激活函数。此外,网络的输入被事先插值到输出大小。该网络只学习插值后的低分辨率图像与其高分辨率父图像之间的残差。训练过程使用 L1 损失函数和 ADAM 优化器。初始学习率为0.001。该方法还会定期对重建误差进行线性拟合,如果标准偏差比线性拟合的斜率大一个因子,就将学习率除以10。当学习率降低到

1

0

−

6

10^{-6}

10−6 时,停止训练。

核心逻辑

具体的核心逻辑如下所示:

def super_resolution(input_image, configs, show_process=False):

# 参数读取

in_channels = configs['in_channels']

model_width = configs['model_width']

model_depth = configs['model_depth']

model_kernel_size = configs['model_kernel_size']

lr = configs['lr']

lr_stop = configs['lr_stop']

lr_decay = configs['lr_decay']

lr_decay_ratio = configs['lr_decay_ratio']

lr_decay_range = configs['lr_decay_range']

lr_decay_step = configs['lr_decay_range']

num_epochs = configs['num_epochs']

crop_size = configs['crop_size']

patch_size = configs['patch_size']

scale_factor = configs['scale_factor']

scale_times = configs['scale_times']

# 将图像转为float32张量

init_transforms = v2.Compose([

v2.ToImage(),

v2.ToDtype(torch.float32, scale=True)

])

input_image = init_transforms(input_image).unsqueeze(0)

# 若图像过小则返回原图像

height = input_image.shape[2]

width = input_image.shape[3]

if height < 3 or width < 3:

output_image = input_image.squeeze(0).permute(1, 2, 0)

output_image = (torch.clamp(output_image, min=0, max=1) * 255).to(torch.uint8).cpu().numpy()

output_image = Image.fromarray(output_image)

return output_image

crop_size = min(height, width, crop_size)

crop = v2.RandomCrop([crop_size, crop_size])

# 获取不同角度的输入图像

images = [[]]

for degree in [0, 90, 180, 270]:

rotated = v2.functional.rotate(input_image, angle = degree, expand=True)

rotated_flipped = v2.functional.horizontal_flip(rotated)

images[0].append(rotated)

images[0].append(rotated_flipped)

# 获取不同缩放程度的图像

for scale_time in range(scale_times):

images.append([])

for image in images[scale_time]:

height = image.shape[2]

width = image.shape[3]

resized = v2.functional.resize(image, [int(height / scale_factor), int(width / scale_factor)])

resized = v2.functional.resize(resized, [height, width])

images[scale_time + 1].append(resized)

# 计算采样概率

props = np.array([scale_factor ** (2 * scale_time) for scale_time in range(scale_times)], dtype=np.float32)

props = props / np.sum(props)

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

model = SimpleConvNet(in_channels, model_width, model_depth, model_kernel_size).to(device)

criterion = nn.L1Loss()

optimizer = optim.Adam(model.parameters(), lr=lr)

lr_scheduler = StepLR(optimizer, step_size=1, gamma=lr_decay)

model.train()

current_lr = lr

unchanged_epoch = 0

loss_epoch = []

if show_process:

epochs = tqdm(range(num_epochs), desc='Training')

else:

epochs = range(num_epochs)

for epoch in epochs:

# 随机抽取训练样例

scale_time = np.random.choice(list(range(len(props))), p=props)

transfer_id = rd.randint(0, 7)

HR_image = images[scale_time][transfer_id]

LR_image = images[scale_time + 1][transfer_id]

cropped_images = crop(torch.cat([HR_image, LR_image], dim=0))

cropped_HR_image = cropped_images[0: 1].to(device)

cropped_LR_image = cropped_images[1: 2].to(device)

# 计算梯度并更新模型参数

optimizer.zero_grad()

outputs = model(cropped_LR_image)

loss = criterion(outputs, cropped_HR_image)

loss.backward()

optimizer.step()

loss_epoch.append(loss.item())

unchanged_epoch += 1

# 检查损失并判断是否降低学习率

if unchanged_epoch >= lr_decay_step and (epoch + 1) % lr_decay_step == 0:

loss_range = np.array(loss_epoch[-min(lr_decay_range, len(loss_epoch)):])

epoch_range = np.array(list(range(len(loss_range))))

slope, interept = np.polyfit(loss_range, epoch_range, 1)

loss_std = np.sqrt(np.var(loss_range - (slope * epoch_range + interept)))

if loss_std > -slope * lr_decay_ratio:

lr_scheduler.step()

unchanged_epoch = 0

current_lr = optimizer.param_groups[0]['lr']

# 学习率低于最小值则停止训练

if current_lr < lr_stop:

break

if show_process:

print(f'Loss: {np.mean(loss_epoch[-100:])}')

model.eval()

# 对原图执行超分辨率

with torch.no_grad():

height = input_image.shape[2]

width = input_image.shape[3]

for scale_time in range(scale_times):

# 将输入图像拆解成一系列小尺寸图像

input_image = v2.functional.resize(input_image, [height * scale_factor, width * scale_factor])

height = input_image.shape[2]

width = input_image.shape[3]

pad_h = (patch_size - (height % patch_size)) % patch_size

pad_w = (patch_size - (width % patch_size)) % patch_size

padding = (0, pad_w, 0, pad_h)

input_image = F.pad(input_image, padding, mode='reflect')

patches = split_image(input_image, patch_size)

output_patches = []

if show_process:

batches = tqdm(range(patches.size(2)), desc=f'Infering {scale_time + 1}/{scale_times}')

else:

batches = range(patches.size(2))

# 依次对小尺寸图像执行超分辨率

for i in batches:

output_patches.append([])

for j in range(patches.size(3)):

patch = patches[:, :, i, j, :, :].to(device)

output_patch = model(patch)

output_patches[i].append(output_patch)

# 融合超分辨率小尺寸图像

output_patches = torch.stack([torch.stack(output_patches[i], dim=2) for i in range(patches.size(2))], dim=2)

output_image = merge_patches(output_patches)

output_image = output_image[:, :, :height, :width]

input_image = output_image

output_image = output_image.squeeze(0).permute(1, 2, 0)

output_image = (torch.clamp(output_image, min=0, max=1) * 255).to(torch.uint8).cpu().numpy()

output_image = Image.fromarray(output_image)

return output_image

以上代码仅作展示,更详细的代码文件请参见附件。

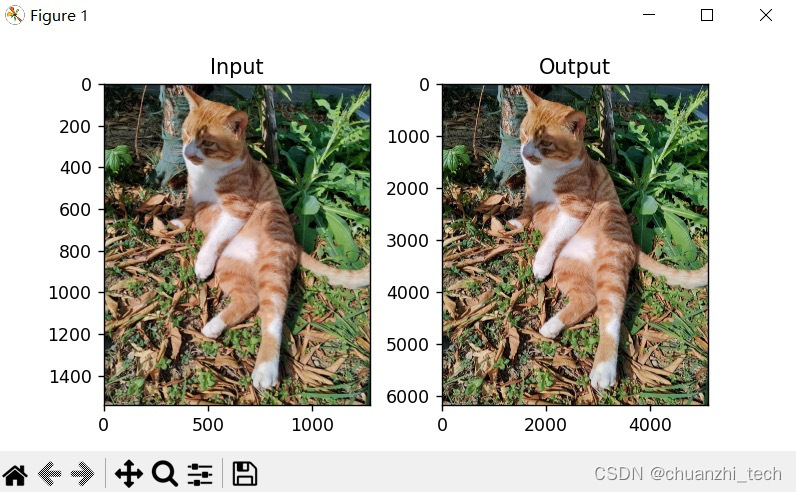

效果演示

配置环境并运行 main.py脚本,效果图4所示。由图4可见,图像的长宽均被放大四倍。观察图3可以发现细节部分变得更加清晰了。

图4:程序运行结果

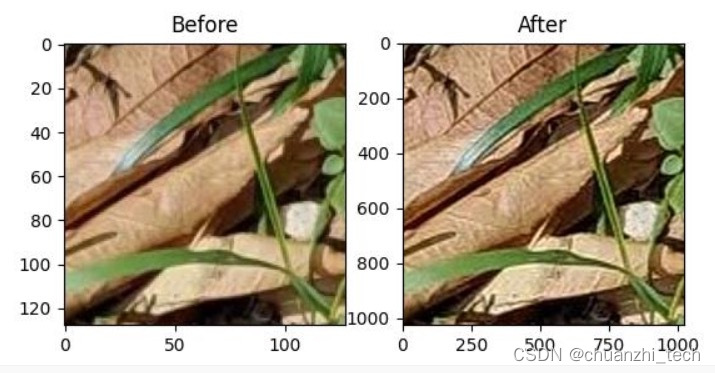

此外,网站还提供了在线体验功能。用户只需要输入一张大小不超过 1MB 的 JPG 图像,网站就会随机截取图像的一部分并放大8倍。在线体验的效果如图5所示,经观察可以发现图片在被放大的同时,细节变得更加丰富了。

图5:在线体验结果

使用方式

- 解压附件压缩包并进入工作目录。如果是Linux系统,请使用如下命令:

unzip image_super_resolution.zip

cd image_super_resolution

- 代码的运行环境可通过如下命令进行配置:

pip install -r requirements.txt

- 如果希望在本地运行程序,请运行如下命令:

python main.py

- 如果希望在线部署,请运行如下命令:

python main-flask.py

- 如果希望使用自己的文件路径或改动其他实验设置,请在文件

config.json中修改对应参数。以下是参数含义对照表:

| 参数名 | 含义 |

|---|---|

| max_MB | 输入图像文件大小限制(以 MB 为单位) |

| base64 | 是否将输出转码为 base64 格式 |

| image | 输入图像路径 |

| output | 输出图像路径 |

| in_channels | 输入图像通道数 |

| model_width | 网络宽度 |

| model_depth | 网络深度 |

| model_kernel_size | 网络卷积核大小 |

| lr | 初始学习率 |

| lr_stop | 停止训练时学习率 |

| lr_decay | 学习率衰减率 |

| lr_decay_ratio | 学习率衰减因子 |

| lr_decay_range | 学习率衰减参考范围 |

| lr_decay_step | 学习率衰减检查间隔 |

| num_epochs | 最大迭代次数 |

| crop_size | 训练时输入图像截取大小 |

| patch_size | 测试时输入图像截取大小 |

| scale_factor | 放大率 |

| scale_times | 放大次数 |

(以上内容皆为原创,请勿转载)

参考文献

[1] Shocher A, Cohen N, Irani M. “zero-shot” super-resolution using deep internal learning[C]//Proceedings of the IEEE conference on computer vision and pattern recognition. 2018: 3118-3126.

详细复现过程的项目源码、数据和预训练好的模型可从该文章下方附件获取。

679

679

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?