https://www.bilibili.com/video/av42021445/?p=6

卷积的过程就是特征提取的过程。

机器翻译,聊天机器人,情感分类和语义搜索

例子:将英文翻译成德文,就是利用的多层次递归神经网络 sequence to sequence

需要:编码器+解码器 谷歌2017年提出来的

深度学习在自然语言处理的步骤:

1)论文的阅读,最新算法的研究

自然语言处理最顶级:ACL

2)算法的大概方向的评估和确定(比如聊天机器人很早就提出来了)

A问题相似度评估

B情景相似度评估:

递归神经网络用在NLP比较多(条件随机场,获取上下文),卷积神经网络用在图像处理比较多

但是 眼睛总是在鼻子上的,那么处理图像时就可以利用条件随机场进行迁移

C语言是否可切换

3)数据收集,清洗和数据预处理

网络数据:可以爬虫获取

GAN生成:生成对抗网络收集数据

4)算法实现(代码),系统设计,参数调优,模型升级(有新样本了)

5)模型评估

![]()

https://github.com/fxsjy/jieba

# encoding=utf-8

import jieba

seg_list = jieba.cut("我来到北京清华大学", cut_all=True)

print("Full Mode: " + "/ ".join(seg_list)) # 全模式

seg_list = jieba.cut("我来到北京清华大学", cut_all=False)

print("Default Mode: " + "/ ".join(seg_list)) # 精确模式

seg_list = jieba.cut("他来到了网易杭研大厦") # 默认是精确模式

print(", ".join(seg_list))

seg_list = jieba.cut_for_search("小明硕士毕业于中国科学院计算所,后在日本京都大学深造") # 搜索引擎模式

print(", ".join(seg_list))type(seg_list) 是一个生成器“generator“ 好处是 内存大小都可以运行

generator 可以用不同的东西join起来 用空格或者斜杠/ 将句子分开

语句:

“ ”.join(seg_list)

"/".join(seg_list)

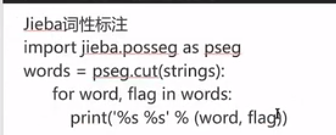

除了分词以外,还有词性识别

7661

7661

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?