一、XPath简介

XPath即为XML路径语言(XMLPathLanguage),它是一种用来确定XML文档中某部分位置的语言。XPath被开发者用来当作小型查询语言,基于XML的树状结构,用于定位元素节点、属性节点、文本节点,提供在数据结构树中找寻节点的能力。

二、安装lxml库

直接输入以下命令进行安装

pip install lxml

但是一般这样安装可能会出现很多问题,可以采用以下的方法进行解决:

1.下载并安装whl安装包

从http://www.lfd.uci.edu/~gohlke/pythonlibs/#lxml下载与系统位数(32位或64位)、Python版本对应的whl安装包,比如我的python就是3.7的版本,操作系统是64位,那我可以下载lxml‑4.6.3‑cp37‑cp37m‑win_amd64.whl的版本,大家根据自己的版本来进行下载,比如我下载到D盘的根目录下,可以输入以下命令进行安装:

pip install d:\lxml‑4.6.3‑cp37‑cp37m‑win_amd64.whl

2.安装Anaconda的python发行版本

ananconda默认会安装lxml,可以从官网中下载与本地操作系统位数匹配的安装包。下载完成后安装即可。

三、xpath语法基础

首先从lxml中导入etree模块

from lxml import etree

html='''<ul class="clearfix lavalamp">

<div class="lavalamp-object" id="nav">第一个div</div>

<li class="navitem-index current"><a href="/index">首页</a></li>

<li class="lavalamp-item"><a href="/guonei">国内</a></li>

<li class="lavalamp-item"><a href="/guoji">国际</a></li>

<li class="lavalamp-item"><a href="/mil">军事</a></li>

<li class="lavalamp-item"><a href="/finance">财经</a></li>

<li class="lavalamp-item"><a href="/ent">娱乐</a></li>

<li class="lavalamp-item"><a href="/sports">体育</a></li>

</ul>'''

首先初始化

selector=etree.fromstring(html)

常用的Xpath路径表达式的属性含义如下:

| 属性 | 描述 | 实例 |

|---|---|---|

| 标签名 | 获取当前标签下的所有节点 | ul |

| / | 从根节点选取 | /ul,选取根路径下的ul |

| // | 从任意位置选取 | //a,选取所有的a标签 |

| . | 选取当前节点 | |

| … | 选取当前节点的父节点 | |

| @ | 属性 | //a/@href,选取所有a标签的href属性 |

如果要查找所有的li标签,可以使用/从根ul开始查找,然后查找所有的li

all_li=selector.xpath("/ul/li")

for li in all_li:

print(li)

结果:

<Element li at 0x16f4e9a0448>

<Element li at 0x16f4e9a0488>

<Element li at 0x16f4e9a04c8>

<Element li at 0x16f4e9a0508>

<Element li at 0x16f4e9a0548>

<Element li at 0x16f4e9a05c8>

<Element li at 0x16f4e9a0608>

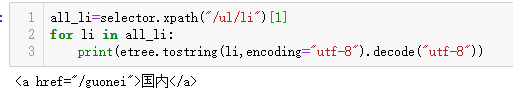

打印出来的结果为7行Element Li对象,么法晓得获取的内容,那我们可以使用etree.tostring方法打印输出的结果,同时必须使用decode(“utf-8”)解码,否则中文乱码

all_li=selector.xpath("/ul/li")

for li in all_li:

print(etree.tostring(li,encoding="utf-8").decode("utf-8"))

获取所有的li标签可以不使用’/‘从根节点开始查找,直接用’//'获取所有的li节点

all_li=selector.xpath("//li")

for li in all_li:

print(etree.tostring(li,encoding="utf-8").decode("utf-8"))

提取所有的li标签下a标签的href属性,可以使用@获取属性

all_href=selector.xpath("//a/@href")

print(all_href)

需要提取第一个li下的A标签,可以通过索引来控制。需要注意的是索引是从1开始。//li[1]代表选取任意位置li种的第一个

first_li=selector.xpath("//li[1]/a")[0]

print(etree.tostring(first_li,encoding="utf-8").decode("utf-8"))

获取文本内容。需要获取第三个li下a标签中的内容“国际”两个字,可以通过text()来进行获取。

a_text=selector.xpath("//li[3]/a/text()")

print(a_text)

四、通过属性查找元素

使用属性查找元素,一般格式为标签名[@属性名=‘属性值’]。也可以使用通配符 * ,代表任意标签,格式为*[@属性名=‘属性值’]。

#通过属性id查找元素

nav_text=selector.xpath("//div[@id='nav']/text()")

print(nav_text)

#通过使用CSS选择器class来进行定位

lavalamp_text=selector.xpath("//li[@class='lavalamp-item']/a/text()")

print(lavalamp_text)

结果:['国内', '国际', '军事', '财经', '娱乐', '体育']

第一个li中引用了两个类,但在使用Xpath表达式时必须当成一个整体,不能引用部分的class名

navitem=selector.xpath("//li[@class='navitem-index current']/a/text()")

print(navitem)

结果:['首页']

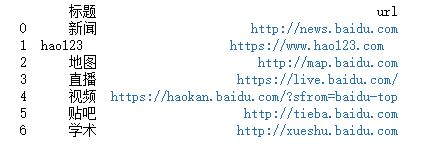

基础练习

from lxml import etree

import requests

import pandas as pd

try:

url = "http://www.baidu.com"

headers={

"User-Agent":"Mozilla/5.0 Chrome/77.0.3865.90 Safari/537.36"

}

r = requests.get(url,headers=headers) # 发送请求,获取响应

r.encoding = r.apparent_encoding # 从内容中分析出的响应内容编码方式

r.raise_for_status() # 发出请求后返回的状态码(正常为200)

R = r.text

selector = etree.HTML(R)

title_list=[]

href_list=[]

for i in range(0,7):

a = selector.xpath("//*[@id='s-top-left']/a")#获取id为s-top-left的标签下所有的a标签

title_list.append(a[i].xpath("text()")[0])#获取内容标题

href_list.append(a[i].xpath("@href")[0])#获取内容链接

df=pd.DataFrame({'标题':title_list,'url':href_list})

print(df)

except Exception as error:

print(error)

673

673

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?