Markov decision process(MDP)

要素

1、Sets(集合)

states

S

Action

A(s)

Reward

R(s,a)

2、Probability distribution

- 当前在s 执行a 跳到s’的概率是多少

p(s’|s,a) - 当前在s take action a 得到r(reward)的概率是多少

p(r|s,a)

3、Policy

当前在s 有一个策略 会告诉我采取action a的概率是多少

π(a|s)

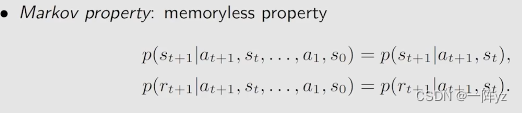

4、Markov property

和历史无关的性质

-开始的状态是s0 采取了一个action a1 慢慢走到 st 采取 a t+1 下一个状态s t+1的概率等于?

-等于 不考虑历史 现在是st 执行a t+1 到s t+1

(r同理)

有无历史的概率是一样的

394

394

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?