本文来源公众号“我爱计算机视觉”,仅用于学术分享,侵权删,干货满满。

原文链接:2025 TPAMI综述 | 全新视角红外与可见光图像融合完整理解与入门!附GitHub最全开源对比方法结果!

论文信息

标题:Infrared and Visible Image Fusion: From Data Compatibility to Task Adaption

作者:Jinyuan Liu, Guanyao Wu, Zhu Liu, Di Wang, Zhiying Jiang, Long Ma, Wei Zhong, Xin Fan, Risheng Liu

机构:大连理工大学

原文链接:

https://ieeexplore.ieee.org/abstract/document/10812907

Git仓库链接:

https://github.com/RollingPlain/IVIF_ZOO

可以直接检索论文标题 或IVIF_ZOO直达

1. 引言简介

红外-可见光图像融合(IVIF)是计算机视觉领域的一个基础性关键的任务,旨在将红外和可见光光谱的独特特征集成到整体表示中。

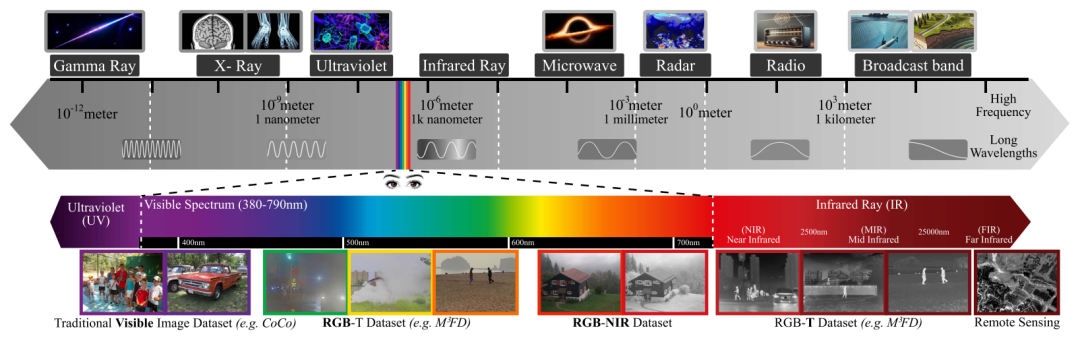

图1 详细的光谱图,展示了几乎所有波长和频率范围,并标注了可见光范围和对应的IVIF图像数据集。

将一对红外图像和可见光图像进行融合,这一过程称为红外-可见光图像融合,是计算机视觉领域的一个基础性关键的任务,融合图像具有

1)增强信息表达能力;

2)抑制噪声引起的干扰等优势,可以更好地支持诸如遥感、军事监视和自动驾驶等广泛的实际应用。

自 2018 年以来,IVIF方法获得了长足的发展。相比传统方法,这些基于学习的解决方案在视觉质量、鲁棒性和计算效率方面表现更好,因此受到越来越多的关注。然而现有的调查大多数专注于综述传统的或基于学习的IVIF方法,并没有从多个方面(数据、融合和任务)对IVIF进行研究。

2. 本文主要贡献

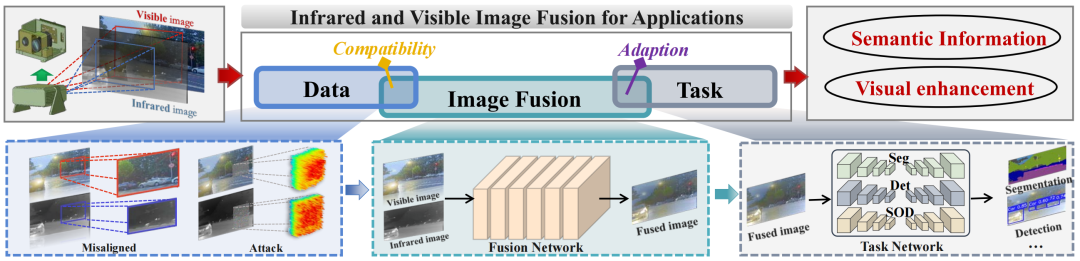

图2 面向实际应用的红外与可见光图像融合流程图。

我们的综述采用了更全面的视角,细致审查了多个关键因素。并且们强调了初步数据兼容性和后续任务的关键作用,这对于IVIF的实际应用至关重要。本研究的主要贡献有四个方面:

-

1)本综述首次从多维视角(数据、融合与任务)出发,统一理解并系统组织了基于学习的红外与可见光图像融合方法。整理了180多个基于学习的方法。

-

2)我们针对每个视角进行了深入讨论,包括最近采用的架构和损失函数。同时,讨论了代表性方法的核心思想,为后续的研究人员提供便利。

-

3)为了阐明面向应用的红外与可见光图像融合方法,我们用分层和结构化的方式系统地概述了技术层面和数据集的最新进展。

-

4)我们首次比较了初步配准和后续任务(如目标检测和语义分割)的融合性能。

3. 全新的分类方法

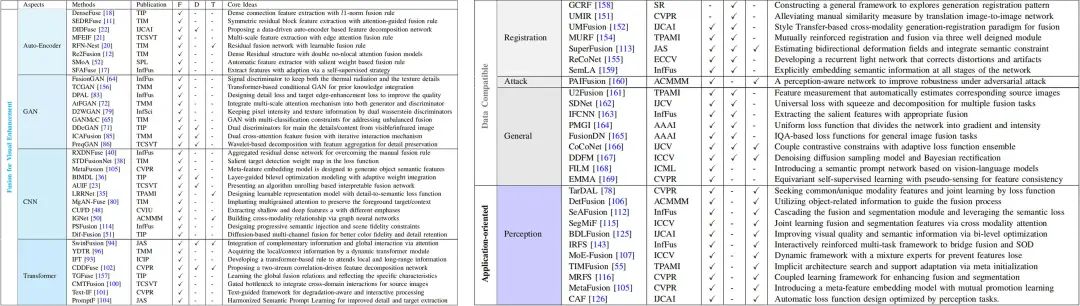

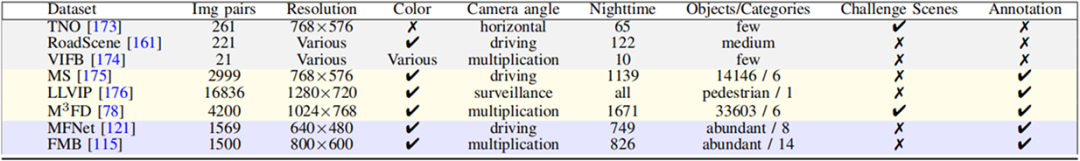

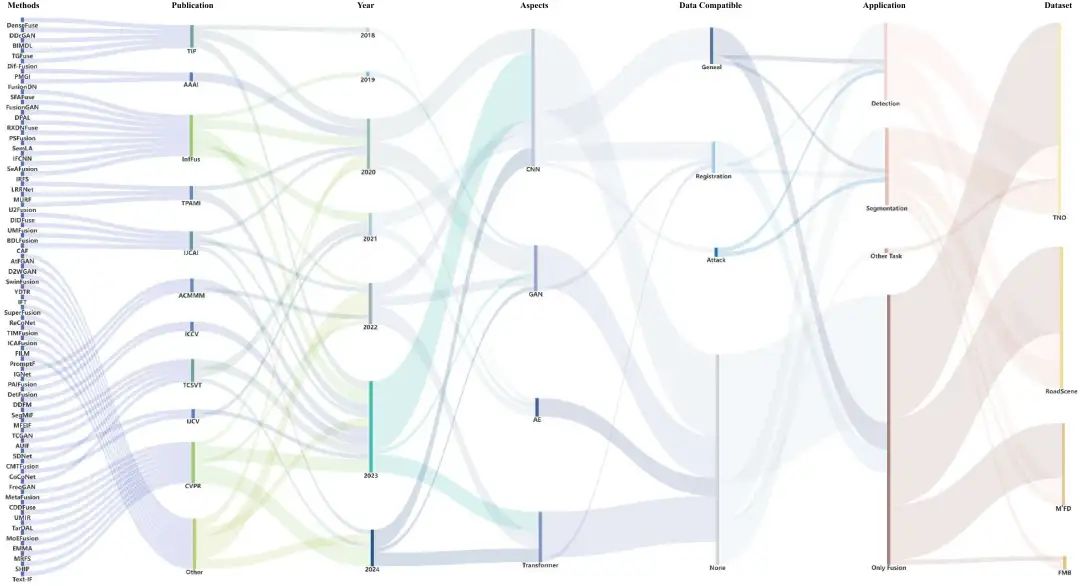

图3 文中关键方法分类图表整合 详细大图请参考原文

为了更直观地梳理红外与可见光图像融合领域的研究脉络,文章中的关键图表进行了整合。文内包含方法汇总大表格:按类别整理了已有方法,涵盖代表模型、特征处理方式、融合策略等关键信息,一目了然地展示了当前研究热点与发展趋势。数据集概览表:罗列并比较了该领域主流数据集,包含采集方式、模态类型、任务适用性等,为研究选型和复现提供参考依据。桑基图:可视化展示了不同方法与任务之间的流向关系,帮助读者理解各类方法的适用场景。

我们总体上将IVIF分为三类,并且在文章中进行了详细的说明:

A:用于视觉增强的融合:提升融合图像的视觉效果,让图像所呈现的信息更加清晰、全面。

基于自编码器(AE)的方法:先预训练 AE,再用其编码器提取特征、解码器重建图像,融合方式有手动规则或二次训练。现有方法可分为改进融合规则和数据集成、创新网络架构两类。

基于卷积神经网络(CNN)的方法:包含特征提取、融合、重建三步。创新点在基于优化、修改损失函数和架构改进。

基于生成对抗网络(GAN)的方法:分为单重判别和双重判别。单重判别易导致模态不平衡,双重判别旨在解决此问题,但面临引导判别器提取多样模态特征的挑战。

基于 Transformer 的方法:结合 CNN 和 Transformer,利用自注意力机制,但计算资源需求大。

B:面向应用的融合:在实际高级视觉任务中具有广泛的应用场景

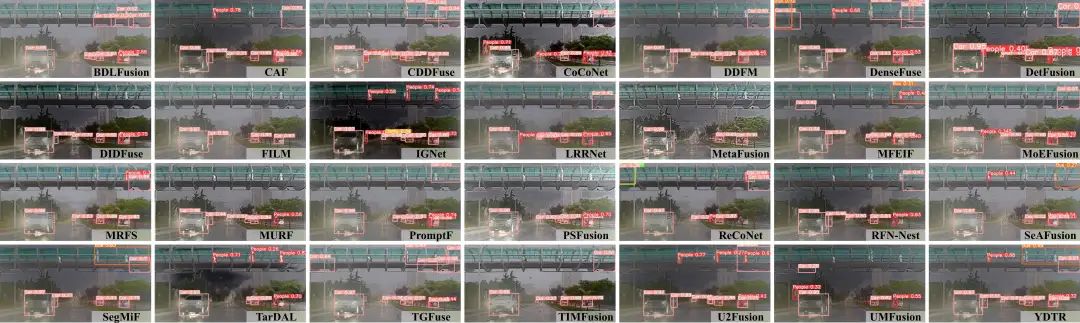

目标检测:有的方法通过双层优化等手段结合图像融合与目标检测;也有直接用红外和可见光图像检测的方法,通过多种机制增强精度。

语义分割:包括级联融合与分割任务、提出多功能框架、引入渐进式语义注入等方法。

其他感知任务:在目标跟踪、人群计数、显著目标检测、深度估计等方面,多模态融合都起到重要作用。

C:数据兼容融合:解决数据兼容性问题的相关方法。

免配准方法:分为伪标签生成(基于风格迁移)和构建模态无关特征空间(基于潜在空间)两类,用于解决配准问题。

通用融合方法:它能够有效整合不同的成像技术,有着优秀的算法通用性和可拓展性,潜力巨大。

对抗攻击:在图像中添加微小且不可察觉的扰动,干扰神经网络的估计结果。

4. 全面评价和总结

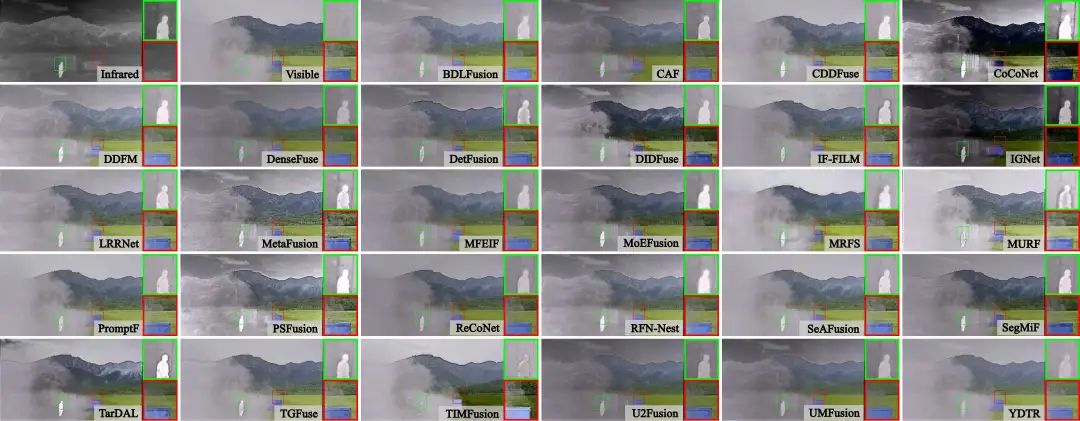

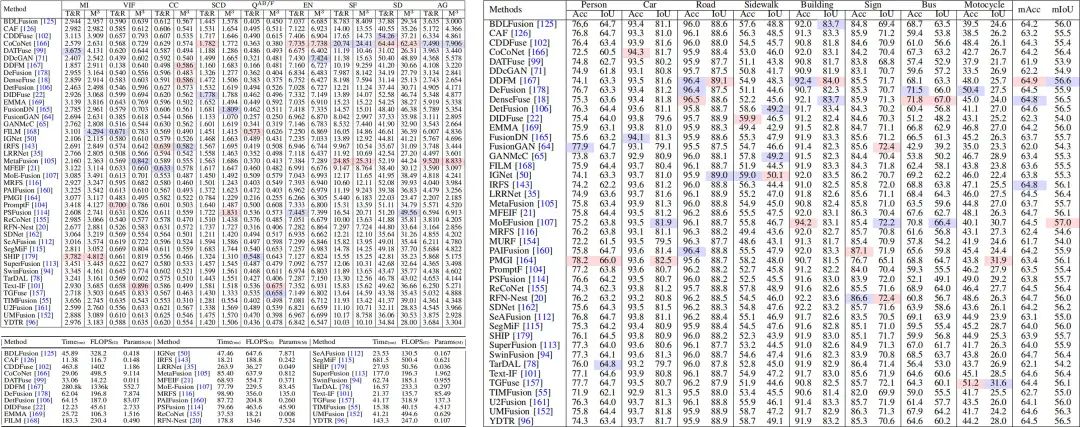

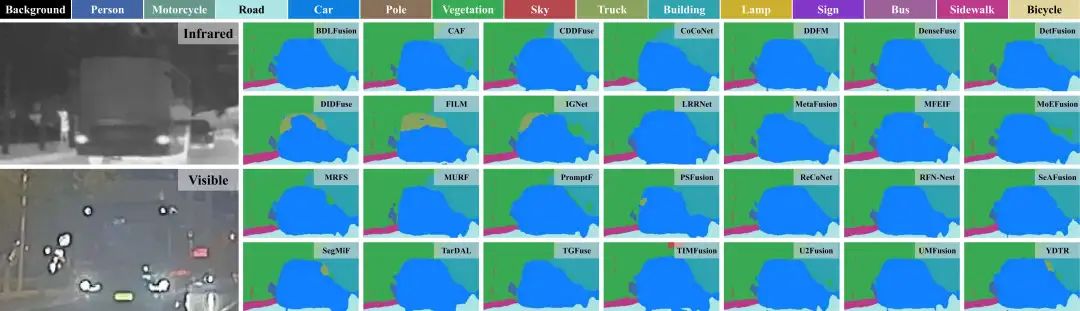

我们不仅对大量的IVIF方法进行了分类,还对这些方法进行了极为全面的评价,包括配准、融合及其他后续下游操作等任务的定性和定量结果,并进行了计算复杂度分析。

在评价中,我们针对分类法中不同的融合方法选用多个数据集,并将各个方法的性能进行对比,得出全面的性能总结。

图4 文中关键对比结果图表整合 详细大图、大表请参考原文

这些旨在为红外与可见光图像融合领域的研究人员,工程师和爱好者提供一个核心库,促进红外-可见图像融合技术的进步和协作。

所有的结果,包括基准数据集、评价指标和定性定量结果都已开源至我们的Git仓库IVIF_ZOO中:

5. 未来趋势分析

目前基于学习的IVIF方法获得了长足的发展。但仍存在几个关键问题,需要未来的研究加以关注。

A.处理错位/攻击数据

图像融合网络在复杂对抗情境下的鲁棒性,仍然是一个重大挑战。

B.开发基准

高质量的基准对于IVIF研究至关重要,尽管已经出现了许多相关的数据集,满足了一定的需要,但是仍有三大紧迫问题需要关注。

-

1)创建红外和可见光图像配准基准至关重要,因为现有基准主要关注像素对齐的图像对。

-

2)扩展IVIF基准以包含各种高层次任务。

-

3)探索多样化的挑战性场景。

C.更有效的评价指标

传统的指标如EN、MI、CC和SCD各自仅衡量图像质量的一个方面,且可能与主观评价不一致,特别是在高噪声水平等条件下。因此,这些指标单独使用无法全面捕捉图像融合质量的本质。

D.轻量化设计

大多数现有设备(如无人机(UAV)和手持设备)无法支持重型GPU的计算需求,这需要探索更高效且资源占用更少的网络架构。

E.多任务结合

IVIF 作为一种基本的图像增强技术,无疑可以提升、辅助或结合其他视觉任务。如高级场景分析、深度估计与三维重建等。

6. 结语

红外与可见光图像融合,正站在从理论研究走向实际应用的关键十字路口。本综述不仅系统梳理了当前主流方法与数据集,也首次从“数据-融合-任务”的完整链路出发,搭建起了一个统一的研究框架。我们希望这份工作,能为研究者提供参考,为工程实践者带来启发,也为未来的发展方向提供一些思路。欢迎关注本文的 GitHub 项目,共同完善红外与可见光融合技术的知识地图!

THE END !

文章结束,感谢阅读。您的点赞,收藏,评论是我继续更新的动力。大家有推荐的公众号可以评论区留言,共同学习,一起进步。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?