2.3 残差网络 - 2

Residual Networks (ResNets)

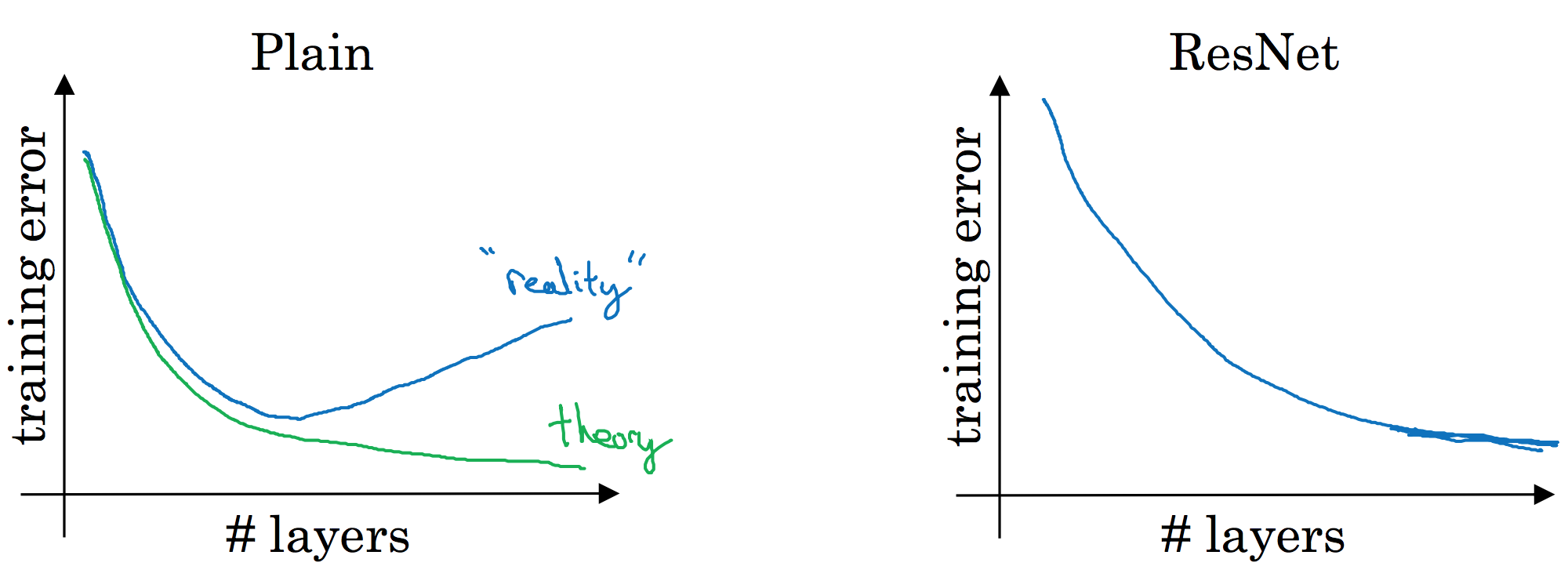

ResNet论文中指出,如果没有残差、没有这些跳跃连接,随着网络深度的加深,训练错误会先减少,然后增多。而理论上,随着网络深度的加深,应该训练得越来越好才对。实际上,如果没有残差网络,对于普通网络来说,深度越深意味着用优化算法越难训练,随着网络深度的加深,训练错误会越来越多。

但ResNets不同,即使网络再深,训练的表现却依然不错,比如说训练误差减少,就算是训练深达100层的网络也不例外(甚至1000层)。但对x的激活,或者这些中间的激活能够到达网络的更深层。残差模块的方式有助于解决梯度消失和梯度爆炸问题,在训练更深网络的同时,也能保证良好的性能。也许从另外一个角度来看,随着网络越来深,网络连接会变得臃肿,但是ResNet确实在训练深度网络方面非常有效。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

636

636

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?