周末的时候,因为本地的一个项目启动的时候 和docker里的fastDFS冲突,配置了好久,最终解决了问题。感觉对Nginx陌生,于是再详细的查找资料,今天总结一下,开车!!

fastdfs占用80端口导致nginx服务器部署80端口的应用无法访问

1、什么是Nginx

Nginx 是⼀款⾼性能的 http 服务器/反向代理服务器及电⼦邮件IMAP/POP3)代理服务器。由俄罗斯的程序设计师伊⼽尔·⻄索夫(Igor Sysoev)所开发,官⽅测试 nginx 能够⽀⽀撑 5 万并发链接,并且cpu、内存等资源消耗却⾮常低,运⾏⾮常稳定。

2 Nginx应⽤场景:

1、http 服务器。Nginx 是⼀个 http 服务可以独⽴提供 http 服务。可以做⽹⻚静态服务器。

2、虚拟主机。可以实现在⼀台服务器虚拟出多个⽹站。例如个⼈⽹站使⽤的虚拟主机。

3、反向代理,负载均衡。当⽹站的访问量达到⼀定程度后,单台服务器不能满⾜⽤户的请求时,需要⽤多台服务器集群可以使⽤ nginx 做反向代理。并且多台服务器可以平均分担负载,不会因为某台服务器负载⾼宕机⽽某台服务器闲置的情况。

3 Nginx安装

[1 在centOS本地安装]

(https://blog.csdn.net/sinat_34289015/article/details/113804070?app_version=5.8.1&code=app_1562916241&csdn_share_tail=%7B%22type%22:%22blog%22,%22rType%22:%22article%22,%22rId%22:%22113804070%22,%22source%22:%22delete_bug%22%7D&uLinkId=usr1mkqgl919blen&utm_source=app)

2使用Docker安装

- 搜索nginx镜像

docker search nginx

- 拉取nginx镜像

docker pull nginx

- 创建容器,设置端⼝映射、⽬录映射

# 在/root⽬录下创建nginx⽬录⽤于存储nginx数据信息

mkdir ~/nginx

cd ~/nginx

mkdir conf

cd conf

# 在~/nginx/conf/下创建nginx.conf⽂件,粘贴下⾯内容

vim nginx.conf

user nginx;

worker_processes 1;

error_log /var/log/nginx/error.log warn;

pid /var/run/nginx.pid;

events {

worker_connections 1024;

}

http {

include /etc/nginx/mime.types;

default_type application/octet-stream;

log_format main '$remote_addr - $remote_user [$time_local] "$request" '

'$status $body_bytes_sent "$http_referer" '

'"$http_user_agent" "$http_x_forwarded_for"';

access_log /var/log/nginx/access.log main;

sendfile on;

#tcp_nopush on;

keepalive_timeout 65;

#gzip on;

include /etc/nginx/conf.d/*.conf;

}

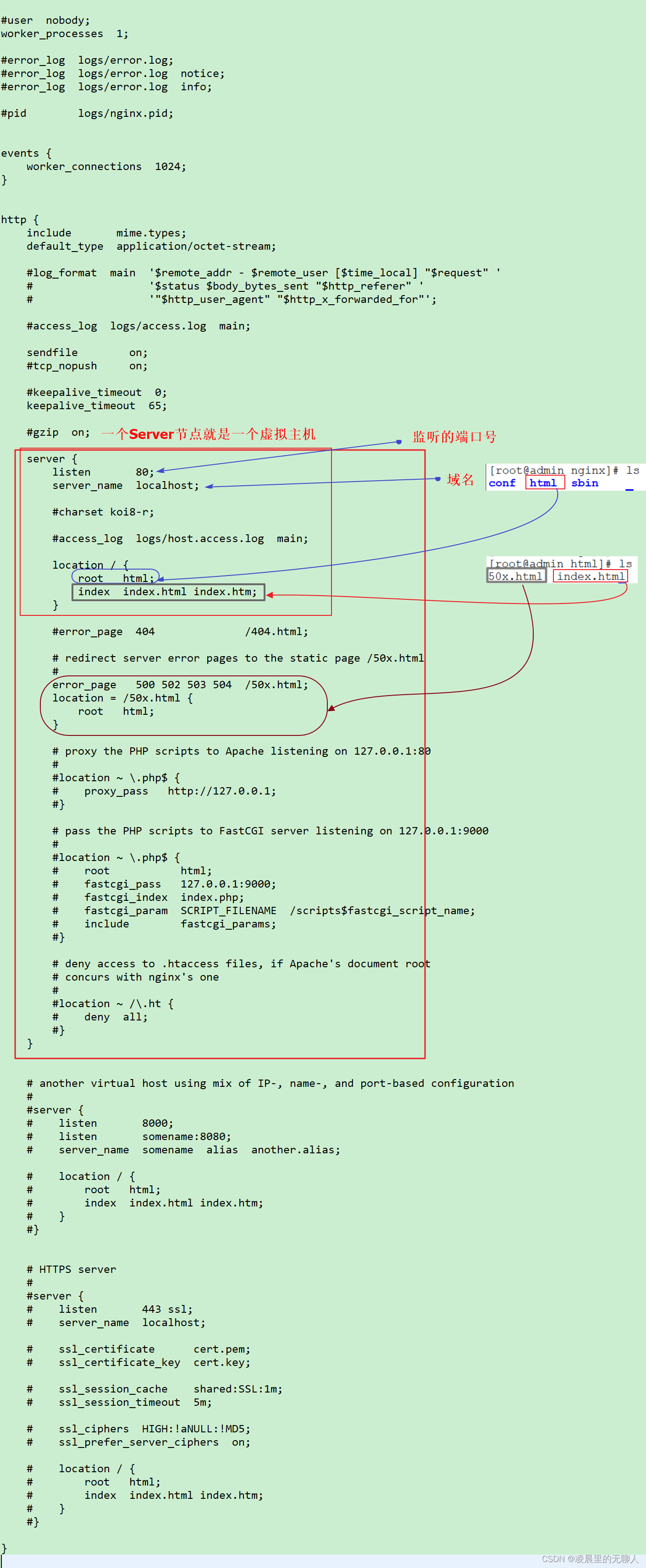

~/nginx/conf.d/80.conf

server {

listen 80; # 监听的端⼝

server_name localhost; # 域名或ip

location / { # 访问路径配置

root /usr/share/nginx/html;# 根⽬录

index index.html index.htm; # 默认⾸⻚

}

error_page 500 502 503 504 /50x.html; # 错误⻚⾯

location = /50x.html {

root html;

}

}

nginx配置文件的位置:/usr/local/nginx/conf/nginx.conf

图片引用作者

docker run -id --name=c_nginx \

-p 80:80 \

-p 81:81 \

-p 82:82 \

-v $PWD/conf/nginx.conf:/etc/nginx/nginx.conf \

-v $PWD/conf.d:/etc/nginx/conf.d \

-v $PWD/logs:/var/log/nginx \

-v $PWD/html:/usr/share/nginx/html \

nginx

参数说明:

-p 80:80:将容器的 80端⼝映射到宿主机的 80 端⼝。

-v $PWD/conf/nginx.conf:/etc/nginx/nginx.conf:将主机当前⽬录下的

/conf/nginx.conf 挂载到容器的 :/etc/nginx/nginx.conf。配置⽬录

-v $PWD/logs:/var/log/nginx:将主机当前⽬录下的 logs ⽬录挂载到容器的/var/log/nginx。⽇志⽬录

4. 使⽤外部机器访问nginx

就可以访问到nginx了。

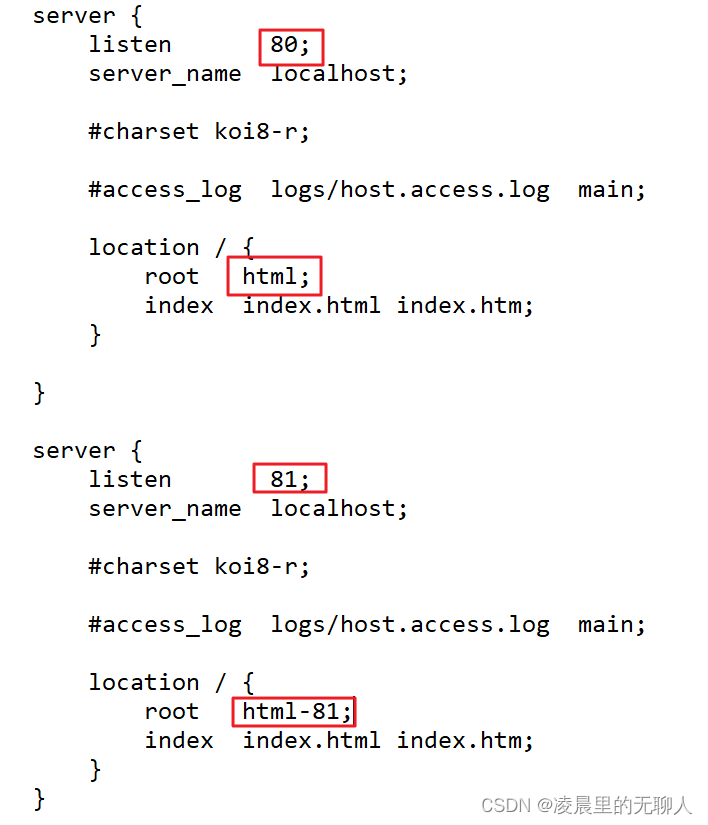

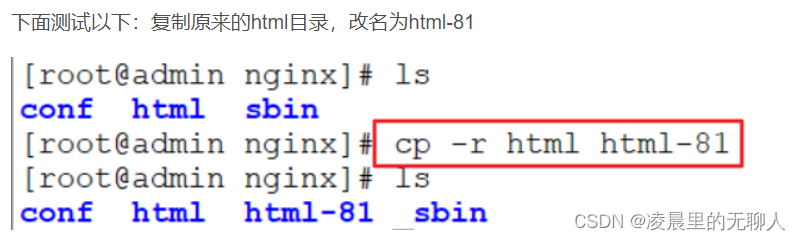

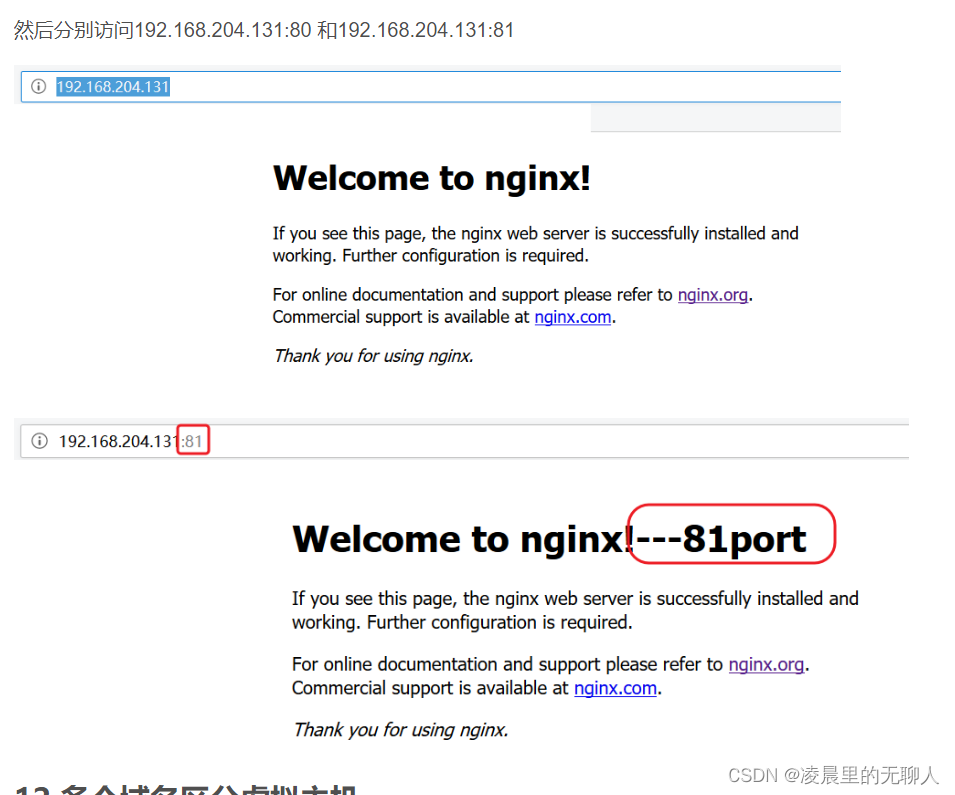

也可以在上面的server配置多个虚拟机

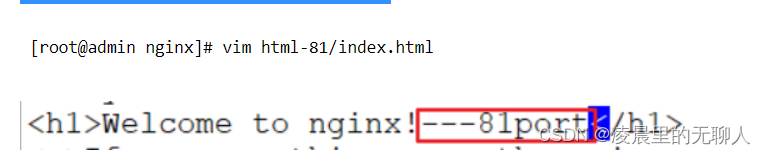

修改以下里面的index.html文件,方便区分

修改完成之后刷新以下配置文件

[root@admin sbin]# ./nginx -s reload

然后访问主机就可以看到不同的服务界面了

4 域名绑定

1 什么是域名

域名(Domain Name),是由⼀串⽤“点”分隔的字符组成的Internet上某⼀台计算机或计算机组的名称,⽤于在数据传输时标识计算机的电⼦⽅位(有时也指地理位置,地理上的域名,指代有⾏政⾃主权的⼀个地⽅区域)。域名是⼀个IP地址上有“⾯具” 。域名的⽬的是便于记忆和沟通的⼀组服务器的地址(⽹站,电⼦邮件,FTP等)。域名作为⼒所能及难忘的互联⽹参与者的名称。域名按域名系统(DNS)的规则流程组成。在DNS中注册的任何名称都是域名。域名⽤于各种⽹络环境和应⽤程序特定的命名和寻址⽬的。通常,域名表示互联⽹协议(IP)资源,例如⽤于访问因特⽹的个⼈计算机,托管⽹站的服务器计算机,或⽹站本身或通过因特⽹传送的任何其他服务。世界上第⼀个注册的域名是在1985年1⽉注册的。

域名级别:

(1)顶级域名

顶级域名⼜分为两类

⼀是国家顶级域名(national top-level domainnames,简称nTLDs),200多个国家都按照ISO3166国家代码分配了顶级域名,例如中国是cn,美国是us,⽇本是jp等;

⼆是国际顶级域名(international top-level domain names,简称iTDs),例如表示⼯商企业的 .Com.Top,表示⽹络提供商的.net,表示⾮盈利组织的.org,表示教育的.edu,以及没有限制的中性域名如.xyz等。⼤多数域名争议都发⽣在com的顶级域名下,因为多数公司上⽹的⽬的都是为了赢利。但因为⾃2014年以来新顶级域名的发展,域名争议案件数量增⻓幅度越来越⼤[5] 。为加强域名管理,解决域名资源的紧张,Internet协会、Internet分址机构及世界知识产权组织(WIPO)等国际组织经过⼴泛协商, 在原来三个国际通⽤顶级域名:(com)的基础上,新增加了7个国际通⽤顶级域名:firm(公司企业)、store(销售公司或企业)、Web(突出WWW活动的单位)、arts(突出⽂化、娱乐活动的单位)、rec (突出消遣、娱乐活动的单位)、info(提供信息服务的单位)、nom(个⼈),并在世界范围

内选择新的注册机构来受理域名注册申请。

例如:baidu.com

(2)⼆级域名

⼆级域名是指顶级域名之下的域名,在国际顶级域名下,它是指域名注册⼈的⽹上名称,例如 ibm,yahoo,microsoft等;在国家顶级域名下,它是表示注册企业类别的符号,例如.top,com,edu,gov,net等。

中国在国际互联⽹络信息中⼼(Inter NIC) 正式注册并运⾏的顶级域名是CN,这也是中国的⼀级域名。在顶级域名之下,中国的⼆级域名⼜分为类别域名和⾏政区域名两类。类别域名共7个, 包括⽤于科研机构的ac;⽤于⼯商⾦融企业的com、top;⽤于教育机构的edu;⽤于政府部⻔的 gov;⽤于互联⽹络信息中⼼和运⾏中⼼的net;⽤于⾮盈利组织的org。⽽⾏政区域名有34个,分别对应于中国各省、⾃治区和直辖市。

例如:map.baidu.com

(3)三级域名

三级域名⽤字⺟( A~Z,a~z,⼤⼩写等)、数字(0~9)和连接符(-)组成, 各级域名之间⽤实点(.)连接,三级域名的⻓度不能超过20个字符。如⽆特殊原因,建议采⽤申请⼈的英⽂名(或者缩写)或者汉语拼⾳名 (或者缩写) 作为三级域名,以保持域名的清晰性和简洁性。

例如:

item.map.baidu.com

2 域名与IP绑定:

⼀个域名对应⼀个 ip 地址,⼀个 ip 地址可以被多个域名绑定。

本地测试可以修改 hosts ⽂件(C:\Windows\System32\drivers\etc)

可以配置域名和 ip 的映射关系,如果 hosts ⽂件中配置了域名和 ip 的对应关系,不需要⾛dns 服务器。

192.168.177.129 www.xzk.com

192.168.177.129 regist.xzk.com

做好域名指向后,修改nginx配置⽂件

server {

listen 80;

server_name www.xzk.com;

location / {

root /usr/share/nginx/cart;

index cart.html;

}

}

server {

listen 80;

server_name regist.xzk.com;

location / {

root /usr/share/nginx/search;

index search.html;

}

}

5、Nginx反向代理与负载均衡

1、反向代理

1.1、什么是反向代理

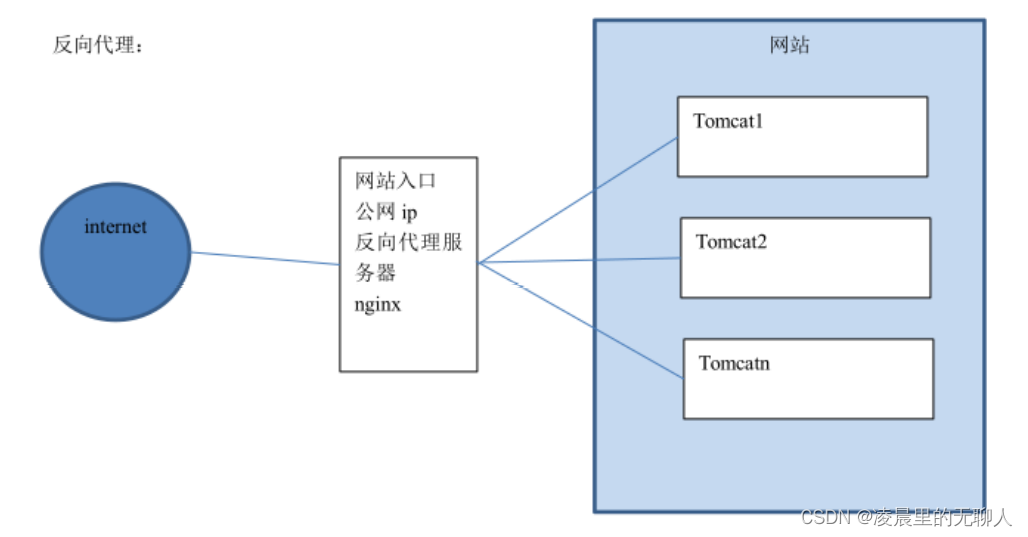

反向代理(Reverse Proxy)⽅式是指以代理服务器来接受internet上的连接请求,然后将请求转发给内部⽹络上的服务器,并将从服务器上得到的结果返回给internet上请求连接的客户端,此时代理服务器对外就表现为⼀个反向代理服务器。

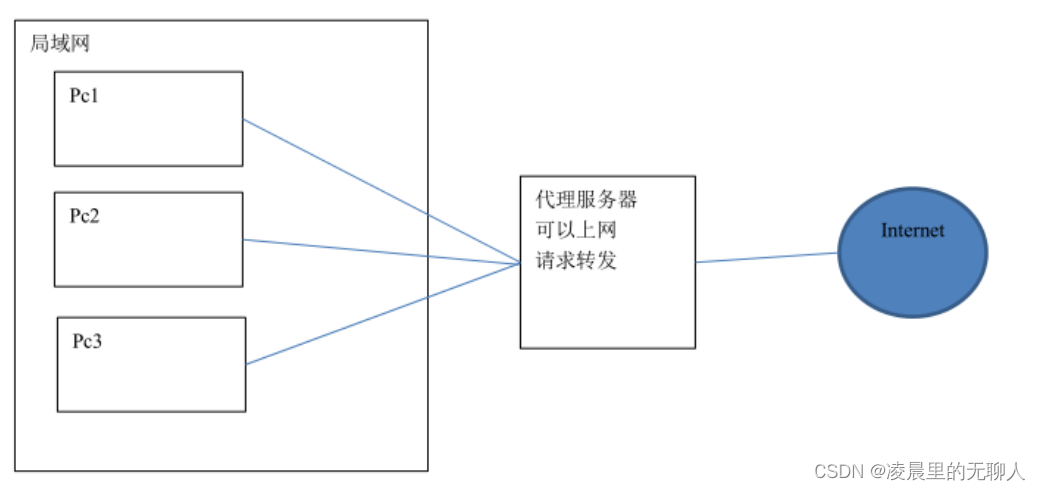

⾸先我们先理解正向代理,如下图:

正向代理是针对你的客户端,⽽反向代理是针对服务器的,如下图

1.2、配置反向代理-准备⼯作

在docker中部署tomcat

- 搜索tomcat镜像

docker search tomcat

- 拉取tomcat镜像

docker pull tomcat

- 创建容器,设置端⼝映射、⽬录映射

# 在/root⽬录下创建tomcat⽬录⽤于存储tomcat数据信息

mkdir ~/tomcat

cd ~/tomcat

docker run -id --name=c_tomcat \

-p 8080:8080 \

-v $PWD:/usr/local/tomcat/webapps \

tomcat

参数说明:

-p 8080:8080:将容器的8080端⼝映射到主机的8080端⼝

-v $PWD:/usr/local/tomcat/webapps:将主机中当前⽬录挂载到容器的webapps

- 使⽤外部机器访问tomcat

1.3 配置反向代理

~/nginx/config.d/proxy.conf

upstream tomcat-kkb{

server 192.168.220.12:8080;

}

server {

listen 80; # 监听的端⼝

server_name www.kkb.com; # 域名或ip

location / { # 访问路径配置

# root index;# 根⽬录

proxy_pass http://tomcat-kkb;

index index.html index.htm; # 默认⾸⻚

}

}

重新启动Nginx 然后⽤浏览器测试:http://www.kkb.com (此域名须配置域名指向)

2、负载均衡

什么是负载均衡

负载均衡 建⽴在现有⽹络结构之上,它提供了⼀种廉价有效透明的⽅法扩展⽹络设备和服务器的带宽、增加吞吐量、加强⽹络数据处理能⼒、提⾼⽹络的灵活性和可⽤性。

负载均衡,英⽂名称为Load Balance,其意思就是分摊到多个操作单元上进⾏执⾏,例如Web服务器、FTP服务器、企业关键应⽤服务器和其它关键任务服务器等,从⽽共同完成⼯作任务。

配置负载均衡-准备⼯作

(1)使⽤docker创建3个tomcat容器,端⼝分别为8080 ,8081,8082 。

docker run -id --name=c_tomcat1 \

-p 8081:8080 \

-v $PWD:/usr/local/tomcat/webapps \

tomcat

docker run -id --name=c_tomcat2 \

-p 8082:8080 \

-v $PWD:/usr/local/tomcat/webapps \

tomcat

(2)分别启动这三个tomcat服务。

(3)为了能够区分是访问哪个服务器的⽹站,可以在⾸⻚标题加上标记以便区分。

配置负载均衡

修改 Nginx配置⽂件:

upstream tomcat-huike {

server 192.168.220.12:8080;

server 192.168.220.12:8081;

server 192.168.220.12:8082;

}

server {

listen 80; # 监听的端⼝

server_name www.huike.com; # 域名或ip

location / { # 访问路径配置

# root index;# 根⽬录

proxy_pass http://tomcat-huike;

index index.html index.htm; # 默认⾸⻚

}

error_page 500 502 503 504 /50x.html; # 错误⻚⾯

location = /50x.html {

root html;

}

}

地址栏输⼊http:// www.huike.com / 刷新观察每个⽹⻚的标题,看是否不同。

经过测试,三台服务器出现的概率各为33.3333333%,交替显示。

如果其中⼀台服务器性能⽐较好,想让其承担更多的压⼒,可以设置权重。

⽐如想让NO.1出现次数是其它服务器的2倍,则修改配置如下:

upstream tomcat-travel {

server 192.168.177.129:8080;

server 192.168.177.129:8081 weight=2;

server 192.168.177.129:8082;

}

6 nginx限流

一般情况下,首页的并发量是比较大的,即使 有了多级缓存,当用户不停的刷新页面的时,或者有大量恶意的请求达到,也会对系统造成影响。

而限流就是保护措施之一。

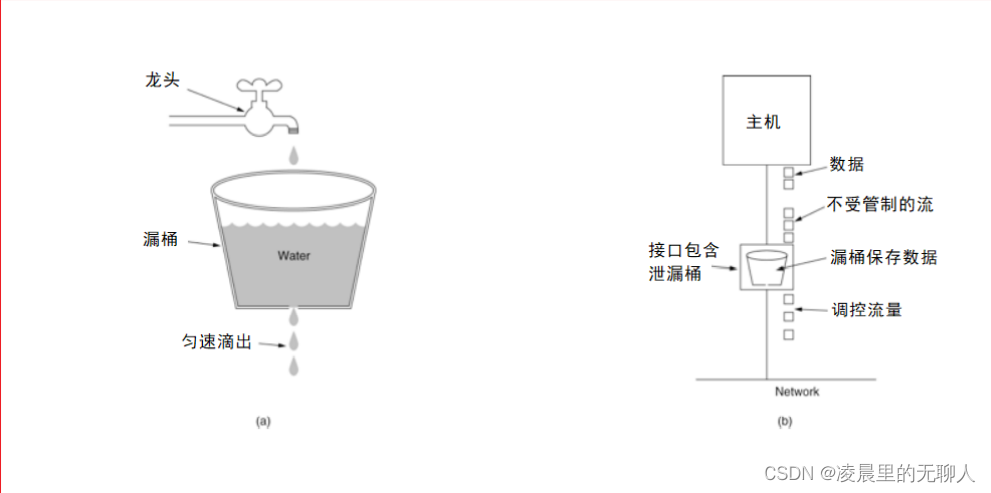

6.1 漏桶算法

算法思想是:

水(请求)从上方倒入水桶,从水桶下方流出(被处理);

来不及流出的水存在水桶中(缓冲),以固定速率流出;

水桶满后水溢出(丢弃)。

这个算法的核心是:缓存请求、匀速处理、多余的请求直接丢弃。

nginx提供两种限流的方式:

一是控制速率

二是控制并发连接数

Nginx按请求速率限速模块使用的是漏桶算法,即能够强行保证请求的实时处理速度不会超过设置的阈值。

Nginx官方版本限制IP的连接和并发分别有两个模块:

limit_req_zone 用来限制单位时间内的请求数,即速率限制,采用的漏桶算法 “leaky bucket”。

limit_req_conn 用来限制同一时间连接数,即并发限制。

6.2 控制速率

配置示意图如下:

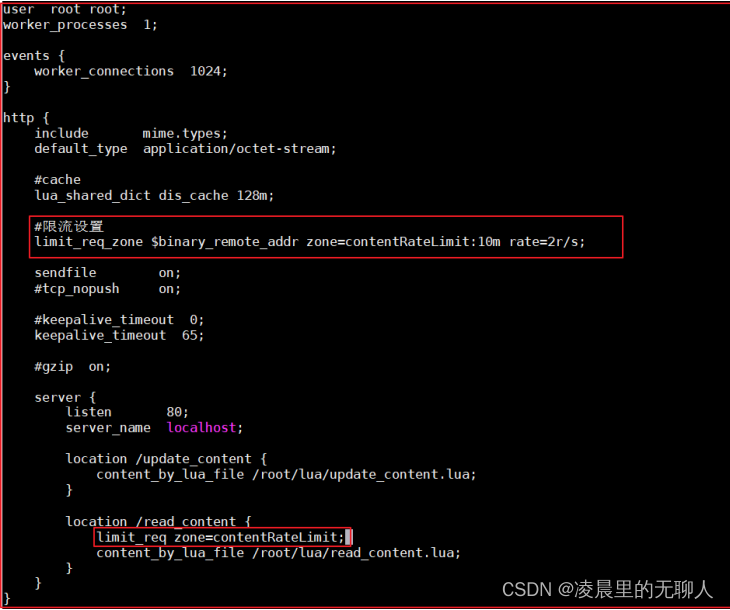

修改/usr/local/openresty/nginx/conf/nginx.conf:

user root root;

worker_processes 1;

events {

worker_connections 1024;

}

http {

include mime.types;

default_type application/octet-stream;

#cache

lua_shared_dict dis_cache 128m;

#限流设置

limit_req_zone $binary_remote_addr zone=contentRateLimit:10m rate=2r/s;

sendfile on;

#tcp_nopush on;

#keepalive_timeout 0;

keepalive_timeout 65;

#gzip on;

server {

listen 80;

server_name localhost;

location /update_content {

content_by_lua_file /root/lua/update_content.lua;

}

location /read_content {

#使用限流配置

limit_req zone=contentRateLimit;

content_by_lua_file /root/lua/read_content.lua;

}

}

}

配置说明:

binary_remote_addr 是一种key,表示基于 remote_addr(客户端IP) 来做限流,binary_ 的目的是

压缩内存占用量。

zone:定义共享内存区来存储访问信息, contentRateLimit:10m 表示一个大小为10M,名字为

contentRateLimit的内存区域。1M能存储16000 IP地址的访问信息,10M可以存储16W IP地址访问信

息。

rate 用于设置最大访问速率,rate=10r/s 表示每秒最多处理10个请求。Nginx 实际上以毫秒为粒度来跟

踪请求信息,因此 10r/s 实际上是限制:每100毫秒处理一个请求。这意味着,自上一个请求处理完后,若

后续100毫秒内又有请求到达,将拒绝处理该请求.我们这里设置成2 方便测试。

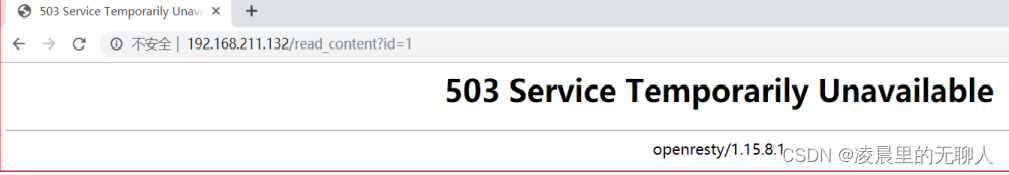

测试:

重新加载配置文件

cd /usr/local/openresty/nginx/sbin

./nginx -s reload

访问页面: http://192.168.220.110/read_content?id=1 ,连续刷新会直接报错

执行效果图

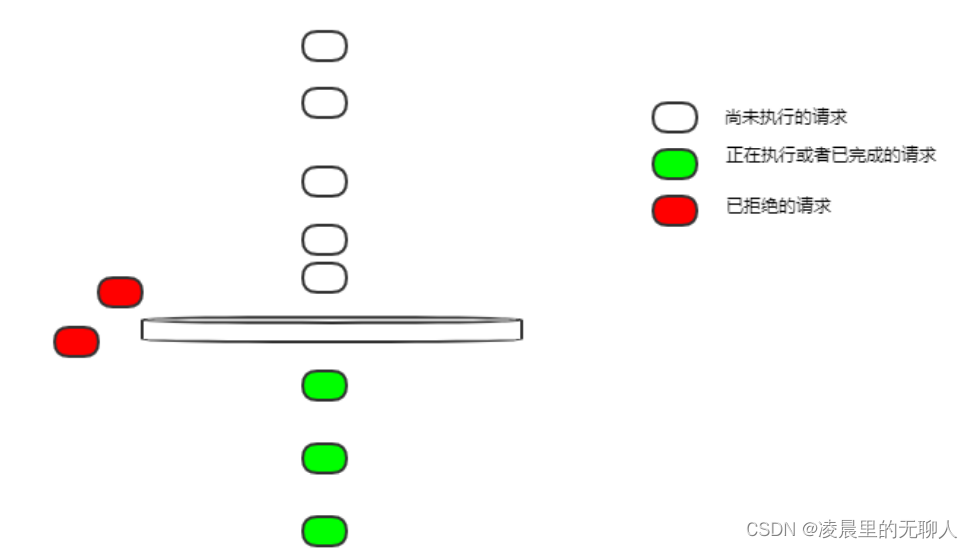

限流速度为每秒10次请求,如果有10次请求同时到达一个空闲的nginx,他们都能得到执行吗?

漏桶漏出请求是匀速的。10r/s是怎样匀速的呢?每100ms漏出一个请求。在这样的配置下,桶是空的,所有不能实时漏出的请求,会被拒绝掉。所以如果10次请求同时到达,那么只有一个请求能够得到执行,其它的,都会被拒绝。这不太友好,大部分业务场景下我们希望这10个请求都能得到执行。

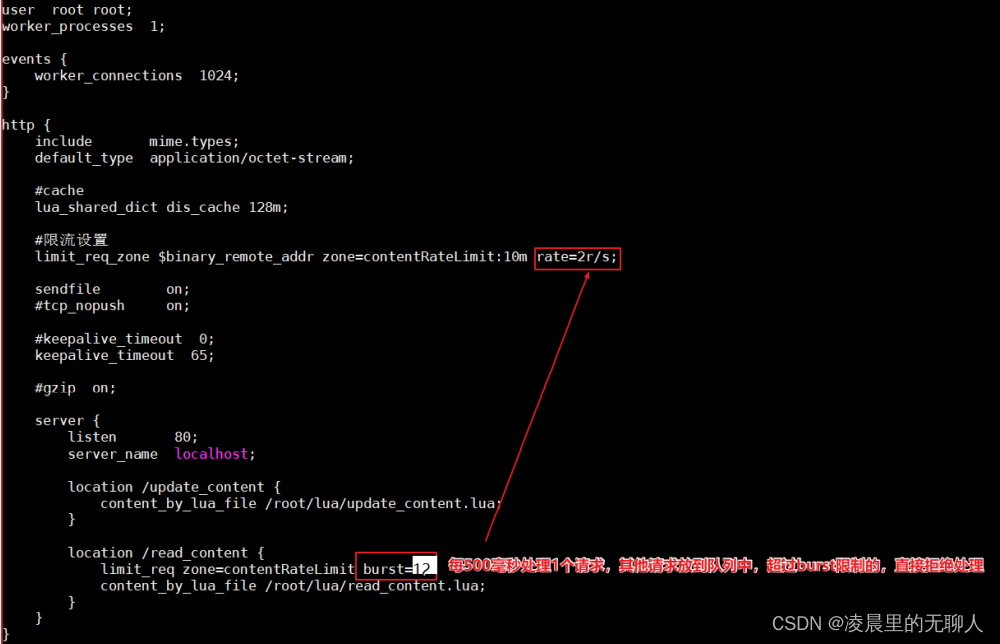

(3)处理突发流量

上面例子限制 2r/s,如果有时正常流量突然增大,超出的请求将被拒绝,无法处理突发流量,可以结合burst 参数使用来解决该问题。

例如,如下配置表示:

上图代码如下:

server {

listen 80;

server_name localhost;

location /update_content {

content_by_lua_file /root/lua/update_content.lua;

}

location /read_content {

limit_req zone=contentRateLimit burst=12;

content_by_lua_file /root/lua/read_content.lua;

}

}

burst 译为突发、爆发,表示在超过设定的处理速率后能额外处理的请求数,当 rate=10r/s 时,将1s拆成10份,即每100ms可处理1个请求。

此处,burst=12,若同时有12个请求到达,Nginx 会处理第一个请求,剩余11个请求将放入队列,然后每隔500ms从队列中获取一个请求进行处理。若请求数大于12,将拒绝处理多余的请求,直接返回503.

单独设置burst效果图

burst=12

不过,单独使用 burst 参数并不实用。假设 burst=50 ,rate依然为10r/s,排队中的50个请求虽然每100ms会处理一个,但第50个请求却需要等待 50 * 100ms即 5s,这么长的处理时间自然难以接受。

因此,burst 往往结合 nodelay 一起使用。

6.3 控制并发量(连接数)

ngx_http_limit_conn_module 提供了限制连接数的能力。主要是利用limit_conn_zone和limit_conn两个指令。

利用连接数限制 某一个用户的ip连接的数量来控制流量。

注意:并非所有连接都被计算在内 只有当服务器正在处理请求并且已经读取了整个请求头时,才会计算有效连接。此处忽略测试。

配置语法:

Syntax: limit_conn zone number;

Default: —;

Context: http, server, location;

(1)配置限制固定连接数

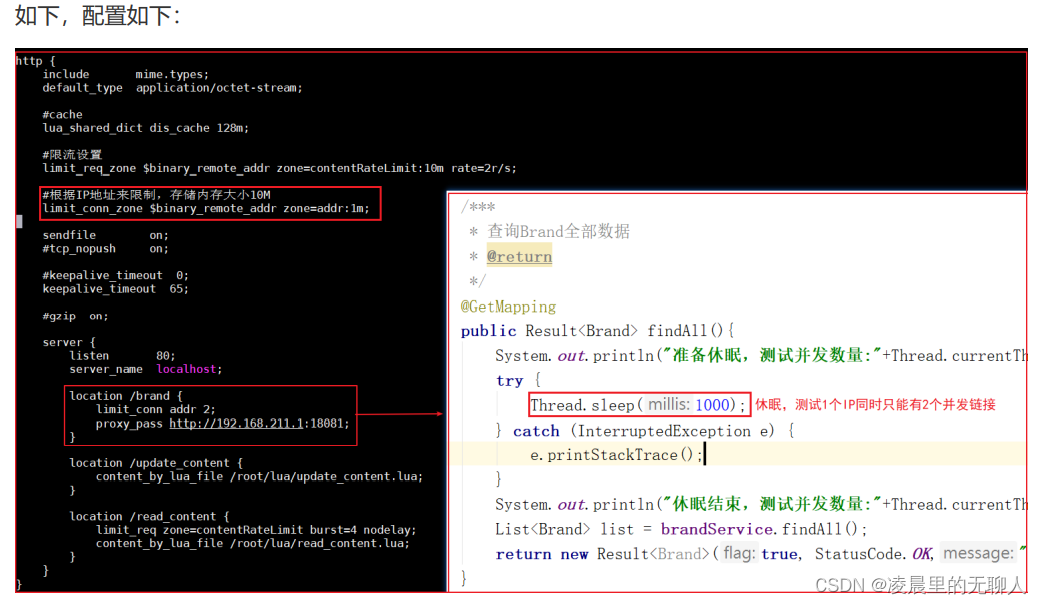

上图配置如下:

http {

include mime.types;

default_type application/octet-stream;

#cache

lua_shared_dict dis_cache 128m;

#限流设置

limit_req_zone $binary_remote_addr zone=contentRateLimit:10m rate=2r/s;

#根据IP地址来限制,存储内存大小10M

limit_conn_zone $binary_remote_addr zone=addr:1m;

sendfile on;

#tcp_nopush on;

#keepalive_timeout 0;

keepalive_timeout 65;

#gzip on;

server {

listen 80;

server_name localhost;

#所有以brand开始的请求,访问本地商品微服务

location /brand {

limit_conn addr 2;

proxy_pass http://192.168.220.1:9005;

}

location /update_content {

content_by_lua_file /root/lua/update_content.lua;

}

location /read_content {

limit_req zone=contentRateLimit burst=4 nodelay;

content_by_lua_file /root/lua/read_content.lua;

}

}

}

表示:

limit_conn_zone $binary_remote_addr zone=addr:10m; 表示限制根据用户的IP地址来显示,

设置存储地址为的内存大小10M

limit_conn addr 2; 表示 同一个地址只允许连接2次。

此时开3个线程,测试的时候会发生异常,开2个就不会有异常

(2)限制每个客户端IP与服务器的连接数,同时限制与服务器的连接总数。(了解)

如下配置:

#存储个人请求IP的限流配置

limit_conn_zone $binary_remote_addr zone=perip:10m;

#整个location对应的请求并发容量配置

limit_conn_zone $server_name zone=perserver:10m;

server {

listen 80;

server_name localhost;

charset utf-8;

location / {

limit_conn perip 10;#单个客户端ip与服务器的连接数."3"

limit_conn perserver 100; #限制与服务器的总连接数"5"

root html;

index index.html index.htm;

}

}

7 Tomcat与Nginx的区别

https://www.cnblogs.com/zhaosq/p/10537852.html

8 Nginx + keepalived 实现高可用 + 防盗链 + 动静分离

8.1 Nginx Rewrite 规则

Rewrite规则含义就是某个URL重写成特定的URL(类似于Redirect),从某种意义上说为了美观或者对搜索引擎友好,提高收录量及排名等。

8.2、Nginx 防盗链

- 什么是防盗链

比如http://www.dbspread.com/download/av123.rmvb 这个视频下载地址被其他网站引用,比如在www.test.com的index.html引用download/av123.rmvb就叫盗链,我们要禁止这种引用就叫做防盗链

8.3、Nginx 动静分离

- 动静分离是什么

Nginx动静分离是让动态网站里的动态网页根据一定规则把不变的资源和经常变的资源区分开来,动静资源做好了拆分以后,我们就可以根据静态资源的特点将其做缓存操作,这就是网站静态化处理的核心思路。

8.4、Nginx+keepalived 实现高可用

- keepalived是什么

Keepalived软件起初是专为LVS负载均衡软件设计的,用来管理并监控LVS集群系统中各个服务节点的状态,后来又加入了可以实现高可用的VRRP (Virtual Router Redundancy Protocol ,虚拟路由器冗余协议)功能。因此,Keepalived除了能够管理LVS软件外,还可以作为其他服务(例如:Nginx、Haproxy、MySQL等)的高可用解决方案软件

以上内容在文末的原文中 ,点击可直达原文。原文有详细配置和说明。 此处不多赘述

本文参考:

nginx安装及其配置详细教程

602

602

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?