先介绍拉格朗日对偶性,具体见《统计学习算法》附录C

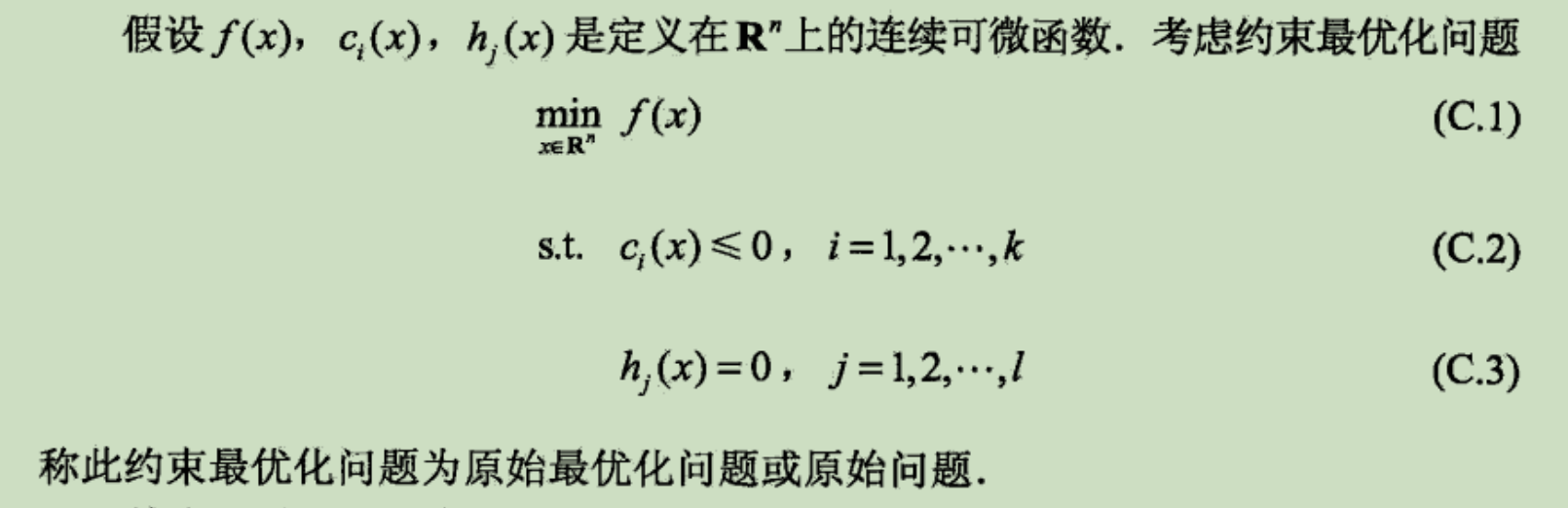

下图叫“原始问题”,此时的向量 x ⃗ \vec{x} x是有约束条件的

引进拉格朗日函数之后,注意 x ⃗ , α i , β i \vec{x},α_i,β_i x,αi,βi都是变量;式 ( C . 5 ) (\text{C}.5) (C.5)将 α i , β i α_i,β_i αi,βi变成参数,此时 x ⃗ \vec{x} x才是变量,并且注意这里的 x ⃗ \vec{x} x是不用满足任何约束条件的;此时经过推导可以得出式 ( C . 8 ) (\text{C}.8) (C.8),而且有式 ( C . 7 ) (\text{C}.7) (C.7),我们求解原始问题(此时 x ⃗ \vec{x} x满足约束条件)的最优解相当于求解式 ( C . 9 ) (\text{C}.9) (C.9)(此时 x ⃗ \vec{x} x不用满足任何约束条件;只不过式 ( C . 9 ) (\text{C}.9) (C.9)如果返回的是一个有限值,那么其输入肯定就满足原式问题的约束条件)

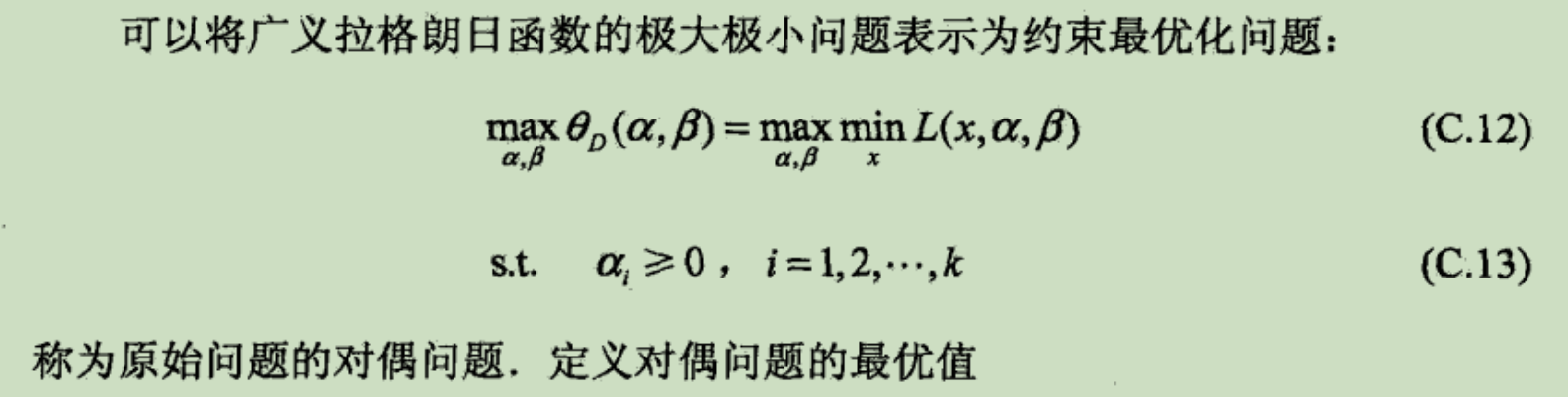

下图叫“对偶问题”,此时只有 α i α_i αi有约束条件, β i , x ⃗ β_i,\vec{x} βi,x都没有,而且此时 x ⃗ \vec{x} x是参数, α i , β i α_i,β_i αi,βi是自变量

推论 C . 1 \text{C}.1 C.1的符号使用应该有一点问题,这里的 d ∗ , p ∗ d^{*},p^{*} d∗,p∗应该不是上文所说的最优值了,而应该是将 x ∗ x^{*} x∗代入式 ( C . 9 ) (\text{C}.9) (C.9)得到的 p ∗ p^{*} p∗,将 α ∗ , β ∗ α^{*},β^{*} α∗,β∗代入式 ( C . 14 ) (\text{C}.14) (C.14)得到的 d ∗ d^{*} d∗,此时不难理解这个推论的正确性

定理 ( C . 2 ) (\text{C}.2) (C.2)表明求解原始问题就转变为求解对偶问题,即式 ( C . 14 ) (\text{C}.14) (C.14)

定理 ( C . 3 ) (\text{C}.3) (C.3)没看太懂,不应该只用满足式 ( C . 25 ) , ( C . 26 ) , ( C . 27 ) (\text{C}.25),(\text{C}.26),(\text{C}.27) (C.25),(C.26),(C.27)就行了嘛,等之后补充

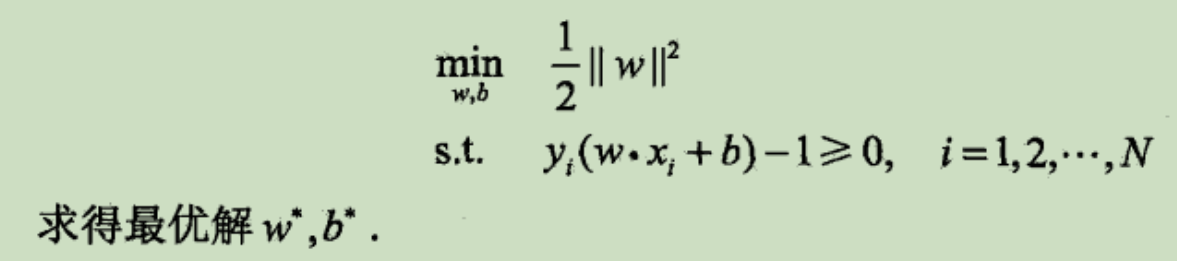

然后来看线性可分向量机的对偶算法

我们要求解的是如下问题的 w ⃗ , b \vec{w},b w,b

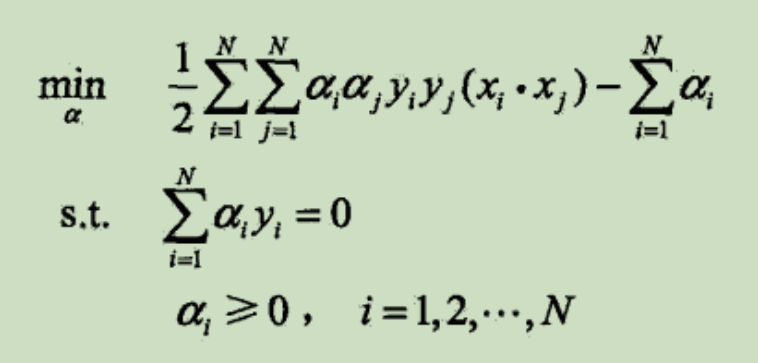

我们构造对偶问题如下

可以验证其满足式 ( C . 2 ) (\text{C}.2) (C.2)的条件,于是求解原问题就转化为求解对偶问题。再利用定理 7.2 7.2 7.2求出 w ∗ , b ∗ w^{*},b^{*} w∗,b∗(注意书中的 x x x都是向量)

1415

1415

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?