Densely Connected Convolutional Networks,原文链接:https://arxiv.org/pdf/1608.06993.pdf

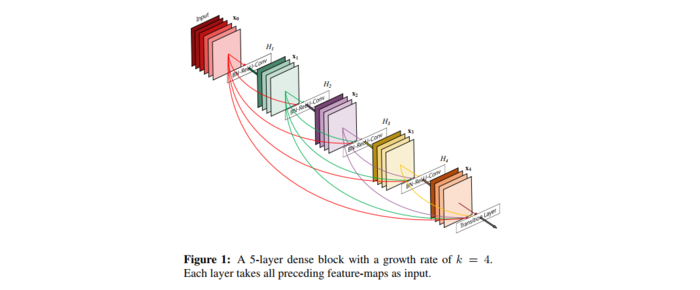

自从2016年何恺明大神提出ResNet后,众多神经网络的研究者似乎突然悟到了很多,各种利用short path来提升性能的结构如雨后春笋,层出不穷。有点名头的比如Stochastic depth、FractalNets,影响最大的就是这个康奈尔大学、清华、Facebook研究者联合搞的DenseNet。DenseNet可以算是short path类型网络的终极版了,它把每一层的输出都直连到了后面每一层的输入上。图1是论文原作者给的示意图,这个图漏画了总的输入数据的连接,总的输入也连到了其后的每一层输入上,所以对于一个L层的网络来说就有Lx(L+1)/2条连线。

图1:论文中的DenseNet示意图

搞这么多直连有什么好处呢?作者给了两个解释:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

6743

6743

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?