大道至简----多示例学习与注意力机制的巧妙结合

【池化方法】多示例学习池化(MIL pooling)公式与代码

1、定义

多示例学习中的关键是找到示例与包之间的逻辑关系。

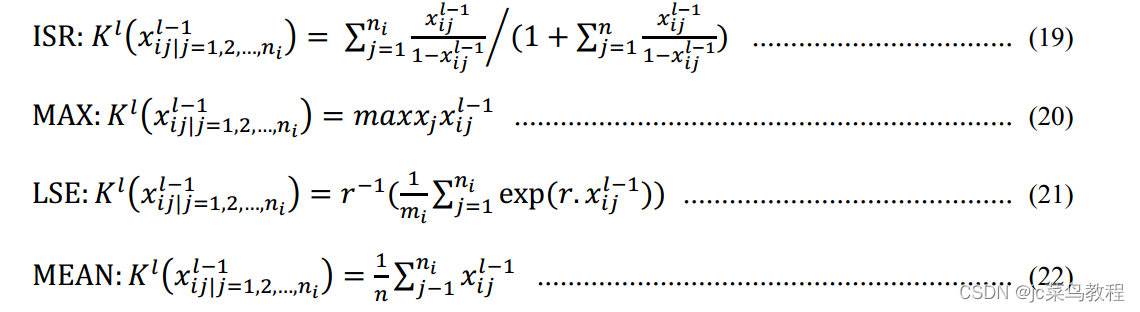

常见方法:

常见的有三种:

- 【1】实例平均池化

- 【2】最大池化

- 【3】基于注意力机制的方法

注意力机制(Attention Mechanism)是解决信息超载问题的主要手段的一种资源分配方案,将计算资源分配给更重要的任务。通俗且不是很严谨的说,就是一种被赋予了直观意义的权重,它决定着哪一部分信息更加重要。

与上文结合来说,(1)和(2)可以认为是多示例问题中的一种硬性注意力。

(1)中每个示例的注意力权重可以认为是1/n。(2)中Key Instance权重为1.0,而其余示例的注意力权重均为0。

2、实例注意力

经典的多示例网络如下

他与我们所熟悉的全连接网络区别在于,网络末端增加了符合多示例假设的模块:Instance Score Layer和MIL Pooling Layer。上述经典的网络结构中所使用的Pooling方法正是上文提到的最大池化。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?