文章目录

Scrapy简介

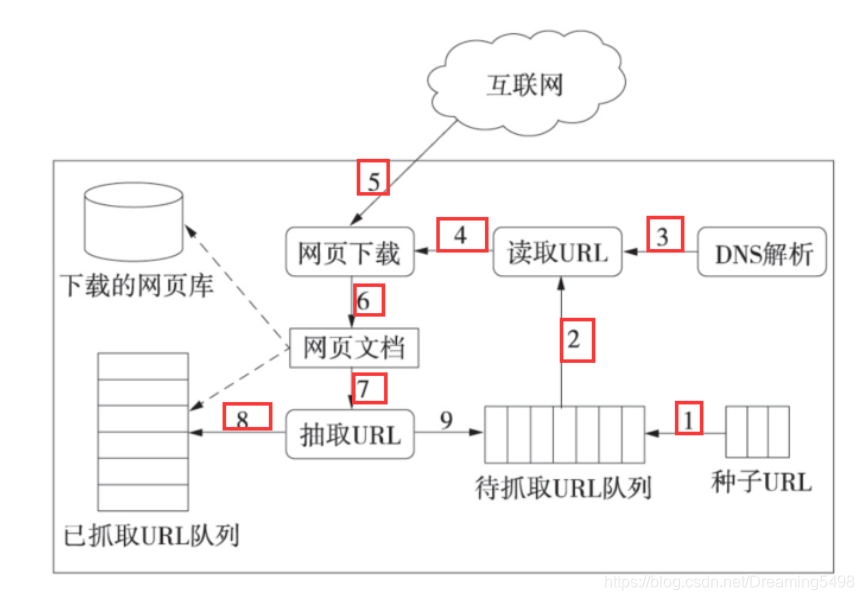

通用爬虫框架流程

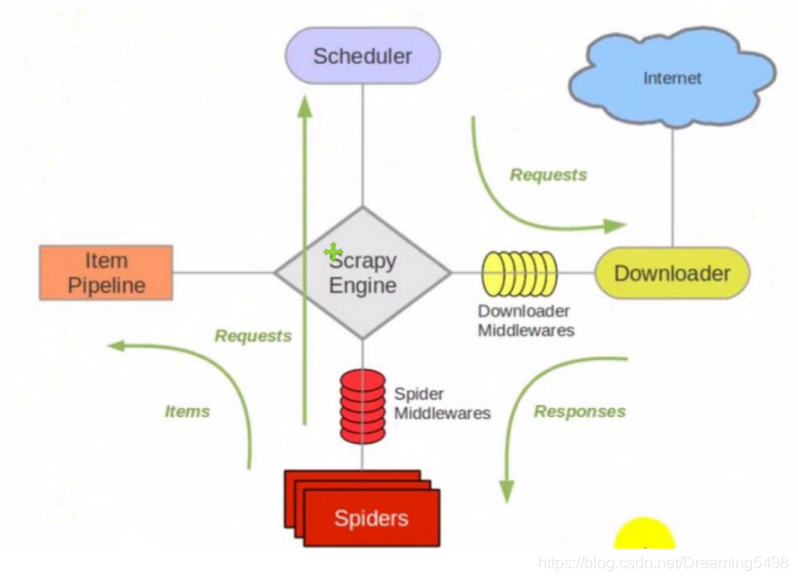

Scrapy 框架流程

Scrapy组件

Scrapy主要包括了以下组件:

- 引擎(Scrapy)

用来处理整个系统的数据流处理, 触发事务(框架核心) - 调度器(Scheduler)

用来接受引擎发过来的请求, 压入队列中, 并在引擎再次请求的时候返回. 可以想像成一个URL(抓取网页的网址或者说是链接)的优先队列, 由它来决定下一个要抓取的网址是什么, 同时去除重复的网址 - 下载器(Downloader)

用于下载网页内容, 并将网页内容返回给蜘蛛(Scrapy下载器是建立在twisted这个高效的异步模型上的) - 爬虫(Spiders)

爬虫是主要干活的, 用于从特定的网页中提取自己需要的信息, 即所谓的实体(Item)。用户也可以从中提取出链接,让Scrapy继续抓取下一个页面 - 项目管道(Pipeline)

负责处理爬虫从网页中抽取的实体,主要的功能是持久化实体、验证实体的有效性、清除不需要的信息。当页面被爬虫解析后,将被发送到项目管道,并经过几个特定的次序处理数据。 - 下载器中间件(Downloader Middlewares)

位于Scrapy引擎和下载器之间的框架,主要是处理Scrapy引擎与下载器之间的请求及响应。 - 爬虫中间件(Spider Middlewares)

介于Scrapy引擎和爬虫之间的框架,主要工作是处理蜘蛛的响应输入和请求输出。 - 调度中间件(Scheduler Middewares)

介于Scrapy引擎和调度之间的中间件,从Scrapy引擎发送到调度的请求和响应。

Scrapy运行流程

- 引擎从调度器中取出一个链接(URL)用于接下来的抓取

- 引擎把URL封装成一个请求(Request)传给下载器

- 下载器把资源下载下来,并封装成应答包(Response)

- 爬虫解析Response

- 解析出实体(Item),则交给实体管道进行进一步的处理

- 解析出的是链接(URL),则把URL交给调度器等待抓取

Scrapy的安装

Linux下的安装(包括mac)

pip install scrapy

Windows下的安装

1. 下载twisted

http://www.lfd.uci.edu/~gohlke/pythonlibs/#twisted

2. 安装wheel

pip3 install wheel

3. 安装twisted

进入下载目录,执行 pip3 install Twisted‑18.7.0‑cp36‑cp36m‑win_amd64.whl

4. 安装pywin32

pip3 install pywin32

5. 安装scrapy

pip3 install scrapy

基本命令

1. scrapy startproject 项目名称

在当前目录中创建一个项目文件

2. scrapy genspider [-t template] <name> <domain>

创建爬虫应用

如:

scrapy gensipider -t basic oldboy oldboy.com

scrapy gensipider -t xmlfeed autohome autohome.com.cn

或者简单直接:

scrapy gensipider app名 要爬取的域名

PS:

查看所有命令:scrapy gensipider -l

查看模板命令:scrapy gensipider -d 模板名称

3. scrapy list

展示爬虫应用列表

4. scrapy crawl 爬虫应用名称

运行单独爬虫应用

备注:

scrapy crawl 应用名称 表示以日志的形式运行爬虫应用,可以在后面加 --nolog 取消日志

scrapy crawl 名称 --nolog

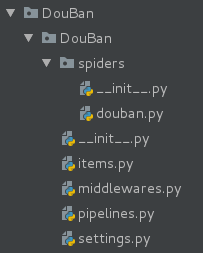

项目文件说明

- scrapy.cfg 项目的主配置信息。(真正爬虫相关的配置信息在settings.py文件中)

- items.py 设置数据存储模板,用于结构化数据,如:Django的Model

- pipelines 数据处理行为,如:一般结构化的数据持久化

- settings.py 配置文件,如:递归的层数、并发数,延迟下载等

- spiders 爬虫目录,如:创建文件,编写爬虫规则

项目案例

项目介绍

为了充分利用网上大数据资源,让用户能够方便利用影视信息,采用基于 Scrapy 框架的爬虫技术,开发了检索电影信息的搜索引擎。对豆瓣网站的影视信息进行爬取,以方便用户准确获取最新的电影信息。

项目代码

以“豆瓣电影”为爬取目 标,爬取网站中的影视信息。主要包括网站排名 “ Top250 ”和喜剧、动作类电影的电影名称、电影评分、电影导演, 电影上映时间以及电影评语。

创建工程

scrapy startproject DouBan

创建爬虫程序

cd DouBan/

scrapy genspider douban 'douban.com'

自动创建目录及文件

编写爬虫文件(douban.py)

# -*- coding: utf-8 -*-

import scrapy

from scrapy import Request

from DouBan.items import DoubanItem

import copy

class DoubanSpider(scrapy.Spider):

name = 'douban'

allowed_domains = ['douban.com']

# start_urls = ['http://douban.com/']

start_urls = ['https://movie.douban.com/top250']

url = 'https://movie.douban.com/top250'

def parse(self, response):

items = DoubanItem()

# with open('douban.html', 'w') as f:

# f.write(response.text)

movies = response.xpath("//ol[@class='grid_view']/li")

for movie in movies:

title = movie.xpath(".//span[@class='title']/text()").extract()[0]

rating_num = movie.xpath(".//span[@class='rating_num']/text()").extract()

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

960

960

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?