过拟合问题(THE PROBLEM OF OVERFITTING)

通过学习得到的假设,可能能够非常好地适应训练集(代价函数可能几乎为 0),但是可能会不能推广到新的数据。

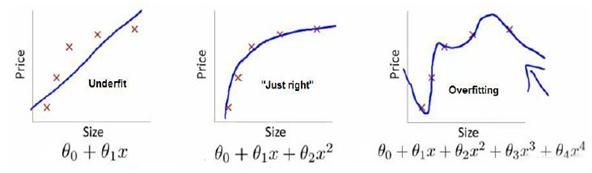

下图是一个回归问题的例子:

- 第一个模型是一个线性模型,低度拟合,不能很好地适应我们的训练集。这个问题的另一个术语叫做高偏差(high bias);

- 第三个模型是一个四次方的模型,过度拟合,虽然能非常好地适应我们的训练集但在新输入变量进行预测时可能会效果不好。这个问题的另一个术语叫做高方差(high variance),将会在变量多的时候发生;

- 中间的模型似乎最合适。

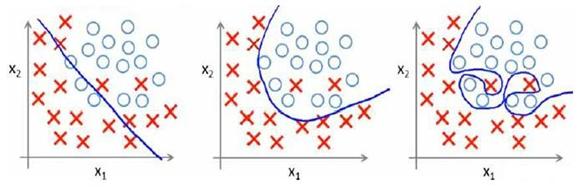

分类问题中也存在这样的问题:

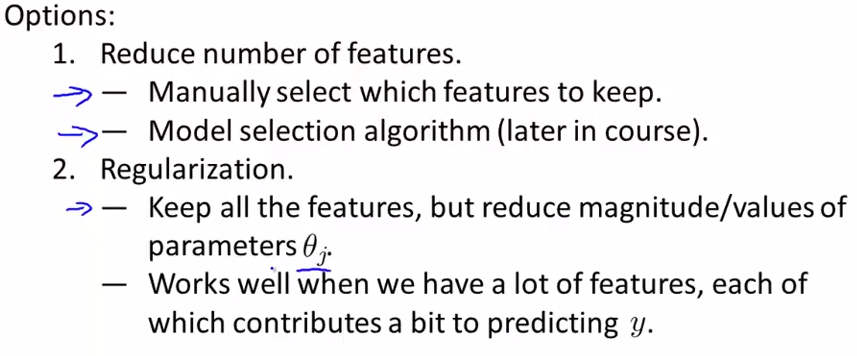

问题是,如果我们发现了过拟合问题,应该如何处理?

归一化代价函数(REGULARIZATION COST FUNCTION)

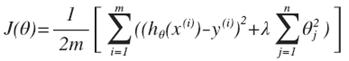

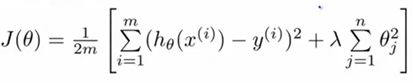

假如我们有非常多的特征,我们并不知道其中哪些特征我们要惩罚,我们将对所有的特征进行惩罚,并且让代价函数最优化的软件来选择这些惩罚的程度。这样的结果是得到了一个较为简单的能防止过拟合问题的假设:

其中λ又称为归一化参数(Regularization Parameter)。

注:根据惯例,我们不对

θ0

进行惩罚。

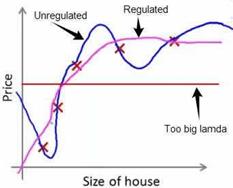

经过归一化处理的模型与原模型的可能对比如下图所示:

如果选择的归一化参数λ过大,则会把所有的参数都最小化了,导致模型变成 hθ(x)=θ0 ,也就是上图中红色直线所示的情况,造成低度拟合。

归一化线性回归(REGULARIZED LINEAR REGRESSION)

归一化线性回归的代价函数为:

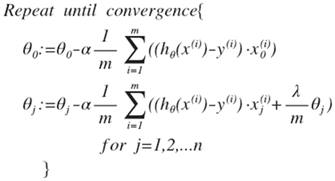

如果我们要使用梯度下降法令这个代价函数最小化,因为我们未对

θ0

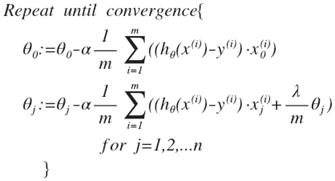

进行归一化,所以梯度下降算法将分两种情形:

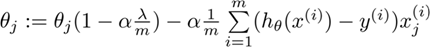

对上面的算法中 j=1,2,…,n 时的更新式子进行调整可得:

可以看出,归一化线性回归的梯度下降算法的变化在于:每次都在原有算法更新规则的基础上令θ值减少了一个额外的值。

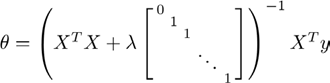

我们同样也可以利用正规方程来求解归一化线性回归模型,方法如下所示:

图中的矩阵尺寸为 n+1*n+1。

归一化逻辑回归(REGULARIZED LOGISTIC REGRESSION)

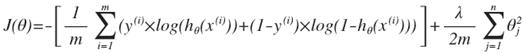

同样对于逻辑回归,我们也给代价函数增加一个归一化的表达式,得到:

要最小化该代价函数,通过求导,得出梯度下降算法为:

注:看上去同线性回归一样,但是知道

hθ(x)=g(θTX)

,所以与线性回归不同。

Octave 中,我们依旧可以用 fminuc 函数来求解代价函数最小化的参数,值得注意的是参数

θ0

的更新规则与其他情况不同。

2590

2590

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?