一、yolov3环境搭建及测试

参考博客 mac/linux系统中YOLOv3环境搭建与测试

二、voc数据集制作

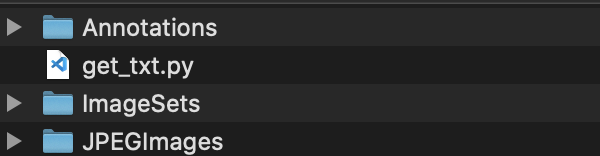

使用labelimg标柱数据集,新建两个文件夹Annotations和JPEGImaages,JPEGImaages用于存储图片,Annotations用于存储voc标签。数据集标柱参考博客 labelimg安装及数据集标柱

三、生成yolo数据集格式

在Annotations和JPEGImaages同级目录下,运行代码get_txt.py, 将生成ImageSets文件夹。

四、生成标签

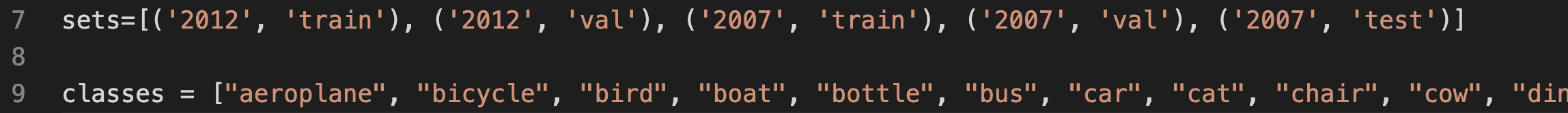

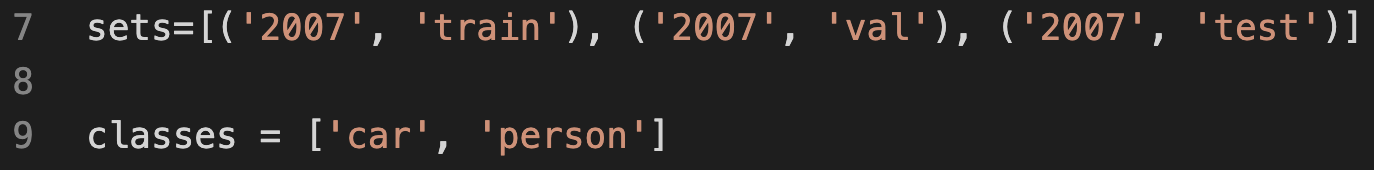

将darknet/scripts文件夹下的voc_label.py文件,放到VOCdevkit同级目录下,并修改voc_label.py文件,sets只保留2007的三项,classes写入自己训练的类别,这里训练两类,人和车。

修改前 :

修改后:

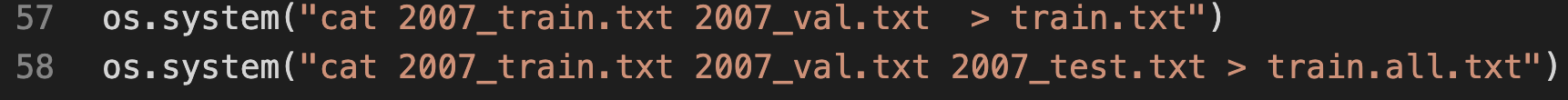

voc_label.py其他修改如下

在VOCdevkit上级目录下执行

python label_voc.py

即可生成

2007_test.txt 2007_train.txt, 2007_val.txt, train.all.txt ,train.txt文件

VOCdevkit目录结构

五、训练

5.1 修改cfg/voc.data文件:

classes= 2 #你的数据及类别

train = /home/darknet/dataset/train.txt #上步产生的train.txt文件路径

valid = /home/darknet/dataset/test.txt #上步生成的test.txt文件路径

names = data/voc.names #类别

backup = backup #backup用于存储训练结果

5.2 修改data/voc.names文件:

car #自己的数据集标签

person

5.3 修改cfg/yolov3-voc.cfg文件:

训练时注释掉,下面两行

[net]

# Testing

# batch=1 #注释

# subdivisions=1 #注释

# Training

batch=64

subdivisions=16

有3处需要修改,ctrl+f查找yolo

[convolutional]

size=1

stride=1

pad=1

filters=21 # 需要修改,值等于3*(5+类别数),这里是两类,所以是21

activation=linear

[yolo]

mask = 6,7,8

anchors = 10,13, 16,30, 33,23, 30,61, 62,45, 59,119, 116,90, 156,198, 373,326

classes=2 # 需要修改,类别数

num=9

jitter=.3

ignore_thresh = .5

truth_thresh = 1

random=1 # 需要修改,如果显存较小,可设为0

5.4 下载预训练权重

wget https://pjreddie.com/media/files/darknet53.conv.74

5.5 训练

./darknet detector train cfg/voc.data cfg/yolov3-voc.cfg darknet53.conv.74 -gpus 0,1

-gups可以选择用于训练的gpu,也可以不写。训练结果将保存在darknet/backup文件夹下

训练到一半时终止后,想继续训练

./darknet detector train cfg/voc.data cfg/yolov3-voc.cfg backup/yolov3-voc_10000.weights -gpus 0,1

cfg/yolov-voc.cfg 文件参数说明

[net]

# Testing 测试模式

# batch=1

# subdivisions=1

# Training 训练模式

batch=64 一批训练样本的样本数量,每batch个样本更新一次参数

subdivisions=16 batch/subdivisions作为一次性送入训练器的样本数量,如果显存不够大,将batch分割为subdivisions个子batch

如果显存较小,则把batch改小一点,subdivisions改大

width=416 图像的大小,只可以设置成32的倍数

height=416

channels=3

momentum=0.9 DeepLearning1中最优化方法中的动量参数,这个值影响着梯度下降到最优值得速度

decay=0.0005 权重衰减正则项,防止过拟合.每一次学习的过程中,将学习后的参数按照固定比例进行降低,为了防止过拟合,decay参数越大对过拟合的抑制能力越强。

angle=0 通过旋转角度来生成更多训练样本

saturation = 1.5 通过调整饱和度来生成更多训练样本

exposure = 1.5 通过调整曝光量来生成更多训练样本

hue=.1 通过调整色调来生成更多训练样本

learning_rate=0.001 学习率决定着权值更新的速度,设置得太大会使结果超过最优值,太小会使下降速度过慢。

如果仅靠人为干预调整参数,需要不断修改学习率。刚开始训练时可以将学习率设置的高一点,

而一定轮数之后,将其减小

在训练过程中,一般根据训练轮数设置动态变化的学习率。

刚开始训练时:学习率以 0.01 ~ 0.001 为宜。

一定轮数过后:逐渐减缓。

接近训练结束:学习速率的衰减应该在100倍以上。

学习率的调整参考

burn_in=1000 在迭代次数小于burn_in时,其学习率的更新有一种方式,大于burn_in时,才采用policy的更新方式

max_batches = 20200 训练达到max_batches后停止学习

policy=steps 这个是学习率调整的策略,有policy:constant, steps, exp, poly, step, sig, RANDOM,constant等方式

参考

steps=40000,45000 下面这两个参数steps和scale是设置学习率的变化,比如迭代到40000次时,学习率衰减十倍。

scales=.1,.1 45000次迭代时,学习率又会在前一个学习率的基础上衰减十倍

[convolutional]

batch_normalize=1 是否做BN

filters=32 输出特征图的数量

size=3 卷积核的尺寸

stride=1 做卷积运算的步长

pad=1 如果pad为0,padding由 padding参数指定;如果pad为1,padding大小为size/2,padding应该是对输入图像左边缘拓展的像素数量

activation=leaky 激活函数的类型

# Downsample

[convolutional]

batch_normalize=1

filters=64

size=3

stride=2

pad=1

activation=leaky

[convolutional]

batch_normalize=1

filters=32

size=1

stride=1

pad=1

activation=leaky

[convolutional]

batch_normalize=1

filters=64

size=3

stride=1

pad=1

activation=leaky

[shortcut]

from=-3

activation=linear

# Downsample

......

# Downsample

######################

[convolutional]

batch_normalize=1

filters=512

size=1

stride=1

pad=1

activation=leaky

[convolutional]

batch_normalize=1

size=3

stride=1

pad=1

filters=1024

activation=leaky

[convolutional]

batch_normalize=1

filters=512

size=1

stride=1

pad=1

activation=leaky

[convolutional]

batch_normalize=1

size=3

stride=1

pad=1

filters=1024

activation=leaky

[convolutional]

batch_normalize=1

filters=512

size=1

stride=1

pad=1

activation=leaky

[convolutional]

batch_normalize=1

size=3

stride=1

pad=1

filters=1024

activation=leaky

[convolutional]

size=1

stride=1

pad=1

filters=45 每一个[region/yolo]层前的最后一个卷积层中的 filters=(classes+1+coords)*anchors_num,

其中anchors_num 是该层mask的一个值.如果没有mask则 anchors_num=num是这层的ancho

5的意义是5个坐标,论文中的tx,ty,tw,th,to

activation=linear

[yolo] 在yoloV2中yolo层叫region层

mask = 6,7,8 这一层预测第6、7、8个 anchor boxes ,每个yolo层实际上只预测3个由mask定义的anchors

anchors = 10,13, 16,30, 33,23, 30,61, 62,45, 59,119, 116,90, 156,198, 373,326

[?]anchors是可以事先通过cmd指令计算出来的,是和图片数量,width,height以及cluster(应该就是下面的num的值,

即想要使用的anchors的数量)相关的预选框,可以手工挑选,也可以通过kmeans 从训练样本中学出

classes=10 网络需要识别的物体种类数

num=9 每个grid cell预测几个box,和anchors的数量一致。当想要使用更多anchors时需要调大num,且如果调大num后训练时Obj趋近0的话可以尝试调大object_scale

jitter=.3 [?]利用数据抖动产生更多数据,YOLOv2中使用的是crop,filp,以及net层的angle,flip是随机的,

jitter就是crop的参数,tiny-yolo-voc.cfg中jitter=.3,就是在0~0.3中进行crop

ignore_thresh = .5 决定是否需要计算IOU误差的参数,大于thresh,IOU误差不会夹在cost function中

truth_thresh = 1

random=0 如果为1,每次迭代图片大小随机从320到608,步长为32,如果为0,每次训练大小与输入大小一致

[route]

layers = -4

2652

2652

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?