Windows 安装 Xinference

0. 引言

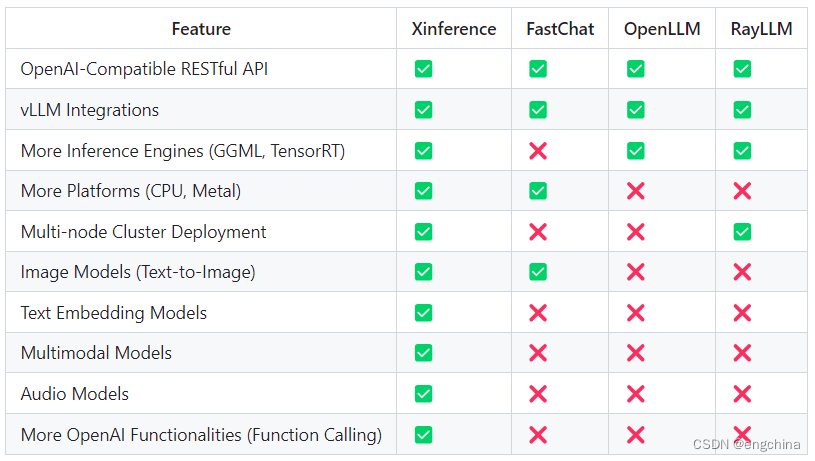

Xorbits Inference(Xinference)是一个性能强大且功能全面的分布式推理框架。可用于大语言模型(LLM),语音识别模型,多模态模型等各种模型的推理。通过 Xorbits Inference,你可以轻松地一键部署你自己的模型或内置的前沿开源模型。无论你是研究者,开发者,或是数据科学家,都可以通过 Xorbits Inference 与最前沿的 AI 模型,发掘更多可能。

为什么选择 Xinference?

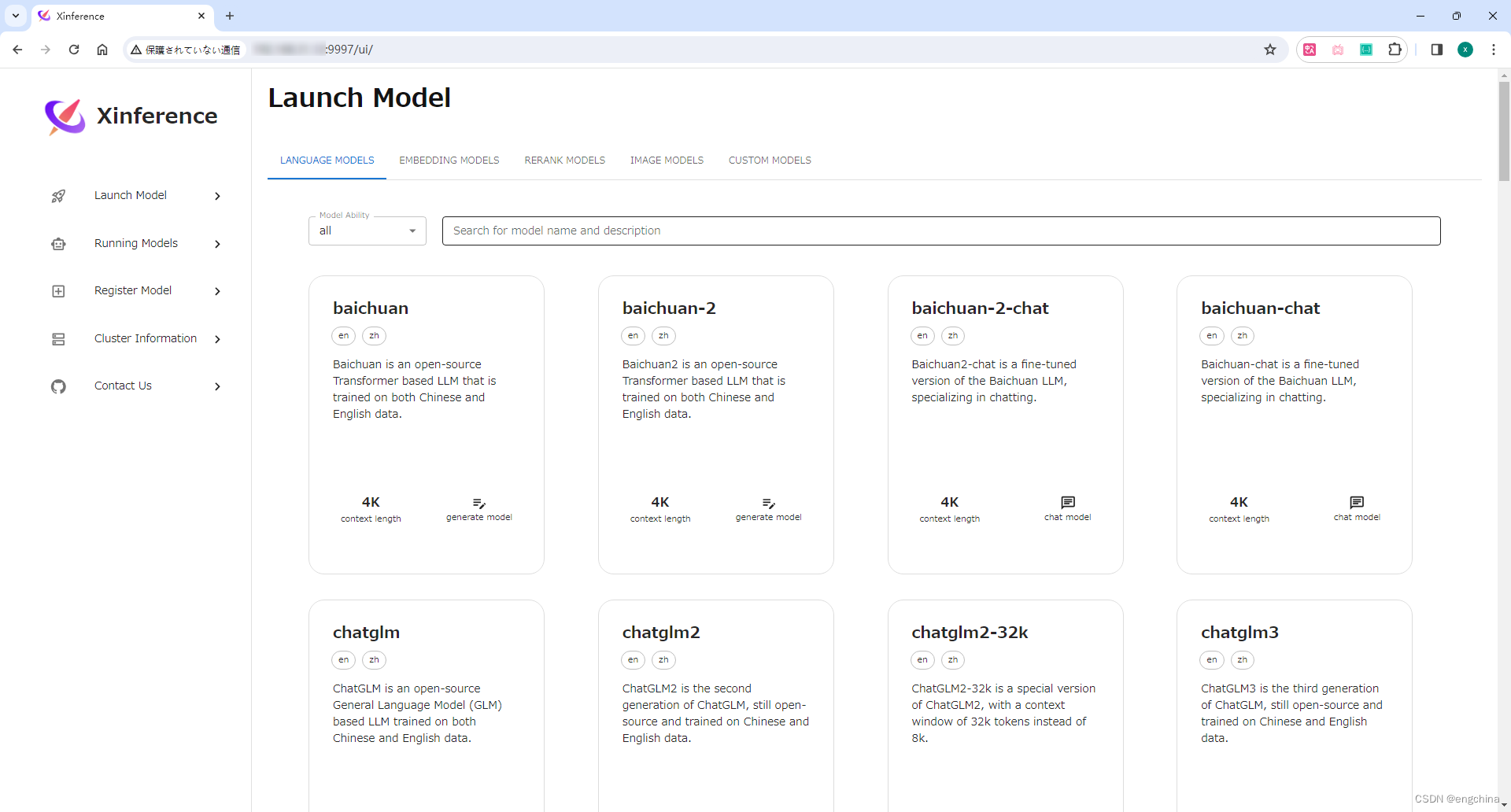

启动后的画面,

1. 创建虚拟环境

conda create -n xinference python=3.10 -y

conda activate xinference

2. 安装 pytorch

conda install pytorch==2.0.1 torchvision==0.15.2 torchaudio==2.0.2 pytorch-cuda=11.8 -c pytorch -c nvidia

3. 安装 llama_cpp_python

pip install https://github.com/abetlen/llama-cpp-python/releases/download/v0.2.55/llama_cpp_python-0.2.55-cp310-cp310-win_amd64.whl

refer: https://github.com/abetlen/llama-cpp-python

4. 安装 chatglm-cpp

pip install https://github.com/li-plus/chatglm.cpp/releases/download/v0.3.1/chatglm_cpp-0.3.1-cp310-cp310-win_amd64.whl

refer: https://github.com/li-plus/chatglm.cpp

5. 安装 Xinference

pip install "xinference[all]"

refer: https://github.com/xorbitsai/inference

6. 设置 model 路径

在我的电脑上设置环境变量,路径请根据各自环境修改。

XINFERENCE_HOME=F:\XinferenceCache

7. 启动 Xinference

xinference-local -H <your_ip>

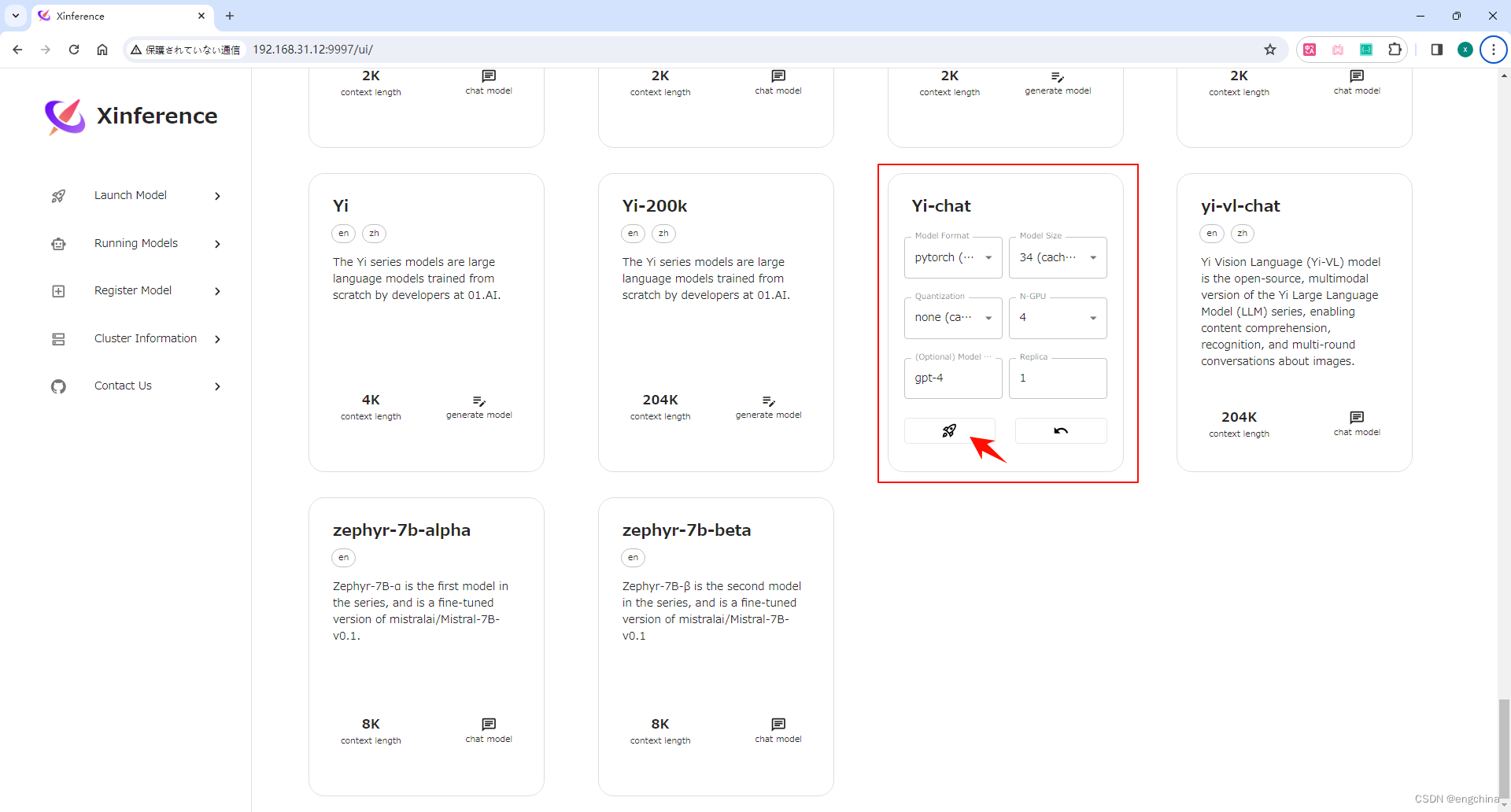

选择一个 Model 运行,

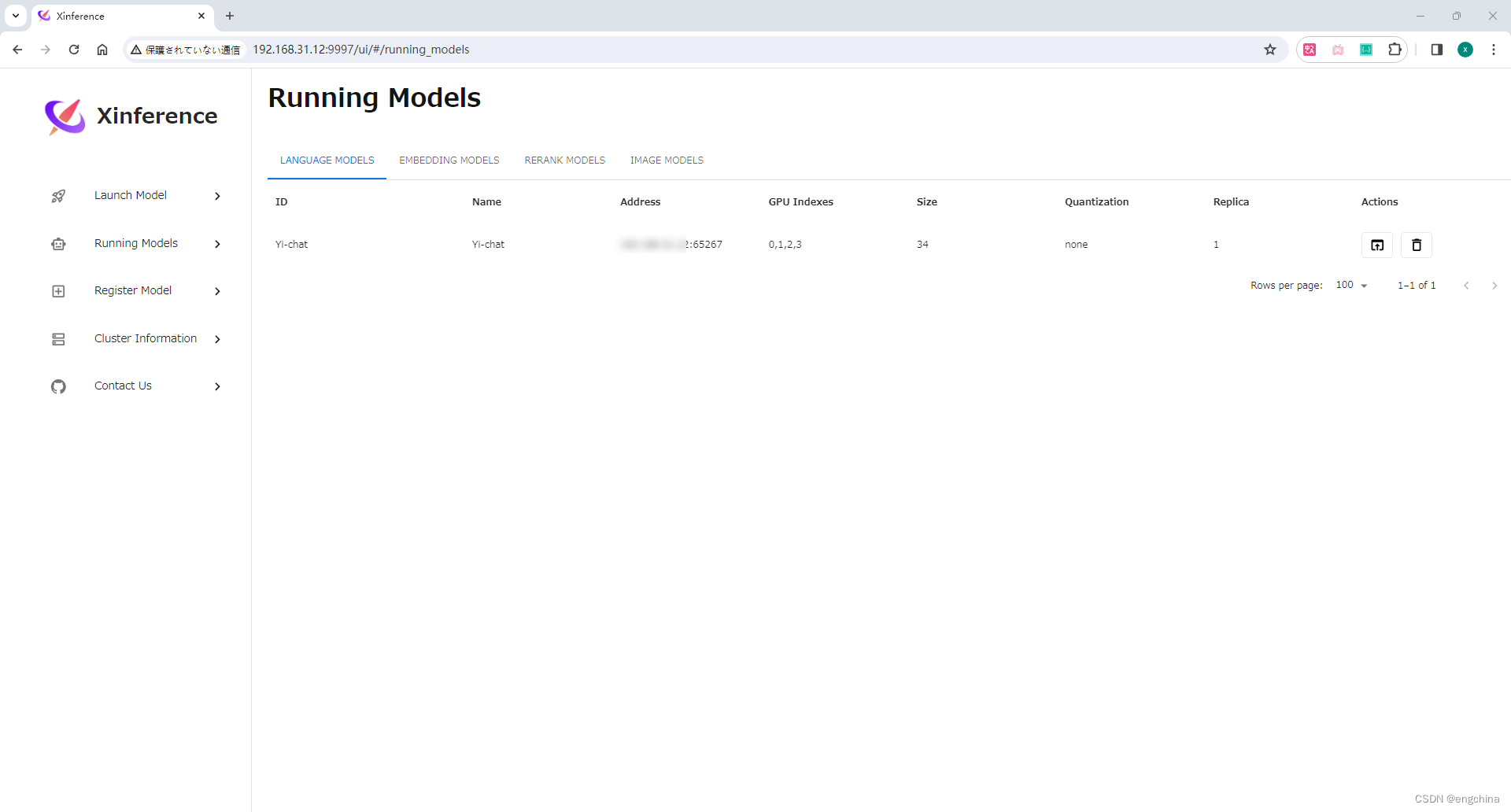

运行成功后,在 “Running Models” 页面可以查看,

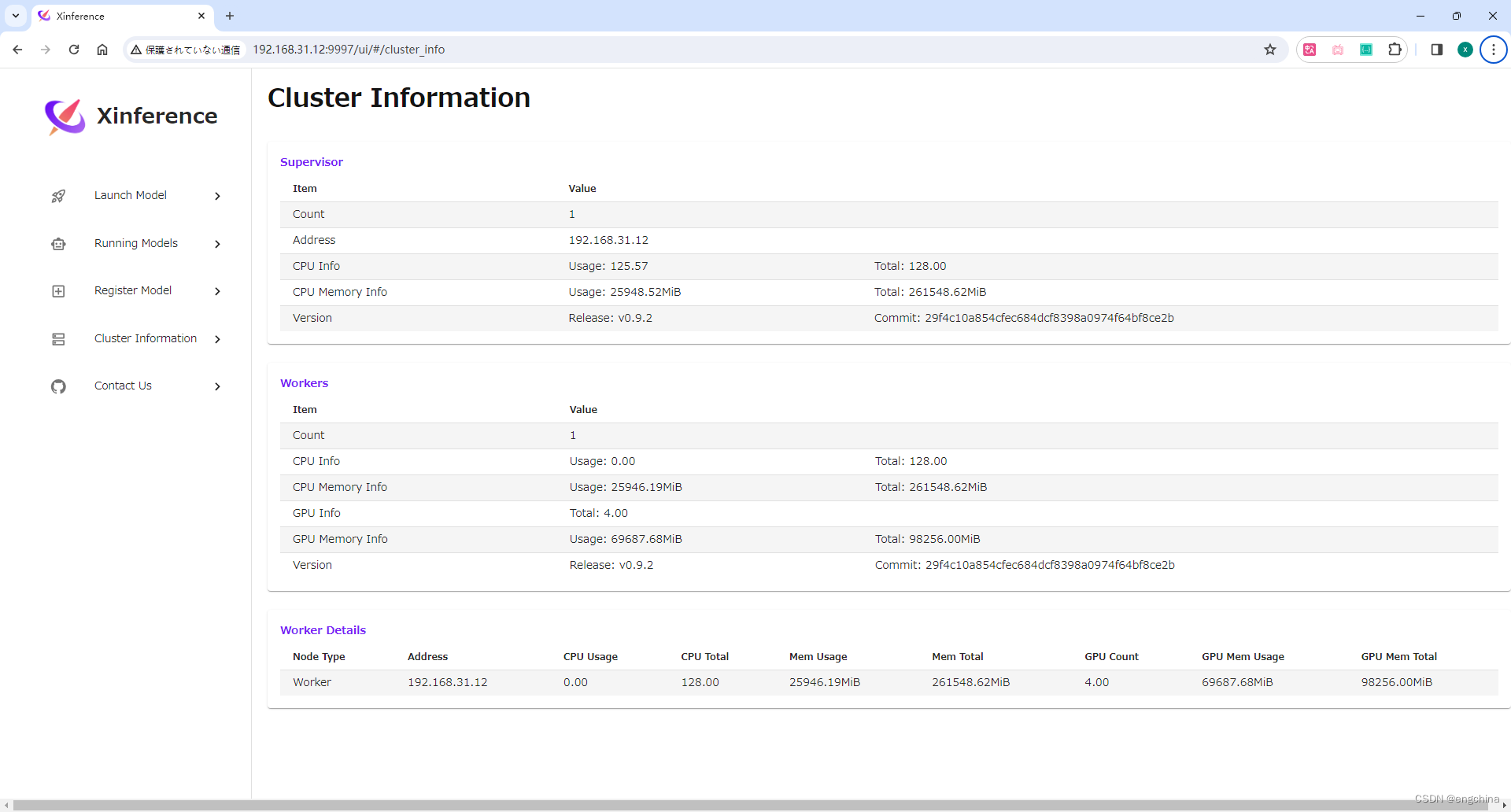

8. 查看 Cluster Information

点击 Cluster Information,

完结!

3407

3407

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?