机器学习基石

机器学习基石笔记,笔记总要自己做过才有用啊

FlameAlpha

荒诞之余也常伴理性,不是吗?

展开

-

台大林轩田机器学习课程笔记前言

正确的判断来自于经验,而经验来自于错误的判断。— Frederick P. Brooks本专栏为机器学习笔记文件,参考资料有《林轩田机器学习基石&技法》《机器学习》《吴恩达机器学习课堂》《神经网络与深度学习》《Sklearn 与 TensorFlow 机器学习实用指南》。感谢林轩田老师!让我入门机器学习,不再止步调包侠。详细的笔记见专栏 《机器学习基石》 和 《机器学习技法》。视频...原创 2020-05-03 18:40:18 · 1018 阅读 · 1 评论 -

机器学习基石 之 机器学习实现与可行性(Feasibility)分析

前言正确的判断来自于经验,而经验来自于错误的判断。— Frederick P. Brooks本文为机器学习笔记文件,参考资料有《林轩田机器学习基石&技法》《机器学习》《吴恩达机器学习课堂》《神经网络与深度学习》《Sklearn 与 TensorFlow 机器学习实用指南》。什么是机器学习(Machine Learing)首先我们应该弄清楚什么是学习。learning: a...原创 2020-04-24 10:43:45 · 1960 阅读 · 4 评论 -

机器学习基石 之 线性回归(Linear Regression)

线性回归(Linear Regression)理论实现最简单的想法是y≈∑i=0dwixiy \approx \sum _ { i = 0 } ^ { d } w _ { i } x _ { i }y≈i=0∑dwixi线性回归的假设函数为: h(x)=wTxh(\mathrm{x}) = \mathrm{w}^{T} \mathrm{x}h(x)=wTx。类似于 percept...原创 2020-04-24 10:45:27 · 704 阅读 · 0 评论 -

机器学习基石 之 逻辑回归(Logistic Regression)

逻辑回归(Logistic Regression)软性二分类(Soft Binary Classification)逻辑回归实际上是一种软性二分类(Soft Binary Classification),与 硬性二分类(Hard Binary Classification)的区别是数据一致,但是目标函数不同,软性二分类的目标是给出分类结果为正负样本的概率分别为多少,比如预测是否发放信用卡时,不...原创 2020-04-24 10:45:56 · 578 阅读 · 0 评论 -

机器学习基石 之 多分类(Multi-Classification)

多分类(Multi-Classification)One-Versus-All (OVA) Decomposition以逻辑回归为例,其思路是将其中一类和剩下的类分开,做二分类,并对全部类做次操作,这样便有了K个逻辑回归分类器,只要取其中概率最大hypothesis所对应的分类作为分类结果即可。for k∈Yk \in \mathcal { Y }k∈Y , obtain w[k]\ma...原创 2020-04-24 10:46:26 · 929 阅读 · 0 评论 -

机器学习基石 之 非线性转换(Nonlinear Transformation)

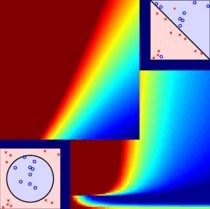

非线性转换(Nonlinear Transformation)前面讲了许多线性模型,但是假如数据并不是线性可分的,该如何处理呢?基本思路是将数据样本(特征)空间 X\mathcal{X}X 映射到 Z\mathcal{Z}Z 空间后,在 Z\mathcal{Z}Z 空间数据是线性可分的话,便可以在 Z\mathcal{Z}Z 空间上使用线性模型对数据分析。那么该映射叫做非线性特征转换 Φ\Ph...原创 2020-04-24 10:46:49 · 2136 阅读 · 0 评论 -

机器学习基石 之 正则化(Regularization)与验证(Validation)

过拟合与欠拟合(under & over)欠拟合(underfitting): EinE_{\text {in}}Ein较高,EoutE_{\text {out}}Eout也较高。过拟合(overfitting): EinE_{\text {in}}Ein较低,EoutE_{\text {out}}Eout却较高。(例如数据中有噪声,却使用了高次多项式非线性转换,便会出现过拟合...原创 2020-04-24 10:47:30 · 1229 阅读 · 0 评论 -

机器学习基石 之 三大学习原则(Three Learning Principles)

三大学习原则(Three Learning Principles)奥卡姆剃刀 ‘Occam’s razor’引用两个名言An explanation of the data should be made as simple as possible, but no simpler. —Albert Einsteinentia non sunt multiplicanda praeter n...原创 2020-04-24 10:47:53 · 971 阅读 · 0 评论

分享

分享