在 Windows 环境下安装 Ollama 及 Ollama 使用技巧

Ollama 是一款支持本地部署和运行大型语言模型(LLM)的开源工具,提供简洁的命令行操作和丰富的模型库。以下是详细安装步骤与实用技巧,助你快速上手。

安装前准备

在开始安装 Ollama 之前,确保你的 Windows 系统满足以下要求:

- 系统版本:Windows 10 22H2 或更高版本。

- 硬件要求:建议至少 8GB 内存,以确保模型能够流畅运行。

- 如果你有 NVIDIA 显卡,需要安装 452.39 或更新版本的驱动程序

- 如果你有 Radeon 显卡,需要安装 AMD Radeon 驱动程序 https://www.amd.com/en/support

一、安装步骤

1. 下载安装包

- 访问 Ollama 官网 ,点击 Download for Windows 获取安装程序(文件名为

OllamaSetup.exe)。 - 注意:国内用户可能因网络问题下载缓慢,建议使用稳定的网络环境。

- 这里我的技巧是把下载链接复制下来,用迅雷下载。下载链接:

https://ollama.com/download/OllamaSetup.exe

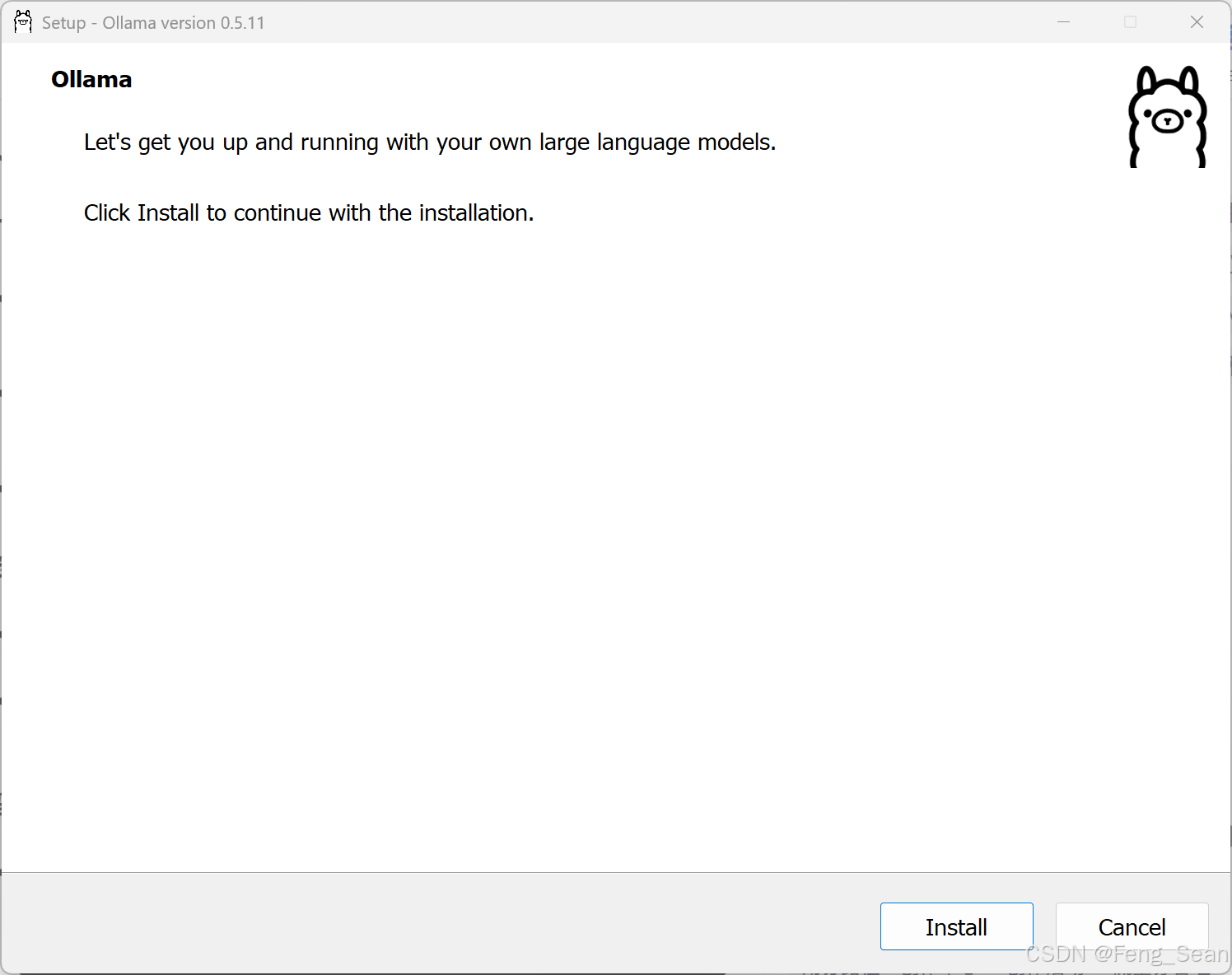

2. 安装程序

-

双击安装包

OllamaSetup.exe

-

点击“Install”按钮,开始安装。默认路径为

C:\Users\用户名\AppData\Local\Programs\Ollama。 -

【安装技巧】如果要将 Ollama 应用程序安装在不同于用户目录的位置,请使用以下方式启动安装程序,开始-运行-cmd,切换到安装程序目录,输入以下命令,启动安装程序:

.\OllamaSetup.exe /DIR="D:\Develop\ollama"

推荐这种安装方法,释放系统盘空间。如果已经安装到系统盘了,用这个方法也可以释放系统盘的空间(将近4.7GB)。

- 安装完成后,安装程序会自动退出。

3. 验证安装

- 打开 CMD 或 PowerShell,输入以下命令:

ollama --version - 若显示版本号(如

ollama version is 0.5.11),则安装成功。

4. 修改模型存储路径(推荐)

- 模型一般存储在默认路径

C:\Users\用户名\.ollama中,会占用很大的系统盘存储空间。 - 为避免占用系统盘空间,可通过环境变量设置模型存储位置:

- 右键 此电脑 → 属性 → 高级系统设置 → 环境变量。

- 新建用户变量:

- 变量名:

OLLAMA_MODELS - 变量值:自定义路径(如

D:\models\Ollama)

- 变量名:

- 重启电脑使配置生效。

二、基础使用技巧

1. 下载与运行模型

- 查看官方模型库:访问 Ollama 模型库 ,选择所需模型(如

llama3、gemma等),执行命令:ollama run llama3.2 # 下载并运行模型 - 资源建议:

- 7B 模型需至少 8GB 内存,13B 需 16GB,34B 需 32GB1。

2. 模型管理命令

- 查看本地模型列表:

ollama list - 删除模型:

ollama rm 模型名称 # 如 ollama rm gemma2:9b - 复制模型:

ollama cp 原模型名 新模型名 # 如 ollama cp qwen2:0.5b Qwen2-0.5B

3. 启用 GPU 加速(需 NVIDIA 显卡)

- 安装最新显卡驱动及 CUDA 工具包。

- 设置环境变量

CUDA_VISIBLE_DEVICES=0,确保 Ollama 优先调用 GPU。

4. 开放远程访问

- 若需通过其他设备访问本地 Ollama,设置环境变量:

重启服务后生效。OLLAMA_HOST=0.0.0.0:11434 # 开放端口 11434

常见问题

- 下载速度慢:尝试更换网络环境或使用代理。可以参考我的文档文章,解决Ollama下载模型越来越慢的问题:《Ollama下载模型越来越慢的解决办法》

- 显存不足:选择更小参数的模型(如

gemma:2b)。 - 端口冲突:修改

OLLAMA_HOST变量指定其他端口。

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?