1、Hive简介

基于SQL on Hadoop的有Hive、SparkSQL、Phonix(主要是用于Hbase上的查询,也支持SparkSQL等),Impala(用来做交换式查询的)等。

Hive是Apache的一个开源顶级的项目,官网:http://hive.apache.org/ 源码:https://github.com/apache/hive

Hive是数据仓库,由Facebook贡献,使用SQL进行大数据的处理和分析,但底层解析成MapReduce计算。

Hive本身是没有存储的,底层还是存储在HDFS上的,所以Hive仅仅相当于一个客户端,只需要部署一台就行了,也不需要做热备。

Hive版本现在主要是1.x和2.x,区别是2.x可以支持运行在Spark上面,但是现在生产上2.x还是比较少,还不够稳定,有很多bug;1.x的最后一个版本是hive-1.2.1,之后就是2.x。

2、安装部署

2.1 MySQL安装

安装Hive前,先要安装好MySQL,当然你也可以选择其他数据库;因为Hive要存储元数据信息。

MySQL安装参考博客:https://blog.csdn.net/greenplum_xiaofan/article/details/97670427

2.2 安装Hive

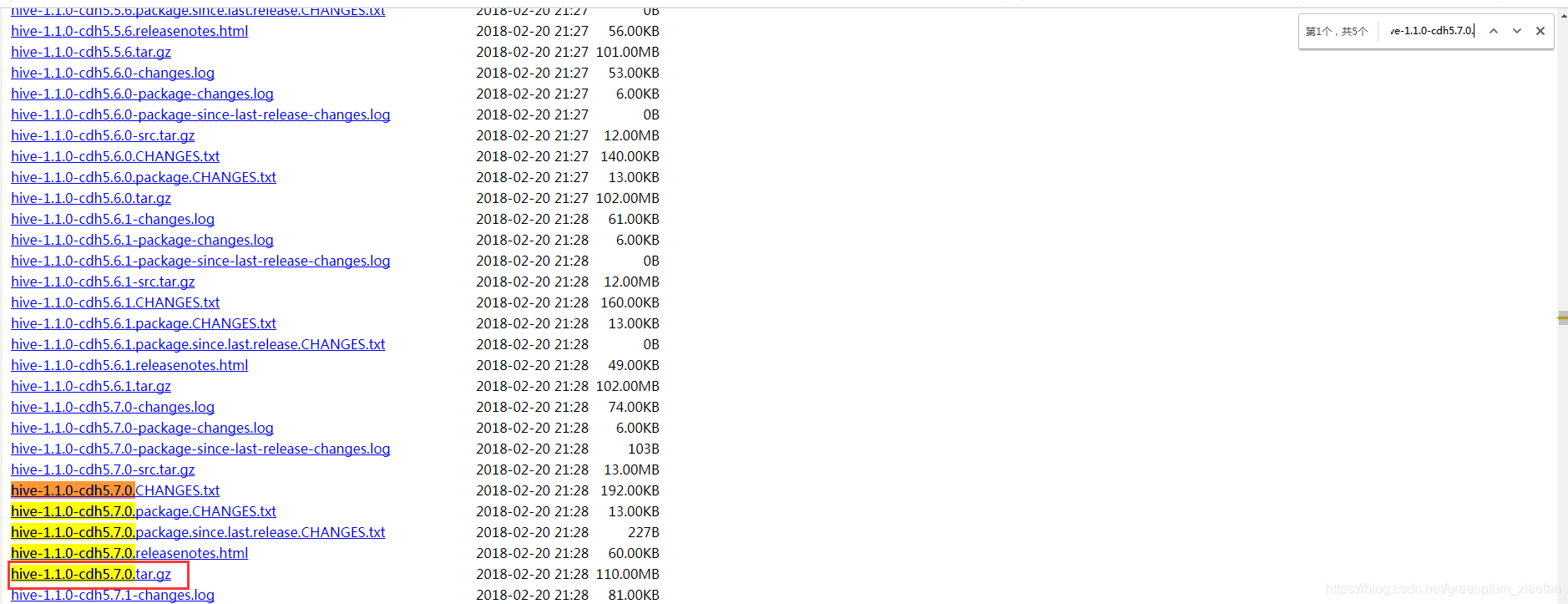

下载hive-1.1.0-cdh5.7.0.tar.gz,因为我的Hadoop版本是hadoop-2.6.0-cdh5.7.0

下载地址:(百度上搜cdh5)

http://archive.cloudera.com/cdh5/cdh/5/

上传-解压-添加环境变量

[root@vm01 ~]# su - hadoop

[hadoop@vm01 software]$ rz #上传文件

[hadoop@vm01 software]$ tar -zxvf hive-1.1.0-cdh5.7.0.tar.gz -C ../app/

[hadoop@vm01 software]$ vi ~/.bash_profile

export HIVE_HOME=/home/hadoop/app/hive-1.1.0-cdh5.7.0

export PATH=$HIVE_HOME/bin:$PATH

[hadoop@vm01 software]$ source ~/.bash_profile

添加mysql驱动

[hadoop@vm01 software]$

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

618

618

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?