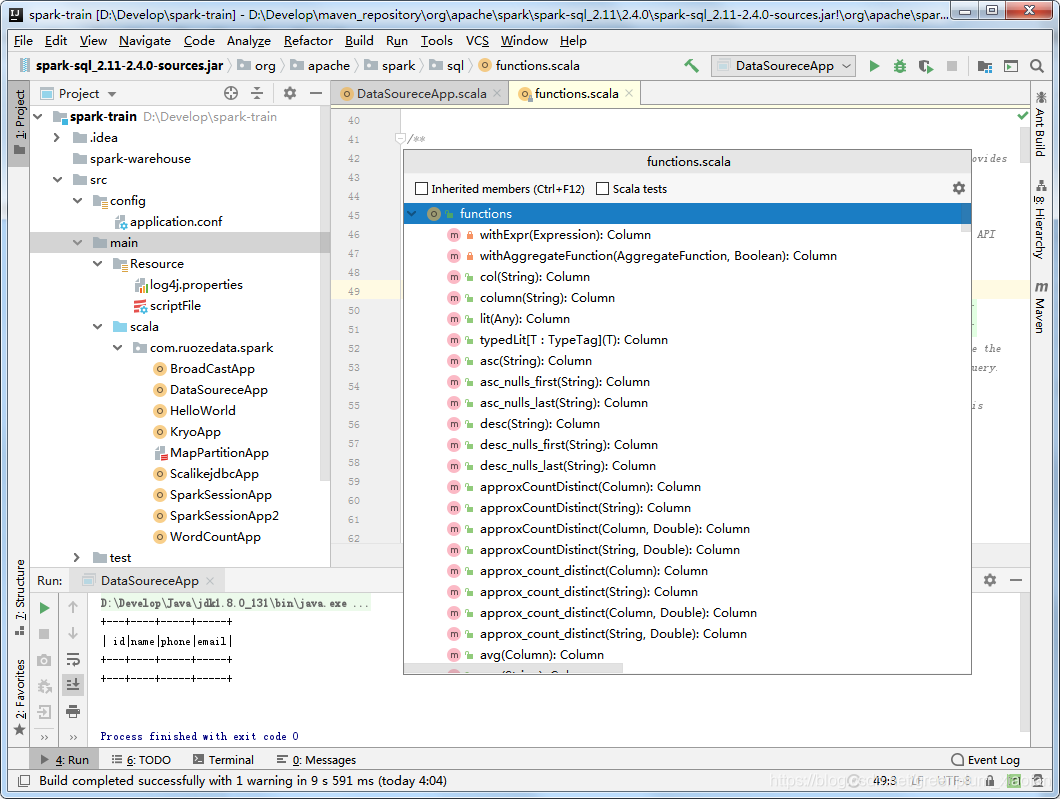

1、SparkSQL内置函数介绍

SparkSQL的内置函数全部都是在functions.scala类中,Ctrl+F12快捷键可以产看本类中的所有方法。

需要手动导入:import org.apache.spark.sql.functions._

scala> val df=spark.read.json("file:///home/hadoop/data/stu1.json")

df: org.apache.spark.sql.DataFrame = [email: string, id: string ... 2 more fields]

scala> df.show

+--------+---+--------+-----------+

| email| id| name| phone|

+--------+---+--------+-----------+

|1@qq.com| 1|zhangsan|13721442689|

|2@qq.com| 2| lisi|13721442687|

|3@qq.com| 3| wangwu|13721442688|

|4@qq.com| 4|xiaoming|13721442686|

|5@qq.com| 5|xiaowang

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

369

369

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?