**#################################################

本项目分析南京房价数据,数据来源:链家网

autho:owl

前言:本文利用网上爬取的南京二手房信息,利用R进行简单分析,数据做仅学习研究练习用,侵删

首先读取数据,数据为.csv格式

houseprice = read.csv("E:/houseprice.csv",stringsAsFactors = F)

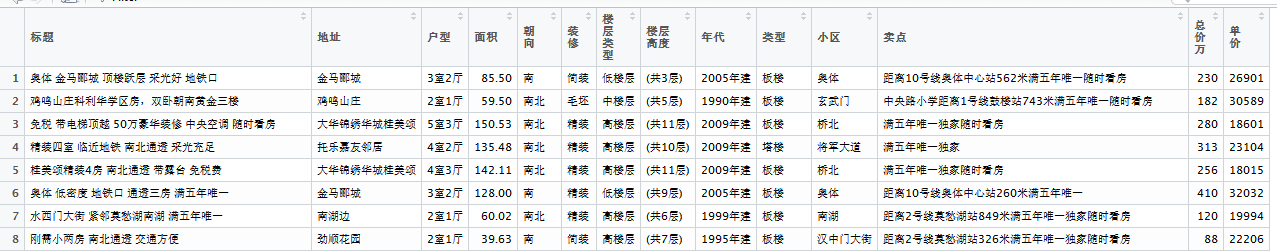

View(head(houseprice,30))

str(houseprice)修改数据类型,由于并不是所有的数据都是我们需要的,可以选择特定的数据做处理

########################################################################根据标题跟卖点进行文本挖掘,可以找出买房者与买房者比较关注的因素,将标题与卖点的字符串拼接(同时去掉数字与常用标点)

//编写函数,拼接字符串并除去数字、标点

combindString = function(s){

tem = ''

for (i in 1:length(s)) tem = paste(tem,s[i],sep = "")

tem = gsub("[0-9 ,、!?。]","",tem)

tem

}

`

title = combindString(houseprice$标题)

maidian = combindString(houseprice$卖点)

words = combindString(c(title,maidian))

`

#######

进行分词,使用Rwordseg包

`

library(Rwordseg)

library(jiebaR)`

测试Rwordseg与jiebaR分词的效果

w = "中间楼层双南东边户老虎桥小区黄金三楼户型方正黑龙江八巷南北通透全明格局精致装修星雨华府室厅万奥体万科金域缇香南北通透双阳台采光好黄金楼层采光充足黄金楼层诚心出售满两年周边配套好靠近大洋百货非常方便盛景华庭CBD中心交通便捷环境优美配套齐全常府街地铁年小区八一医院核心地段雅居乐花园学区房满两年武定门地铁中北精装三房秦淮一中心学区改善首选"

w1 = segmentCN(w,returnType = "vector")

w1

jiebaR分词

test = worker()

w2 = (test<=w)

w2

#从结果看,jiebaR更符合我们的需求,因此使用jiebaR进行分词

results<-(test<=words)

head(results)

#分好的词是一个向量,我们需要进行词频统计

#可以通过制造一个数据框,分组数数的方法

mywords<-data.frame("词汇"=results)

mywords$词频<-1

View(head(mywords,30)) #看看长什么样

#使用plyr包中的函数进行分组统计

library(plyr)

sumBygroup = function(df) sum(df[,2])

m

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

8342

8342

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?