《Fast Transformer Decoding: One Write-Head is All You Need》

核心贡献:优化 multi-head attention 为文中命名的 multi-query attention,减少多head相关运算,不降低精度 且 大幅提升解码速度。

具体对比如下:

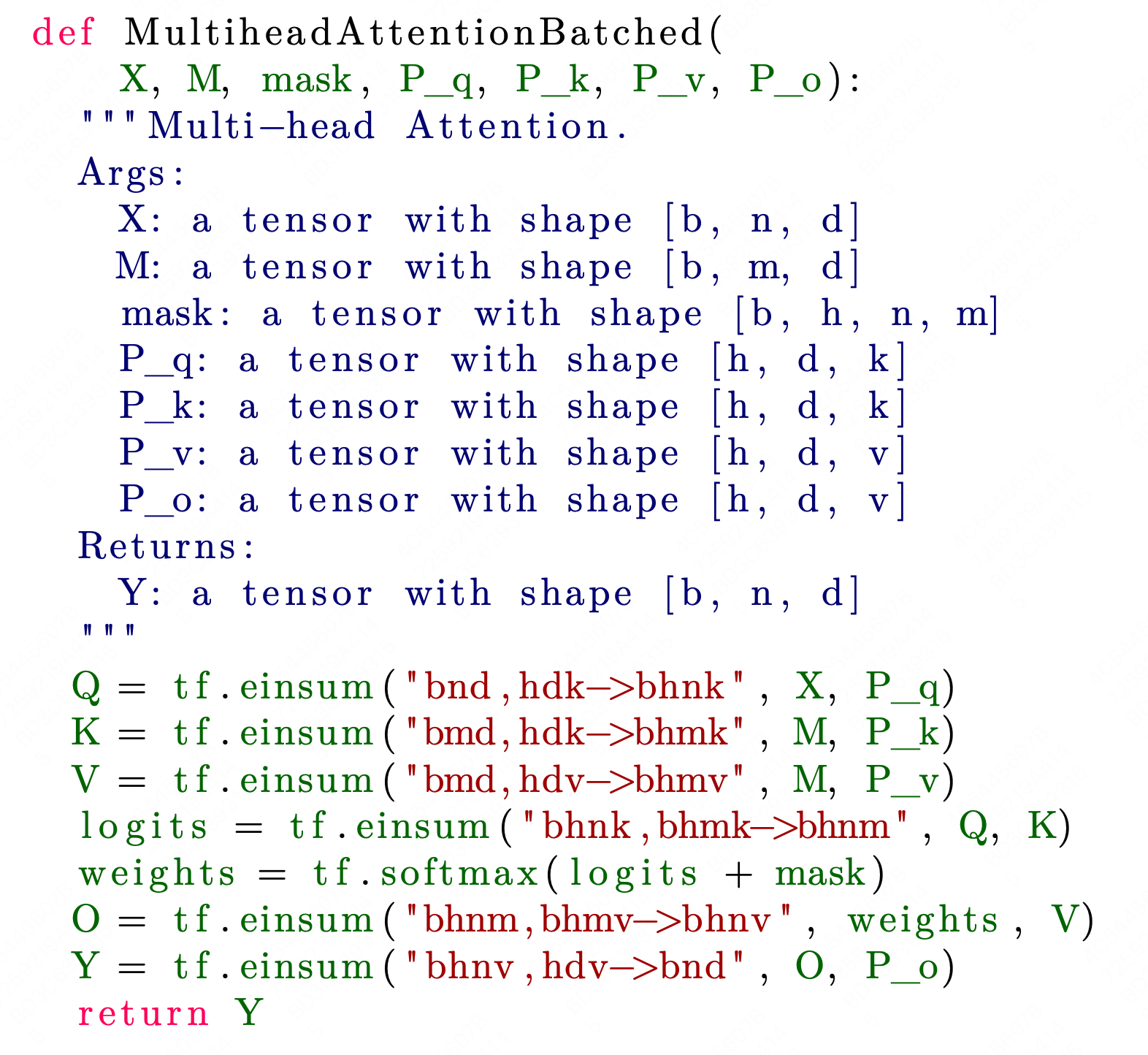

multi-head attention:

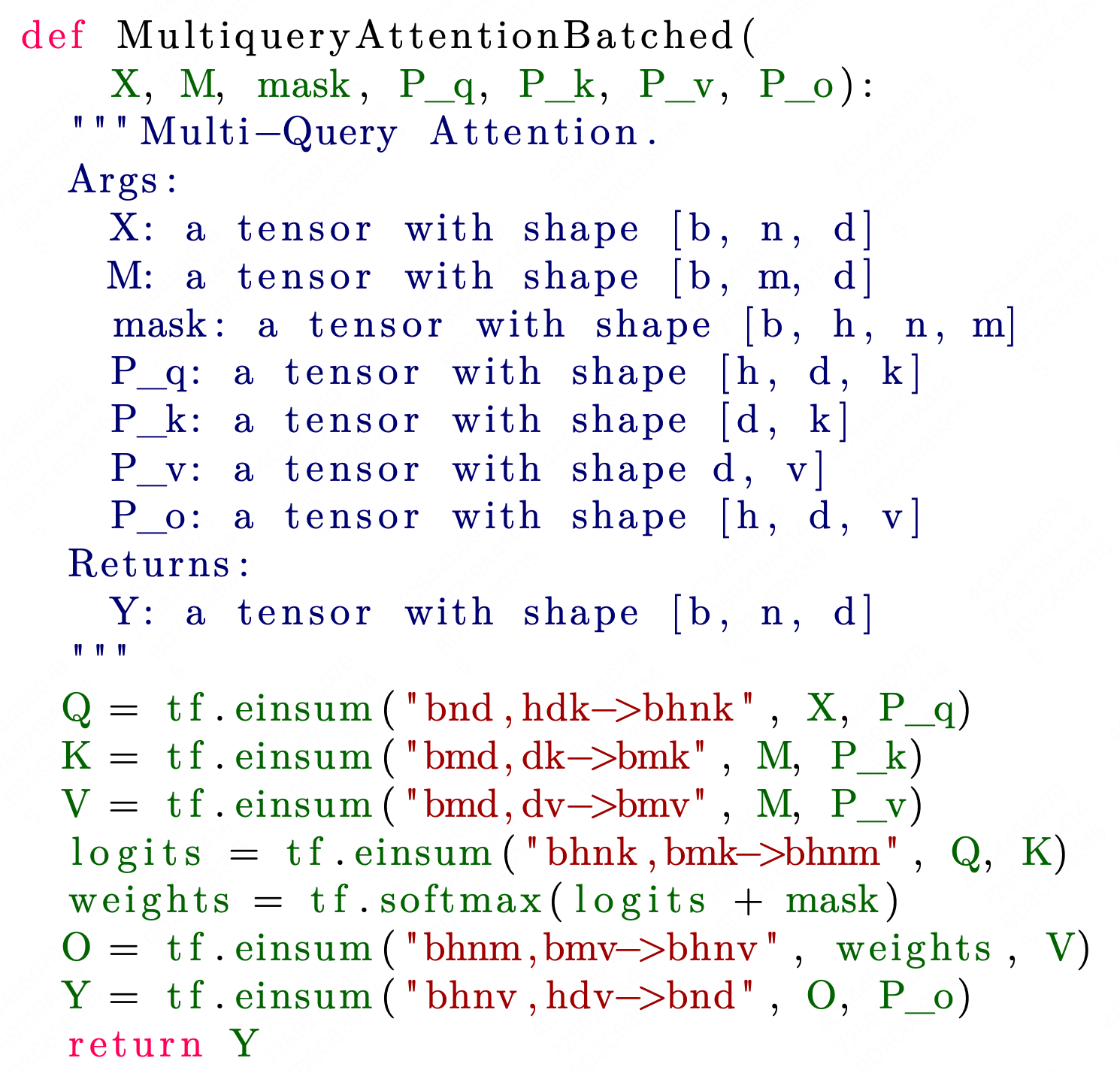

multi-query attention:

《Fast Transformer Decoding: One Write-Head is All You Need》

核心贡献:优化 multi-head attention 为文中命名的 multi-query attention,减少多head相关运算,不降低精度 且 大幅提升解码速度。

具体对比如下:

multi-head attention:

multi-query attention:

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?