一、前言

前面介绍了词库的自动生成的方法,本文介绍如何利用前文所生成的词库进行分词。

二、分词的原理

分词的原理,可以参看吴军老师《数学之美》中的相关章节,这里摘取Google黑板报版本中的部分:

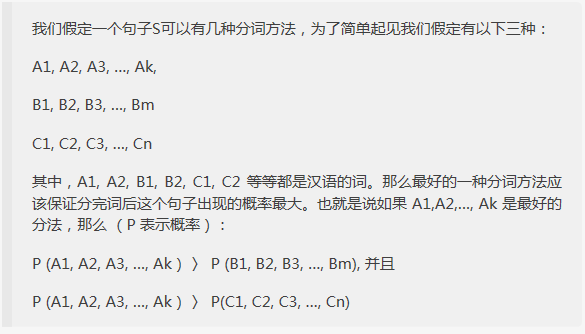

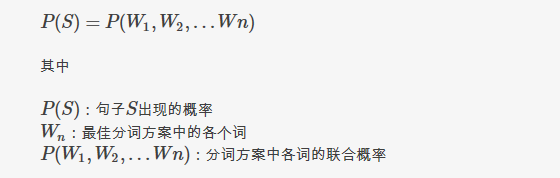

从上文中,可以知道分词的任务目标:给出一个句子S,找到一种分词方案,使下面公式中的P(S)最大:

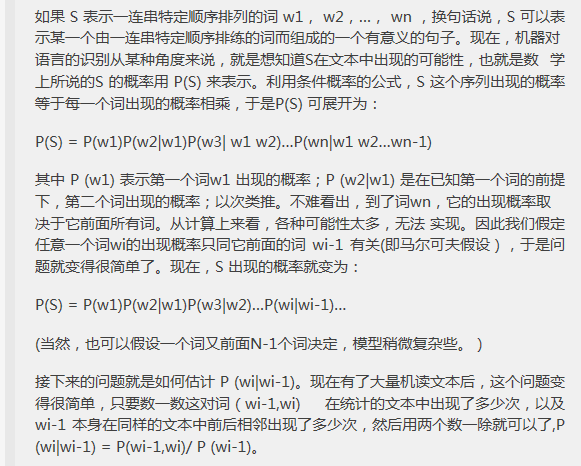

不过,联合概率求起来很困难,这种情况我们通常作马尔可夫假设,以简化问题,即:任意一个词wi的出现概率只同它前面的词 wi-1 有关。

关于这个问题,吴军老师讲的深入浅出,整段摘录如下:

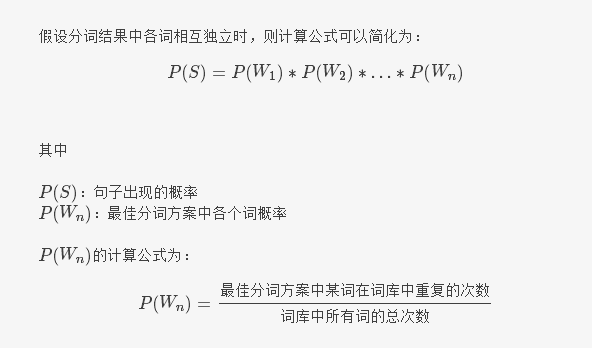

另外,如果我们假设一个词与其他词都不相关,即相互独立时,此时公式最简,如下:

这个假设分词无关的公式,也是本文所介绍的分词算法所使用的。

三、分词的实现

1、算法分析

问:假设分词结果中各词相互无关是否可行?

答:可行,前提是使用遗忘算法系列(二)中所述方法生成的词库,理由如下:

<

本文介绍了如何利用生成的词库进行分词,通过马尔可夫假设简化问题,提出一种无监督的分词算法,该算法具有O(N)级时间复杂度,词库自维护且支持多语种混合分词。文章提供了实现代码和演示程序下载。

本文介绍了如何利用生成的词库进行分词,通过马尔可夫假设简化问题,提出一种无监督的分词算法,该算法具有O(N)级时间复杂度,词库自维护且支持多语种混合分词。文章提供了实现代码和演示程序下载。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1485

1485

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?