周末总结

周末花6.5k的4060ti主机到家了,配好了和女朋友一起玩了两天帕鲁,真好玩!

玩完开始上班!

今天,上午先看三篇paper,然后下午继续1日计划的工作

文章阅读

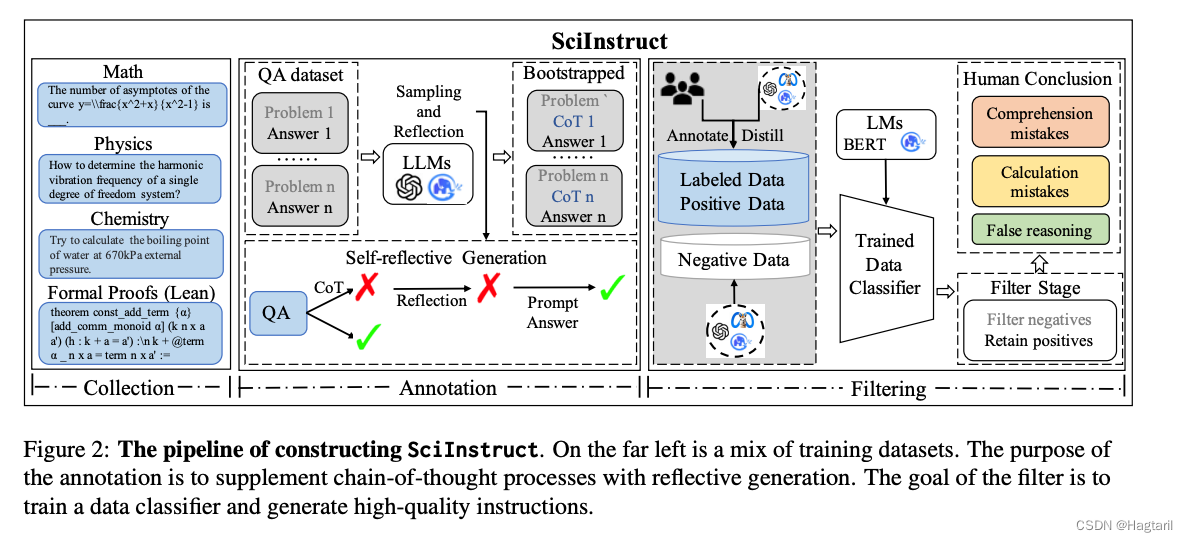

文章一:SciGLM: Training Scientific Language Models with Self-Reflective Instruction Annotation and Tuning

https://github.com/THUDM/SciGLM

通过自动纠错生成SciInstruct数据集,在SciInstruct数据集上训练ChatGLM得到优于baseline(ChatGLM)的模型。

-

“从互联网上获得的用于科学问题的指令数据的规模远小于其他任务。科学内容通常需要更高级别的专业知识才能创建,且大多数高质量信息经常受到知识产权的保护。我们能合法访问的大多数数据只包含问题-答案(QA)对,而没有详细的思考链条推理步骤。然而,仅仅训练大型语言模型(LLMs)使用QA对会导致非常糟糕的结果,甚至损害它们的通用语言能力。为了获得高质量的推理步骤作为指令(I

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?