《Context-aware Natural Language Generation with Recurrent Neural Networks》

使用循环神经网络的上下文感知自然语言生成

1.背景

传统的自然语言生成(可以理解为NMT)中,只是开始生成的时候才用到了编码时生成的向量,这篇论文主要针对该问题做出相应的改进,在后续生成过程中使用编码时生成的向量。

2.大体框架

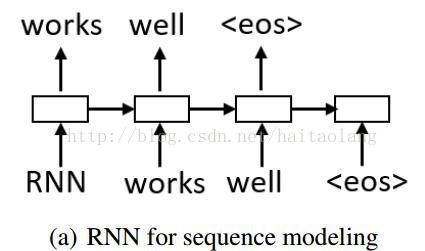

2.1传统方式

这就是一个传统的RNN模型

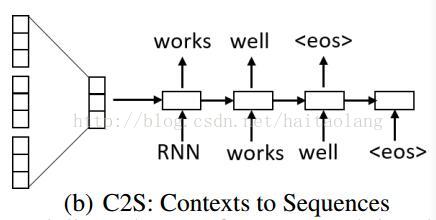

2.2 C2S

C2S: Context to Sequence

相比于传统方式,C2S在刚开始翻译的时候多了一个总上下文表示的参数

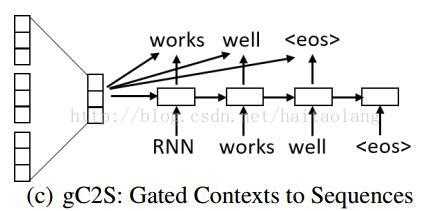

2.3 gC2S

gC2S: gating of Context to Sequence (大体意思是这样)

为了继续改进模型,则需要在后面的生成过程中继续引用上下文信息,但是考虑到不是所有步骤都跟上下文有着紧密的关联,这时候就增加了一个门gate,用于评价当前步骤与上下文的关系。

3.主要公式

论文中对公式的解释不是很清楚,只要理解大体意思即可。

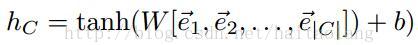

3.1 C2S

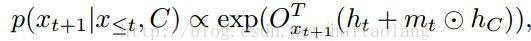

3.2 gC2S

论文链接:https://arxiv.org/abs/1611.09900v1

374

374

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?