版权归属:

更多关注:

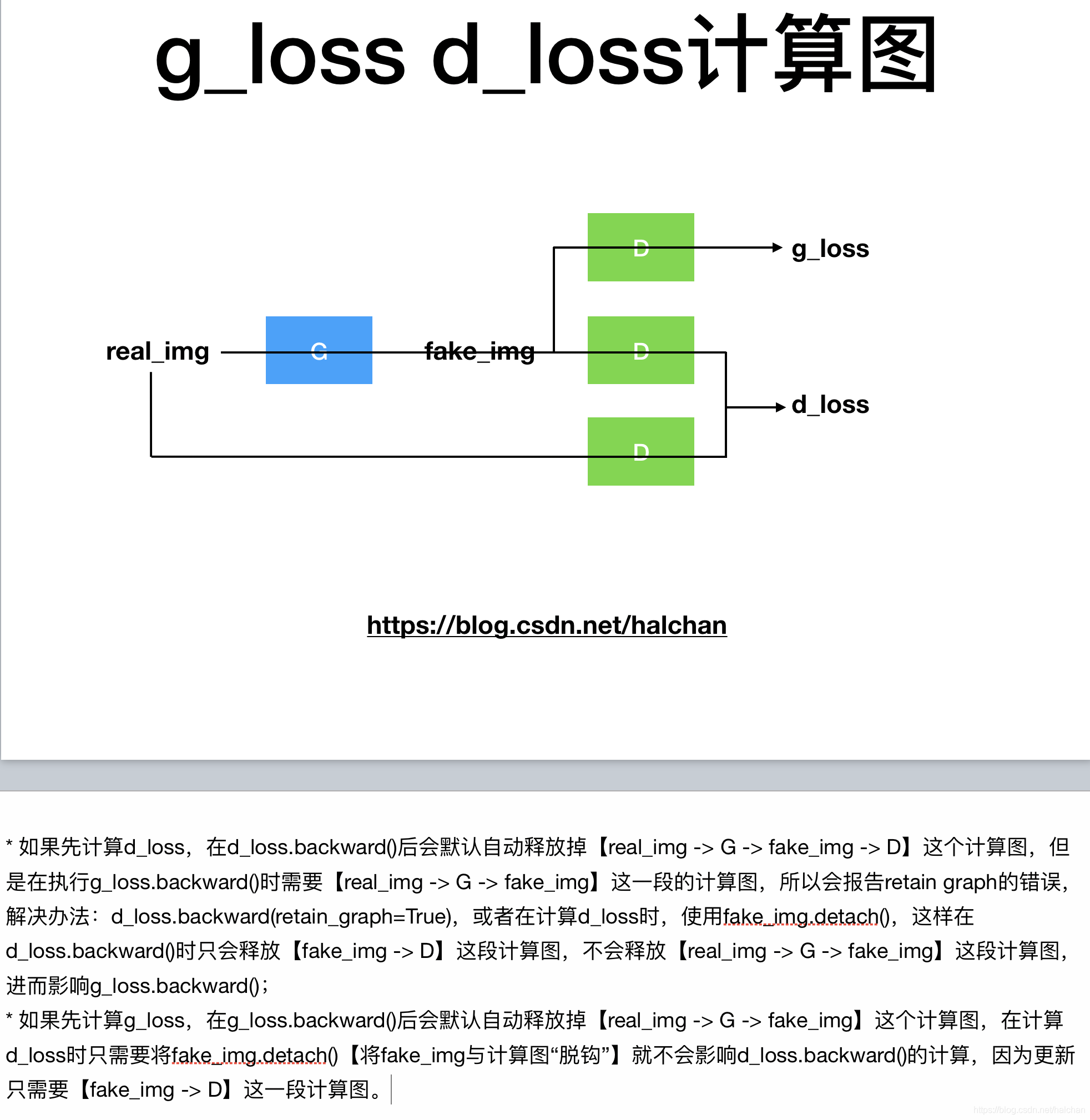

- 如果先计算d_loss,在d_loss.backward()后会默认自动释放掉【real_img -> G -> fake_img -> D】这个计算图,但是在执行g_loss.backward()时需要【real_img -> G -> fake_img】这一段的计算图,所以会报告retain graph的错误,解决办法:d_loss.backward(retain_graph=True),或者在计算d_loss时,使用fake_img.detach(),这样在d_loss.backward()时只会释放【fake_img -> D】这段计算图,不会释放【real_img -> G -> fake_img】这段计算图,进而影响g_loss.backward();

- 如果先计算g_los

本文探讨了在对抗神经网络GAN中,d_loss和g_loss的反向传播过程中计算图的保留问题。若先计算d_loss,需使用retain_graph=True或detach()避免影响g_loss;反之,若先计算g_loss,detach()fake_img即可不影响d_loss的计算。参考了相关知乎文章进行深入解析。

本文探讨了在对抗神经网络GAN中,d_loss和g_loss的反向传播过程中计算图的保留问题。若先计算d_loss,需使用retain_graph=True或detach()避免影响g_loss;反之,若先计算g_loss,detach()fake_img即可不影响d_loss的计算。参考了相关知乎文章进行深入解析。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?