联邦学习是一种特殊的分布式机器学习,跨多个局部数据集训练模型,在保护用户隐私的同时,提高数据利用率提升模型性能。本文总结了联邦学习目前的一些热门研究方向,个人拙见,仅供参考。

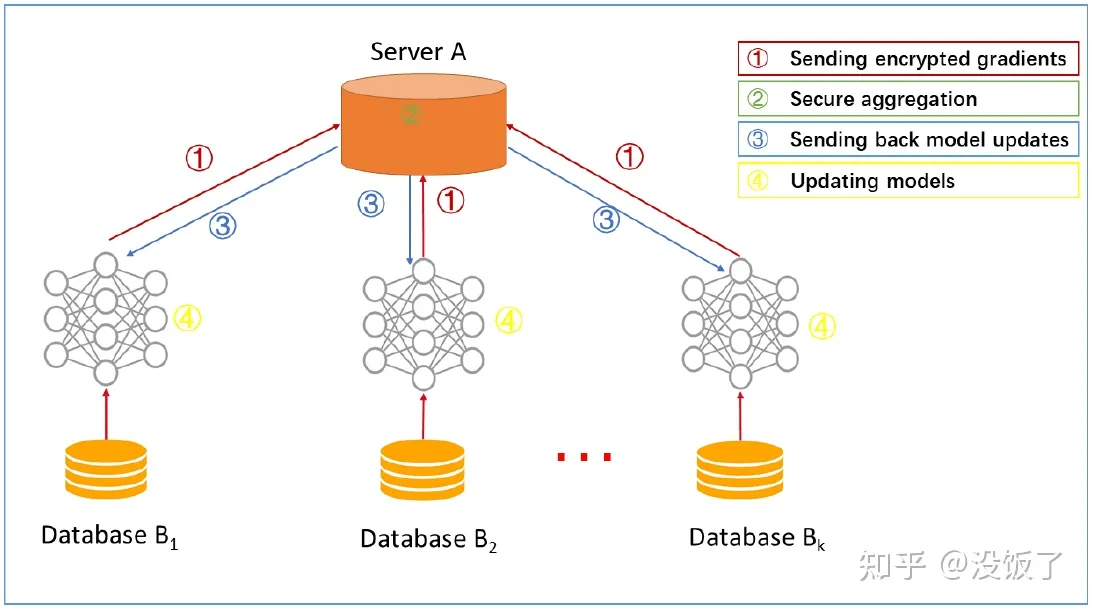

横向联邦学习架构

1. 隐私保护和安全

(1)差分隐私: 研究如何在不泄露个人信息的前提下分享信息。

(2)安全多方计算: 允许多方在保持各自数据私密的情况下,共同进行计算。

(3)对抗性攻击和防御: 开发新的算法和策略来抵抗对抗性攻击,保护模型不被欺骗。

2. 通信效率

(1)模型压缩(量化、稀疏化和参数剪枝等): 减少需要传输的数据量,以减轻通信负担,同时保持或提高性能。

(2)定期发送:本地训练多个Epoch后再向服务器发送更新的模型,而不是仅训练一次。

3. 联邦学习算法和优化

(1)异构数据: 提高模型在面对数据分布不均匀(非独立同分布,non-IID)时的性能。

(2)多任务学习: 开发算法以在不同任务间更有效地共享知识(知识蒸馏)。

4. 跨领域和跨语言联邦学习

(1)跨垂直行业应用: 如在医疗、金融等领域的特定应用。

(2)跨语言模型训练: 研究如何使用联邦学习方法训练多语言模型。

5. 可扩展性和部署

(1)联邦学习框架和平台: 开发更加高效、易用的框架和平台,支持大规模联邦学习。

(2)边缘联邦学习: 将联邦学习与边缘计算结合,以利用边缘设备的计算资源。

6. 公平性和透明度

(1)算法公平性: 确保模型对所有参与者公平,无偏见。

(2)可解释性和透明度: 增强模型的解释能力,让非专业人士也能理解模型的决策过程。

这些研究方向反映了联邦学习领域内对于隐私保护、效率、可扩展性以及公平性等关键问题的关注。随着存储、算力和大模型等技术的发展,这些研究方向会继续扩展。

参考文献

[1]Yang Q, Liu Y, Chen T, et al. Federated machine learning: Concept and applications[J]. ACM Transactions on Intelligent Systems and Technology (TIST), 2019, 10(2): 1-19.

[2]P. Kairouz et al., “Advances and open problems in federated learning,”2019, arXiv:1912.04977.

[3] T. Li, A. K. Sahu, A. Talwalkar, and V. Smith, “Federated learning: Challenges, methods, and future directions,” IEEE Signal Process. Mag., vol. 37, no. 3, pp. 50–60, May 2020.

481

481

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?