LLM

文章平均质量分 95

大语言模型相关的工作和文章

HERODING77

上海人工智能实验室Research Engineer,硕士就读于华东师范大学数据科学与工程专业,本科就读于大连理工大学软件工程专业,兴趣方向为GUI Agent,LLM,NLP。

展开

专栏收录文章

- 默认排序

- 最新发布

- 最早发布

- 最多阅读

- 最少阅读

-

【论文通读】Cross-model Control: Improving Multiple Large Language Models in One-time Training

一个很有想法的工作,直面当前低资源场景下微调迁移的困难及挑战,并采用一个小模型引导大模型的方式来实现跨模型的知识迁移。该工作中稿于NeurIPS 2024,并且获得了评审的一致好评。PaperCodeFromLLMs之间知识的复用是一个挑战。本文提出CMC,采用一个轻量语言模型在一次训练中改进多个LLM。作者观察到微调前后不同模型的logit的偏移相似。基于此,作者整合了一个轻量级LLM,通过与冻结LLM一起训练,获得改变LLM输出的logits的能力。原创 2024-11-04 18:39:04 · 1158 阅读 · 4 评论 -

【论文通读】Qwen2-VL: Enhancing Vision-Language Model‘s Perception of the World at Any Resolution

当前多模态大模型的天花板,Qwen2-VL无论是通用的多模态能力还是多语言、Agent的能力,在开源模型中都是一骑绝尘的,甚至可以和商业模型如GPT-4o掰掰手腕。Qwen2-VL是经过沉淀的工作,它不只是扩数据那么简单,在很多实现细节上都进行了改进,是非常值得学习的工作。PaperCodeQwen2-VL重新定义了视觉处理中传统的预定分辨率的方法。它提出了新颖的动态分辨率机制,集成了M-RoPE(多模态旋转位置编码),并采用了统一的范式来处理图像和视频,增强模型的视觉感知能力。原创 2024-10-29 15:58:23 · 1236 阅读 · 0 评论 -

How Far Are We to GPT-4V: Closing the Gap to Commercial Multimodal Models with Open-Source Suites

InternVL系列梦开始的地方,奠定了InternVL在开源MLLMs中第一梯队的基础,其实方法简单粗暴,但是背后的数据集处理,模型训练这些dirty work,文章是永远体现不出来的,我想这也是InternVL能够中稿CVPR的关键原因吧。PaperCodeFromCVPR 2024本文提出InternVL 1.5,一个开源的MLLM用于减小与商业闭源多模态大模型的差距。更强的vision decoder。动态高分辨率。高质量中英文数据。原创 2024-10-16 16:07:27 · 846 阅读 · 0 评论 -

【论文通读】Navigating the Digital World as Humans Do: UNIVERSAL VISUAL GROUNDING FOR GUI AGENTS

SeeAct团队的后续工作,旨在通过大规模Grounding数据对开源模型进行 continuous-training以提升MLLM的Grouding能力。文章思路清晰,方法简单,介绍了很多数据处理和训练的trick,实验结果也表明本文方法显著提升了MLLM的Grounding能力。UGround是一个大的突破,但是后续还是有很多值得改进并做下去的地方。PaperGithubHomepageMLLM正在改变GUI智能体的能力,使其从仿真场景过渡到跨平台现实的应用程序。原创 2024-10-09 13:35:56 · 1543 阅读 · 0 评论 -

【论文通读】Diagnosing and Remedying Knowledge Deficiencies in LLMs via LaMer

一篇很有意思的工作,通过相对熵判断LLM在知识上的缺陷,从而合成新数据来修复模型的知识缺口。方法简单,效果不错,简洁易懂,虽然在应用场景上有很大的限制,但是也是给LLM的知识诊断与修复带来了新的思考方向。Paper大模型从大量无标注数据中学习,展现广泛的用途。然而大模型仍会面临推理错误和知识缺失的问题,影响其可靠性。虽然多样的query可以改善该问题,但是获得充分有效反馈是困难的。此外,受限于有限的标签,难以全面评估LLM,因此通过丰富的无标签查询来诊断和修复LLM 的缺陷成为一项挑战。原创 2024-09-27 16:11:46 · 1179 阅读 · 0 评论 -

【论文通读】C-EVAL: A Multi-Level Multi-Discipline Chinese Evaluation Suite for Foundation Models

一篇关于评估大模型中文能力的benchmark工作,虽然从benchmark的设计角度来看没有额外的新意,但是从故事性和切入点来说都是一个非常不错的工作。此外,文末的Conclusion部分我还对benchmark的设计原则进行了讨论,感兴趣的朋友可以直接跳到文章最后部分查看。PaperCodeFromC-EVAL是第一个全面的中文benchmark用于评估LLMs在中文语境下的基础储备和推理能力。C-EVAL包含四个不同等级的多选问题:中学,高中,大学和职业。原创 2024-08-13 10:02:50 · 979 阅读 · 0 评论 -

【论文通读】Automated Peer Reviewing in Paper SEA: Standardization, Evaluation, and Analysis

一篇关于长文本大语言模型应用的相关工作,面向于自动化论文评审领域。作者提出了一个新颖的自动化论文评审框架,解决了当前大语言模型无法为论文生成有全面有价值评审意见的同时,又为自动化论文评审领域定义了一个新的评估指标。该项目不仅在工作量上投入巨大,更在创新性和应用性方面达到了新的高度,为科研工作者提供了强有力的工具,显著提升了他们的工作质量。PaperHomePageCode当前,学术论文的激增对传统评审机制造成了严重的冲击,造成出版物质量不一。原创 2024-07-19 11:28:29 · 1470 阅读 · 0 评论 -

【论文通读】RuleR: Improving LLM Controllability by Rule-based Data Recycling

一篇关于提升LLMs输出可控性的短文,对SFT数据以规则的方式进行增强,从而提升SFT数据的质量,进而间接帮助提升LLM的可控性。这种基于规则的方式确实可以去除人力和额外的LLM资源的开销,但是在某种程度上可能不能真正泛化到具体的数据上。PaperCodeLLMs缺乏稳定可控的输出,这对产品表现和用户体验不利。然而现有的用于提升LLMs可控性的SFT数据集经常依赖人类经验或者大模型,需要付出额外的成本。原创 2024-07-07 21:01:08 · 1217 阅读 · 0 评论 -

【论文精读】OS-Copilot: Towards Generalist Computer Agents with Self-Improvement

这是第一篇OS智能体框架工作,提出了操作系统上通用且能自我改进的AI助手FRIDAY,这与只能解决简单问题的AI助手Cortana相比有着本质的区别和显著的提升。其github仓库开放一周就收获了600+stars,受到了大量科研人员和科技企业的关注,在业界有着不俗的影响力。文章投稿于ICML 2024,为LLM智能体在OS领域的应用奠定了坚实的基础。PaperCodeFrom与计算机的自动交互一直是长期存在的挑战,最近LLM的发展加速了构建数字智能体的进展。原创 2024-02-23 18:20:38 · 2497 阅读 · 4 评论 -

【论文精读】A Survey on Large Language Model based Autonomous Agents

一篇来自人大高瓴的综述,详细介绍了基于LLM的智能体的发展和应用,以及对未来的预测。作为AI当前最火的领域,智能体上手容易,操作简单,本质上就是框架+prompt,但是其效果惊艳,能够完成很多LLM无法完成的简单任务,其在未来一定大有可为。PaperCodeFrom自主智能体一直都是学术界和工业界的重点研究焦点。先前的研究关注于具有有限知识的智能体在隔绝环境下的训练,这与人类学习方式大相径庭,因此很难像人类一样做决策。最近,LLMs通过获取的丰富web知识,在完成人类等级只能上展现出非凡的潜力。原创 2024-01-03 12:59:14 · 3393 阅读 · 0 评论 -

【论文精读】GAIA: A Benchmark for General AI Assistants

一篇来自Meta、HuggingFace、AutoGPT联合投稿的Agent Benchmark的工作,为当前百花齐放的Agent领域带来了评测的标准。这篇工作详细介绍了GAIA的设计理念,展望了GAIA的未来,讨论了当前GAIA的不足,细读下来可以看到这些大佬们对于这个当前火热领域的热切期待。PaperCodeFrom本文提出GAIA,一个通用AI助手的benchmark。GAIA提出真实世界的问题,需要一系列基本能力,如推理,多模态处理,网页浏览和一般工具使用等。原创 2023-12-11 19:18:14 · 5321 阅读 · 1 评论 -

【论文精读】REACT: SYNERGIZING REASONING AND ACTING IN LANGUAGE MODELS

一篇来自ICLR 2023的文章,可以称得上是当今火爆全网的Agent的鼻祖工作了,它提出了基于LLM初始的Agent的范式,在问答任务和决策任务上都取得了不错的结果,但是受限于LLM的能力,导致与人类的SOTA相距甚远。PaperCodeFromICLR 2023LLMs在语言理解和交互决策上表现出令人印象深刻的性能,其推理能力也作为了一个单独研究的主题。本文探索使用交互的方式生成推理任务特定动作,使二者具有更大的协同性。原创 2023-12-09 16:43:40 · 4851 阅读 · 2 评论 -

【学习笔记】LLM for Education

一篇来自Nature的文章,探讨了教育行业的不同参与者,如何抓住LLM这个变革性的工具带来的机会,重新改造这项自人类文明诞生以来就存在的行业。文中提出了当前LLM所带来的机遇与挑战,以及讨论了未来教育领域该何去何从。PaperFromNatureLLM对教育领域的冲击已经势不可挡,必然会改变教育领域的发展走势,与其闭关锁国,不如学会拥抱,勇于面对LLM对教育领域的挑战,充分挖掘LLM的潜能和优势,才是现如今教育领域面对LLM冲击下的必要措施。原创 2023-12-07 15:46:40 · 1696 阅读 · 0 评论 -

【论文精读】CAMEL: Communicative Agents for “Mind” Exploration of Large Language Model Society

一篇利用LLM通过多智能体对话的形式完成特定任务的工作,中稿于NeurIPS 2023,它最大的特色在于设计了丰富的规范约束prompt,只需要很少的人工干预,就可以让多智能体自动完成任务。PaperCodeFrom随着对话式语言模型的迅速发展,在复杂任务的解决上取得了显著的进展。然而,这些成功依赖于人类的输入来指引对话,这既具有挑战性又耗时。本文探讨了构建可扩展技术以促进沟通式智能体之间自主合作的潜力,并深入了解其认知的过程。为了解决自主合作的挑战,本文提出了一种名为角色扮演的新型沟通式智能体框架。原创 2023-12-01 18:12:25 · 2453 阅读 · 0 评论 -

【论文精读】HuggingGPT: Solving AI Tasks with ChatGPT and its Friends in Hugging Face

又是一篇利用LLM进行规划的工作,中稿于NeurIPS 2023,它充分结合了专家模型解决特定任务的能力和LLMs的理解推理能力,工作新颖但效果一般,可以说提供了一种新的利用LLM解决通用任务的范式,在思想上值得借鉴。解决具有不同领域和模态的复杂人工智能任务是迈向通用人工智能的关键,虽然现在有大量可以用的AI模型面向不同领域和模态,但是它们不能解决复杂的AI任务。LLM在自然语言任务上有出色的表现,因此作者主张LLMs充当控制者来管理当前现有的AI模型,用于处理AI任务,自然语言则成为实现该目标的通用接口。原创 2023-11-23 11:57:16 · 1831 阅读 · 0 评论 -

【论文精读】THOUGHT PROPAGATION: AN ANALOGICAL APPROACH TO COMPLEX REASONING WITH LARGE LANGUAGE MODELS

一篇来自中科院自动化所和耶鲁大学的文章,将prompt方法又卷到一个新的高度,文章提出的思维传播已经从一种方法上升到思想的境界,在任何需要使用LLM进行复杂推理任务的场景都能够大放异彩,是一篇特别fancy的文章。PaperCode无FromarXiv随着prompt技术的发展,大模型在推理任务上取得显著成功。然而现有的prompt方法无法重用解决相似问题的思路,并且在推理过程中会累积错误。为了解决这个问题,作者提出了思维传播(TP),它可以利用相似问题的解决方案来增强LLMs的复杂推理能力。原创 2023-10-23 00:02:33 · 780 阅读 · 0 评论 -

【论文精读】Chain-of-Thought Prompting Elicits Reasoning in Large Language Models

本文是CoT的开山之作,来自于Google,中稿于NeurIPS 2022。CoT是一种简单高效的大模型prompt,旨在激发大模型的推理能力,是当前热门的方向之一,很多prompt的工作都开始转向CoT。本文思路清晰,方法简单,通俗易懂,并且实验巧妙,是一篇特别值得精读的文章。PaperCodeFrom本文提出思维链,即一系列中间推理步骤,用于提升大语言模型的复杂推理能力。该方法高效简单,又被称为chain-of-thought prompting。原创 2023-10-10 11:37:25 · 7496 阅读 · 1 评论 -

【学习笔记】大模型并行化方法

最近跟着李沐老师的视频学习了深度学习分布式系统的发展。这里说是分布式系统,其实还是有点勉强,准确来说是分布式的框架,但是毕竟是系统的文章,基于提出的框架也做了很多系统上的优化,姑且算是分布式系统吧。深度学习近些年随着Transformer模型的流行,呈现出模型越来越大,层数越来越深的趋势,然而在硬件方面,由于成本和技术的限制,难以匹配模型容量的快速发展,比如现有最新的深度学习专业加速器H100,其在容量上也只有80G,连LLaMA 7B都训不起来,因此单机多卡或者多机多卡已经成为模型训练主流的硬件配置。原创 2023-09-29 00:09:30 · 1465 阅读 · 1 评论 -

【论文精读】Evaluating Large Language Models Trained on Code

本篇工作是OpenAI公司出品的Codex,也是GitHub Copilot工具背后的模型原型,其方法简单,但是效果出众,是GPT系列一大重要的落地成果,其对风险的分析也是很多产品落地值得借鉴的地方。PaperCodeFromOpenAI本文提出Codex,基于GPT语言模型,在GitHub代码上进行微调,研究其在Python上的代码能力。此外,作者构建了HumanEval数据集,用于测试模型根据注释生成代码的能力。原创 2023-09-22 23:52:56 · 1756 阅读 · 0 评论 -

【NLP经典论文精读】Language Models are Few-Shot Learners

GPT-3的技术报告,在我看来开启了大模型时代的大门,虽然GPT-3的性能和当前的大模型几乎没有可比性,但是在当时看来,一个无所不能的通用模型,能够在现实社会中产生一定的作用,已经让很多工作者兴奋不已了,所谓从0到1比从1到100更难,说的就是这个道理,如果没有GPT-3的工作,可能大模型时代还需要更长时间才能到来。最近的工作表明通过预训练和微调的范式可以在许多NLP任务中取得巨大的成果。但是微调的过程仍需上千数据,因此,本文表明通过扩大模型的规模,可以极大提高模型的小样本能力。原创 2023-08-03 10:56:41 · 2228 阅读 · 0 评论 -

【NLP经典论文精读】Language Models are Unsupervised Multitask Learners

一篇对我特别有启发的文章,虽然GPT-2的性能不尽如人意,但是其背后的思想还是特别值得学习和借鉴,如果没有GPT-2的出现,可能当今的大模型时代就不会来临。典型的自然语言理解任务都需要在特定任务下进行监督学习,然而本文证明在百万级别WebText数据集下,模型可以在没有任何显式监督情况下学习任务。语言模型的规模对于zero-shot相当重要,增加它可以以对数线性的方式提高性能。此外,作者还发现能够从自然语言演示中学习任务。原创 2023-07-29 00:04:53 · 2485 阅读 · 0 评论 -

【NLP经典论文精读】Improving Language Understanding by Generative Pre-Training

chatGPT的初代工作,可以说没有GPT,就没有现在的大模型百家争鸣,本篇文章回顾这篇经典论文,思考作者是如何根据前者的工作在思想上进行创新,从而得到通用的模型架构。自然语言理解任务繁多,虽然数据丰富,但是缺少标注数据,如何利用未标注数据是亟待解决的问题。作者通过在各种未标注的语料库上对语言模型进行生成式预训练,然后根据特定任务进行微调,可以得到很好的效果。与之前的模型相比,对架构进行了最小的修改。实验部分,GPT在12个任务中的9个达到了SOTA。原创 2023-07-25 23:08:38 · 2956 阅读 · 0 评论 -

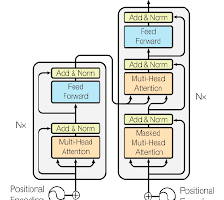

【NLP经典论文精读】Attention Is All You Need

作为和rnn、cnn一样甚至地位更高的模型架构,Transformer可谓是创造了一个全新的时代,为什么要使用attention,cnn和rnn究竟有哪些不足,为什么attention能够在语言任务上有如此优良的表现,本篇文章会给出非常细节的回答,相信会给查缺补漏的朋友一些新的思想和启发~本文提出了一个新颖简单的网络架构——Transformer,完全基于注意力机制,不需要递归和卷积。在机器翻译任务上进行实验,该模型性能好,并行性高,所需训练时长小。原创 2023-07-20 20:21:49 · 703 阅读 · 0 评论 -

【NLP经典论文精读】Prefix-Tuning: Optimizing Continuous Prompts for Generation

LLM参数有效性学习的三驾马车之一(另外两个分别是LoRA和Adapter),来自ACL 2021的prefix-tuning,受到prompt的启发,提出了一种新颖的微调范式,仅需极少的参数就能达到全量微调的性能,文章通俗易懂,但是其背后的原理才是最值得深究的地方~完整微调需要存储所有的参数,本文提出prefix-tuning,可以冻结语言模型参数,优化一系列连续的特定任务的向量,称为prefix。实验部分对GPT-2进行微调,仅修改0.1%的参数,就得到了可比较的性能,并且在低资源场景优于全量微调。原创 2023-07-18 16:56:23 · 2935 阅读 · 0 评论 -

【论文精读】QLORA: Efficient Finetuning of Quantized LLMs

一篇面向低资源大语言模型微调场景的文章,基于LoRA实现,能够将65B的大模型微调在单张48G的专业卡上,并且性能和全量微调相当,在业界引发了不小的轰动。本文将对这篇文章进行细致深入的剖析,来看看究竟运用了什么技术能够如此大幅度降低显存的需求。Paper:code:本文提出了QLORA,一种高效的微调方法,可以极大降低显存的开销,能够做到在48G的显存上微调65B参数模型,同时保留完整的16位精度。QLORA通过冻结的4位量化预训练语言模型将梯度反向传播到LoRA中。原创 2023-07-06 20:33:56 · 5501 阅读 · 0 评论 -

【NLP经典论文精读】LORA: LOW-RANK ADAPTATION OF LARGE LANGUAGE MODELS

当下大模型时代最火的低资源微调大模型方法之一,方法简单易懂,道理清晰明了,对未来的工作有很强的启发性。如果想要深入了解LoRA的底层原理,建议仔细看一看这篇文章,如果只是应用,那么简单了解就好了~大模型预训练后的全量微调往往由于算力缺口而不可行,因此本文提出低秩适应,即LoRA,它冻结了预训练模型的权重,并将可训练的低秩分解矩阵注入到Transformer的每一层,大大减少了下游任务的参数量。与GPT-3相比,LoRA可以减少10000倍的参数训练量和3倍的显存需求。原创 2023-06-18 16:14:49 · 5229 阅读 · 7 评论 -

【论文精读】InstructIE: A Chinese Instruction-based Information Extraction Dataset

一篇关于信息抽取的中文数据集构建的文章,旨在构建指令微调数据集对大语言模型进行微调,以达到对输入文本更为准确抽取其中信息的目的,阅读总结部分有我对这篇工作更为细致的看法~本文引入了一个名为的信息抽取任务,旨在要求LLM遵循特定的说明或指南来提取信息。此外构建了名为InstructIE的数据集,该数据集由来自中文维基百科的270000个弱监督数据和1000个高质量的众包注释实例组成。实验部分,InstructIE和其他模型进行了对比,还有一定的提升空间。最后总结了基于指令的IE任务现有的挑战。原创 2023-06-07 12:46:20 · 1708 阅读 · 0 评论 -

【论文精读】InstructUIE: Multi-task Instruction Tuning for Unified Information Extraction

通用抽取领域很新的一篇文章,使用指令微调的范式来指导预训练的大语言模型应用在通用抽取领域,希望能够通过这篇文章的阅读,学习当前通用抽取领域工作的思路,并找到更好的解决方案。大模型在信息抽取任务上存在困难,本文提出了InstructUIE,一个基于指令微调的统一信息抽取框架,它在32个不同信息抽取数据集上进行了验证,实验结果表明该模型实现了与bert相当的性能,并且在零样本设置中显著优于gpt3.5和领域最优。原创 2023-06-05 10:35:10 · 4196 阅读 · 2 评论 -

【论文精读】HugNLP: A Unified and Comprehensive Library for Natural Language Processing

NLP通用任务框架可以打打降低NLP任务处理的门槛,提供NLP研究人员解决NLP任务高效的处理方案,这将进一步推动NLP领域的发展,可以说是具有里程碑意义的工作~HugNLP是一个统一而全面的自然语言处理库,旨在让NLP研究人员利用现成的算法,在现实世界中使用用户定义的模型和任务开发新方法场景。其结构由模型、处理器和应用程序组成,它统一了预训练模型在不同NLP任务上的学习过程。作者通过一些特色的NLP应用如通用信息抽取、低资源挖掘、代码理解和生成等来展示HugNLP的有效性。原创 2023-05-19 13:49:35 · 367 阅读 · 0 评论 -

【论文精读】Harnessing the Power of LLMs in Practice: A Survey on ChatGPT and Beyond

一篇大规模语言模型的指南,指南介绍详细且会随着大模型的发展不断更新,相信初入大模型的朋友一定能有所收获。本文为LLM的从业者或者其下游任务用户提供了一个全面而实用的指南。首先对现有的LLM进行介绍和总结,其次讨论了预训练数据、训练数据和测试数据的影响,最重要的是,讨论了LLM在各种NLP任务下的使用条件,试图理解数据的重要性和不同NLP任务的具体挑战。定期更新的指南见。原创 2023-05-16 22:11:53 · 1630 阅读 · 0 评论

分享

分享