导语

感谢大家关注图智决策,本公众号为纯学术交流平台,主要为大家分享有关图神经网络、图上组合优化与决策、图上算法推理等前沿研究话题相关的论文及其解读。

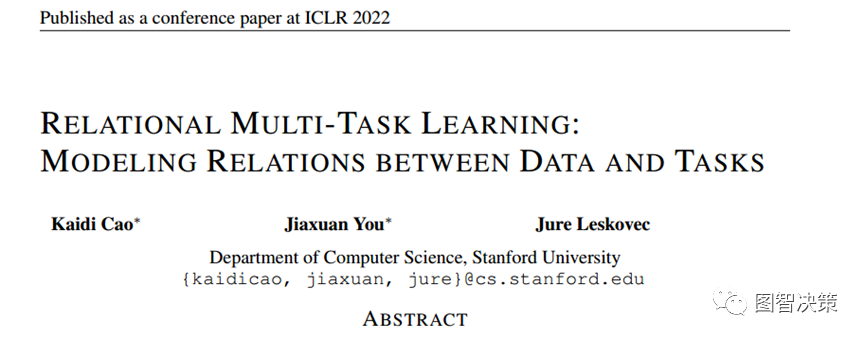

本期话题为图上的多任务学习,笔者将带领大家一起解读来自ICLR2022的一篇Spotlight论文,论文题为《关系型多任务学习:建模数据和任务之间的关系》(RELATIONAL MULTI-TASK LEARNING: MODELING RELATIONS BETWEEN DATA AND TASKS),作者来自斯坦福大学计算机科学系Jure Leskovec团队,包括共同第一作者Kaidi Cao和Jiaxuan You,以及Jure Leskovec教授。用一句话总结这篇文章的工作的亮点就是:文章提出了一个构建在数据和任务上的知识图模型MetaLink可以用于多种场景下的多任务学习。

研究领域:多任务学习,图神经网络

曾利 | 作者

Frank | 审核

文章字数:9000字 建议阅读时长:20分钟

原文链接:https://openreview.net/forum?id=8Py-W8lSUgy

代码链接:https://github.com/snap-stanford/GraphGym/tree/meta_link

汇报PPT:请在关注图智决策公众号后,发送文字消息 metalink 获得下载链接

摘要

多任务学习中的一个关键假设是,在推理时,多任务模型只能访问给定的数据,而不能访问来自其他任务的数据标签。本文提供了一个扩展多任务学习的方法,以利用来自其他辅助任务的数据点标签,并且这种方式提高了新任务的性能。在这里,我们介绍了一种新的关系多任务学习场景,其中我们利用辅助任务的数据点标签来对新任务进行更准确的预测。我们开发了MetaLink,其中我们的关键创新是构建一个连接数据点和任务的知识图,从而允许我们利用辅助任务中的标签。知识图由两种类型的节点组成:(1)数据节点,其中节点特征是由神经网络计算的数据嵌入;(2)任务节点,每个任务的最后一层权重作为节点特征。此知识图中的边捕获数据任务关系,边标签捕获特定任务上的数据点的标签。在MetaLink下,我们将新任务重新定义为数据节点和任务节点之间的链接标签预测问题。MetaLink框架为从辅助任务标签到感兴趣任务的知识转移建模提供了灵活性。我们在生化和视觉领域的6个基准数据集上评估MetaLink。实验表明,MetaLink可以成功地利用不同任务之间的关系,在所提出的关系型多任务学习场景下优于最先进的方法,ROC AUC提高了27%。

一、背景知识

为了对多任务学习的概念有个更加深入的理解,我们首先对多任务学习及其相关概念进行一下辨析。

图1 单任务学习与多任务学习的区别

来源:https://github.com/mbs0221/Multitask-Learning/blob/master/pdf/Multi-Task%20Learning-Theory,%20Algorithms,%20and%20Applications.pdf

如图1所示,传统的单任务学习场景下(图1a),在针对不同学习任务,需要建立各自的模型,逐一学习,且各个模型之间无法共享参数。而多任务学习(图1b)不同于单任务学习,它使用共享表示(模型)将一个问题与其他相关问题同时进行学习。

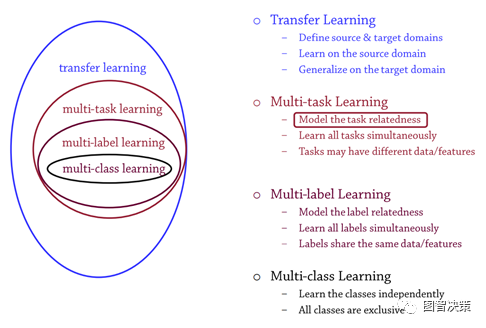

图2 不同学习方法的区别与联系

图2显示了与多任务学习的相关概念及其联系。从图中可以看出迁移学习的概念最广泛、其次为多任务学习、多标签学习、多类别学习等。

其中迁移学习的特点为:

(1)需要定义来源域和目标域

(2)模型在来源域上学习

(3)模型需要在目标域上进行泛化

多任务学习的特点为:

(1)对任务之间的关联关系建模

(2)同步完成多个任务上的学习

(3)不同任务的数据/特征不尽相同

多标签学习的特点为:

(1)对标签之间的关联关系建模

(2)同步完成多个标签上的学习

(3)不同标签具有相同的的数据/特征

多分类学习的特点为:

(1)对每个类别进行独立学习

(2)不同类之间是互斥的

二、论文简介

关于如何从多个任务中进行学习这一话题,研究者从不同视角进行了探索,提出了包括多任务学习(Caruana, 1997)、元学习(Finn et al., 2017)和少样本学习(Vinyals et al., 2016; Cao et al., 2020a;b)等多种学习模式。虽然这些学习模式促进了多种考虑任务之间关系的学习模型(Chen et al., 2019; Zamir et al., 2018; Sener & Koltun, 2018; Lin et al.,2019; Ma et al., 2020),但这些模型却无法捕捉真实世界机器学习应用程序的全部复杂性。具体地说,当从多个任务中学习时,这些方法假设测试数据在对一个新任务进行预测时,无法使用来自其他任务的标签。然而,在许多实际应用中,这种假设过于简化了,忽略了对潜在有用知识的利用。

例如,多任务学习研究同时学习多个预测任务,以利用任务之间的共同特性。测试时,多任务模型可以在感兴趣的任务(即目标任务)上预测给定数据点所对应的标签,例如,预测化合物是否无毒。同时,人们还可以访问其他辅助任务上数据点的标签信息,例如,化合物在两次毒理学测试中有阳性结果。这样的辅助任务标签可以极大地帮助改进目标任务上的预测结果。

然而,目前的深度学习体系结构无法模拟辅助任务/标签与目标任务之间的这种知识迁移。仅仅将已知的标签拼接到输入特性有其局限性,特别是因为这样的标签通常比较难以获取,且尚不清楚如何将这些标签用于新任务和不可见任务。另一种思路是通过生成模型来建模这种灵活且有条件的推理任务 (Dempster et al., 1977; Koller & Friedman, 2009)。虽然生成模型功能强大,但它们是出了名的数据饥渴,因此为高维数据构建和训练生成模型非常困难(Turhan & Bilge, 2018)。

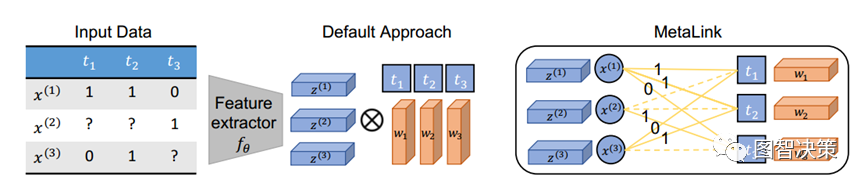

图3:MetaLink架构示意图

在关系型多任务场景下,模型学会在预测时加入辅助知识,以提升数据效率。具体而言,给定任务子集 上的观察值

及其标签

,目标是建立一个模型,利用辅助任务标签

并对新任务

进行预测(由于文章主要以二分类任务为例,因此标签为0或者1)。通常采用的方法是建立一个多头深度神经网络,为每个单独的任务 设置一个预测头。然而,这种方法不能使用辅助标签。相比之下,我们提出的MetaLink将每个任务的最后一层权重重新解释为任务节点,并创建一个知识图,其中途中的节点包括数据节点和任务节点,边上的标签则表示该任务与数据是否有关联(任务是否可以使用数据点上的标签)。在预测给定任务

的数据点标签时,MetaLink可以使用来自其他任务上的标签,从而提高了在目标任务上的预测性能。

在这里,我们提出了一种新的多任务学习场景,称为关系型多任务学习。在我们的场景中,我们区分目标任务(例如,预测分子毒性)和辅助任务,前者是我们旨在预测的任务,后者是在推断时数据标签可用的任务。注意,在我们的场景下,每个数据点可能带有用于辅助任务的不同子集的标签。因此,模型的目标是通过在辅助任务的某些子集上利用给定数据点的标签来实现强大的预测性能。

为了解决关系型多任务学习问题,我们提出了一个名为MetaLink的通用判别模型,它可以显式地融合辅助任务中的知识。我们的核心创新是构建一个连接不同任务 和数据点

的知识图(图4)。 我们方法的第一步是获取取输入数据点

和特征提取器(即神经网络)

,得到其嵌入

。然后我们构建了由两种节点组成的知识图:数据节点

和任务节点

。如果数据点

参与了任务

,并且在任务上

用到了

的标签

,则数据节点

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

736

736

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?