最近的CVPR2018会议上,提出了一个新的更接近真实场景的大型数据集MSMT17,即Multi-Scene Multi-Time,涵盖了多场景多时段。

早期数据集的缺点

(1)和实际的监控网络相比,数据集中行人和摄像头的数目不多;

(2)大多数数据集仅覆盖单一场景;

(3)时间跨度短,没有显著的光照变化;

(4)行人检测器有昂贵的人工标注或过时的DPM模型实现。

MSMT17数据集描述

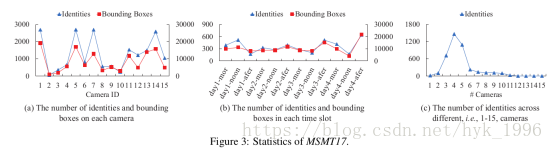

数据集采用了安防在校园内的15个摄像头网络,其中包含12个户外摄像头和3个室内摄像头。为了采集原始监控视频,在一个月里选择了具有不同天气条件的4天。每天采集3个小时的视频,涵盖了早上、中午、下午三个时间段。因此,总共的原始视频时长为180小时。

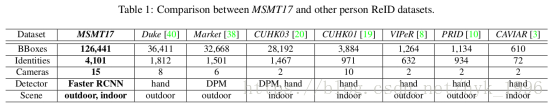

基于Faster RCNN作为行人检测器,三位人工标注员用了两个月时间查看检测到的包围框和标注行人标签。最终,得到4101个行人的126441个包围框。和其它数据集的对比以及统计信息如下图所示。

MSMT17数据集的特点如下:

(1)数目更多的行人、包围框、摄像头数;

(2)复杂的场景和背景;

(3)涵盖多时段,因此有复杂的光照变化;

(4)更好的行人检测器(faster RCNN)

评估协议

按照训练-测试为1:3的比例对数据集进行随机划分,而不是像其他数据集一样均等划分。这样做的目的是鼓励高效率的训练策略,由于在真实应用中标注数据的昂贵。

最后,训练集包含1041个行人共32621个包围框,而测试集包括3060个行人共93820个包围框。对于测试集,11659个包围框被随机选出来作为query,而其它82161个包围框作为gallery.

测试指标为CMC曲线和mAP. 对于每个query, 可能存在多个正匹配。

参考

[1] 数据集地址(含下载链接) https://www.pkuvmc.com/publications/msmt17.html

[2] 论文 Person Transfer GAN to Bridge Domain Gap for Person Re-Identification

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?